1.view_source

2.robots

3.backup

4.cookie

5.disabled_button

6.weak_auth

7.simple_php

8.get_post

9.xff_referer

10.webshell

11.command_excution

12.simple_js

1.view_source

ctrl+u查看源代码

出现以下界面:

2.robots

首先了解一下robots.txt的概念:

robots是网站跟爬虫间的协议,用简单直接的txt格式文本方式告诉对应的爬虫被允许的权限,也就是说robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。

也就是说robots.txt中存在的文件名是我们作为用户不能访问的文件。而我们为了寻找flag,则就是遇见凡是不能访问的就去访问。

构建路径:在地址栏后写入/robots.txt,得到不允许访问的界面的文件名。

访问:/f1ag_1s_h3re.php

得到flag。

3.backup

首先普及一个关于备份文件的概念:文本编辑器和代码编辑器通常对正在编辑的文件会事先产生一个备份文件,这样做的目的是让出问题后可以恢复文件。这类备份文件通常和原文件在同一个目录下,而且文件的命名也和原文件类似。 例如:对一个名为index.php的文件进行编辑,自动创建的备份文件将会被命名成“index.php.bak”。其他的代码编辑器也是一样的,都有一套自己的备份规则。

在地址栏加入路径:/index.php.bak

得到一个后缀名为.bak的文件,用记事本打开后,直接查看内容,就可以得到flag。

4.cookie

首先普及一下cookie(有时也用cookies)的概念:类型为“小型文本文件”,是某些网站为了辨别用户身份,进行Session跟踪而储存在用户本地终端上的数据(通常经过加密),由用户客户端计算机暂时或永久保存的信息

session就是建立一个用户和服务器的会话。在这里,有爬虫基础应该更容易理解。可以将cookie理解为你在网页中登录时电脑中存储的账号和密码一类的东西。

按F12进入调试界面(在这里我用的是火狐浏览器):

得到一个新页面:

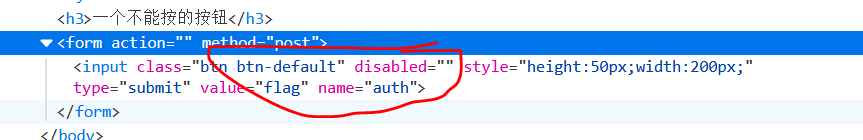

5.disabled_button

打开界面:

将disa

将disa

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4039

4039

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?