Permission denied, please try again.

遇到这个问题重置节点的密码,然后ssh连接每个节点,ssh centos2是不需要输入密码的,如果提示输入centos1的密码,则ssh秘钥分配失败。

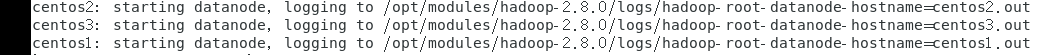

jps查看进程无datanode

在centos1中输入命令:

hadoop-daemons.sh start datanode 启动所有的数据节点

hadoop-daemon.sh start datanode 只启动当前的数据节点

或者 删除slave上的current文件夹(在tmp文件夹下,记得先关闭hadoop)重新启动hadoop

ssh是每个节点都生成一次,分别拷贝到其他节点

ssh-copy-id centosX

hadoop-web 50070管理页面无法访问

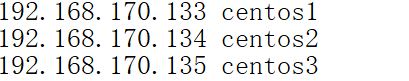

修改win下面的hosts

C:\Windows\System32\drivers\etc\hosts

关闭虚拟机防火墙

查看防火墙状态

systemctl status firewalld

开启防火墙

systemctl start firewalld

关闭防火墙

systemctl stop firewalld

永久关闭

systemctl disable firewalld.service

以上方法还是无法访问:

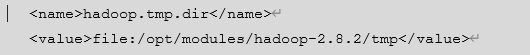

找到tmp文件夹(在core-site.xml中定义)

删除tmp文件夹下面的dfs文件夹

然后hadoop namenode -format

注意访问的web页面是http://ip地址 不是https://ip地址

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?