HDFS入门

【实验要求】

- 安装配置好jdk;

- 构建Maven环境;

- Eclipse中使用Maven构建HDFS API;

【实验目的】 - 了解HDFS文件系统;

- 掌握HDFS的架构及核心组件的职能;

- 掌握HDFS数据的读写流程;

- HDFS常用操作(Shell/Java API);

- 了解Hadoop2.0中HDFS相关的新特性。

实验环境 - Hadoop集群。

- Windows环境。

实验内容与完成情况

项目一 HDFS入门

任务一 Eclipse中使用Maven构建HDFS API。

1.验证,在cmd输入mvn -v。

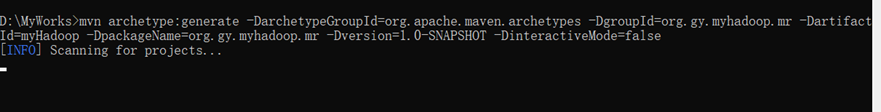

2.在D盘下创建MyWorks文件夹,从cmd中进入到D盘下的MyWorks文件夹中,然后用Maven创建一个标准化的Java项目。

3.通过DOS进入刚才所构建的项目目录内部执行:(cd myHadoop)->执行mvn clean install。

4.启动Eclipse,导入刚才创建的项目。

5.修改项目下的pom.xml,增加Hadoop依赖。

6.再次执行mvn clean install。

7.从Hadoop集群中下载以下三个配置文件:core-site.xml,hdfs-site.xml,mapred-site.xml。

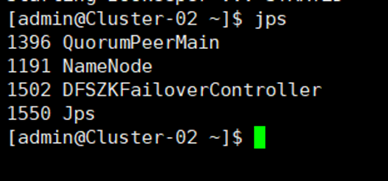

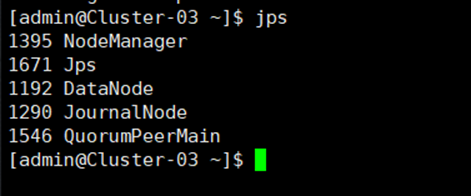

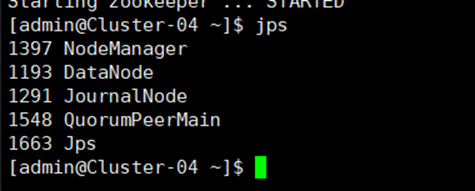

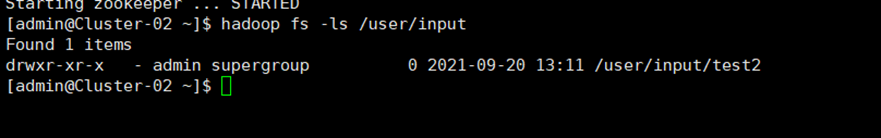

8.启动hadoop集群

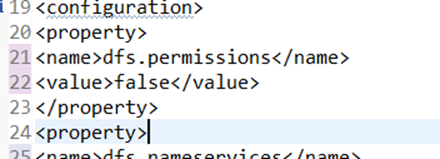

- 修改hdfs-site.xml文件,在之间添加如下内容并上传至Hadoop集群。

10.修改配置本地host—在C:\Windows\System32\drivers\etc。在修改时会弹出权限不足的错误,需进行如下操作:选中host,右击点击属性,选择安全,点击编辑,完全控制勾选允许。

11.添加系统环境变量HADOOP_USER_NAME,值为admin(登录Hadoop用户)

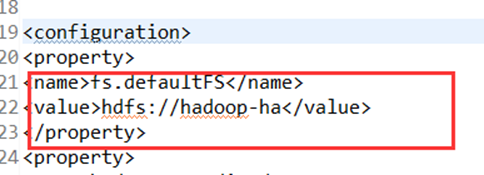

12.core-site.xml中的fs.defaultFS值

13.修改系统登录用户名为Hadoop的登录用户名:admin,更改完成后需重启电脑,用户名才能生效

4.在Hadoop集群中修改hdfs的用户权限:hadoop fs -chmod 777 /

5.编辑App.Java

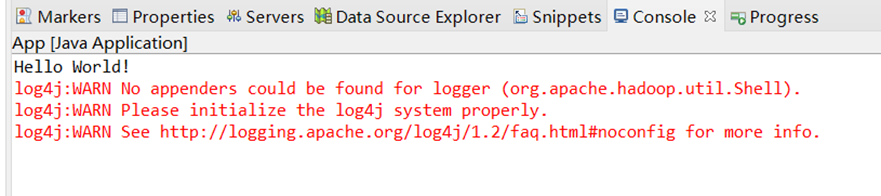

6.运行结果

1961

1961

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?