这次我们抓取多个元素,通过对元素的处理,拼接成我们想要的格式。

首先还是找到爬取内容:电影类型以及对应的url

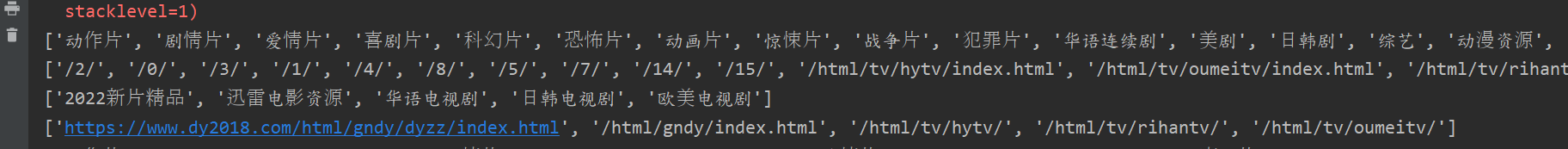

爬取结果:

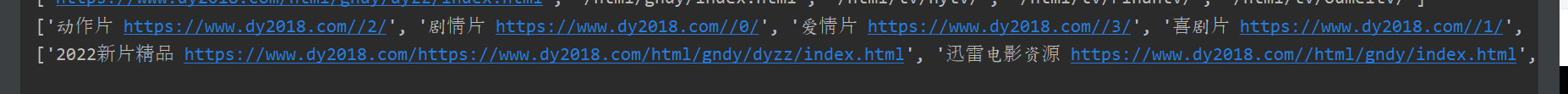

我们想要的结果:

import requests

from lxml import etree

#爬取目标 电影类型以及url

#首先是获取目标网页的内容

sum_http = 'https://www.dy2018.com/'

response = requests.get(sum_http)

response.encoding = 'UTF-8'

html = etree.HTML(response.content, parser=etree.HTMLParser(encoding='gbk'))

dayli_http = html.xpath("//div[@class='contain']")[0]

#开始爬取内容

fime_type = []

f_type_name = dayli_http.xpath("//div[@class= 'contain']/ul/li/a/text()")

f_type_url = dayli_http.xpath("//div[@class= 'contain']/ul/li/a/@href")

f_list_name = dayli_http.xpath("//div[@class='index_list']/div[@class='co_area2']//span[@style='float:left;']/a/text()")

f_list_url = dayli_http.xpath("//div[@class='index_list']/div[@class='co_area2']//span[@style='float:left;']/a/@href")

# print(f_type_name)

# print(f_type_url)

# print(f_list_name)

# print(f_list_url)

'''

爬取到了自己想要的,但是有些格式不对,需要我们进行改动分类

地址需要我们进行拼接

最后的格式:动作片 https://www.dy2018.com/2/

2022新片精品 https://www.dy2018.com/html/gndy/dyzz/index.html

'''

# #查看下他们的类型 都是list集合

# print(type(f_type_name))

# print(type(f_type_url))

# print(type(f_list_name))

# print(type(f_list_url))

#进行改动

#首先对f_type_url

new_f_type_url = []

for i in f_type_url:

new_f_type_url.append(sum_http+i)

# print(new_f_type_url)

#接下来对f_list_url继续宁改动

new_f_list_url = []

for i in range(len( f_list_url)):

new_f_list_url.append(sum_http+f_list_url[i])

# print(new_f_list_url)

#开始合并

add_f = []

add_f_list = []

for i in range(len(f_type_name)):

# print(f_type_name[i]+" "+new_f_type_url[i])

add_f.append(f_type_name[i]+" "+new_f_type_url[i])

for i in range(len(f_list_name)):

# print(f_list_name[i]+new_f_list_url[i])

add_f_list.append(f_list_name[i]+" "+new_f_list_url[i])

print(add_f)

print(add_f_list)版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

本文链接:https://blog.csdn.net/qq_44778375/article/details/123874901

1714

1714

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?