Java读取hdfs数据

前言

大数据实验课,记录一下用Java读取hdfs文件的方式

一、创建一个maven项目

二、导入依赖

<dependencies>

<!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-common -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.2</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-client -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.7.2</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-hdfs -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>2.7.2</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.11</version>

<scope>test</scope>

</dependency>

</dependencies>

三、代码

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import java.io.File;

import java.io.IOException;

public class HdfsTest {

public static void main(String[] args) throws IOException {

readFileToConsole("/a.txt");

}

// 读取hdfs文件系统中的文件

private static void readFileToConsole(String path) throws IOException {

// 获取配置

Configuration conf = new Configuration();

// 配置

conf.set("fs.defaultFS","hdfs://172.27.66.46:9000");

// 获取hdfs文件系统的操作对象

FileSystem fs = FileSystem.get(conf);

// 具体的对文件系统的操作

FSDataInputStream fsDataInputStream = fs.open(new Path(path));

IOUtils.copyBytes(fsDataInputStream,System.out,4096,true);

}

}

运行后出现错误:

Failed to execute goal org.codehaus.mojo:exec-maven-plugin:1.6.0:exec (default-cli) on project bigData: Command execution failed.

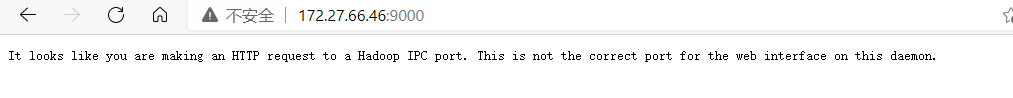

查了很多资料,都说的插件错误,或者idea版本问题,但是把所有方法都试了一遍,发现没用,后面发现9000端口无法返回页面,意识到,可能只是单纯的端口无法访问,查资料发现,Hadoop中9000端口默认无法从外界访问,只能本机访问,于是进行修改,参考了这篇文章:

Hadoop本地开发,9000端口拒绝访问

改了之后再在浏览器进行访问:

虽然还是不能访问,但是和之前的返回页面已经不一样了,于是打算试试,再次运行代码:

这次终于成功了,将hdfs上的一个文件内的内容输出到了本地控制台

总结

9000端口在浏览器上访问还是不能返回一个正常的页面,我估计是我只配置了集群中master的/etc/hosts文件,其他的节点中没有配置,如果都修改了,就需要把ssh公钥再重新配置一下,嫌麻烦就没弄了

2131

2131

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?