Blob是caffe里面的数据结构,是基本的数据存储单元,其主要存储的数据是网络中的中间数据变量,比如各层的输入输出、代价函数对于各层参数的梯度。

Blob中除了存储数据外,还有一些标记数据的参数,如下:

protected:

shared_ptr<SyncedMemory> data_; //网络各层的输入输出

shared_ptr<SyncedMemory> diff_; //代价函数对于各层参数的梯度

shared_ptr<SyncedMemory> shape_data_;

vector<int> shape_; //是一个可变数组,主要存储4个变量==>num:一个batch中的样本数量,blob的存储层是以batch为基本单位的;channels:对应层的通道,比如卷积层有20个卷积核,channels的值就是20;height、width:单个数据的尺寸,可能是一副图像的尺寸,也可能是卷积核的尺寸,在每一层所代表的含义也不相同。

int count_; //这个Blob里已经存储的元素的个数

int capacity_; //这个Blob里面的容量

Blob同时保存了data_和diff_,类型都为SyncedMemory的指针。

Blob除了数据成员之外,也有很多用于操作数据的函数成员,下面将提到几个比较重要的:

void Blob<Dtype>::Reshape() //在原来分配的内存不够的情况下重新分配内存

const Dtype* Blob<Dtype>::cpu_data() //获取Blob结构体中的data_数据的指针,同时限制不能对返回的指针指向的内容进行更改

const Dtype* Blob<Dtype>::cpu_diff() //获取Blob结构体中的diff_数据的指针,同时限制不能对返回的指针指向的内容进行更改

Dtype* Blob<Dtype>::mutable_cput_data() //获取Blob结构体中的data_数据的指针,同时可以对指针指向的内容更改

Dtype* Blob<Dtype>::mutable_cpu_diff() //获取Blob结构体中的diff_数据的指针,同时可以对指针指向的内容更改

void Blob<Dtype>::ShareData(const Blob& ohter) //让其他Blob的data_数据和当前Blob共享

void Blob<Dtype>::ShareDiff(const Blob& other) //让其他Blob的diff_数据和当前的Blob共享

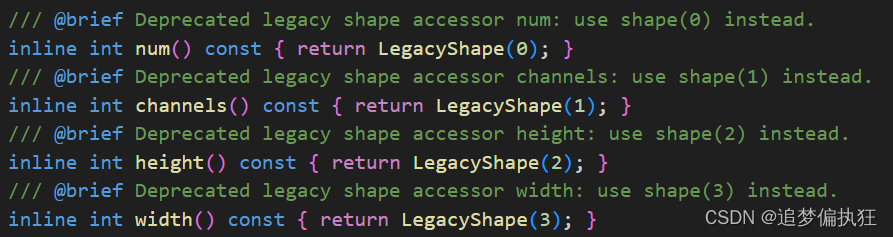

在blob.h中还有这样的定义:

这四个函数和shape()是一样的作用。shape()本身是一个vector数组,size是4,第一个位置存储图片的数量,第二个位置存储通道的数量,第三第四个位置存储图片的尺寸。

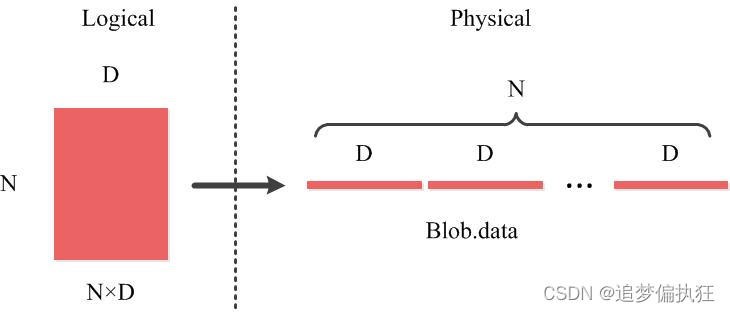

逻辑上看,Blob是一个四维数组,但实际上,因为数组的存储是在内存中开辟一块连续的、大小相同的内存空间,所以Blob的存储应该是一个一维的存储结构,只不过时利用四个参数来进行寻址(shape_里的四个参数),并且Blob是行优先的存储方式。

所以对于一个(n, k, h, w)的Blob,其维度是n * k * h * w,在(n, k, h, w)位置的物理位置是((n * K + k) * H + h) * W + w。

以Blob中二维矩阵为例(如全连接网络shape(N, D)),如图所示,同样的存储方式可以推广到多维。

动态多维数组:Blob类可以动态改变数组的尺寸,当拓展数组导致原有内存空间不足以放下数据时(count > capacity),就会重新分配内存。Blob提供了一组Reshape函数来完成这个功能。

void Reshape(const int num, const int channels, const int height, const int width); // Deprecated

void Reshape(const vector<int>& shape);

void Reshape(const BlobShape& shape);

void ReshapeLike(const Blob& other);

Blob类在初始化时并没有分配内存,也是通过调用Reshape来分配内存的。

template <typename Dtype>

void Blob<Dtype>::Reshape(const vector<int>& shape) {

CHECK_LE(shape.size(), kMaxBlobAxes); // 检查维数

count_ = 1; // 用于计算新的多维数组的大小

shape_.resize(shape.size()); // 更新维数

if (!shape_data_ || shape_data_->size() < shape.size() * sizeof(int)) {

// shape_data_ 未初始化或者内存太小

shape_data_.reset(new SyncedMemory(shape.size() * sizeof(int)));

}

int* shape_data = static_cast<int*>(shape_data_->mutable_cpu_data());

for (int i = 0; i < shape.size(); ++i) {

CHECK_GE(shape[i], 0);

CHECK_LE(shape[i], INT_MAX / count_) << "blob size exceeds INT_MAX";

count_ *= shape[i];

shape_[i] = shape[i];

shape_data[i] = shape[i];

}

if (count_ > capacity_) {

// 内存不够

capacity_ = count_;

data_.reset(new SyncedMemory(capacity_ * sizeof(Dtype)));

diff_.reset(new SyncedMemory(capacity_ * sizeof(Dtype)));

}

}

538

538

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?