- 现有的大语言模型在很多任务上都表现出卓越的性能,但仍有严重的幻觉问题,生成流畅,看似正确但实际不对的答案。

- 知道语言模型什么时候能答对什么时候答不对很重要,这能帮助模型在不会的时候回答“我不会”(以防生成错误答案误导用户),也能在此时触发RAG(仅在需要时进行RAG,这又叫做Adaptive RAG)。

- 现有的很多研究关注,模型是否像人一样,知道自己会什么不会什么。这样我们就能根据模型自己的判断,来决定回复“我不会”和触发RAG的时机。

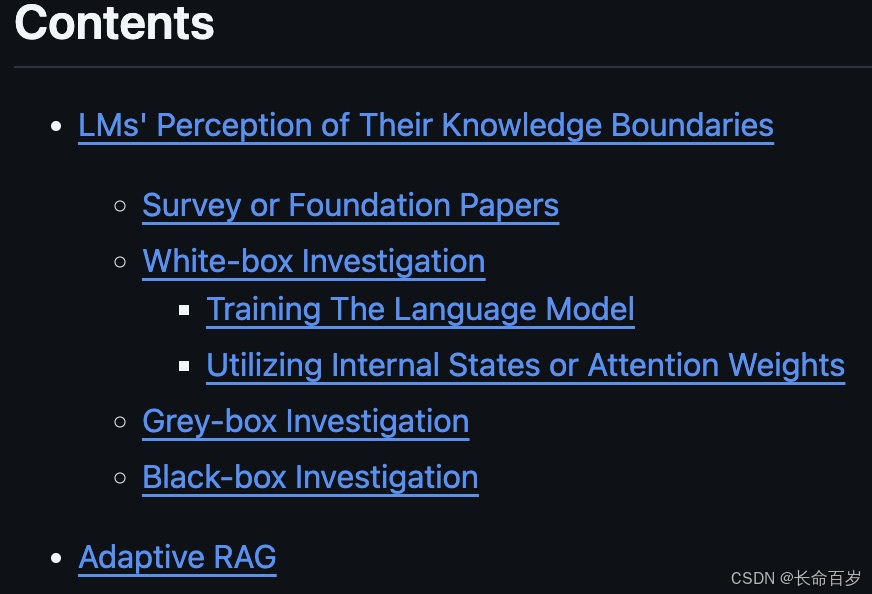

- 我们整理了现有的研究语言模型对其知识边界感知的文章:仓库链接

- 仓库初建,文章在持续更新,文章分类也在不断细化。如果觉得内容有帮助,可以点个star,如果我们有遗漏的文章,欢迎联系与交流合作

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?