1.scrapy安装

-pip install scrapy

2.创建爬虫项目

(1)win + R 打开cmd

(2)进入创建项目的文件夹

(3)scrapy startproject 项目的名字

注意:项目的名字不允许使用数字开头,切不能包含中文

例: scrapy startproject scrapy_baidu_34

3.创建爬虫文件

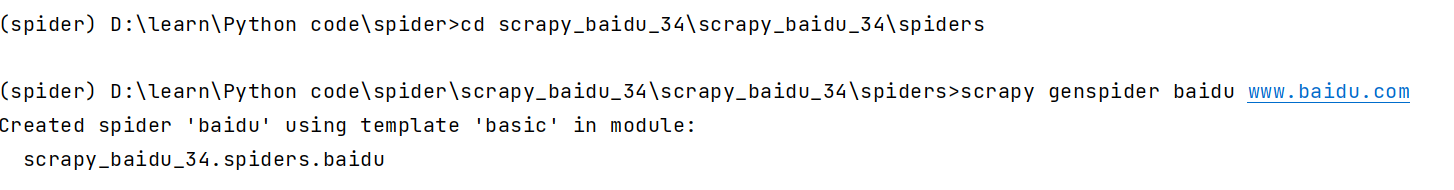

(1)在spiders文件夹下创建爬虫文件

cd 项目的名字\项目的名字\spiders

例:cd scrapy_baidu_34\scrapy_baidu_34\spiders

(2)创建爬虫文件

scrapy genspider 爬虫文件的名字 要爬取的网页

例:scrapy genspider baidu www.baidu.com

注意:网页网址前不要添加http协议

因为start_urls的值是根据allowed_domains修改的,会自动添加http://******/

如果写了http协议,在程序中手动删掉即可

3.运行爬虫代码

scarpy crawl 爬虫的名字

例:scrapy crawl baidu

此时运行会发现打印语句没有执行

这是因为爬虫遵循君子协议

我们需要在项目中找到settings文件,并找到如下语句,将其注释或将ROBOTSTXT_OBEY的值改为false

# Obey robots.txt rules ROBOTSTXT_OBEY = True

此时重新运行

发现已成功打印

1036

1036

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?