结论:在进行模型可视化时,需要将模型设置为model.eval()来保证结果稳定,方便评估,但是由于要进行梯度回传,不能像通常的推理一样使用with torch.no_grad()。

最近在进行学习的过程中需要对模型的性能进行评估,因此尝试对模型进行可视化来帮助我们更好地实现这一点。

在理解的grad-cam的基本原理后,为了省事我从csdn上直接拉了一个代码下来用,为了更好地进行可视化,我将图片的分类信息(原始类别和预测类别)都打印到了图片上。可是发现有时候同一张图的预测概率居然会有不同。进行检查后发现别人的代码中没有加上model.eval()这一操作,所以这到底意味着可视化的模型到底需不需要model.eval()呢?

对此我进行了进一步的探索,先介绍一下需要用到的基本原理:

Grad-Cam:可视化方法,需要根据指定类别的分数进行梯度回传到指定特征层。

model.eval():作用于dropout层和batchnorm层,使dropout层为0,batchnorm不再更新均值和方差,通常在推理时进行设置,使模型推理的结果稳定。

with torch.no_grad():停止对梯度的计算和储存,减少内存消耗,通常推理时会用到。

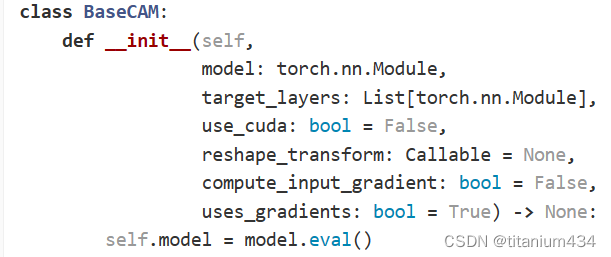

经过思考我认为,既然是通过类别分数进行可视化,那么该分数就是稳定的,否则每次可视化的结果都不同,这肯定是不利于我们评估的,因此必须使用model.eval()。但同时,由于其中出现了梯度回传的步骤,因此我们也需要保留梯度计算的结果,即不能使用with torch.no_grad()。下列仓库中的实现代码也证明了我的猜想。(截图最后一行)

https://github.com/jacobgil/pytorch-grad-cam

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?