目录

1、卷积神经网络和传统神经网络的区别

1.1、传统神将网络(nn)

传统神经网络(NN),是目前各种神经网络的基础,其构造是仿造生物神经网络,将神经元看成一个逻辑单元,其功能是用于对函数进行估计和近似,是一种自适应系统,通俗的讲就是具备学习能力。

其作用,目前为止就了解到分类。其目的就是在圈和叉之间画出一条分界线,使得接下来我们可以根据其位置来预测其属于哪个分类。这个图只有两种分类,实际上可以有非常多种,但其网络结构也会变得复杂,可以说一层网络可以画一条线,多层网络就可以画多条线。

其内部最主要的构造就是神经元,如下图所示

这张图有五个部分组成

- 输入向量

- 权重

- 求和

- 激励函数

- 输出

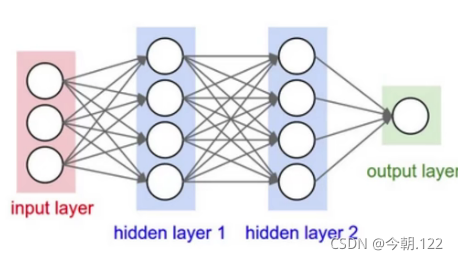

可以把权重,求和,激励函数合并在一起,统称为隐藏层,输入的向量可以成为输入层,输出的向量可以称为输出层。

因此神经网络的基础结构便是三层结构

- 输入层

- 隐藏层

- 输出层

传统神经网络示意图

1.2、卷积神经网络

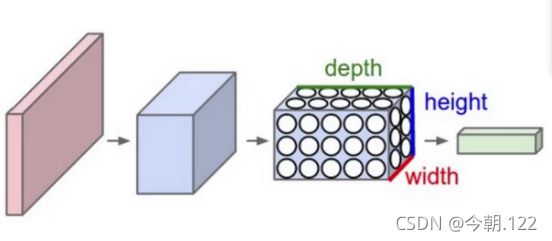

典型的卷积神经网络由5部分构成:

- 输入层

- 卷积层

- 池化层

- 全连接层

- 输出层

卷积层负责提取图像中的局部特征;池化层用来大幅降低参数量级(降维);全连接层类似传统神经网络的部分,用来输出想要的结果,也就是神经网络当中的隐藏层。

目前卷积神经网络主要用于图像处理的方面。

2、卷积神经网络的具体介绍

2.1、输入层

就是给出的图像数据,跟传统神经网络类似。

2.2、卷积层——提取特征

使用多个filter在图像上面做内积,得出多个特征,卷积的过程就是拿一个矩阵在原图矩阵上面边移动,边做内积,最后得出一个比原图小一点的矩阵。如图所示,一个9*9的矩阵被filter后变成了-8。

本文详细介绍了卷积神经网络(CNN)与传统神经网络的区别,重点阐述了CNN的组成部分,包括输入层、卷积层(特征提取)、池化层(特征压缩)。卷积层涉及的关键参数如卷积核大小、步长和填充等进行了说明,并给出了卷积结果的计算公式。同时,讨论了池化层中的最大池化操作。最后,通过PyTorch展示了CNN网络的代码实现。

本文详细介绍了卷积神经网络(CNN)与传统神经网络的区别,重点阐述了CNN的组成部分,包括输入层、卷积层(特征提取)、池化层(特征压缩)。卷积层涉及的关键参数如卷积核大小、步长和填充等进行了说明,并给出了卷积结果的计算公式。同时,讨论了池化层中的最大池化操作。最后,通过PyTorch展示了CNN网络的代码实现。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?