主题:执行sqoop任务

进入:

DolphinScheduler UI地址为http://Hadoop:12345/dolphinscheduler

初始用户的用户名为:admin,密码为dolphinscheduler123

需求:将hive表中的数据导出到MySQL中

1.准备一个文件上传到HDFS

2.通过load命令将HDFS的数据导入hive表test中

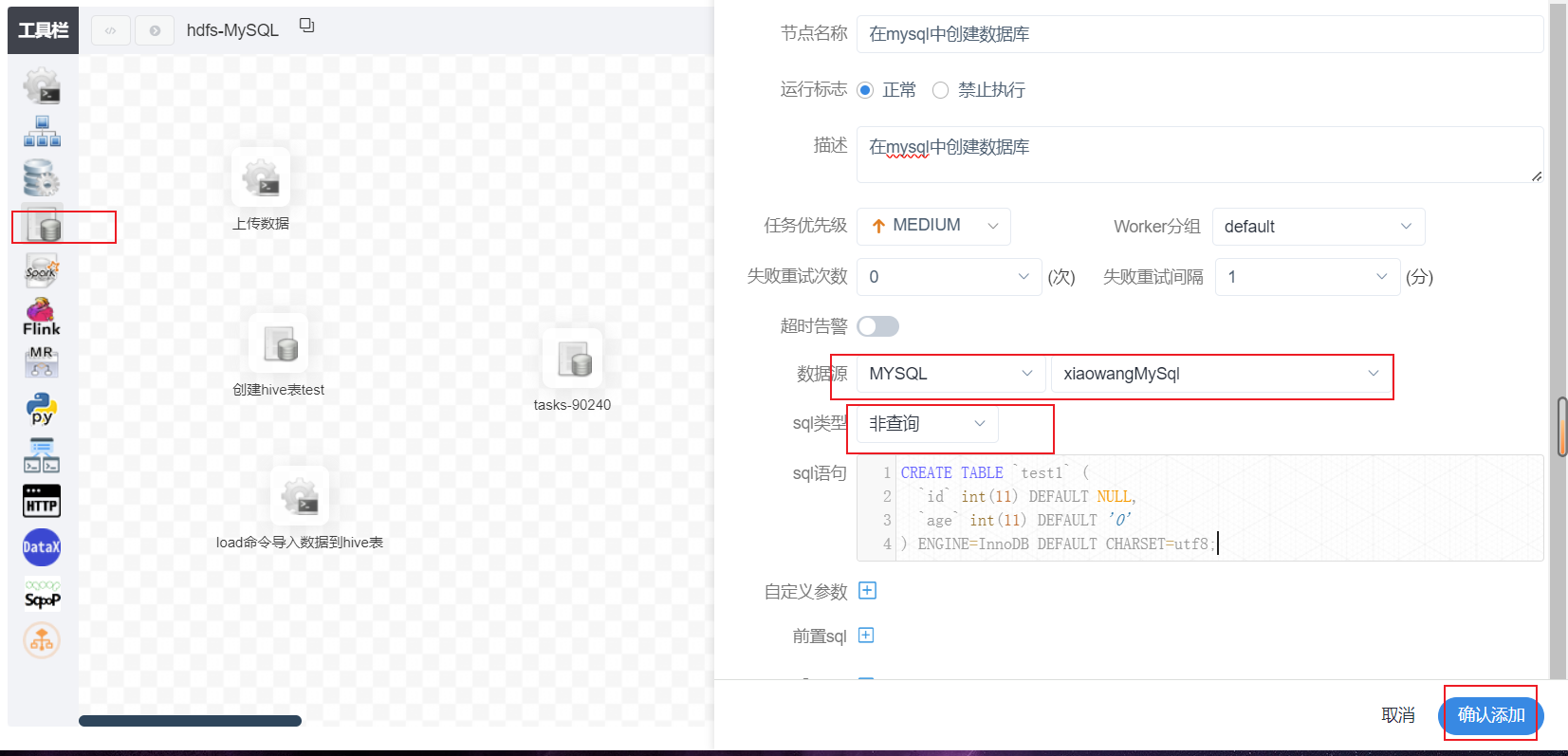

3.在mysql中创建数据库

4.通过sqoop将hive表中的数据导入mysql

以需求来驱动了解ds中hive、sqoop任务的执行

准备工作:

1.在DS中创建一个项目,来完成我们的需求

2.用到了MySQL和HIVE,所以需要先添加数据源

3.创建工作流

1.在ds创建项目 ds-sqoop

2.添加数据源

MySQL

HIVE

3.创建工作流

1.准备一个文件b.txt上传到HDFS

1)在/opt/data/下创建b.txt

1,18

2,20

3,302)上传数据到hdfs

hdfs dfs -mkdir -p /ds_data

hdfs dfs -put /opt/data/b.txt /ds_data

2.通过load命令将HDFS的数据导入hive表中test

1)先创建一个hive表,表中必须有数据:

create table if not exists test(

`id` int,

`age` int

)

row format delimited

fields terminated by ',';

2)通过load命令导入数据到hive表中

load data inpath '/opt/data/b.txt' into table test

3.在mysql中创建数据库:

在mysql中创建数据库:

CREATE TABLE `test1` (

`id` int(11) DEFAULT NULL,

`age` int(11) DEFAULT '0'

) ENGINE=InnoDB DEFAULT CHARSET=utf8;

4.编写Sqoop脚本:将hive表中的数据导入mysql

sqoop export \

--connect jdbc:mysql://bigdata01:3306/sqoop \

--username root \

--password 123456 \

--table test1 \

--hcatalog-database day0906 \

--hcatalog-table test \

-m 1

527

527

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?