💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

💥1 概述

RIME-CNN-LSTM-Attention是一个结合了多种神经网络技术的复合模型,用于解决各种机器学习问题。让我简要解释一下这个模型的各个部分:

1. **霜冰优化算法**(Frost Optimization Algorithm,简称FOA):这是一种元启发式优化算法,受到自然界霜冰形成的过程启发而来。FOA的主要思想是通过模拟霜冰在表面凝结的过程来实现优化搜索,用于寻找函数的全局最优解。

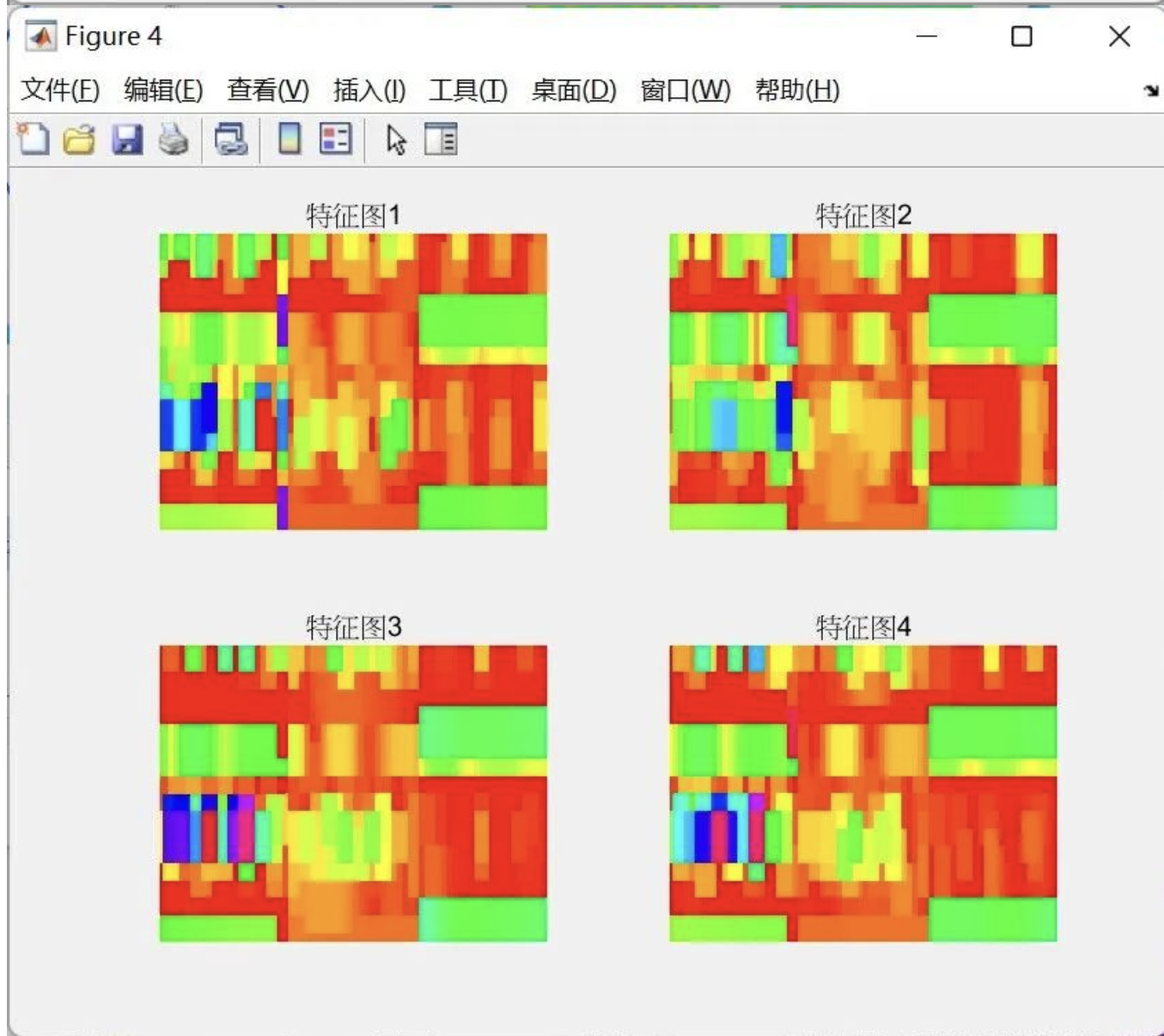

2. **卷积神经网络**(Convolutional Neural Network,简称CNN):CNN是一种专门用于处理网格化数据(如图像、语音)的神经网络结构。它通过在数据上应用卷积操作来捕获局部特征,并通过池化操作来减少计算量和参数数量。

3. **注意力机制**(Attention Mechanism):在神经网络中,注意力机制用于动态地学习输入序列中不同部分的重要性,从而使模型能够集中注意力于最相关的部分。这在处理序列数据时特别有用,比如自然语言处理任务中的机器翻译或文本摘要。

4. **长短期记忆网络**(Long Short-Term Memory,简称LSTM):LSTM是一种循环神经网络结构,专门设计用来处理序列数据,能够有效地捕获序列中的长期依赖关系。相比于传统的循环神经网络,LSTM通过门控单元的设计来更好地控制信息的流动,从而缓解了梯度消失和梯度爆炸等问题。

将这些技术结合起来,RIME-CNN-LSTM-Attention模型可以在处理各种复杂的序列数据和网格化数据任务时表现出色,比如自然语言处理、计算机视觉等领域。通过FOA进行参数优化,进一步提升了模型的性能和泛化能力。

📚2 运行结果

🎉3 参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。

[1]李战武,张帅,乔英峰,等.基于自注意力机制和CNN-LSTM的空战目标机动轨迹预测[J].兵器装备工程学报, 2023, 44(7):209-216.

[2]滕金保,孔韦韦,田乔鑫,等.基于CNN和LSTM的多通道注意力机制文本分类模型[J].计算机工程与应用, 2021, 57(23):154-162.DOI:10.3778/j.issn.1002-8331.2104-0212.

[3]邵星,曹洪宇,王翠香,等.一种基于注意力机制的VMD-CNN-LSTM短期风电功率预测方法[J].[2024-04-17].DOI:10.12677/ORF.2024.141067.

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?