2.10

今日完成了PTv2模型代码的注释(一共耗时三个半星期注释完成)。

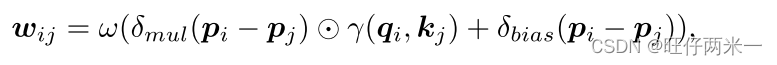

总结下来最重要的模块就是构造了分组向量注意力机制。注意力机制的本质就是定位到感兴趣的信息,屏蔽掉无用的信息,以矩阵或者向量的形式出现。这里将编码通道进行一个分组(一个创新点),然后依次求取Q,K,V值。这里的attention机制和PT的attention机制编写十分相似,相当于进行了一个升级。以及,还加入了偏置(bias)变量来加强对位置信息的关注,也就是文中提到的位置编码乘法器。

通过该公式,可以看出这里加入了两个MLP进行位置编码,补充了组矢量注意,这里做的目的我理解是帮助模型更快速的学习位置,实现网络容量平衡(大概意思就是对网络容量很友好)。

代码根据公式走,还是很好理解的。主要难点是公式的诠释(想不到为什么这么做)。

明日在针对池化模块进行总结,把文章梳理完成。

793

793

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?