具体的搭建过程参考:PySpark环境搭建 - iveBoy - 博客园 (cnblogs.com)

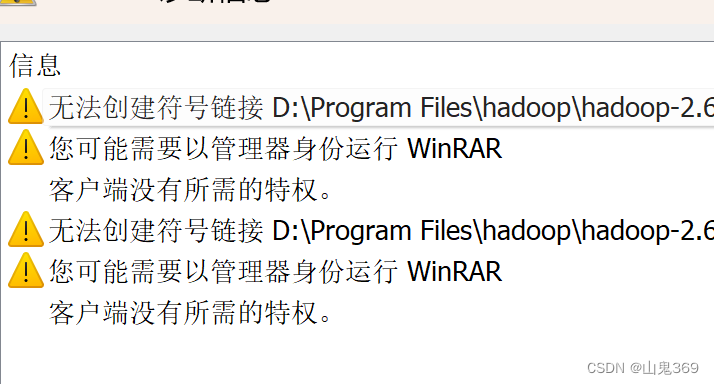

1.在解压hadoop文件时发现报错:

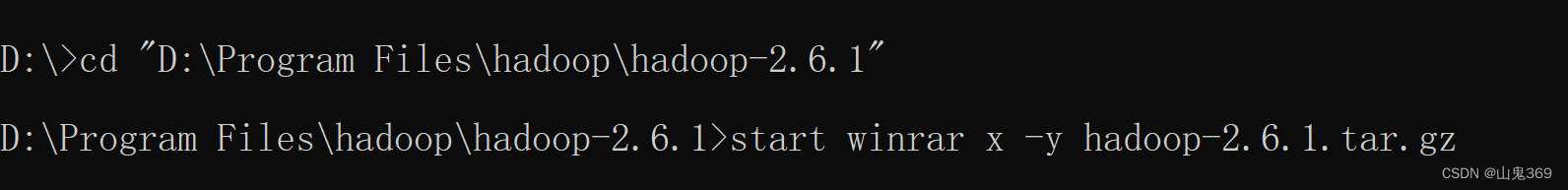

解决办法:以管理员权限打开cmd切换目录至要下载到的路径

输入start winrar x -y hadoop-2.6.1.tar.gz即可

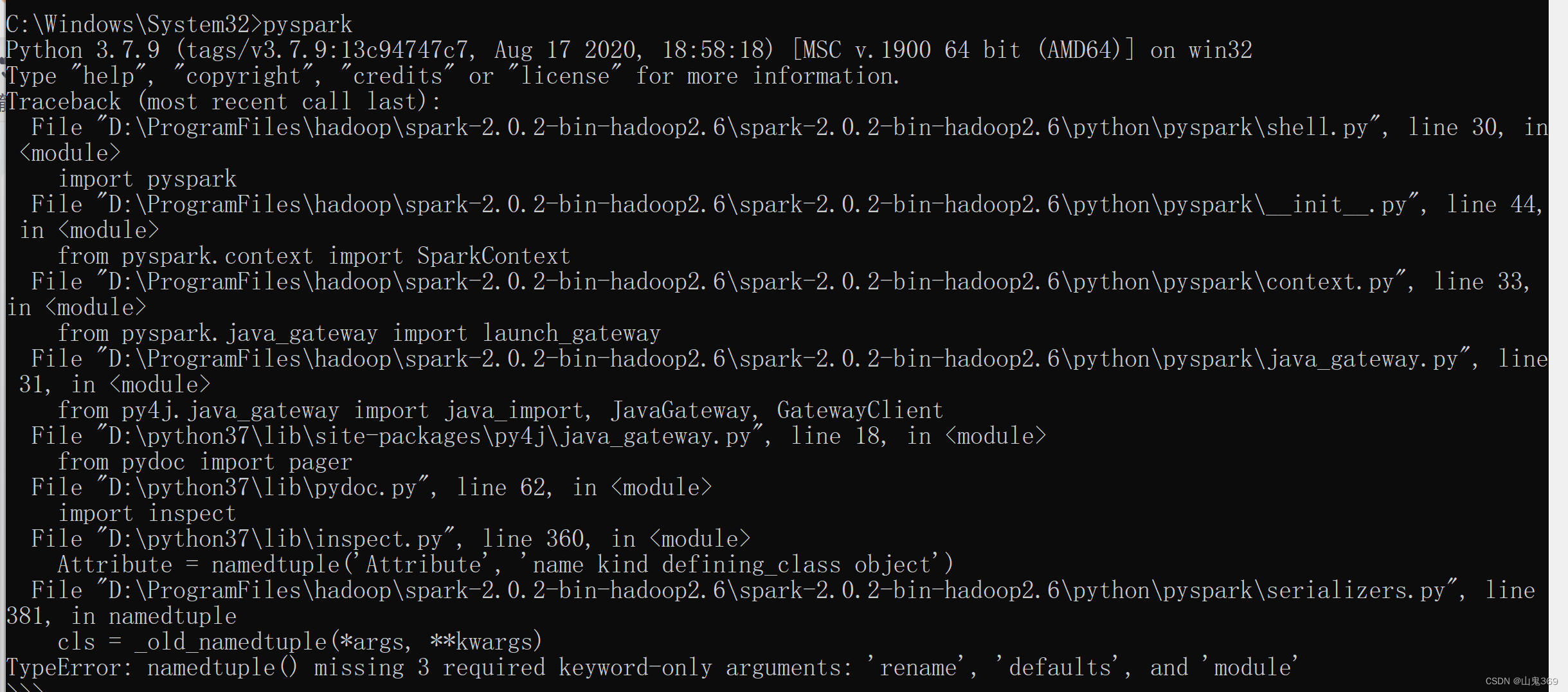

2.cmd输入 pyspark报错系统找不到路径,

2.cmd输入 pyspark报错系统找不到路径,

发现时系统路径名含空格,去掉名字中的空格即可

3.重命名之后再次输入·pyspark 发现spark和python版本不一致

我用的是python3.7,经过查询要用spark3.0版本

具体可以看这个贴子查询对应的spark:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?