Hive 安装

在opt目录上传hive安装包

# 解压

tar -zxvf apache-hive-3.1.3-bin.tar.gz

# 重命名

mv apache-hive-3.1.3-bin hive

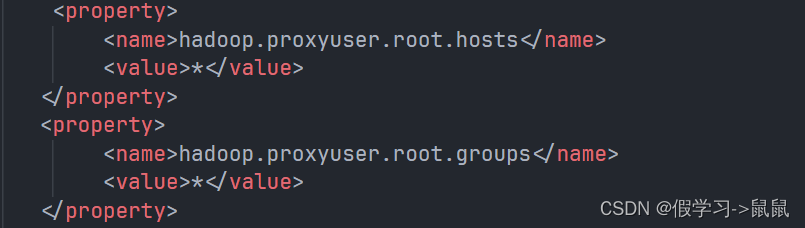

修改hadooop配置文件core-site.xml,添加

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

在/opt/hive/conf目录下新建hive-site.xml配置文件

<configuration>

<!-- MySQL JDBC连接配置 -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExist=true</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.cj.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<!-- 连接用户名 -->

<value>root</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<!-- 连接密码 -->

<value>123</value>

</property>

<!-- Hive元数据存储路径配置 -->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/opt/hive/warehouse</value>

</property>

<!-- Hive Thrift Server2配置 -->

<property>

<name>hive.server2.thrift.port</name>

<value>10000</value>

</property>

<property>

<name>hive.server2.thrift.bind.host</name>

<value>shushu</value>

</property>

<property>

<name>hive.server2.enable.doAs</name>

<value>true</value>

</property>

</configuration>

进入到Hive的home目录,进入到bin目录中,找到hive-config.sh脚本

export HADOOP_HEAPSIZE=${HADOOP_HEAPSIZE:-20480}

配置Hive系统环境变量

在/etc/profile文件中添加

# HIVE

export HIVE_HOME=/opt/hive

export PATH=$PATH:$HIVE_HOME/bin

source /etc/profile

同步guava包

在/opt/hive/lib中上传mysql-connector-j-8.2.0.jar

选择hadoop和hive中guava.jar版本高者,删除低版本

本机中hadoop中的guava-27.0-jre.jar较高

所以删除hive中的guava.jar,并拷贝hadoop中的guava-27.0-jre.jar到/opt/hive/lib下

上传mysql-connector-j-8.2.0.jar

初始化Hive元数据库(修改为采用MySQL存储元数据)

schematool -initSchema -dbType mysql

启动hiveserver2

hiveserver2

进入命令行界面

hive

6万+

6万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?