本文将讨论文本预处理的基本步骤,旨在将文本信息从人类语言转换为机器可读格式以便用于后续处理。此外,本文还将进一步讨论文本预处理过程所需要的工具。

当拿到一个文本后,首先从文本正则化(text normalization) 处理开始。常见的文本正则化步骤包括:

将文本中出现的所有字母转换为小写或大写

将文本中的数字转换为单词或删除这些数字

删除文本中出现的标点符号、重音符号以及其他变音符号

删除文本中的空白区域

扩展文本中出现的缩写

删除文本中出现的终止词、稀疏词和特定词

文本规范化(text canonicalization)

下面将详细描述上述文本正则化步骤。

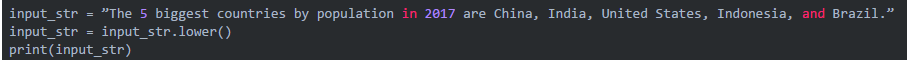

将文本中出现的字母转化为小写

示例1:将字母转化为小写

Python 实现代码:

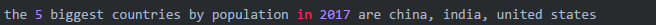

输出:

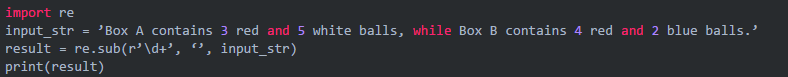

删除文本中出现的数字

如果文本中的数字与文本分析无关的话,那就删除这些数字。通常,正则化表达式可以帮助你实现这一过程。

示例2:删除数字

Python 实现代码:

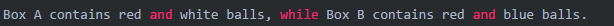

输出:

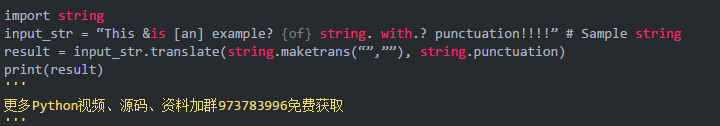

删除文本中出现的标点

以下示例代码演示如何删除文本中的标点符号,如 [!”#$%&’()*+,-./:;<=>?@[]^_`{|}~] 等符号。

示例3:删除标点

Python 实现代码:

输出:

Thisisan exampleofstringwithpunctuation

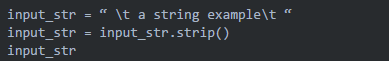

删除文本中出现的空格

可以通过 strip()函数移除文本前后出现的空格。

示例4:删除空格

Python 实现代码:

输出:

‘astringexample’

符号化(Tokenization)

符号化是将给定的文本拆分成每个带标记的小模块的过程,其中单词、数字、标点及其他符号等都可视为是一种标记。在下表中(Tokenization sheet),罗列出用于实现符号化过程的一些常用工具。

删除文本中出现的终止词

终止词(Stop words) 指的是“a”,“a”,“on”,“is”,“all”等语言中最常见的词。这些词语没什么特别或重要意义,通常可以从文本中删除。一般使用 Natural Language Toolkit(NLTK) 来删除这些终止词,这是一套专门用于符号和自然语言处理统计的开源库。

示例7:删除终止词

实现代码:

输出:

[‘NLTK’, ‘leading’, ‘platform’, ‘building’, ‘Python’, ‘programs’, ‘work’, ‘human’, ‘language’, ‘data’, ‘.’]

此外,scikit-learn 也提供了一个用于处理终止词的工具:

fromsklearn.feature_extraction.stop_wordsimportENGLISH_STOP_WORDS

同样,spaCy 也有一个类似的处理工具:

fromspacy.lang.en.stop_wordsimportSTOP_WORDS

删除文本中出现的稀疏词和特定词

在某些情况下,有必要删除文本中出现的一些稀疏术语或特定词。考虑到任何单词都可以被认为是一组终止词,因此可以通过终止词删除工具来实现这一目标。

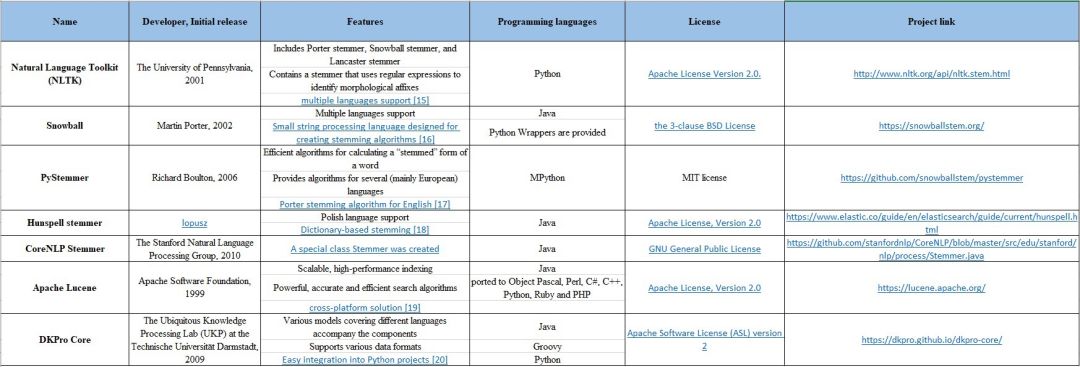

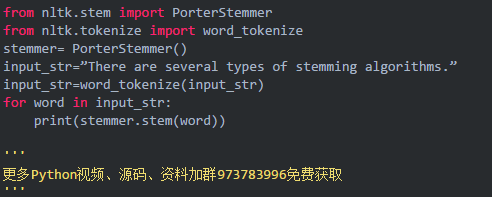

词干提取(Stemming)

词干提取是一个将词语简化为词干、词根或词形的过程(如books-book,looked-look)。当前主流的两种算法是 Porter stemming 算法(删除单词中删除常见的形态和拐点结尾) 和 Lancaster stemming 算法。

示例 8:使用 NLYK 实现词干提取

实现代码:

输出:

There are severtypeofstem algorithm.

词形还原(Lemmatization)

词形还原的目的,如词干过程,是将单词的不同形式还原到一个常见的基础形式。与词干提取过程相反,词形还原并不是简单地对单词进行切断或变形,而是通过使用词汇知识库来获得正确的单词形式。

当前常用的词形还原工具库包括: NLTK(WordNet Lemmatizer),spaCy,TextBlob,Pattern,gensim,Stanford CoreNLP,基于内存的浅层解析器(MBSP),Apache OpenNLP,Apache Lucene,文本工程通用架构(GATE),Illinois Lemmatizer 和 DKPro Core。

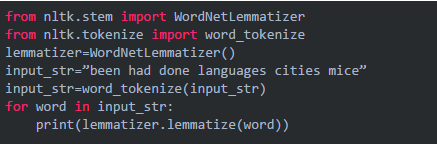

示例 9:使用 NLYK 实现词形还原

实现代码:

输出:

be havedolanguagecity mouse

词性标注(POS)

词性标注旨在基于词语的定义和上下文意义,为给定文本中的每个单词(如名词、动词、形容词和其他单词) 分配词性。当前有许多包含 POS 标记器的工具,包括NLTK,spaCy,TextBlob,Pattern,Stanford CoreNLP,基于内存的浅层分析器(MBSP),Apache OpenNLP,Apache Lucene,文本工程通用架构(GATE),FreeLing,Illinois Part of Speech Tagger 和DKPro Core。

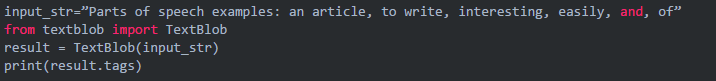

示例 10:使用 TextBlob 实现词性标注

实现代码:

输出:

[(‘Parts’, u’NNS’), (‘of’, u’IN’), (‘speech’, u’NN’), (‘examples’, u’NNS’), (‘an’, u’DT’), (‘article’, u’NN’), (‘to’, u’TO’), (‘write’, u’VB’), (‘interesting’, u’VBG’), (‘easily’, u’RB’), (‘and’, u’CC’), (‘of’, u’IN’)]

词语分块(浅解析)

词语分块是一种识别句子中的组成部分(如名词、动词、形容词等),并将它们链接到具有不连续语法意义的高阶单元(如名词组或短语、动词组等) 的自然语言过程。常用的词语分块工具包括:NLTK,TreeTagger chunker,Apache OpenNLP,文本工程通用架构(GATE),FreeLing。

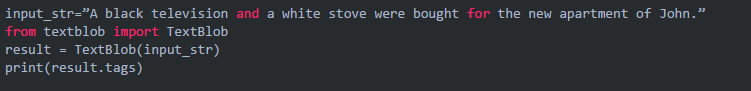

示例 11:使用 NLYK 实现词语分块

第一步需要确定每个单词的词性。

实现代码:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?