一. Finetune(微调)

1. 简介

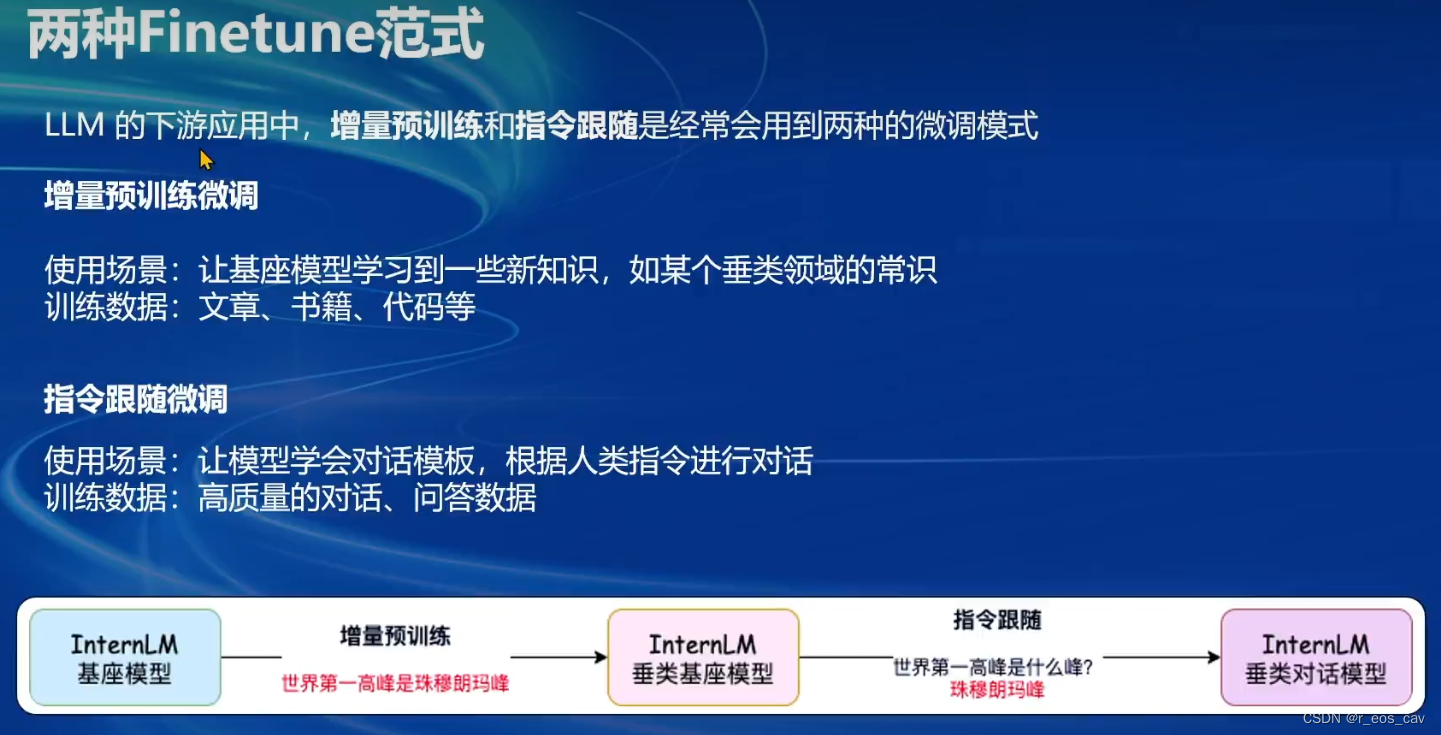

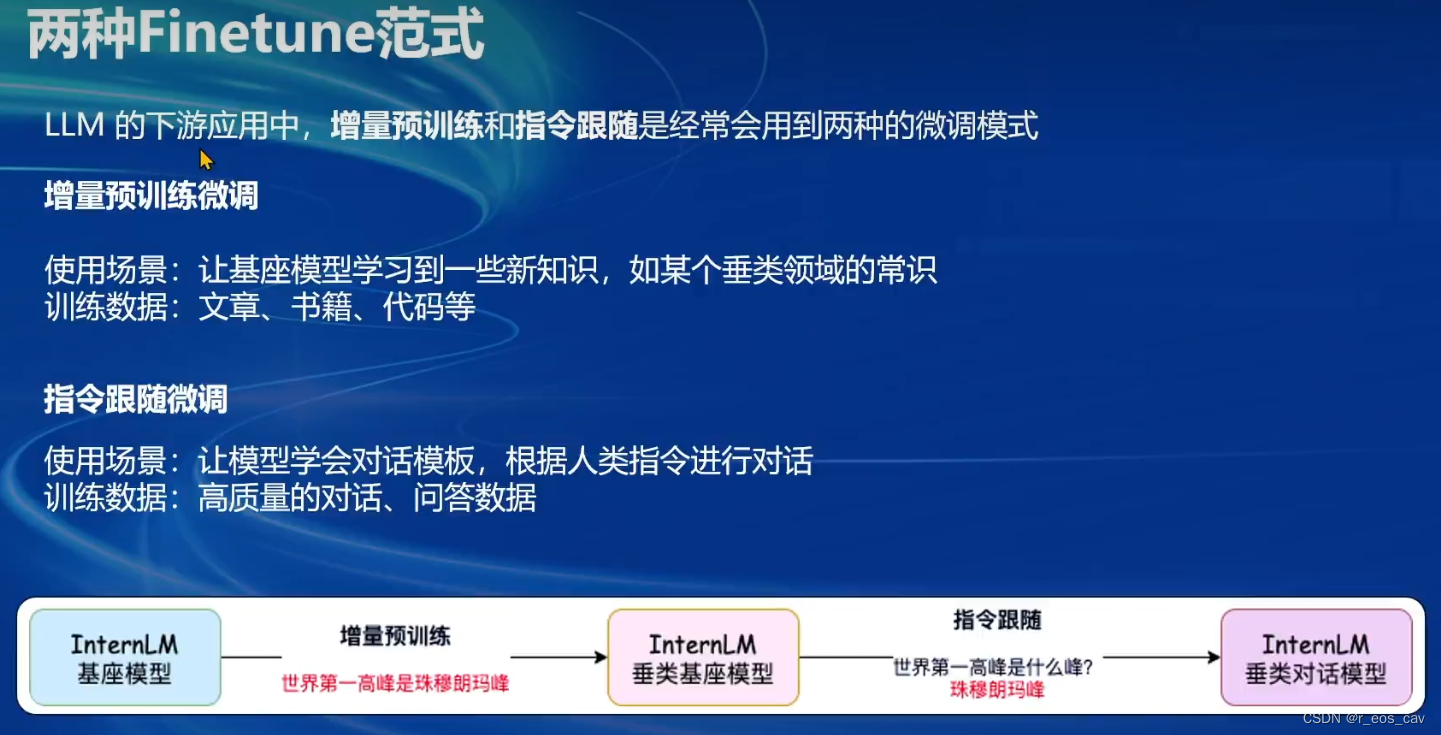

模型微调主要有两种方式:一种为增量微调,另一种为指令微调。

2. 一条数据的一生

3. 微调方案

LoRA方案能够大幅降低训练的显存消耗,基本原理如下图所示。

方案对比

二. Xtuner

Xtuner特点

工具箱详细内容介绍参见视频https://www.bilibili.com/video/BV15m421j78d/

本文介绍了模型微调的两种主要方式:增量微调和指令微调,重点讲解了LoRA方案在减少显存消耗的应用,并提到了Xtuner工具箱的详细内容,可参考相关视频链接。

本文介绍了模型微调的两种主要方式:增量微调和指令微调,重点讲解了LoRA方案在减少显存消耗的应用,并提到了Xtuner工具箱的详细内容,可参考相关视频链接。

模型微调主要有两种方式:一种为增量微调,另一种为指令微调。

LoRA方案能够大幅降低训练的显存消耗,基本原理如下图所示。

方案对比

工具箱详细内容介绍参见视频https://www.bilibili.com/video/BV15m421j78d/

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?