Chapter 4 句子主观性与情感分类_Sentence Subjectivity and Sentiment Classificationl

4.1 主观性分类

主观性分类将句子分为主观和客观两大类(Wiebe,Bruce和O’Hara, 1999)。客观句子表达一些事实信息,而主观句子通常表达个人观点。实际上,主观句子可以表达许多类型的信息,例如观点,评价,情感,信念,推测,判断,指控,立场等(Quirk等,1985; Wiebe,Bruce和O’Hara,1999)。其中一些表示正面或负面情绪,而另一些则不然。早期的研究将主观性分类作为一个独立的问题来解决,即不是出于情感分类的目的。在最近的研究中,一些研究者把它作为情感分类的第一步,用它来删除那些被认为没有表达或暗示观点的客观句子。

大多数现有的主观分类方法都是基于监督学习的。例如,(Wiebe,Bruce和O’Hara,1999年)的早期工作中,使用朴素贝叶斯分类器进行主观分类,该分类器具有一组二元特征,例如一个代词、一个形容词、一个基数、一个非will的情态动词和一个非not的副词在句子中的存在。随后的研究还使用了其他学习算法和更复杂的功能。

在(Wiebe,2000)中,Wiebe提出了一种无监督的主观分类方法,该方法仅使用句子中主观表达的存在来确定句子的主观性。由于没有一套完整的这样的表达方式,它提供了一些种子,然后使用分布相似性(Lin,1998)来查找也可能是主观性指示的相似词。但是,以这种方式发现的单词的精度较低,召回率很高。然后,使用(Hatzivassiloglou和McKeown,1997)中的方法和(Hatzivassiloglou和Wiebe,2000)中的gradability可分级性来过滤错误的主观表达。我们将在(Hatzivassiloglou and McKeown,1997)第6.2节中讨论该方法。可分级性是一种语义属性,它使一个词出现在比较结构中,并接受作为增强词或减强词的修饰性表达式。相对于由修饰名词明确提及或隐含提供的规范(例如,小行星通常比大房子大得多),可分级形容词以不同程度的强度表示属性。可分级的形容词是在人工编辑的通常用作评分修饰语的副词和名词短语(例如,很少,非常,有些和非常)的种子列表找到的。这种可分级形容词是主观性的良好指标。

在(Yu and Hatzivassiloglou,2003)中,Yu和Hatzivassiloglou使用句子相似性和朴素的贝叶斯分类器进行了主观性分类。句子相似度法是基于主观或观点句与其他观点句的相似度大于事实句的相似度的假设。他们使用(Hatzivassiloglou等, 2001)中的SIMFINDER系统,基于共享的单词,短语和WordNet同义词集来测量句子相似度。对于朴素贝叶斯分类,他们使用的特征包括单词(unigram),bigrams,trigram,词性,情感词的存在,情感词序列的极性(或方向)计数(例如“ ++” ”(用于两个连续的正向单词),以及与情感信息相结合的词类计数(例如,“ JJ +”代表正向形容词),以及对主要动词、主要主语及其直接修饰符的情感(如果有)进行编码的特征。这项工作还做了情感分类,以确定一个主观句子是积极的还是消极的,我们将在下一节讨论。

应用监督学习的瓶颈之一是注释大量训练样本所涉及的手动工作。为了节省人工标注的工作量,在(Riloff和Wiebe,2003)中提出了一种自动标注训练数据的bootstrapping自举方法。该算法首先使用两个高精度分类器(HP-Subj和HP-Obj)来自动识别一些主观和客观句子。高精度分类器使用作为主观线索的词汇项列表(单个单词或n-grams)。如果HP-Subj包含两个或多个强烈的主观线索,则将该句子归类为主观句子。如果没有很强的主观线索,HP-Obj会将句子归类为客观句子。这些分类器将提供很高的精度precision,但召回率却很低。然后将提取的句子添加到训练数据中以学习模式。这些模式(在下一个迭代中形成主观性分类器)被用来自动识别更多的主客观句子,然后将这些句子添加到训练集中,算法的下一个迭代就开始了。

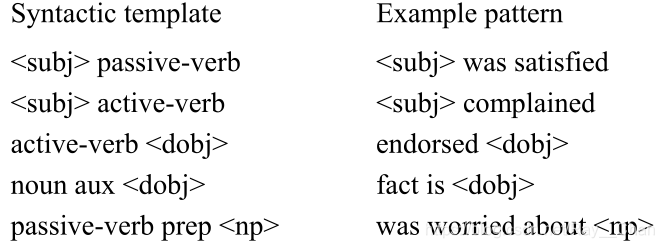

对于模式学习,提供了一组语法模板以限制要学习的模式的种类。下面显示了一些示例语法模板和示例模式。

Wiebe和Riloff(2005)使用发现的模式来生成基于规则的方法,来产生用于主观分类的训练数据。基于规则的主观分类器将包含两个或两个以上强主观线索的句子归类为主观的句子(否则,它不会标记该句子)。对比之下,基于规则的客观分类器则寻找线索的缺失:如果句子中没有强烈的主观线索,则它将一个句子分类为客观句,或其他几种情况。该系统还使用信息提取系统AutoSlog-TS(Riloff, 1996年)学习有关客观句的新句型,AutoSlog-TS基于一些固定的句法模板查找句型模式。基于规则的分类器生成的数据用于训练一个朴素贝叶斯分类器。 (Wiebe等, 2004)也报道了一项相关研究,该研究使用一组更全面的特征或主观线索来进行主观分类。

Riloff,Patwardhan和Wiebe(2006)研究了不同特征之间的关系。他们定义了单字组,n元组和词汇句法模式之间的包容关系。如果某个特征被另一个特征所包含,则不需要被包含的特征。这可以删除许多冗余特征。

(Pang和Lee, 2004)提出了一种基于mincut的算法,将每个句子划分为主观和客观两类。该算法适用于观点文档(例如评论)的句子图。首先基于局部标记一致性(产生两个句子的关联分数)和基于传统分类方法所产生的概率计算的单个句子主观性分数(为每个句子产生一个评分)来构建图形。局部标记一致性意味着邻近的句子更有可能具有相同的类别标签(主观或客观)。由于局部的标签一致性,mincut方法能够改进基于单个句子的主观分类。这项工作的目的实际上是从评论中删除客观句子,以改善文档级别的情感分类。

Barbosa和Feng(2010)根据传统特征对推文(在Twitter上发布)的主观性进行了分类,并包含了一些特定于Twitter的线索,例如转推,主题标签,链接,大写单词,表情符号,感叹号和问号。对于主观推文的情感分类,也使用了相同的一组特征。

有趣的是,在(Raaijmakers和Kraaij,2008)中,发现子词的字符n-grams而不是单词n-grams也可以很好地执行情感和主观性分类。例如,对于句子"This car rocks",子词字符bigrams是th,hi,ca,ar,ro,oc,ck,ks。在(Raaijmakers,Truong and Wilson,2008)和(Wilson and Raaijmakers,2008)中,对单词n-grams,字符n-grams和音素n-grams进行了实验,并比较了主观分类。 BoosTexter(Schapire and Singer,2000)被用作学习算法。令人惊讶的是,他们的实验表明,字符n-gram表现最佳,而音素n-gram与单词n-gram相似。

Wilson,Wiebe和Hwa(2004)指出,一个句子可以同时包含主、客观分句。找出此类分句很有用。确定主观性的强度也很有用。提出了一种自动主观性分类的研究方法,利用分句中所表达的主观性强度,将分句分为四个层次:中性、低、中、高。中性表示没有主观性。因此,强度分类包含将句子分类为主观或客观的任务。作者使用了监督学习。它们的特征包括主观性指示词和短语,以及从依赖关系解析树中生成的语法线索。

Benamara等(2011)用S,OO,O和SN四个类别进行主观分类,其中S表示主观的和有评价的(他们的情绪可以是正面或负面的),OO表示客观句或句子片段中隐含的正面或负面观点,O表示没有观点的客观性,而SN表示主观但没有评价(没有正面或负面的情绪)。这种分类更加完整,符合我们前面的讨论以及在2.4节中的讨论,该部分表明主观句子可能不是评价性的(带有正面或负面的情感),而客观的句子也可能暗示情感。

在阿拉伯语(Abdul-Mageed, Diab和Korayem, 2011)和乌尔都语(Mukund和Srihari, 2010)中,基于使用通用的和语言特定特征的不同机器学习算法,也进行了关于句子主观性分类的其他工作。

4.2 句子情感分类

如果句子被归类为主观句子,我们就可以确定其表达的是正面还是负面的观点。监督学习也可以像文档级情绪分类一样应用,基于词汇的方法也可以。在讨论现有算法(某些算法不使用主观性分类步骤)之前,让我们指出在有关该主题的许多研究中做出的隐含假设。

句级情感分类的假设:一句话表达了来自一个意见持有人的一种观点。

这种假设适用于带有一种情感的简单句,例如“此摄像机的图像质量很棒。”但是,对于复合句和复杂句,单个句子可能表示一个以上的情感。例如,句子“这台摄像机的图像质量很棒,电池寿命也是如此,但是取景器对于这样一款出色的摄像机来说太小了”,它同时表达了正面和负面的情感(或它有混合的情感)。对于“图片质量”和“电池寿命”,该语句为肯定,而对于“取景器”,则为否定。从整体上看,这也是正面评价(这是第2.1节的“ GENERAL ”方面)。

对于主观句子的情感分类,Yu和Hatzivassiloglou(2003)使用了一种与(Turney,2002)中类似的方法,该方法已在3.2节中进行了讨论。与(Turney, 2002)中使用一个表示积极的种子词和一个表示消极的种子词不同,这项工作使用了大量的种子形容词。此外,这项工作并没有使用PMI,而是使用一个修改过的对数似然比来确定每个形容词、副词、名词和动词的正或负方向。为了给每个句子分配指向,它使用了单词的平均对数似然分数。使用训练数据选择两个阈值,并将其应用于确定句子是正面,负面还是中立的取向。同样的问题也在(Hatzivassiloglou and Wiebe, 2000)考虑可分级形容词时得到了研究。

在(Hu and Liu,2004)中,Hu和Liu提出了一种基于词典的方面级别情感分类算法,但是该方法也可以确定句子的情感方向。它基于自举策略生成的情感词典,其中包含一些给定的正负情感词种子以及WordNet中的同义词和反义词关系。我们将在第六章讨论生成情感词汇的各种方法。句子的情感取向是通过对句子中所有情感词的取向分数求和来确定的。正面单词的情感评分为+1,负面单词的情感评分为-1。还考虑了否定词和相反词(例如,but ,however)。在(Kim and Hovy,2004)中,也使用了类似的方法。他们编辑情感词典的方法也很相似。但是,他们通过将句子中的情感词得分相乘来确定句子的情感取向。同样,一个正词的情感得分为+1,一个负词的情感得分为-1。作者还尝试了另外两种汇总情感评分的方法,但效果较差。在(Kim和Hovy,2007; Kim和Hovy,2004; Kim等,2006)中,监督学习被用来识别几种特定类型的意见。在(Nigam和Hurst,2004年)中,Nigam和Hurst应用了特定领域的词典和浅层NLP方法来评估句子的情感取向。

在(Gamon等人,2005年)中,使用了一种半监督学习算法来从一小组标记的句子和一整套未标记的句子中学习。该学习算法是基于期望最大化(EM),使用朴素贝叶斯作为基础分类器(Nigam等,2000)。这项工作进行了三级分类,肯定,否定和“其他”(无意见或混合意见)。

在(McDonald等, 2007)中,作者提出了一种类似于条件随机场(CRF)的分层序列学习模型(Lafferty,McCallum和Pereira,2001),共同学习并推断句子和文档级别的情感。在训练数据中,每个句子都有情感标签,每个完整评论也有情感标签。他们表明,学习两个级别共同提高了两个分类级别的准确性。在(Täckström和McDonald,2011)中,报告了一种方法,该方法仅从文档级标签中学习,但同时执行句子和文档级情感分类。因此,该方法是部分监督。在(Täckström和McDonald,2011年)中,集成了完全监督模型和部分监督模型以执行多级情感分类。

在(Hassan,Qazvinian和Radev,2010年)中,提出了一种确定在线讨论参与者态度的方法。由于论文只对讨论者感兴趣,因此该算法仅使用带有第二人称代词的句子片段。它的第一步是使用监督学习来找出带有态度的句子。这些特征是使用马尔科夫模型生成的。它的第二步确定态度的指向(正或负),为此,它使用了基于词典的方法,类似于(Ding, Liu and Yu, 2008),但当句子中出现情感词冲突时,其利用依赖树中的最短路径来确定指向,而(Ding, Liu and Yu, 2008)使用词距离(见5.1节)。

在(Davidov,Tsur和Rappoport,2010年)中,研究了Twitter帖子(或推文)的情感分类。每个推文基本上都是一个句子。作者采用了监督学习的方法。除了传统特征外,该方法还使用标签,笑脸,标点符号及其频繁使用的模式。这些特征被证明是非常有效的。

4.3 处理条件句

现有的句子级主观分类或情态分类的研究大多着眼于解决一般问题,而没有考虑到不同类型的句子可能需要非常不同的处理。 Narayanan,Liu和Choudhary (2009)认为,不可能采用一种“技术通用”的解决方案,因为不同类型的句子以非常不同的方式表达情感。可能需要分而治之的方法,即针对不同类型的句子进行重点研究。他们的论文集中在条件句上,条件句具有一些独特的特征,这使得系统很难确定其情感取向。

条件句子是描述含义或假设情况及其后果的句子。这样的句子通常包含两个子句:条件子句和结果子句,它们相互依赖。它们的关系对句子表达正面还是负面情绪有重要影响。一个简单的观察结果是,仅凭情感词(例如 great, beautiful, bad)是无法区分观点句与非观点句的,例如,“如果有人制造出可靠的汽车,我会购买”和“如果您的诺基亚电话不好,请购买这款三星手机。”第一个句子不表达对任何特定汽车的情感,尽管“可靠”是一个积极的情感词,但是第二个句子对三星手机是积极的,并且不表达对诺基亚手机的看法(尽管诺基亚手机的所有者)对此可能是负面的)。因此,用于确定非条件语句中的情感的方法不适用于条件语句。针对这一问题,提出了一种基于语言特征的监督学习方法,例如情感词/短语及其位置,情感词的POS标签,时态模式,条件连接词等。

困难句子的另一种类型是疑问句。例如,“谁能告诉我在哪里可以找到好的诺基亚手机?”显然对任何特定电话都没有意见。但是,“有人能告诉我如何修复这部糟糕的诺基亚手机吗?”对诺基亚手机有负面意见。据我所知,还没有对此问题进行研究。我相信,要进行更准确的情感分析,我们需要以不同的方式处理不同类型的句子。在这个方向上需要做更多的研究。

4.4 处理讽刺句

讽刺是言语行为的一种复杂形式,说话者或作家所说或写的与他们的意思相反。讽刺已在语言学,心理学和认知科学领域得到了研究(Gibbs和Colston,2007; Gibbs,1986; Kreuz和Caucci,2007; Kreuz和Glucksberg,1989; Utsumi,2000)。在情感分析的背景下,这意味着当一个人说积极的话时,他/她实际上是消极的,反之亦然。讽刺很难处理。一些初步工作已经完成(González-Ibáñez,Muresan和Wacholder,2011; Tsur,Davidov和Rappoport,2010)。根据我自己的经验,讽刺性句子在产品和服务的评论中并不常见,但在有关政治的在线讨论和评论中却很常见。

在(Tsur,Davidov和Rappoport,2010年)中,提出了一种半监督学习方法来识别讽刺。它使用了一小组带标签的句子(种子),但没有使用未标记的示例。相反,它通过Web搜索自动扩展了种子集。作者认为,讽刺句与其他讽刺句经常同时出现在文本中。将种子训练集中的每个句子作为一个查询执行一个自动web搜索。然后,系统为每个种子示例收集多达50个搜索引擎片段,并将收集的句子添加到训练集中。然后,将这种丰富的训练集用于学习和分类。对于学习,它使用了两种类型的特征,基于模式的特征和基于标点的特征。模式只是高频单词的有序序列。还设计了两个准则来消除过于笼统和过于具体的模式。这些模式类似于数据挖掘中的顺序模式(Liu,2006和2011)。基于标点的特征包括“!”,“?”和引号,以及句子中首字母大写/全部大写的单词数量。为了分类,采用了基于kNN的方法。但是,这项工作没有进行情感分类。它仅将讽刺和非讽刺的句子分开。

González-Ibáñez,Muresan和Wacholder(2011)的工作在使用Twitter数据进行情感分析的背景下研究了该问题,区分具有讽刺意味的微博和直接表达积极或消极观点的非讽刺微博(不考虑中性话语)。再次使用支持向量机和逻辑回归的监督学习方法。作为特征,他们使用了字母组合和一些基于字典的信息。基于字典的特征包括:(i)单词类别(Pennebaker等,2007); ii)WordNet Affect(WNA)(Strapparava和Valitutti,2004年); iii)感叹词(例如,ah,oh,yeah)和标点符号(如!,?)的列表。还使用了表情符号和ToUser(标记某条Tweet是否是对另一条Tweet的回复,由<@user>表示)的特征。三向分类(讽刺,正面和负面)的实验结果表明,该问题非常具有挑战性。最高的准确度仅为57%。同样,这项工作没有将讽刺性句子分类为积极或消极。

4.5 跨语言主观性和情感分类

与在文档级别的跨语言情感分类中一样,研究人员还在句子级别研究了跨语言的主观性分类和情感分类。同样,研究重点是使用广泛的英语资源和工具以及自动翻译工具来帮助构建其他资源或工具很少的其他语言的情感分析系统。当前的研究提出了三种主要策略:

- 将目标语言中的测试句子翻译成源语言,并使用源语言分类器对它们进行分类。

- 将源语言训练语料库翻译为目标语言,并在目标语言中构建基于语料库的分类器。

- 将源语言中的情感或主观性词典翻译成目标语言,并用目标语言构建基于词典的分类器。

Kim和Hovy(2006)进行了以下实验:(1)将德语电子邮件翻译成英语,并使用英语情感词来确定情感取向,以及(2)将英语情感词翻译成德语,并使用德语情感词分析德语电子邮件。 Mihalcea,Banea和Wiebe(2007)还尝试将英语主观性单词和短语翻译成目标语言。实际上,他们尝试了两种翻译策略来进行跨语言主观性分类。首先,他们通过翻译使用英语主观性词典为新语言(在本例中为罗马尼亚语)派生了主观性词典。然后使用一个类似于(Riloff and Wiebe, 2003)的基于规则的主观性分类器将罗马尼亚语句子分为主客观两类。精度还不错,但是召回率很差。其次,他们使用人工翻译的平行语料库在新语言中派生了主观注释语料库。他们首先使用一些现有工具将语料库中的英语句子自动分类为主观和客观类别,然后使用平行语料库中可用的句子级别对齐方式将主观性类别标签投射到平行语料库中的罗马尼亚句子。然后使用罗马尼亚语建立了基于监督学习的主观性分类器,以对罗马尼亚句子进行分类。在这种情况下,结果比第一种方法要好。但是,应注意,平行语料库的翻译是手动完成的。

在(Banea等,2008)中,报道了三组实验。首先,将带有源语言(英语)的标注语料库自动翻译为目标语言(罗马尼亚语)。然后,将源语言中的主观标签映射到目标语言中的翻译版本。第二,对源语文本进行主观性标注,然后翻译成目的语。在两种情况下,都使用目标语言中带有主观标签的翻译版本来训练目标语言中的主观分类器。第三,将目标语言翻译成源语言,然后使用主观性分类工具对自动翻译的源语言文本进行分类。分类后,标签被映射回目标语言。然后将所得的标记语料库用于训练目标语言中的主观性分类器。三种策略的最终分类结果非常相似。

在(Banea, Mihalcea and Wiebe, 2010)中,通过将标注的英语语料库翻译成5种语言,进行了跨语言句子级主观性分类的大量实验。首先,研究表明,使用翻译后的语料库进行训练对所有5种语言都相当有效。将不同语言的翻译版本与原始英语版本结合以形成单一的训练语料库,也可以改善原有对的英语主观性分类本身。其次,本文证明,通过使用多数投票将单语分类器的预测结合起来,可以生成高精度的句子级主观性分类器。

(Bautin,Vijayarenu and Skiena,2008)中的技术还将目标语言的文档翻译成英语,并使用基于英语词典的方法来确定每个包含实体的句子的情感取向。本文实际上是在方面级别上工作的。情感分类方法与(Hu and Liu,2004)中的相似。

(Kim, Li, Lee, 2010)引入了多语言可比性的概念来评价多语言主体性分析系统。所谓多语可比性,是指具有相同主观含义的一对多语言文本的分类结果中的一致程度。利用一个平行语料库,他们使用Cohen’s Kappa研究了源语言和目标语言的分类结果的一致性。针对目标语言分类,实验了几种现有的基于翻译的跨语言主观性分类方法。他们的结果表明,经过从英语翻译为目标语言的语料库训练后,分类器在主观分类和多语言可比性方面均表现良好。

在(Lu等, 2011)中,尝试了一个稍有不同的问题。该论文假设源语言和目标语言都有一定数量的情感性标注数据,并且还存在一个未标签的平行语料库。他们的方法可以同时改善两种语言的情感分类。该方法是基于最大熵的EM算法,通过将未标记的平行文本中的情感标签视为未观察到的潜在变量,并最大化特定语言的标签数据的正则化联合似然和推断的情感,共同学习两个单语情感分类器平行文字的标签。在学习中,它利用两个平行的句子或文档(即彼此的翻译)应该表现出相同情感的直觉。

4.6 使用话语信息进行情感分类

现有的有关文档级和句子级情感分类的大多数工作都没有使用句子之间或同一句话的子句之间的话语信息。在(Asher,Benamara和Mathieu,2008; Somasundaran,Ruppenhofer和Wiebe,2008)中,对话语级别的情感注释进行了研究。 Asher,Benamara和Mathieu(2008)使用了五种类型的修辞关系:Contrast对比度,Correction校正,Support支持,Result结果和Continuation 延续,并附带了用于注释的情感信息。 Somasundaran,Ruppenhofer和Wiebe(2008)提出了一个称为观点框架的概念。观点框架的组成部分是观点及其目标之间的关系。

在(Somasundaran等,2009)中,Somasundaran等根据观点框架注释进行情感分类。使用的分类算法是协作分类(Bilgic, Namata and Getoor, 2007),在图上执行分类。节点是需要分类的句子(或其他表达式),链接是关系。在话语语境中,它们是与情感相关的话语关系。这些关系可用于生成一组用于学习的关系特征。每个节点本身也会生成一组局部特征。关系特征允许一个节点的分类影响集体分类方案中其他节点的分类。在(Zhou等2011)中,利用单个复合句中的语篇信息对句子进行情感分类。例如,“藤森虽然受到国际社会的批评,但由于人们讨厌腐败的统治阶级而受到国内人民的爱戴”这句话是正面的,尽管它带有更多的负面意见(另见第4.7节)。本文利用模式挖掘来寻找语篇模式进行分类。

在(Zirn等,2011)中,作者提出了一种对话语片段进行分类的方法。每个部分都表达一个单一的(正面或负面)观点。采用马尔可夫逻辑网络进行分类,既能利用情态词汇,又能利用局部/邻近语篇上下文。

4.7 小结

-

句子级主观性分类和情感分类比文档级情感分类更进一步,因为它更接近于观点目标和目标上的情感。它可以被视为整体情绪分析任务中的中间步骤。但是,它对于许多实际应用仍然存在一些缺点:

-

在大多数应用中,用户需要知道其他细节,即喜欢和不喜欢哪些实体或实体的各个方面。文档级、句子级别分析仍然没有这样做。

虽然有人可能会说,如果我们知道了观点的目标(例如,实体和方面,或主题),我们就可以把一个句子的感情指向分配给句子中的目标。然而,这是不够的:

(1)许多复杂的句子在不同的目标上有不同的情感,例如,“因为Firefox不断崩溃而尝试Chrome,”和“在这个糟糕的经济环境下,苹果表现很好。”在后一句话中,甚至从句级别分类也不足够。我们需要进入观点目标或方面层面。

(2)尽管一个句子可能总体上具有正面或负面的语气,但其某些组成部分可能表达相反的观点。例如,一些研究人员认为后续句子是肯定的(Neviarouskaya,

Prendinger and Ishizuka, 2010; Zhou et al., 2011):“Despite the high unemployment rate, the economy is doing well.

尽管失业率很高,但经济运行良好。”的确,这句话的总体语气是积极的,或者作者试图强调积极的一面,但它确实包含了对失业率的消极情绪,我们不能忽视。如果我们进行方面的情感分析,问题就解决了。也就是说,该句子对整体经济是正面的,但对失业率是负面的。

(3)句子级别的情感分类无法处理比较句中的观点,例如“可口可乐口感比百事可乐更好。”在这种情况下,我们需要不同的方法来提取和分析比较观点,因为它们与常规观点的含义完全不同。尽管此句子清楚地表达了一种观点,但我们不能简单地将句子分类为肯定,否定或中性。

我们将在下一章中讨论方面的情感分析,并在第8章中讨论比较性的观点分析。

1396

1396

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?