from llama_cpp import Llama model = Llama(model_path="llama-2-7b-chat.ggmlv3.q4_0.bin")

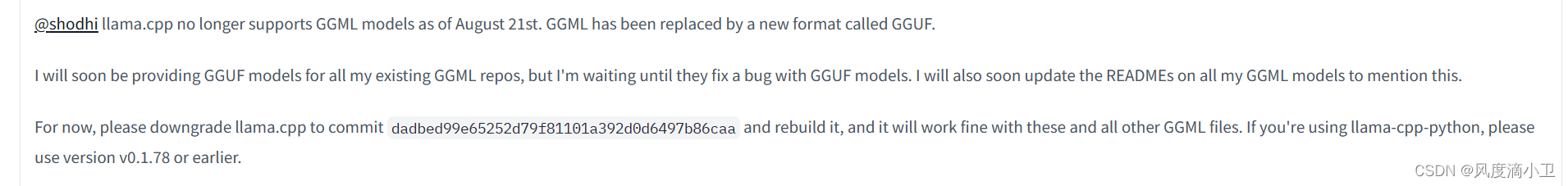

错误:gguf_init_from_file: invalid magic characters 'tjgg'等,也就是无法加载模型

因为最新版的llama-cpp-python不支持ggml文件格式了

解决方案:

1、降低版本(最简单):

pip install llama-cpp-python==0.1.78

2、直接下载对应GGUF的模型

3、利用llama.cpp内部转换函数进行转换

参考出处:TheBloke/Llama-2-13B-GGML · Could not load Llama model from path (huggingface.co)

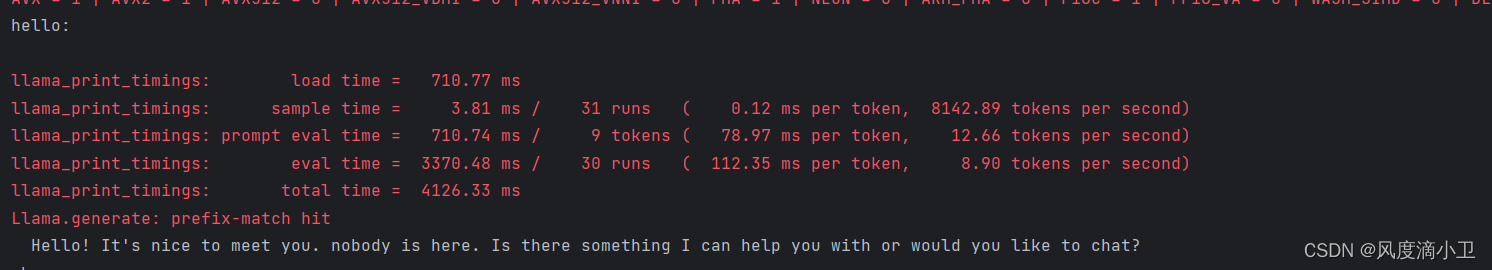

运行结果:

1267

1267

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?