在序列决策问题中的实践与探索

在人工智能领域,序列决策问题一直是一个核心挑战。面对复杂的环境和动态变化的状态,智能体如何做出最优决策,以达到长期目标,是研究者们关注的焦点。Q-Learning算法作为一种经典的强化学习方法,为我们提供了解决这一问题的有效手段。本文将结合实例和代码,对Q-Learning算法在序列决策问题中的应用进行深入分析。

一、Q-Learning算法概述

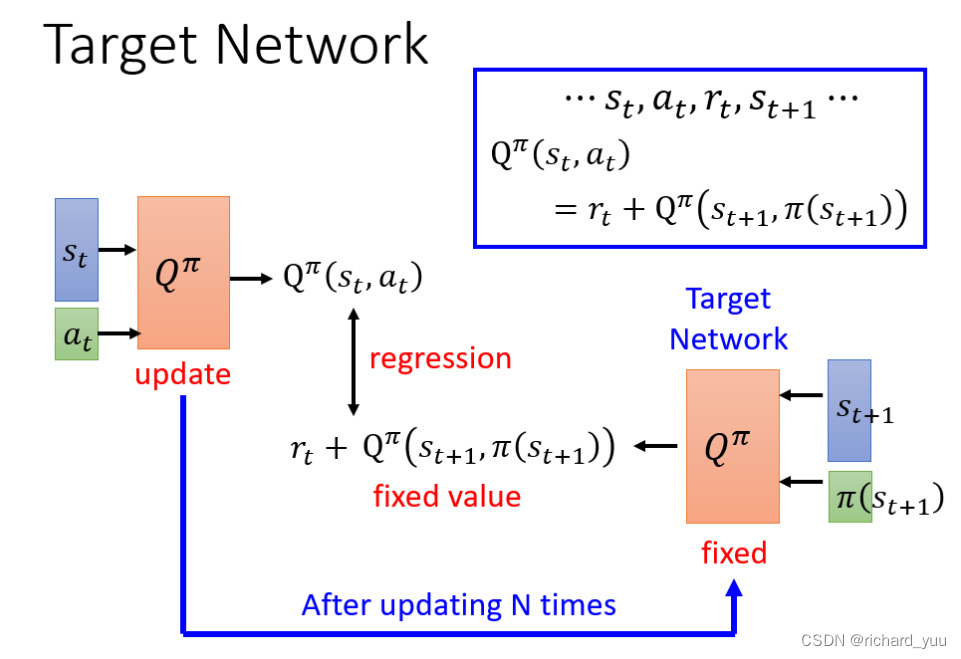

** Q-Learning算法的核心思想是学习一个Q值表,该表记录了在不同状态下采取不同行动所能获得的长期回报**。通过不断更新这个Q值表,智能体能够逐渐学习到最优的行为策略。Q-Learning算法的关键在于其更新规则,即贝尔曼方程的应用。在实际应用中,我们常常采用其简化形式,通过设置学习率α和折扣因子γ来调整更新的步长和未来奖励的权重。

二、Q-Learning算法实例分析

以经典的格子世界问题为例,我们可以直观地展示Q-Learning算法的工作过程。在这个问题中,智能体需要在一个由格子组成的二维环境中,通过一系列行动(如上下左右移动)来找到通往目标格子的最短路径。每个格子代表一个状态,智能体在每个状态下可以选择的行动是固定的(即上下左右移动)。当智能体到达目标格子时,会获得一个正的奖励;如果触碰到障碍物或超出边界,则会受到惩罚。

在这个问题中,我们可以定义一个Q值表来记录每个

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?