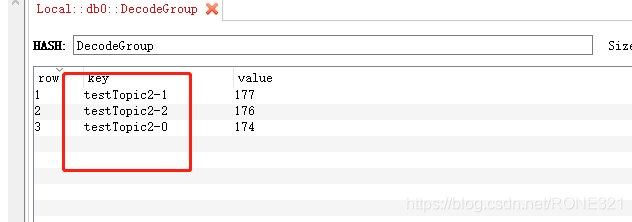

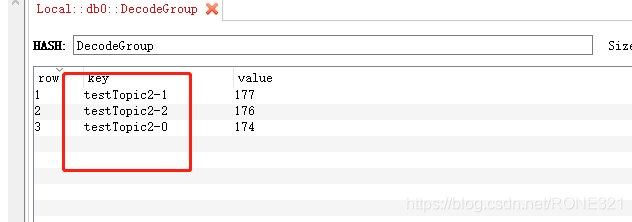

我这边遇到的问题是由于手动维护了offset,指定了分组

我新增了一个Topic,新创建了一个Consumer。但是保存Redis里面的分组还是原来的test

所以消费不到啊!!!!!

SparkStreaming消费不到Kafka的数据

最新推荐文章于 2022-08-18 17:20:05 发布

我这边遇到的问题是由于手动维护了offset,指定了分组

我新增了一个Topic,新创建了一个Consumer。但是保存Redis里面的分组还是原来的test

所以消费不到啊!!!!!

815

815

3331

3331

3306

3306

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?