神经网络与深度学习

第二章 机器学习概述

一、关于概率的一些基本概念

1. 概率(Probability)

- 一个随机事件发生的可能性大小,为0到1之间的实数

2. 随机变量(Random Variable)

- 比如随机掷一个骰子,得到的点数就可以看成一个随机变量X,其取值为{1,2,3,4,5,6}

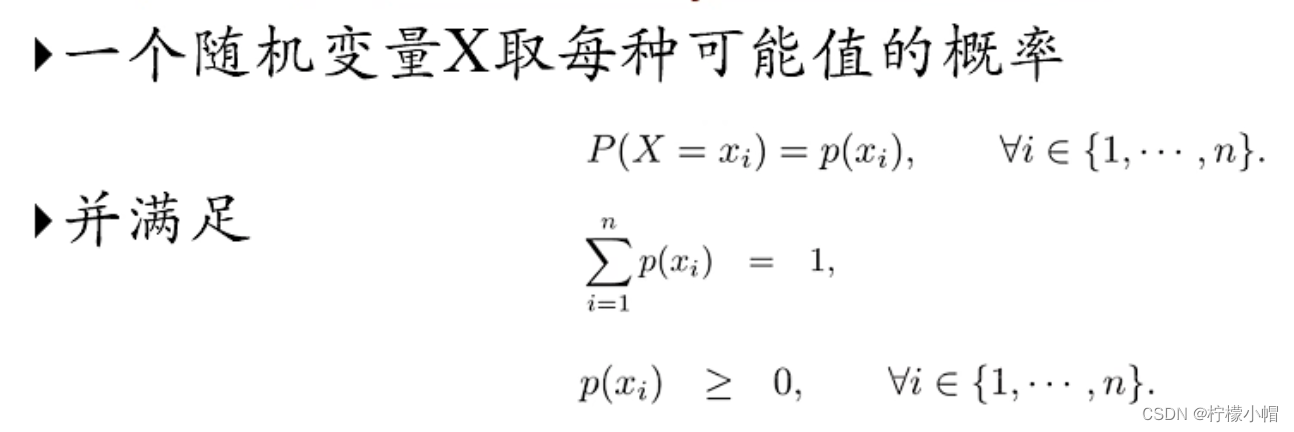

2.1 离散随机变量

2.2 连续随机变量

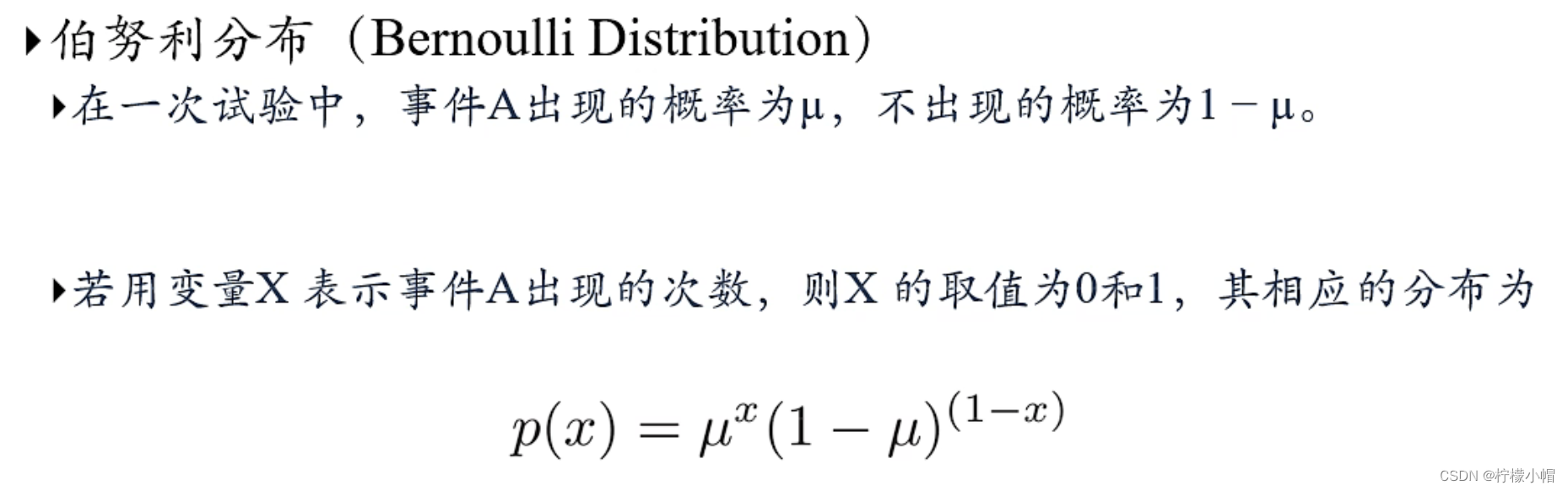

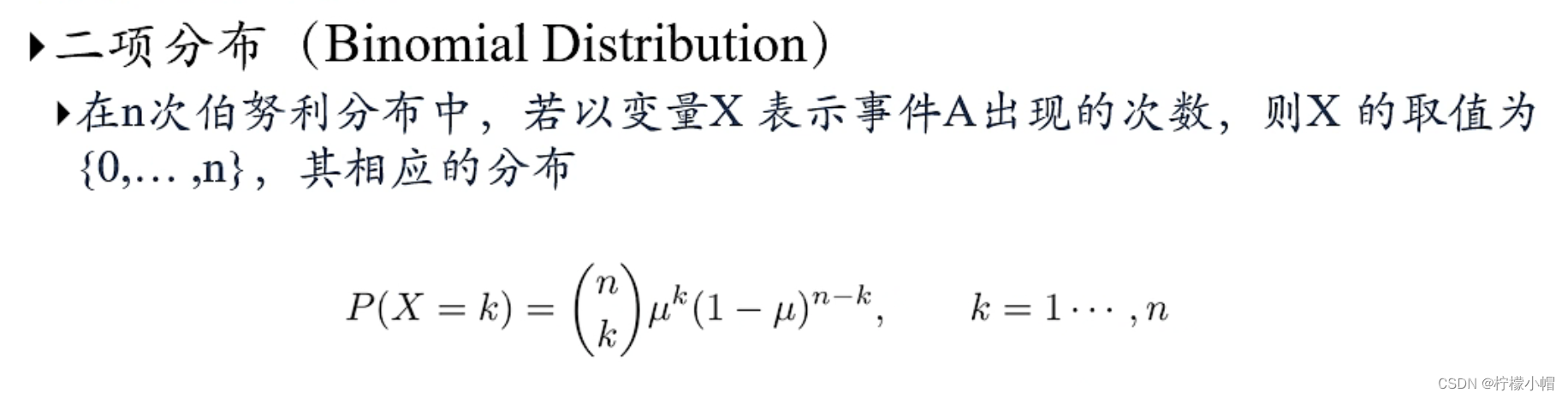

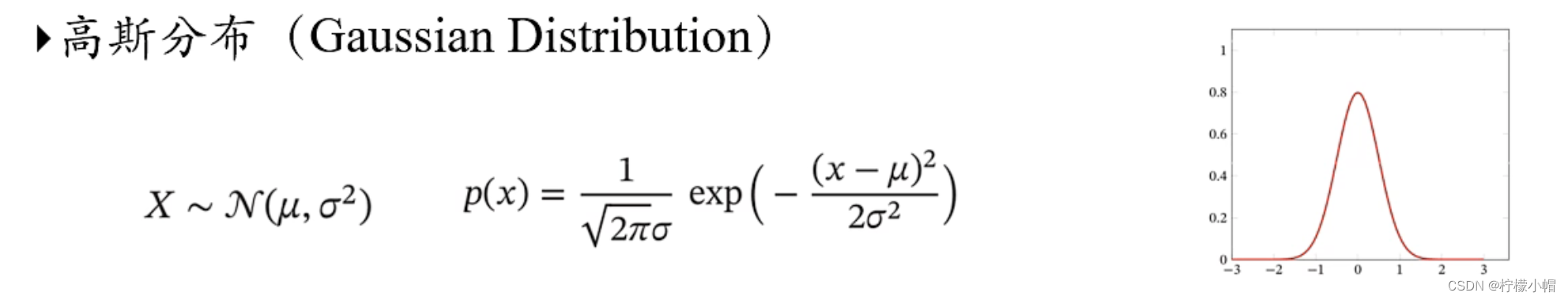

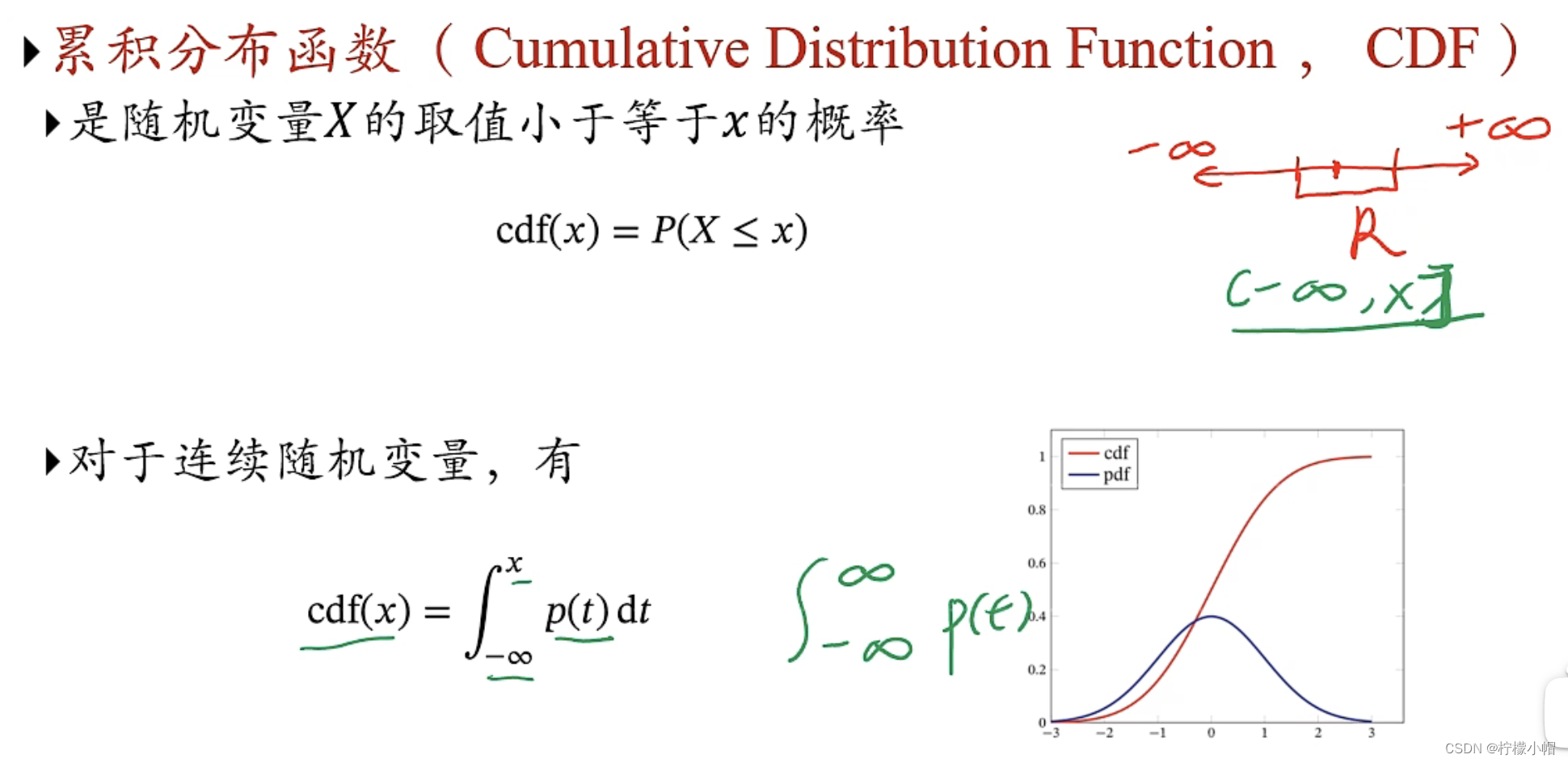

3. 概率分布(Probability Distribution)

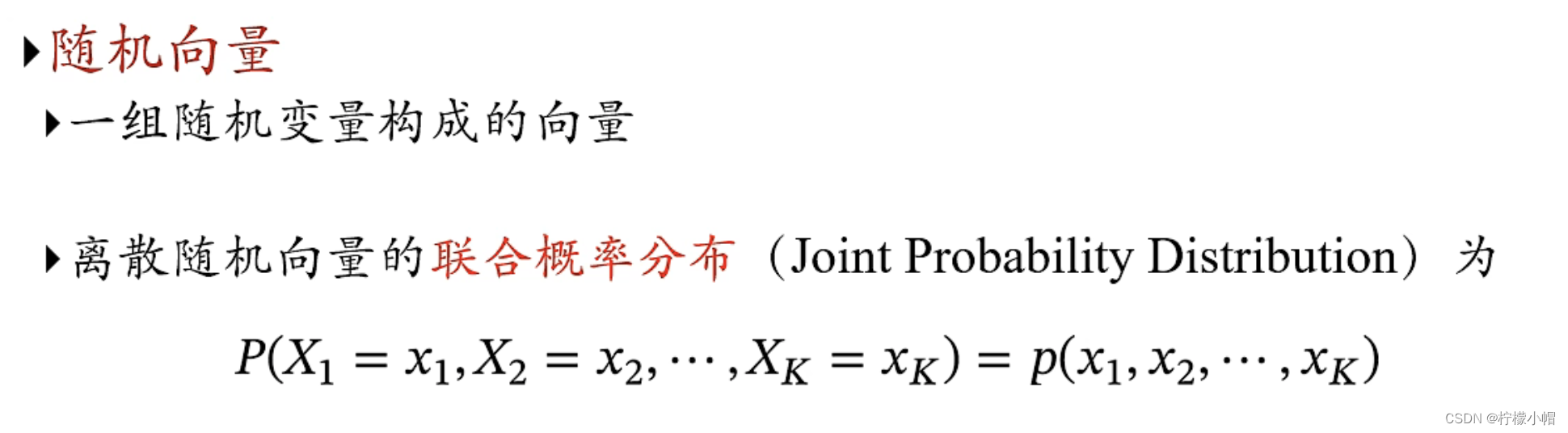

4. 随机向量

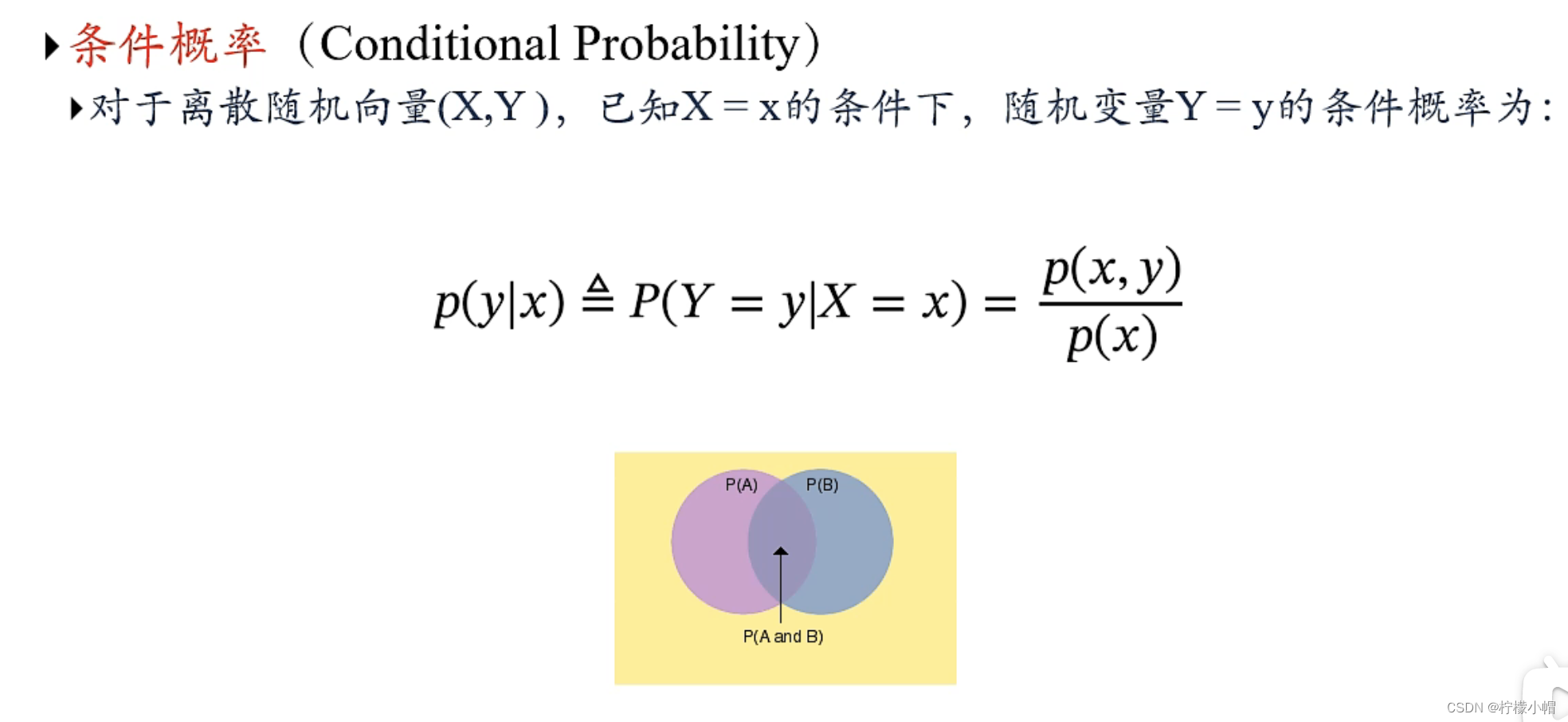

5. 条件概率

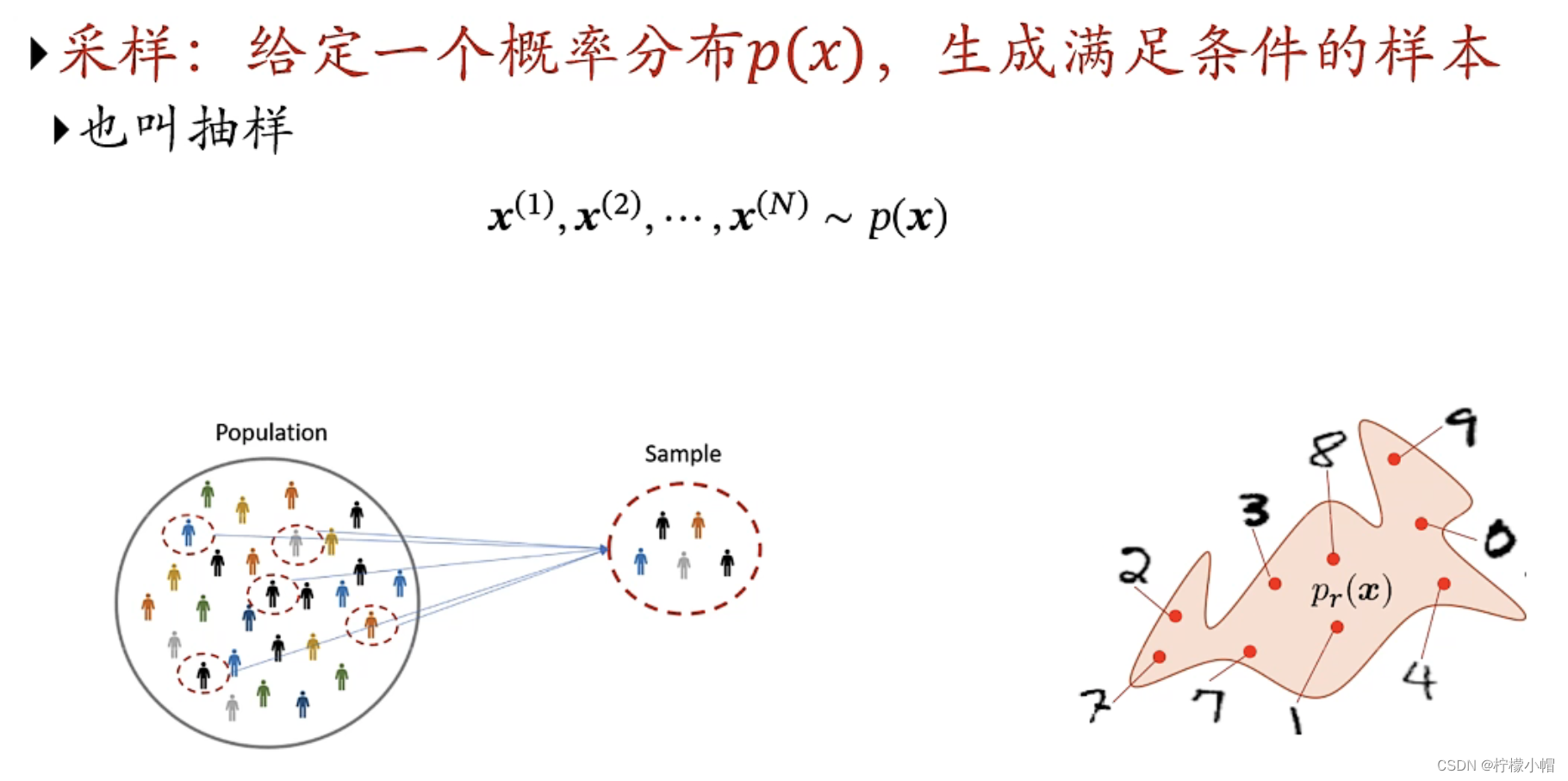

6. 采样(Sampling)

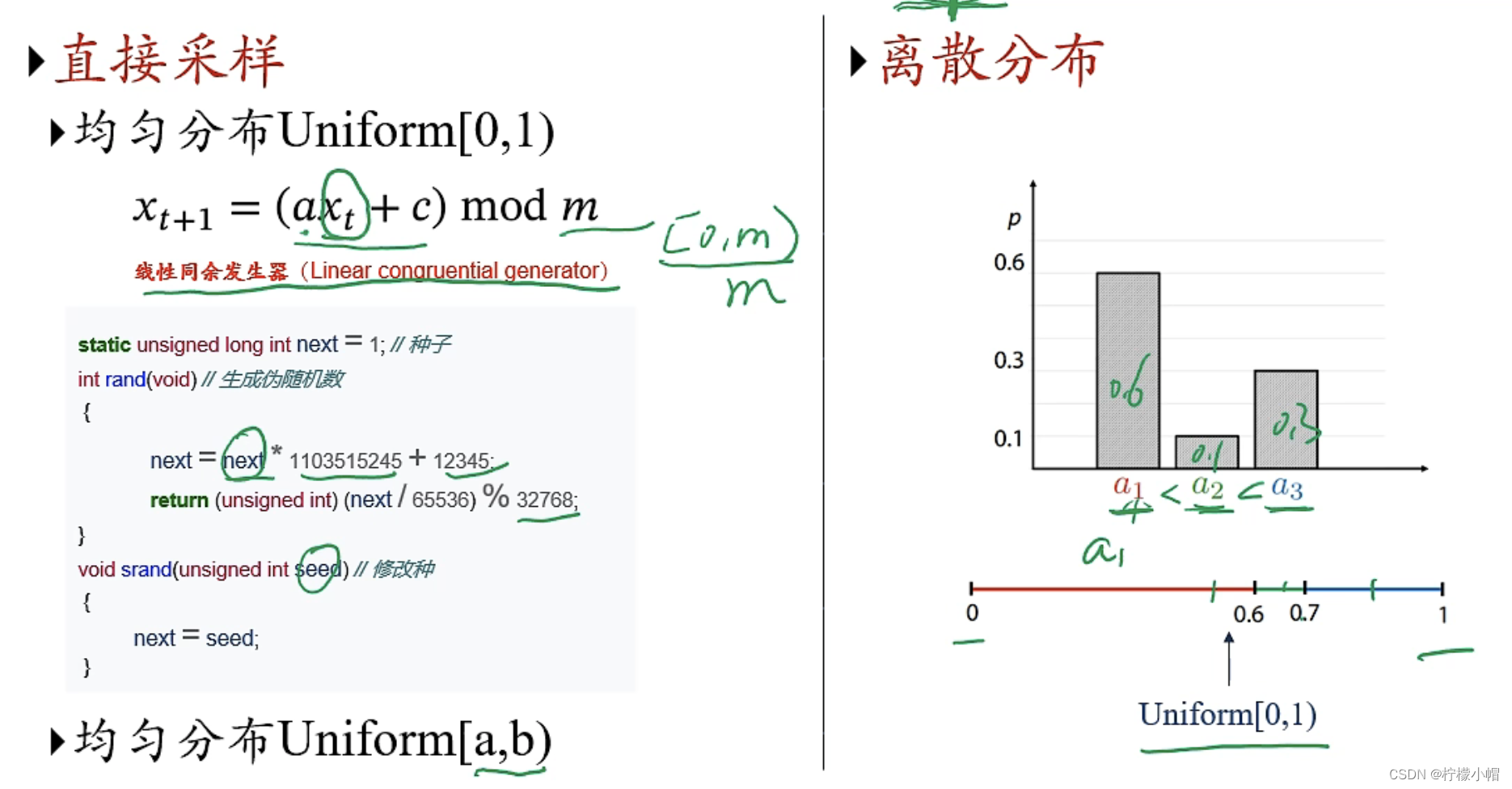

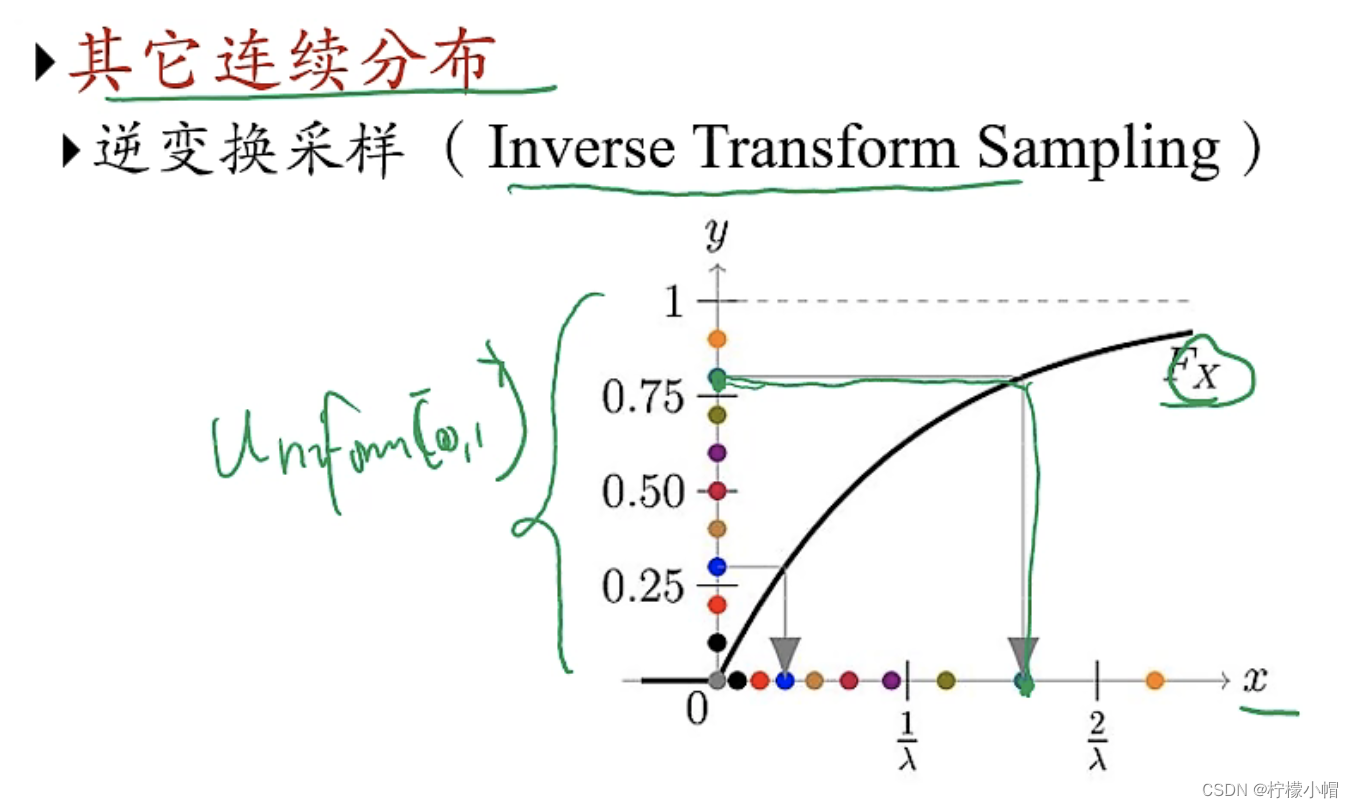

7. 如何进行随机采样?

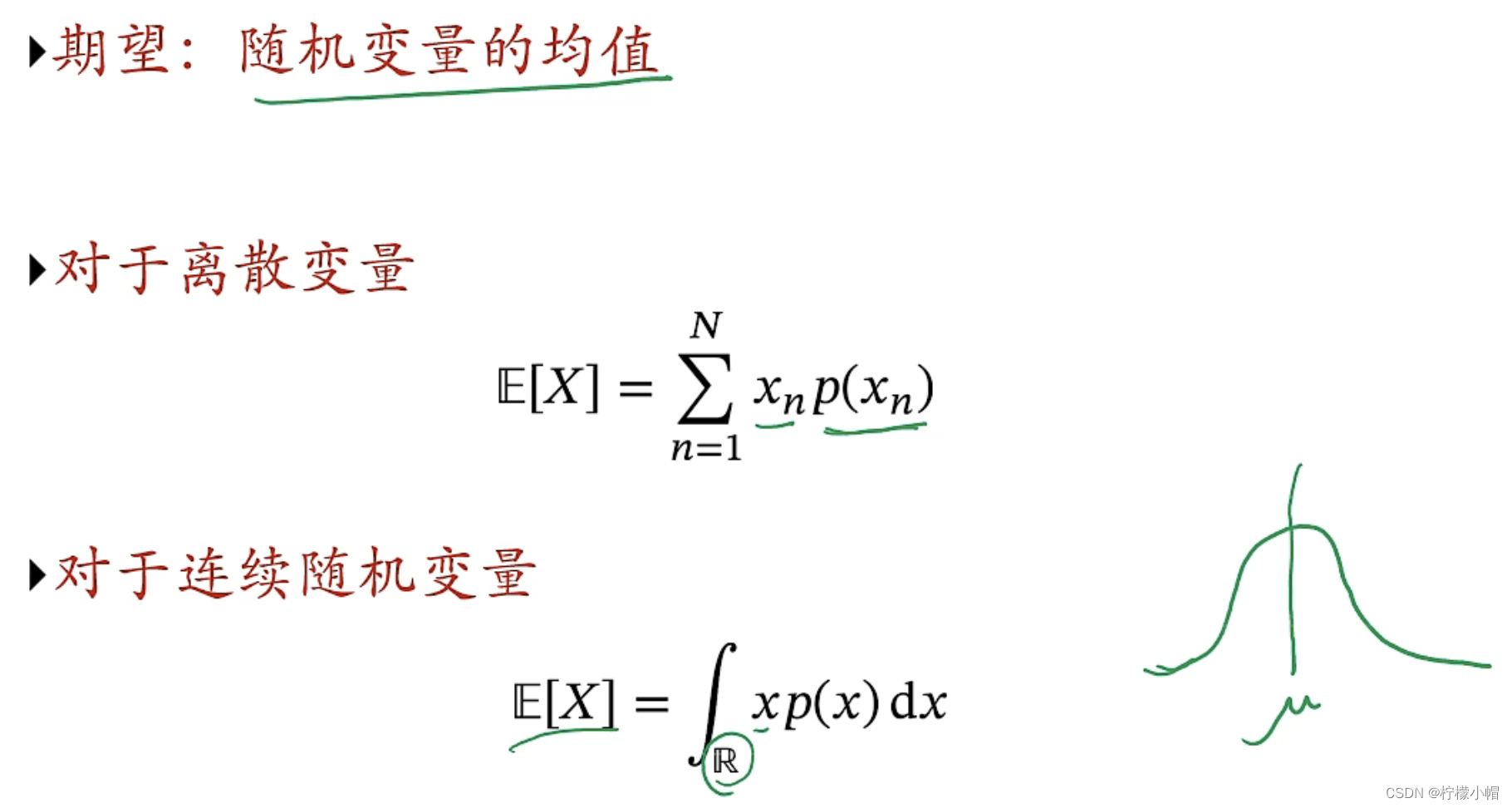

8. 期望(Expectation)

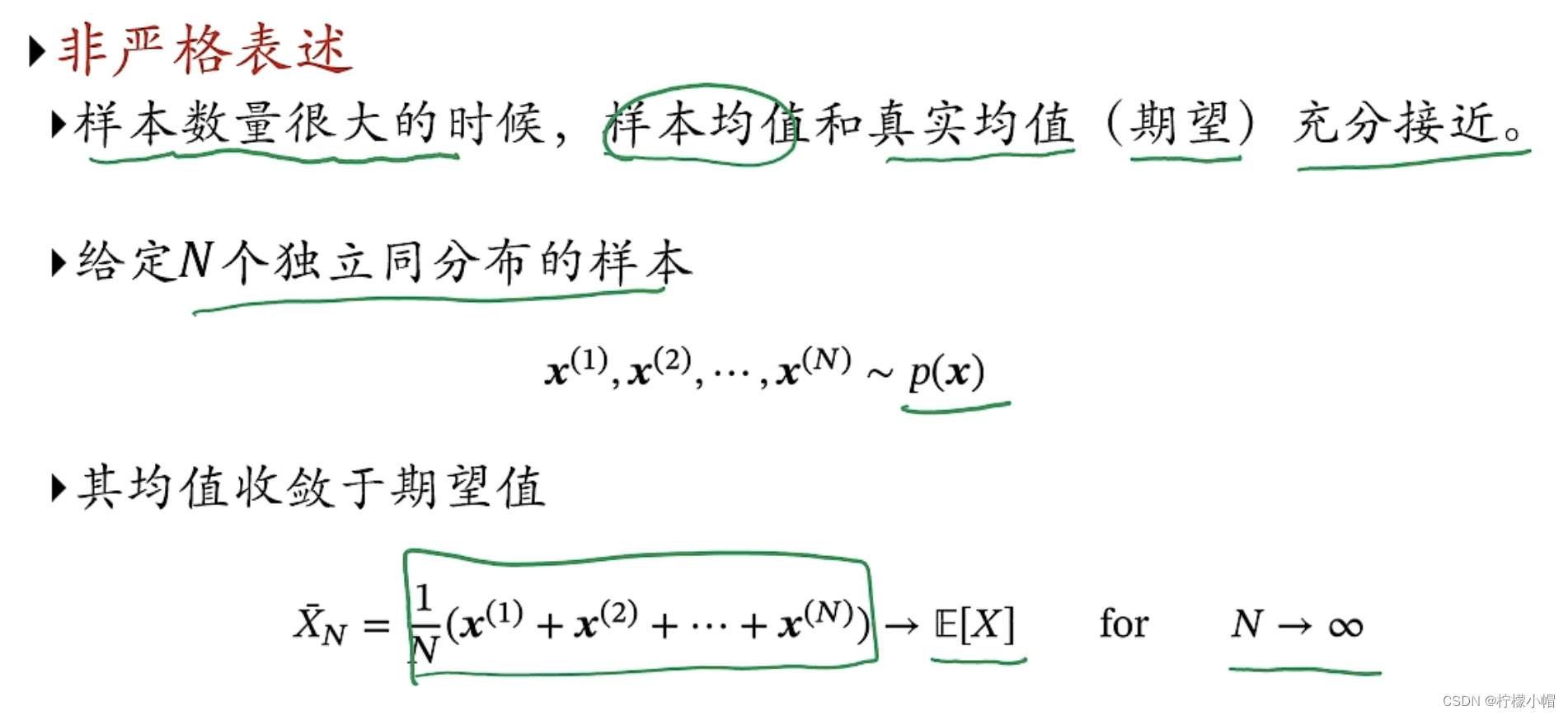

9. 大数定律(Law of Large Numbers)

二、机器学习定义

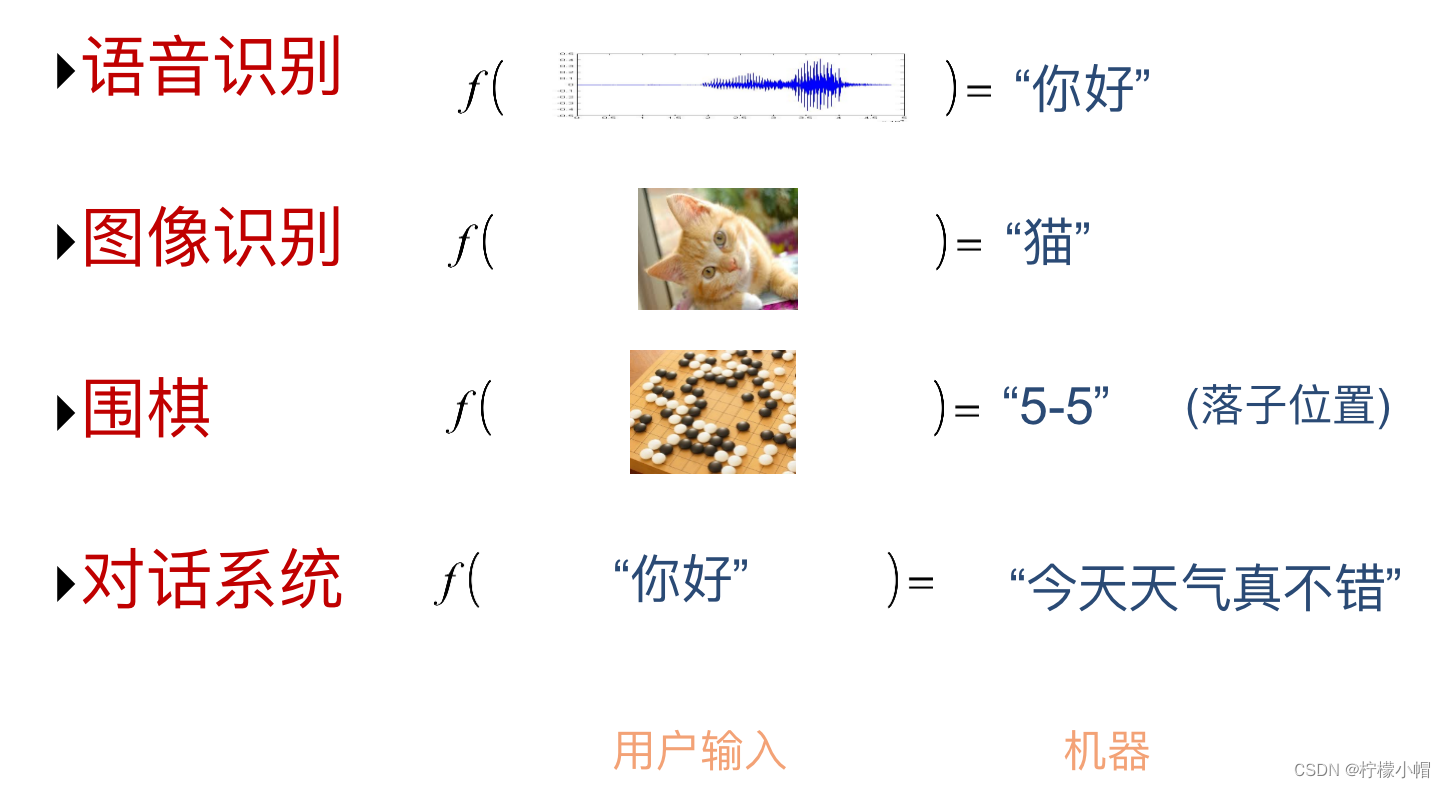

1. 机器学习 ≈ 自动构建一个映射函数

2. 为什么要“机器学习”?

- 现实世界的问题都比较复杂

- 很难通过规则来手工实现

3. 如何构建映射函数?

- 从大量数据中学习规律

4. 机器学习定义

- 机器学习:通过算法使得机器能从大量数据中学习规律从而对新的样本做决策。

- 规律:决策(预测)函数

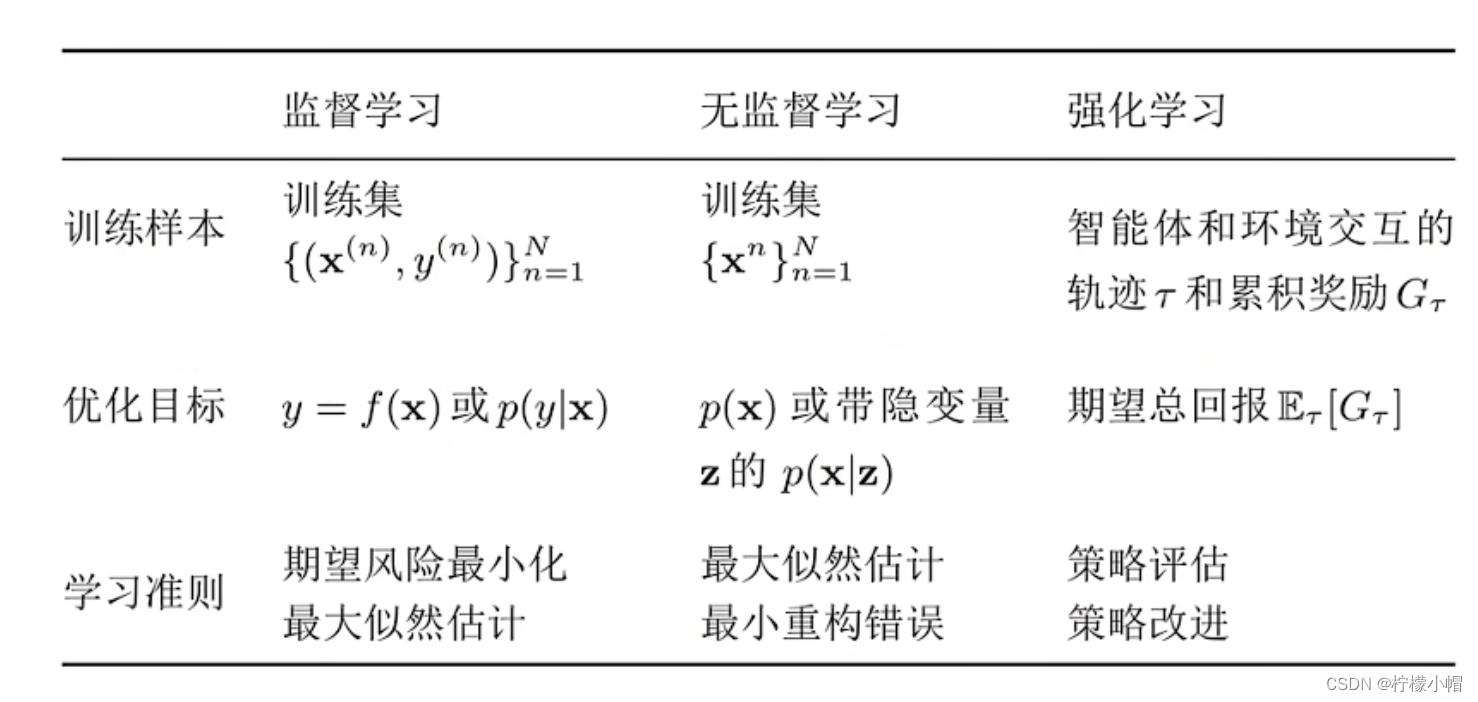

三、机器学习类型

- 回归问题(Regression):电影票房预测,股价预测,房价预测

- 分类问题(Classification):手写数字识别,人脸检测,垃圾邮件检测(Spam Detection)

- 聚类问题:图像聚类(Clustering Images)

- 强化学习:通过与环境进行交互来学习(AlphaGo)

1. 典型的监督学习问题

- 回归 y是实数

- 分类 y是离散值

2. 典型的无监督学习问题

- 聚类

- 降维

- 密度估计

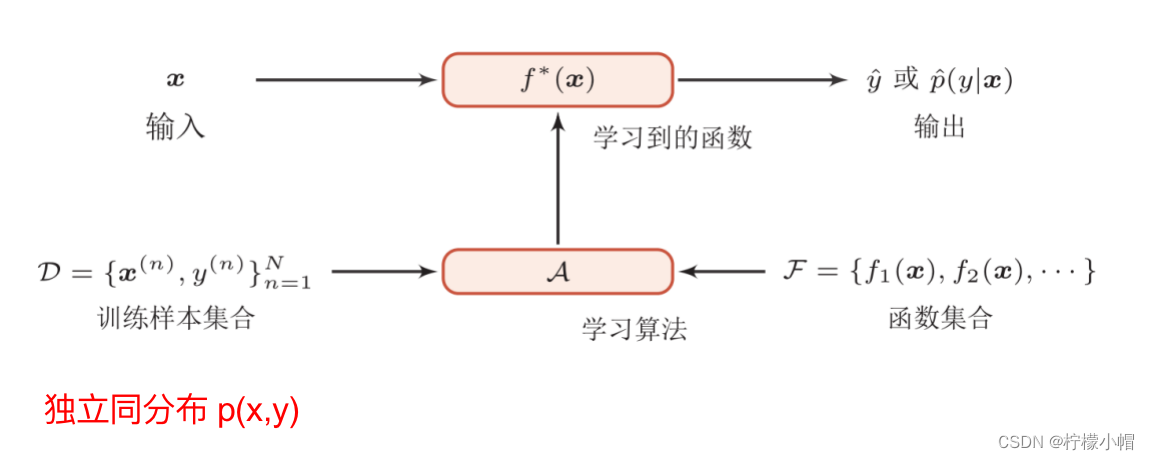

四、机器学习的要素

1. 机器学习的四个要素

- 数据 -> 模型 -> 学习准则 -> 优化算法

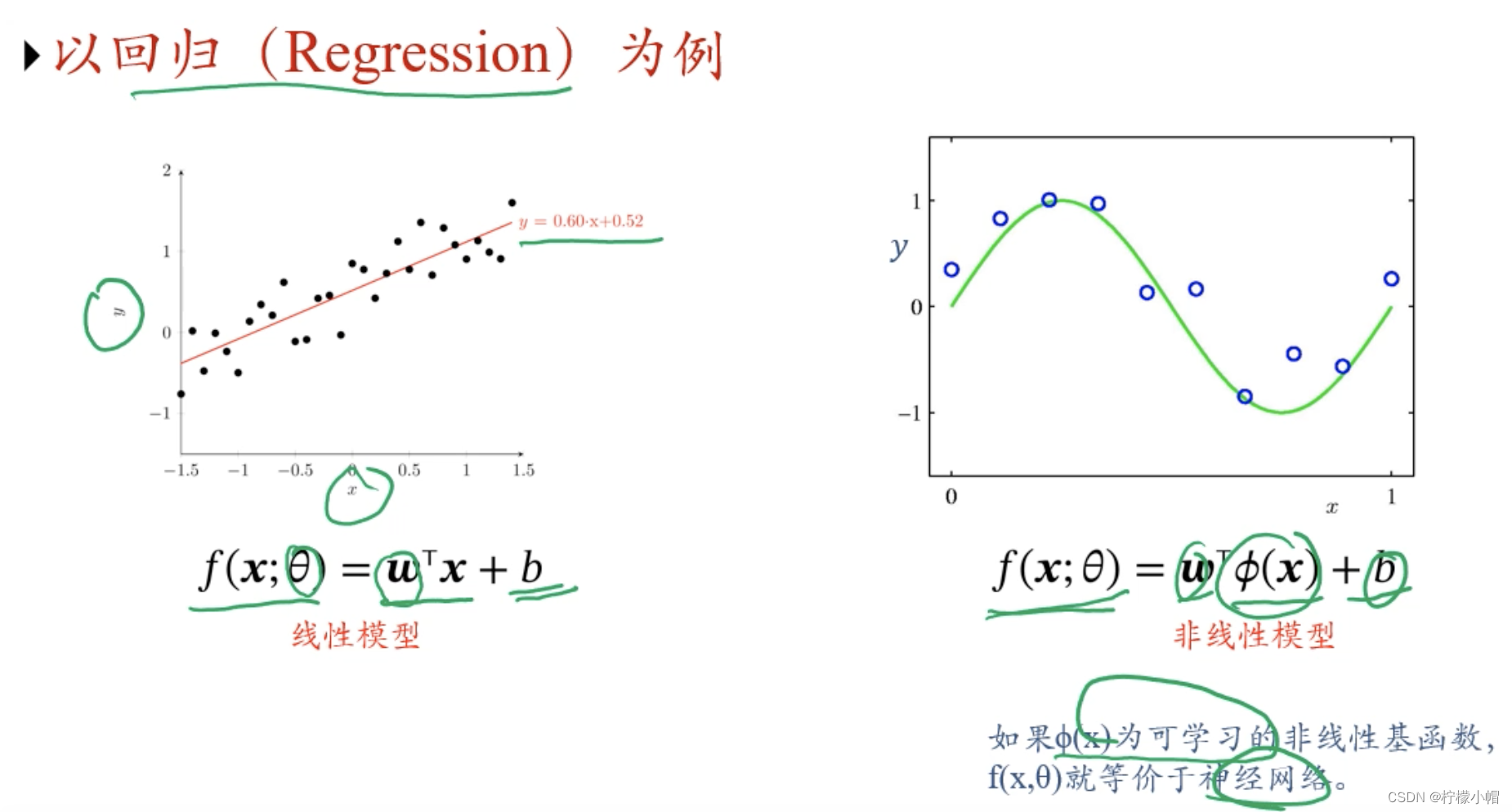

2. 模型

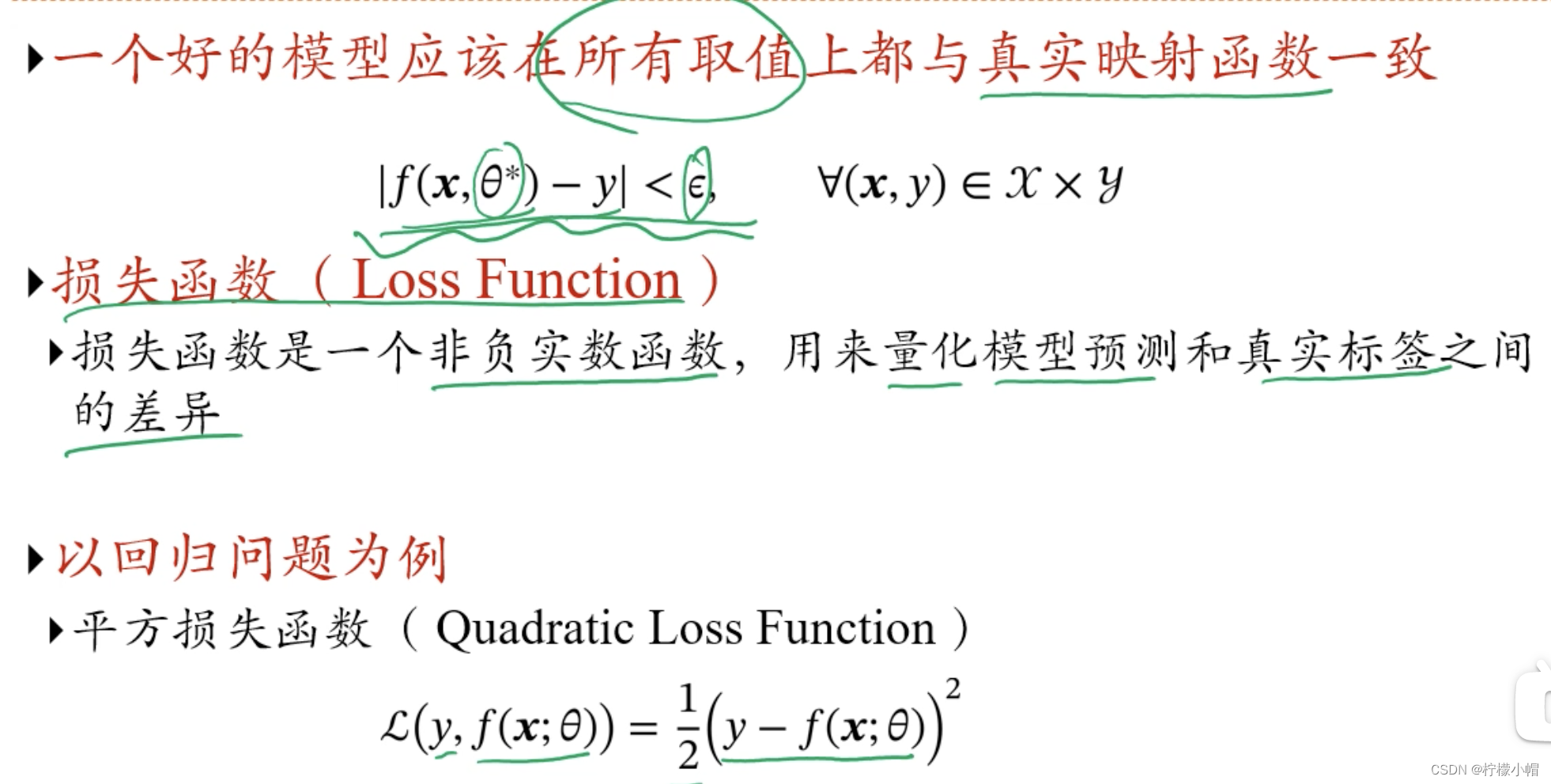

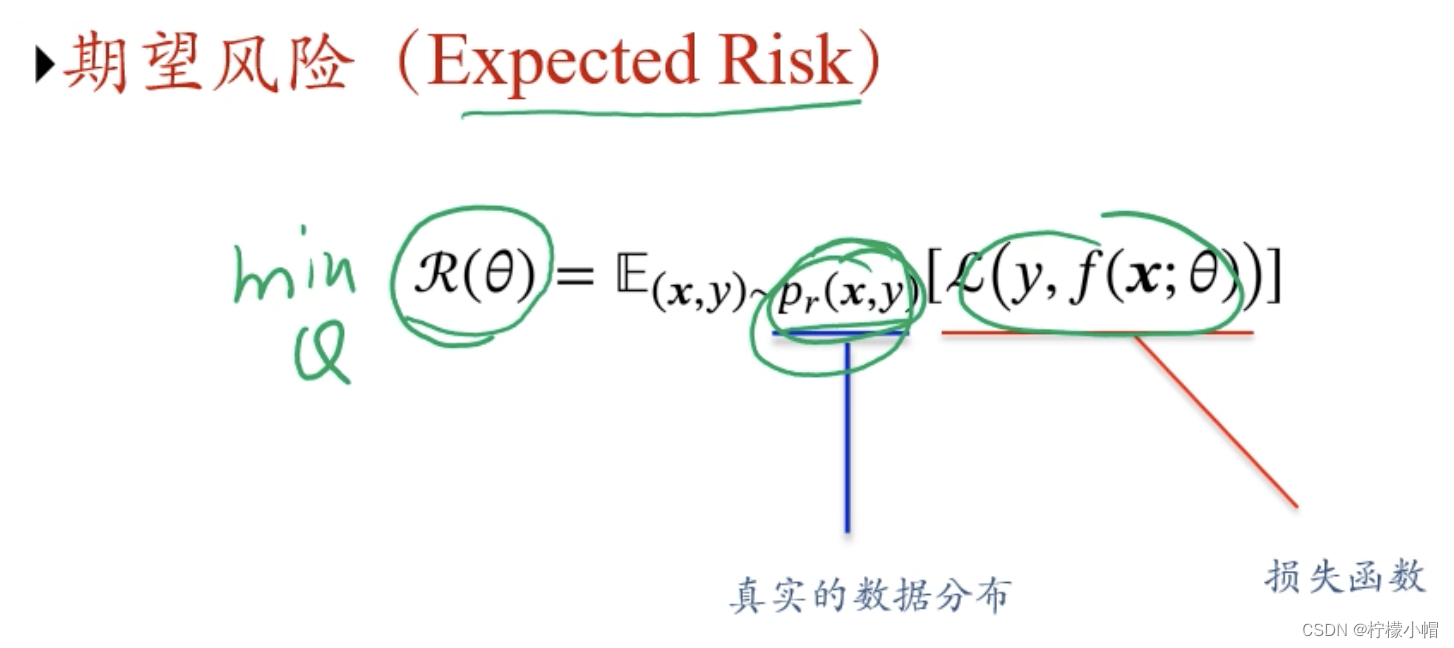

3. 学习准则

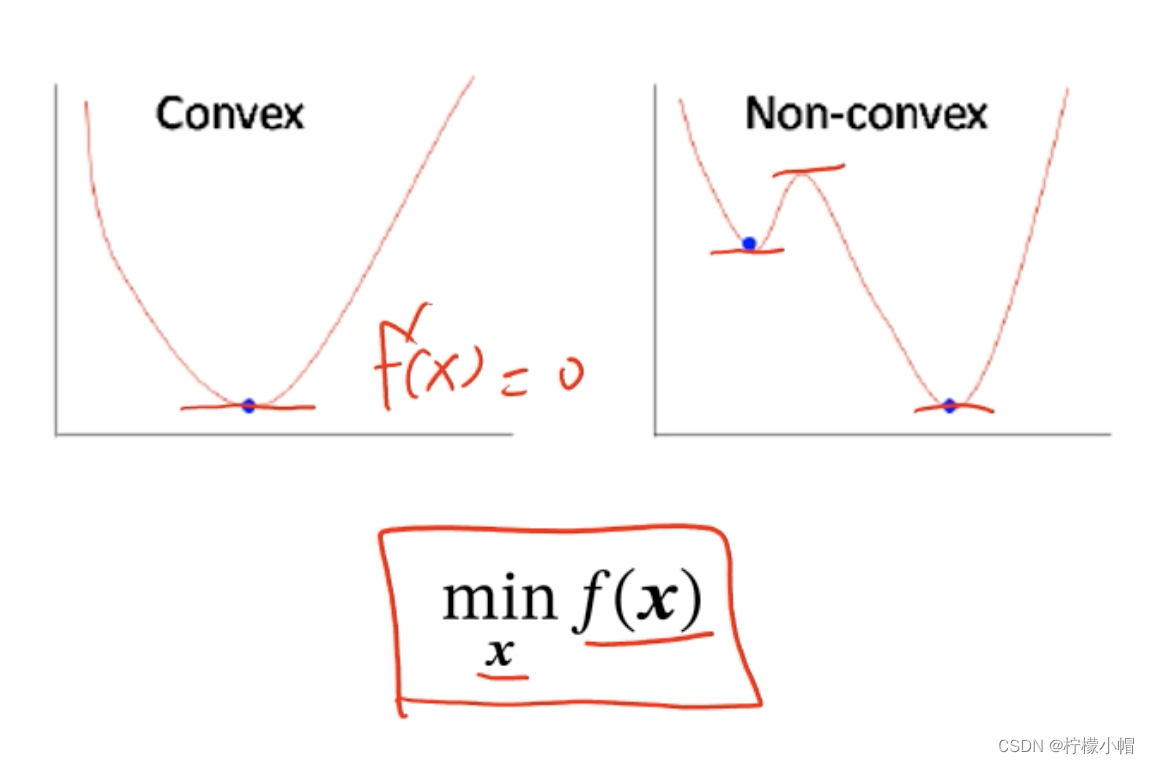

4. 最优化问题

- 让一阶导等于0,求极值点的方法

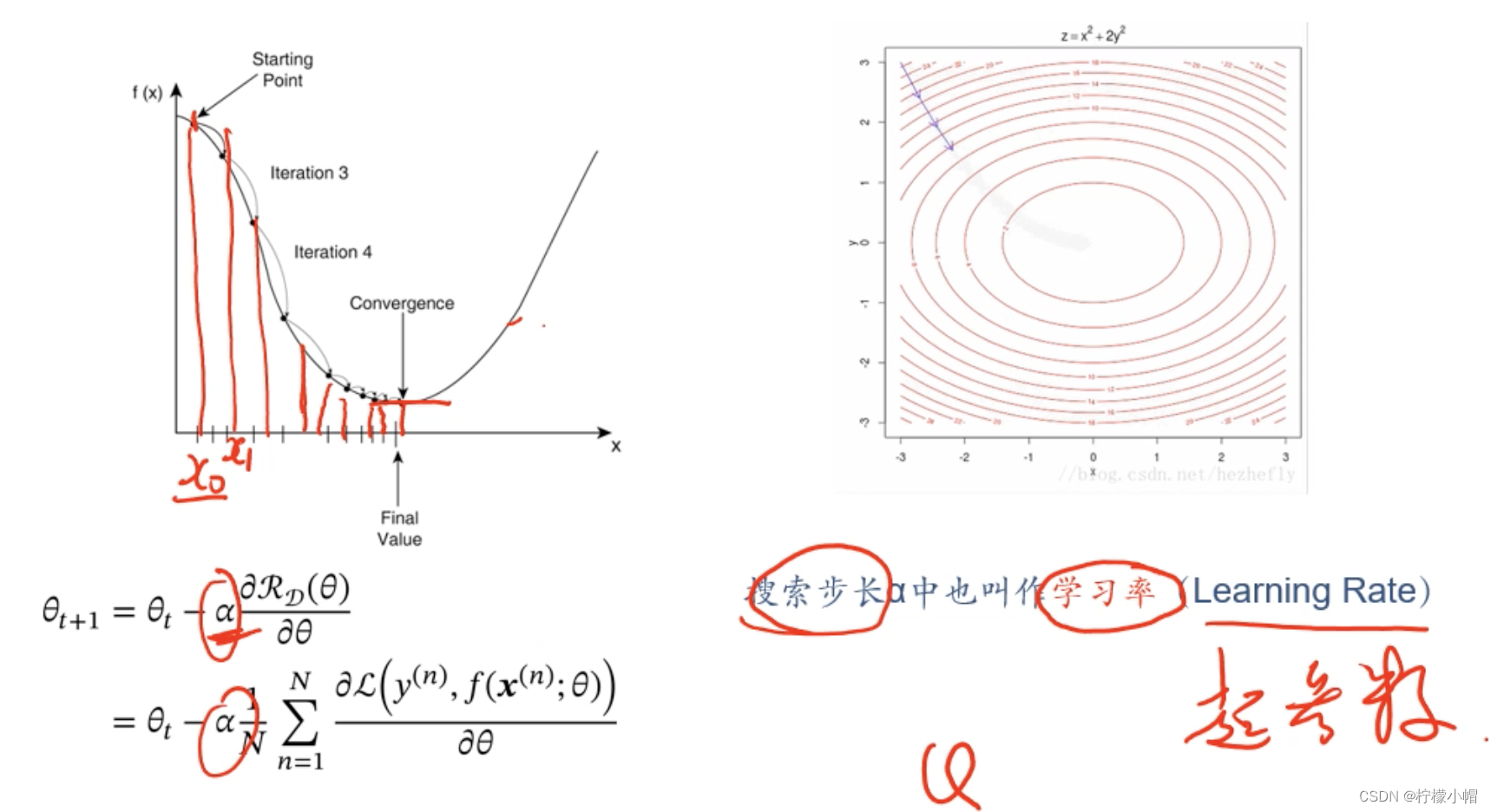

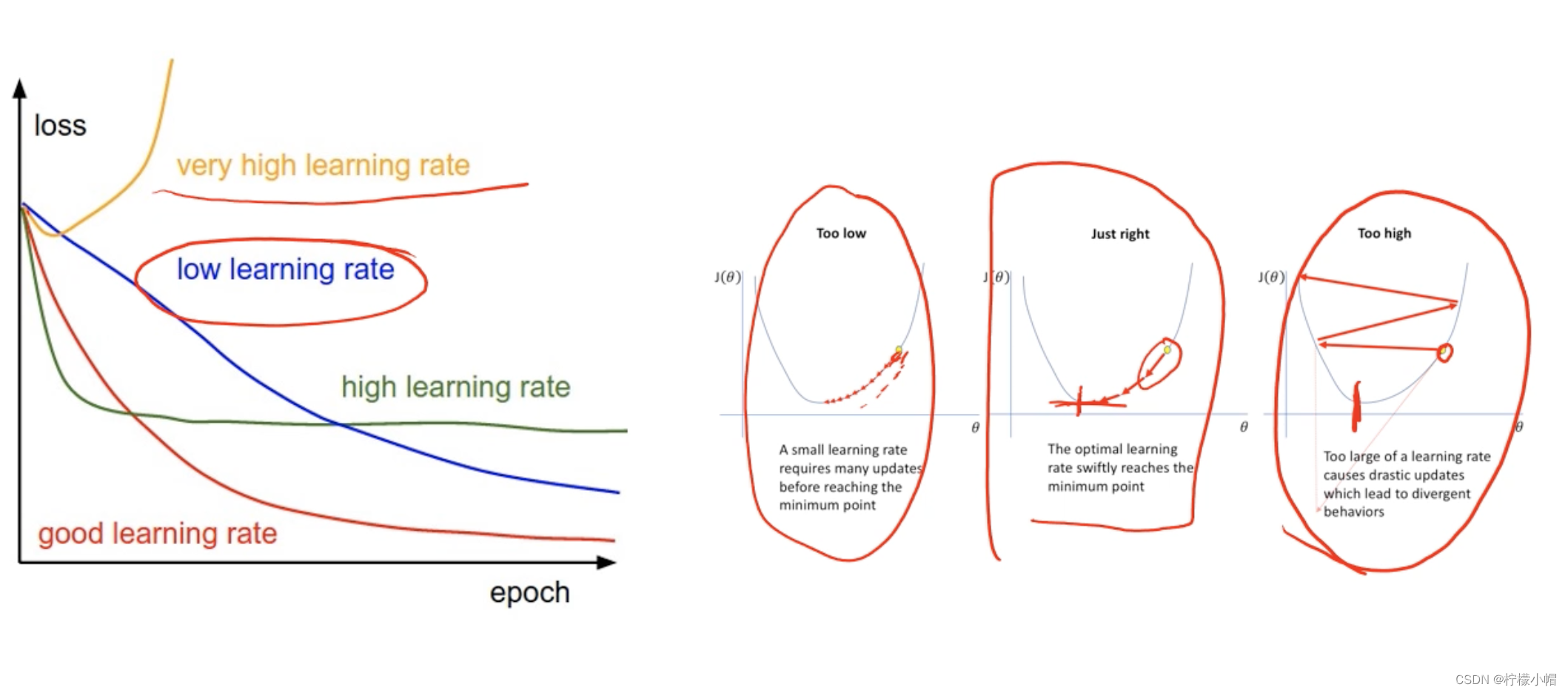

- 梯度下降法(Gradient Descent)

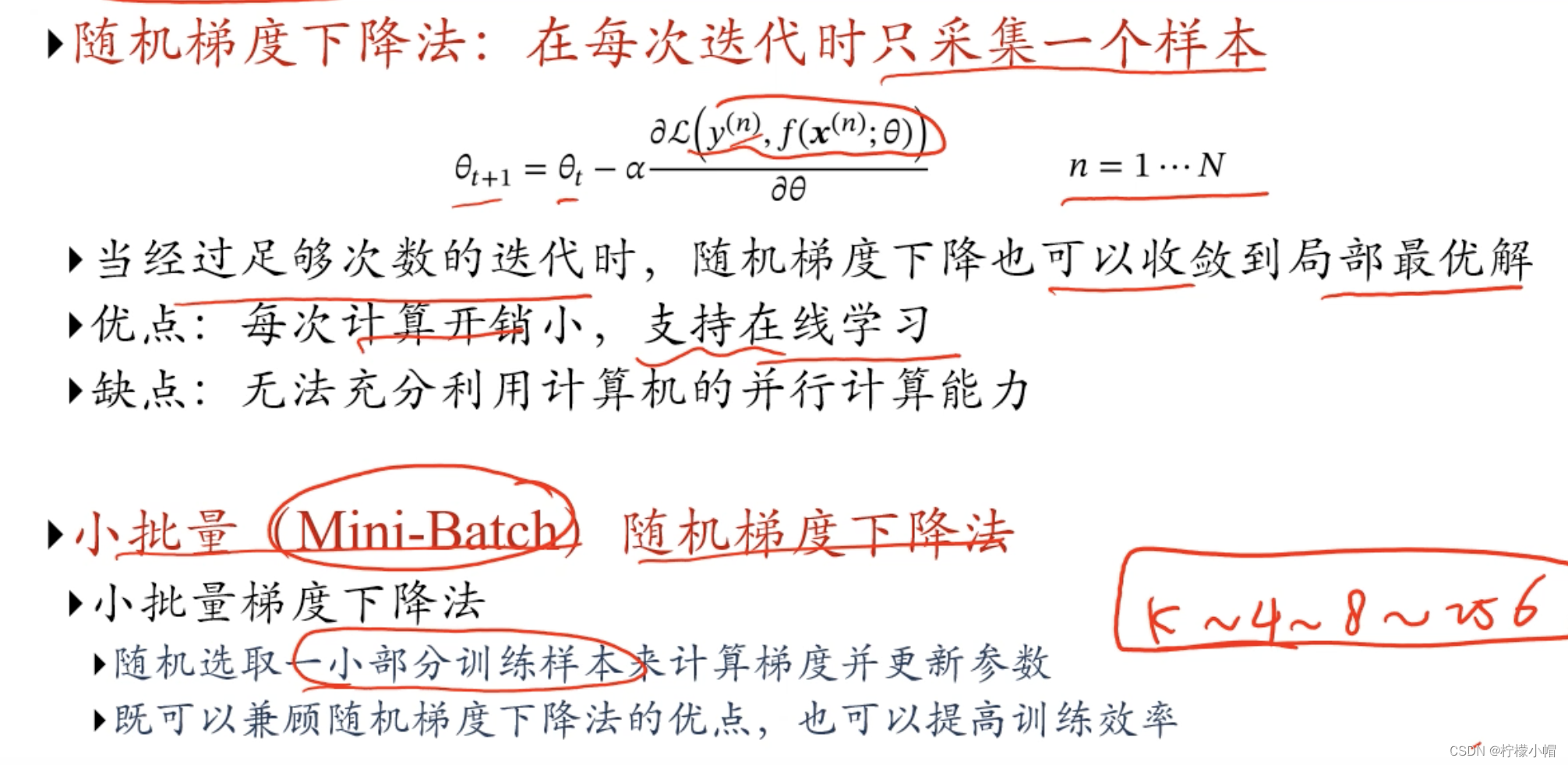

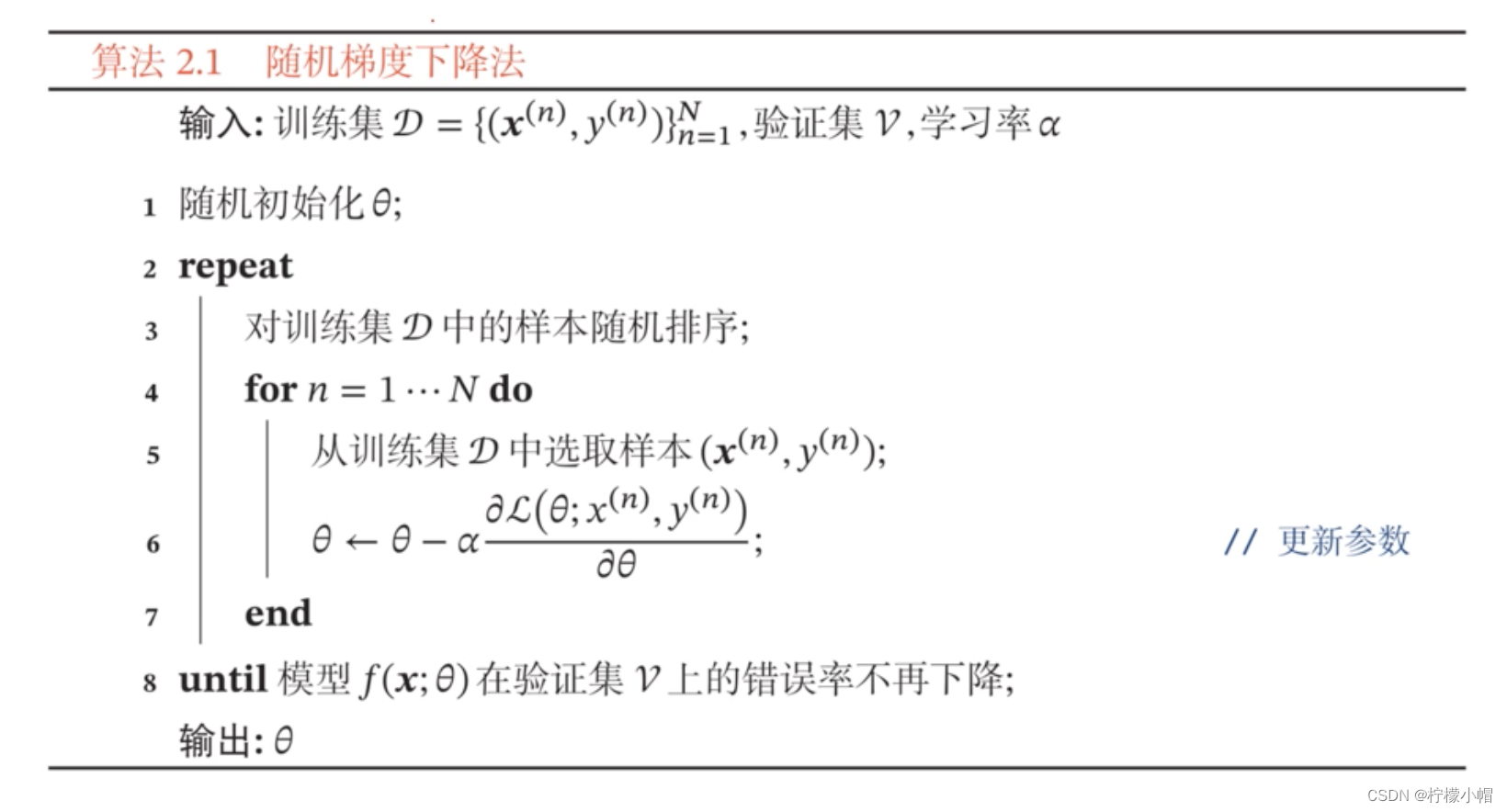

5. 随机梯度下降法(Stochastic Gradient Descent,SGD)

五、泛化与正则化

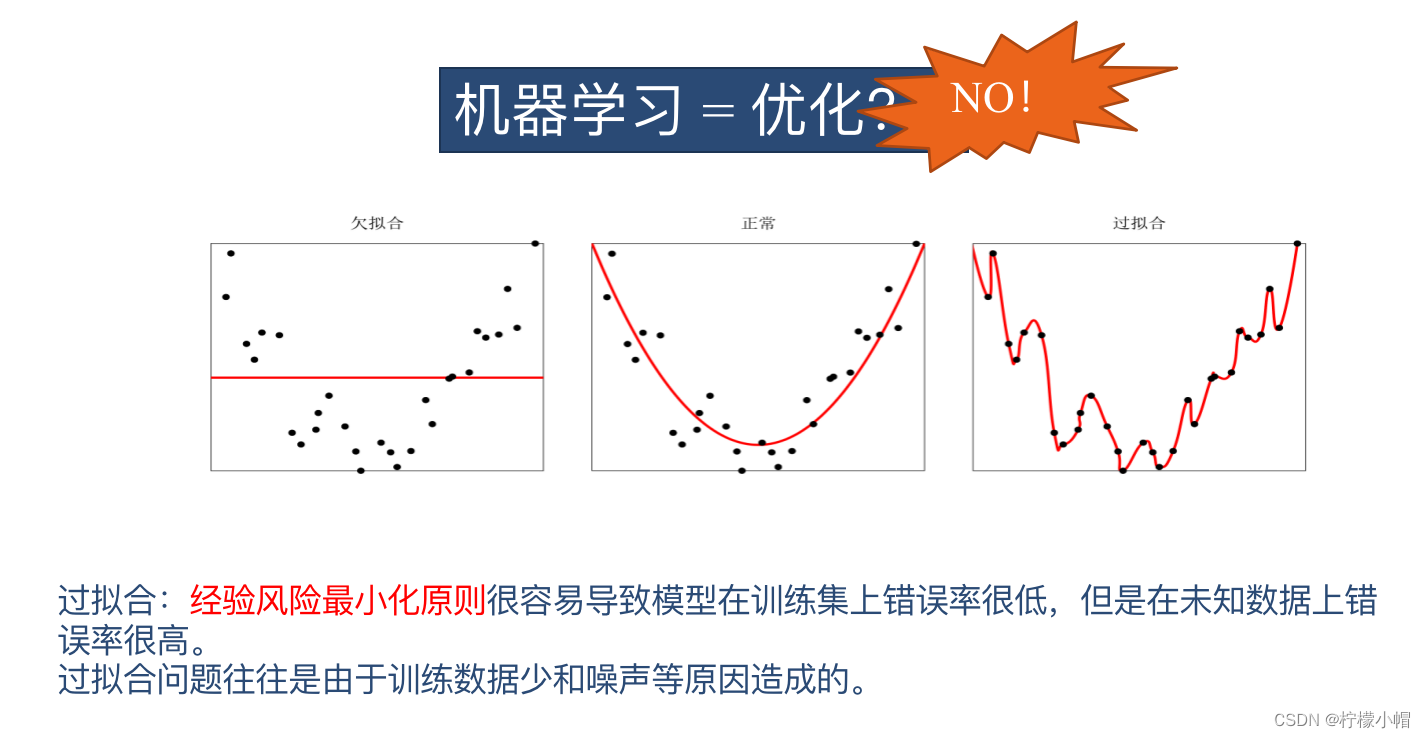

1. 机器学习 = 优化?

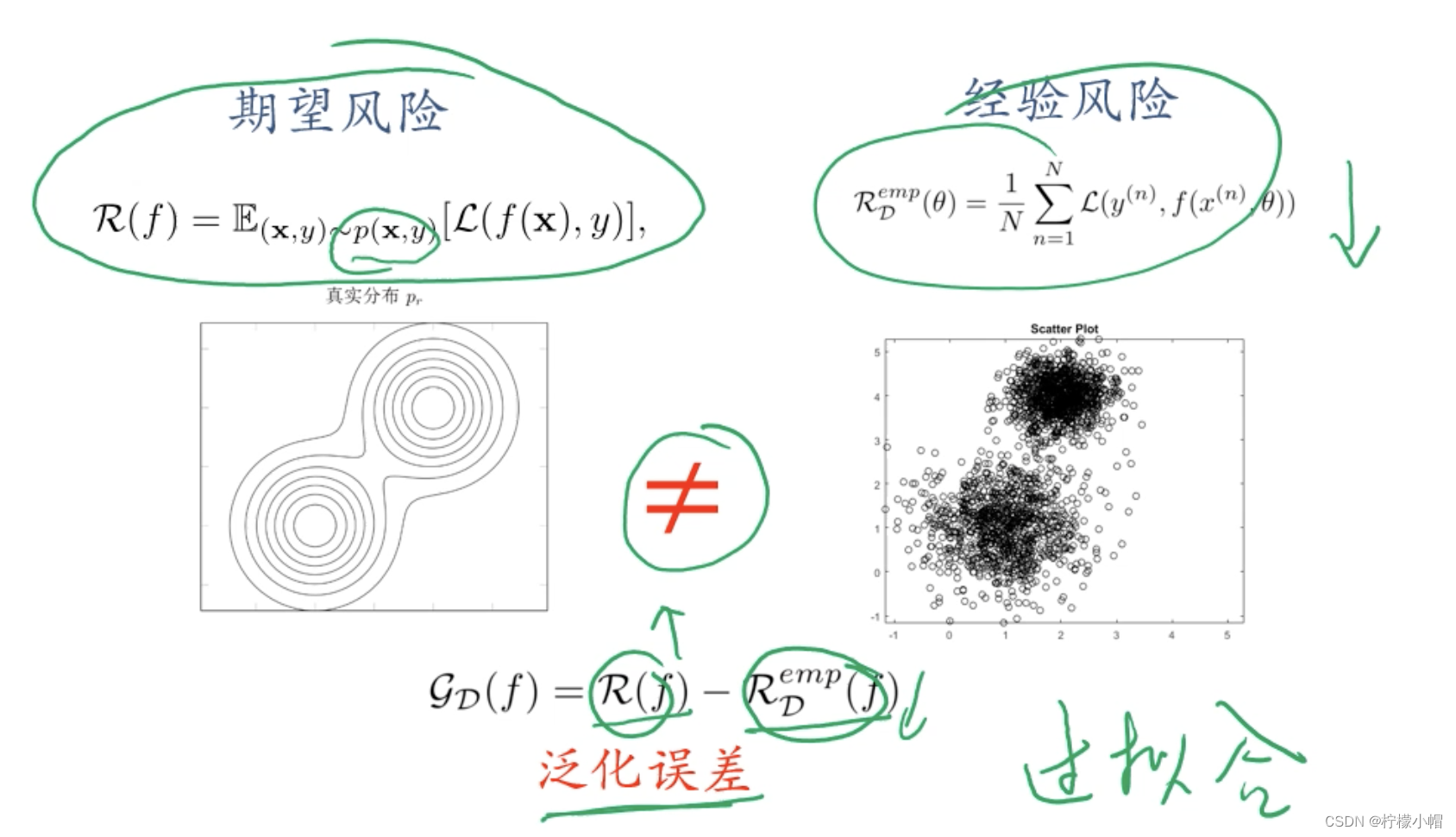

2. 泛化误差

3. 如何减少泛化误差?

- 优化:经验风险最小

- 正则化:降低模型复杂度

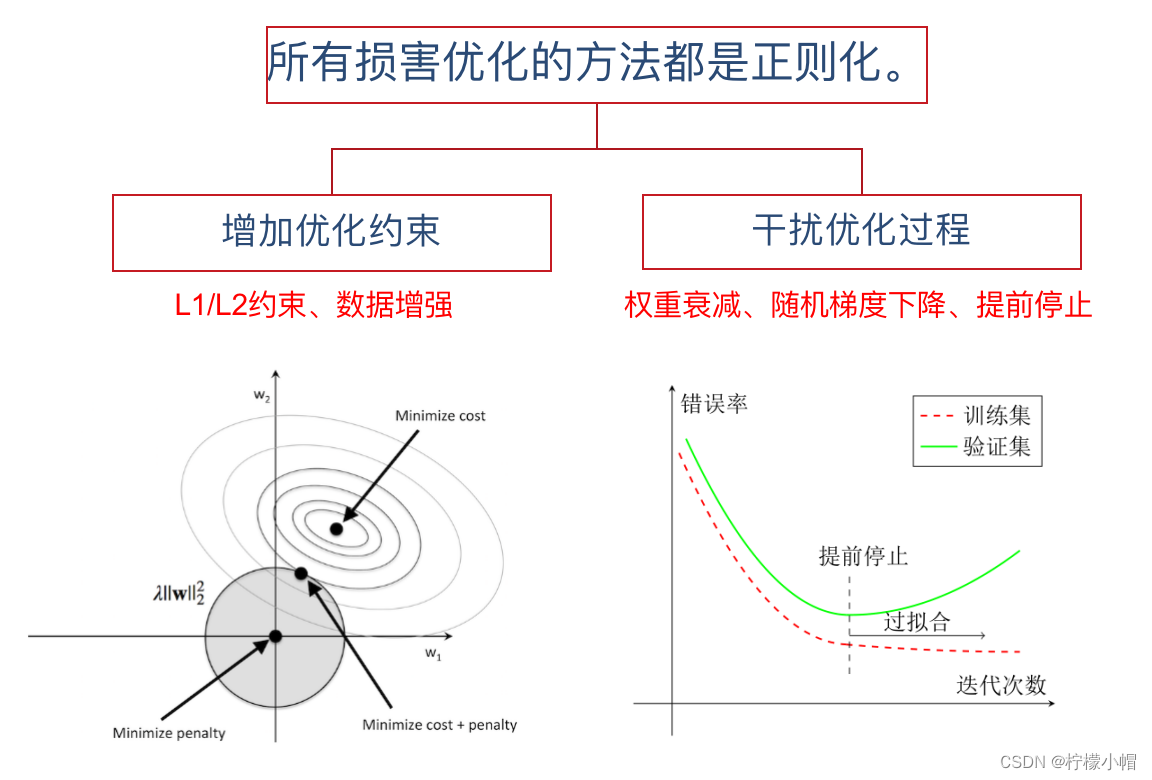

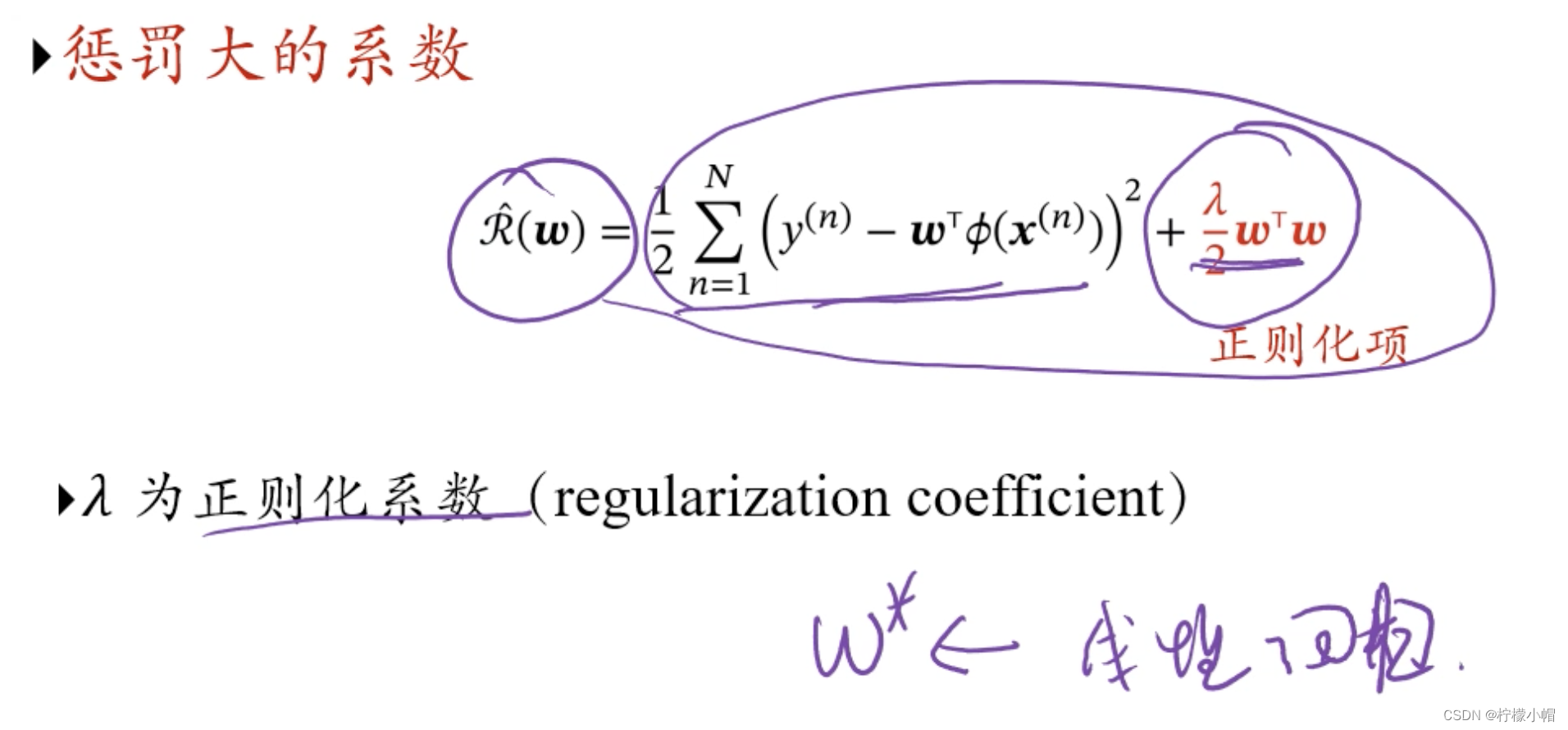

4. 正则化(Regularization)

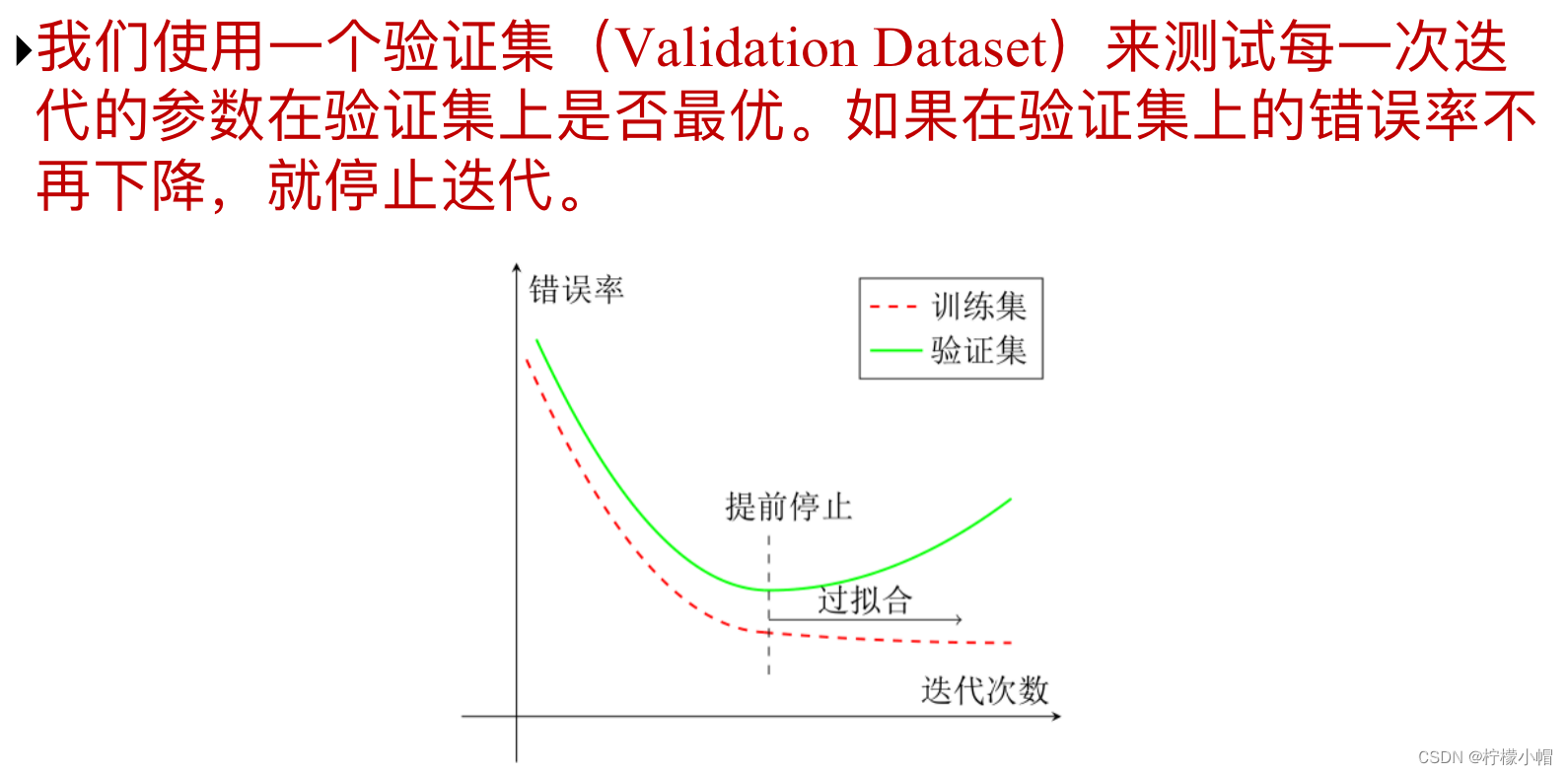

- 提前停止

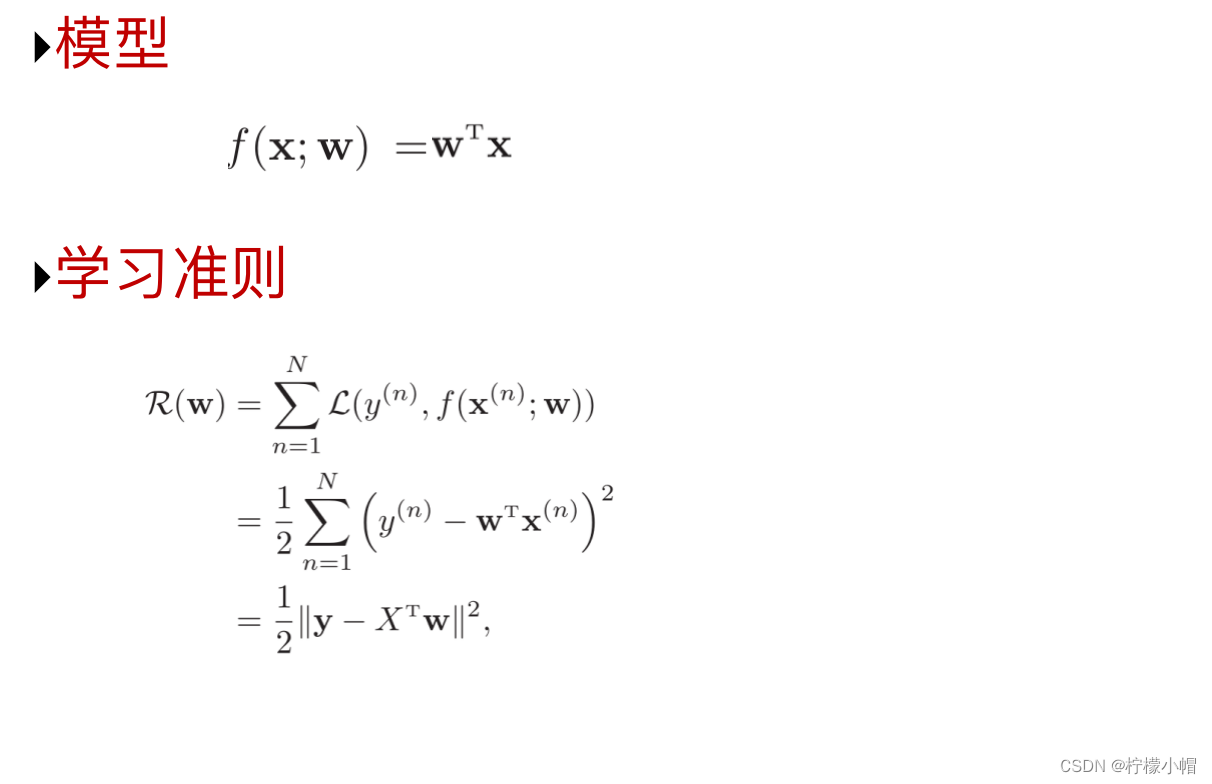

六、线性回归

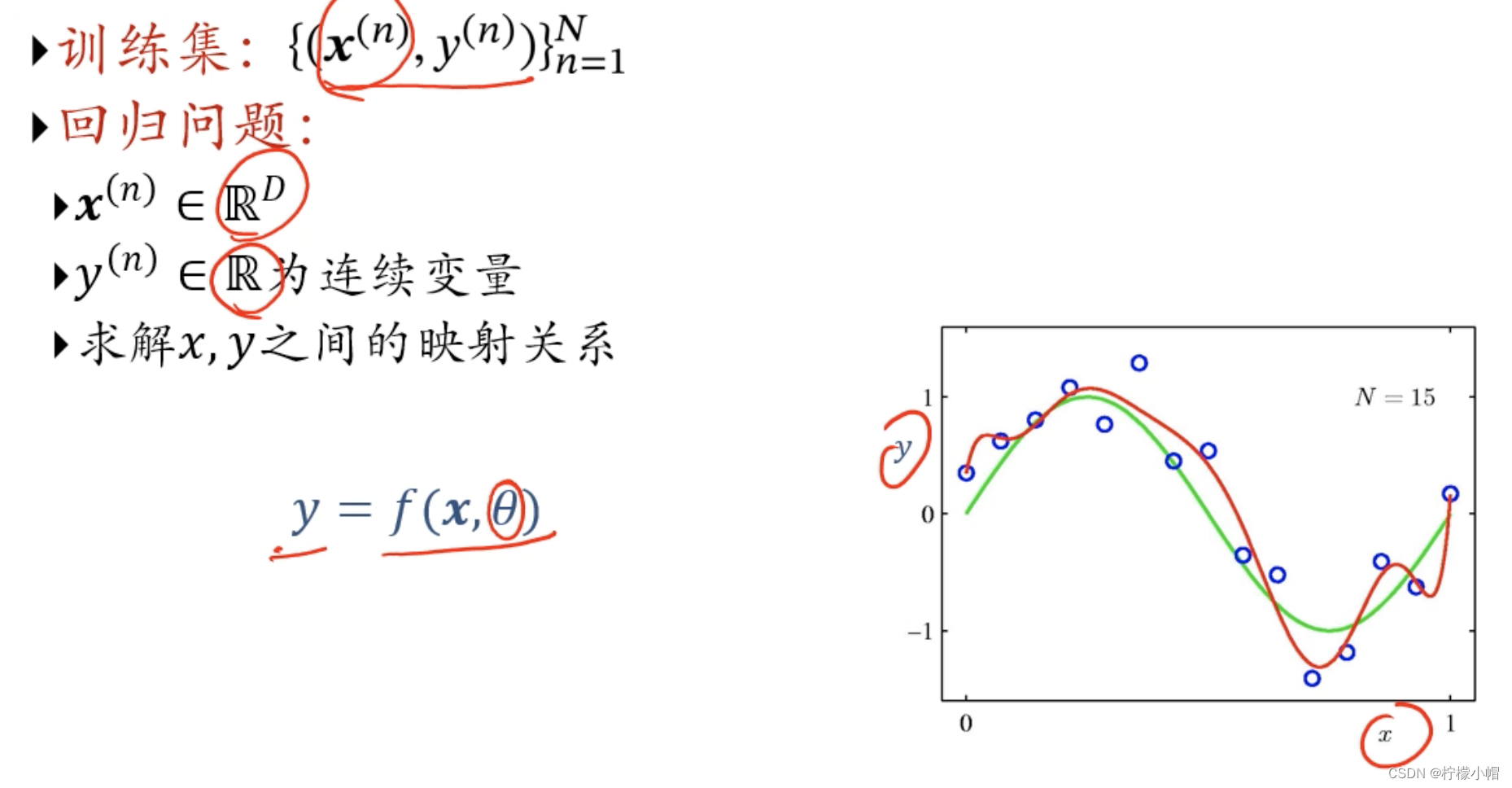

1. 回归(Regression)

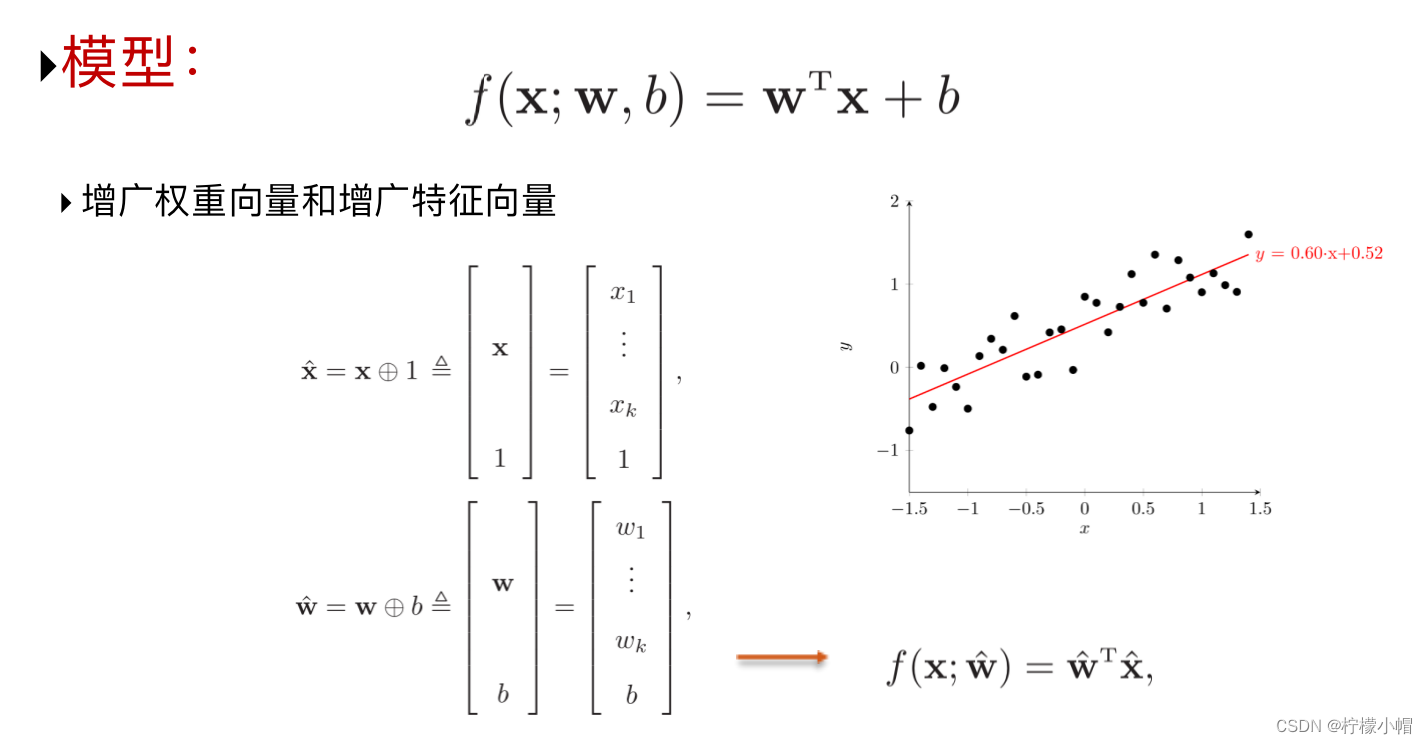

2. 线性回归(Linear Regression)

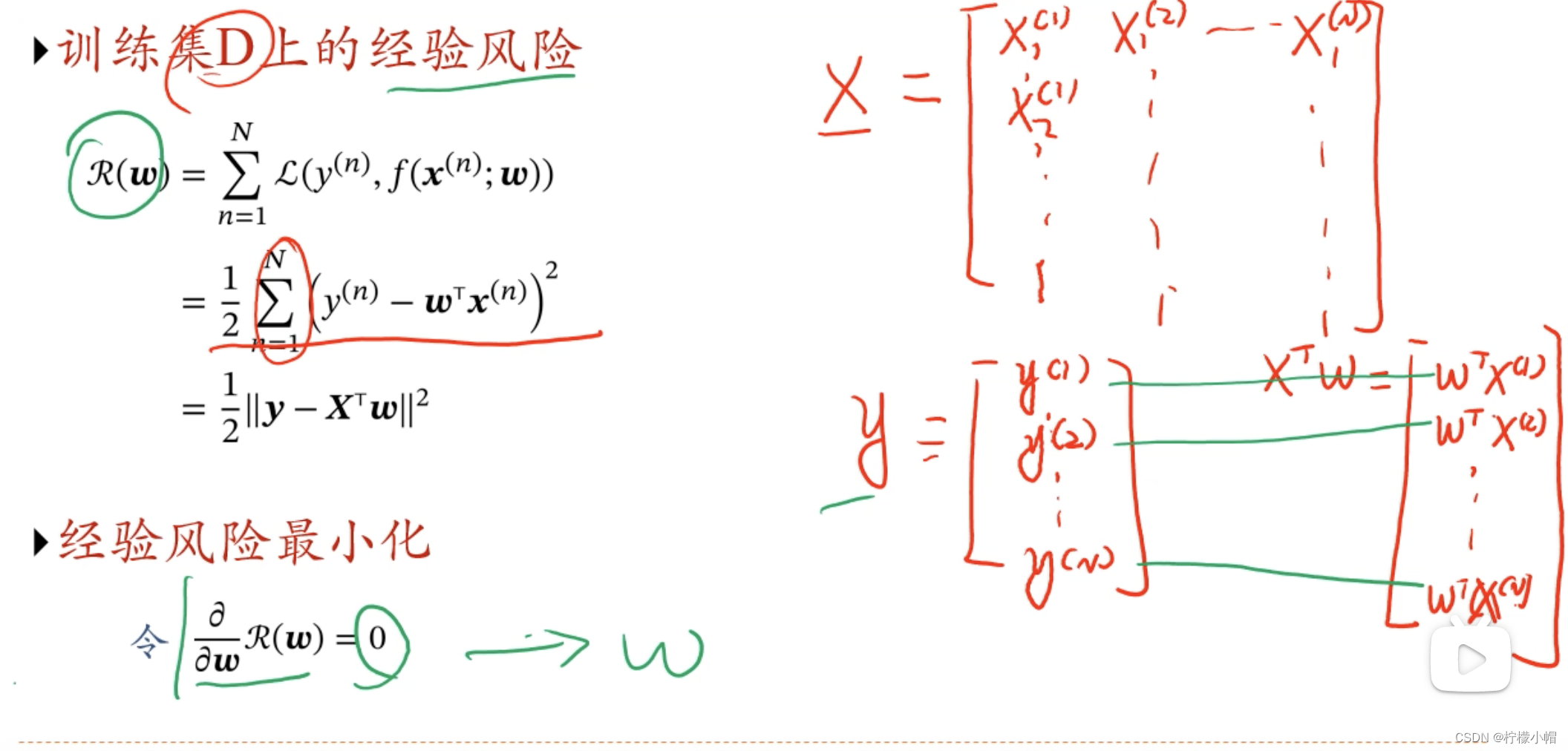

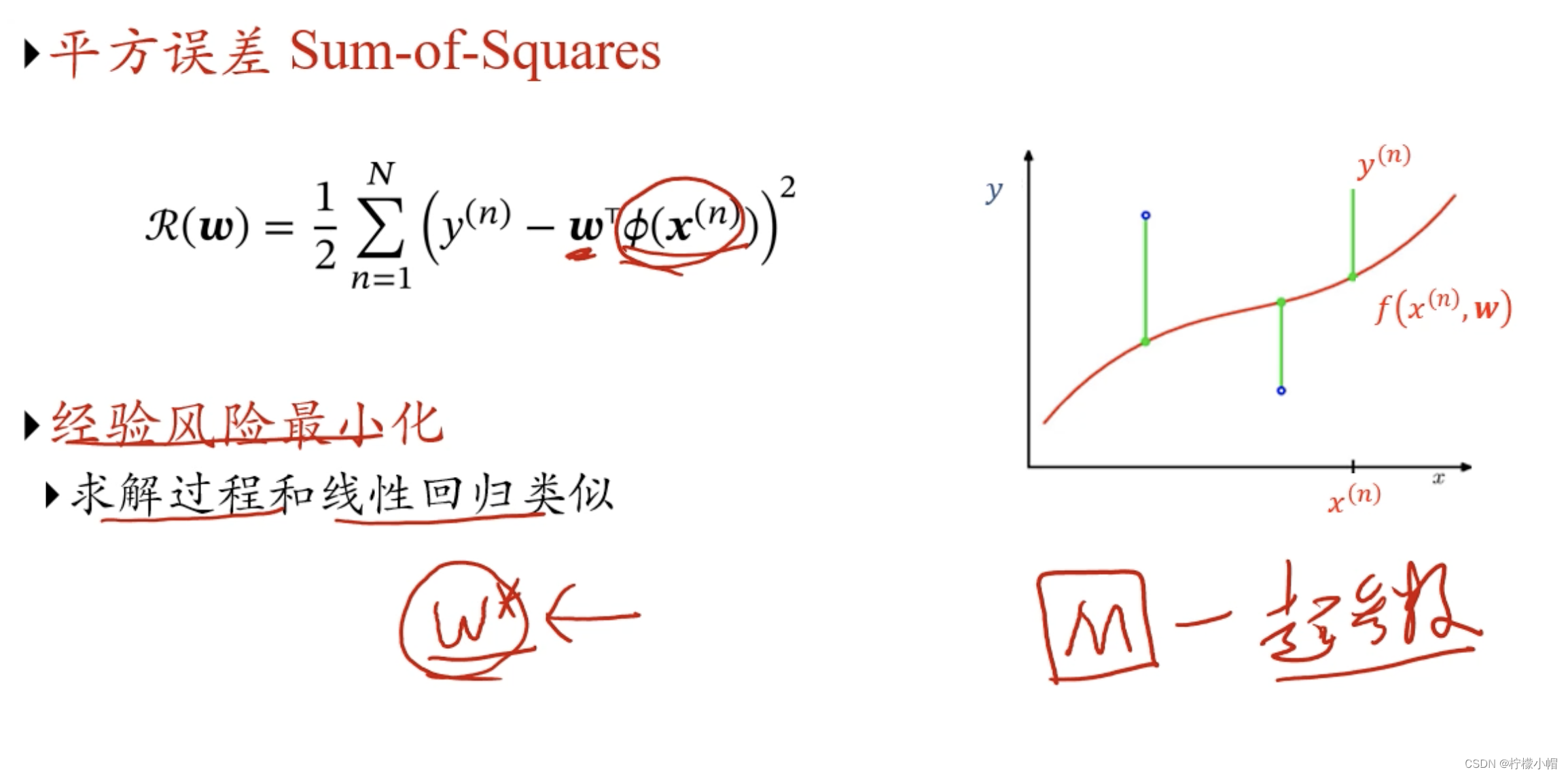

3. 经验风险最小化(Empirical Risk Minimization,ERM)

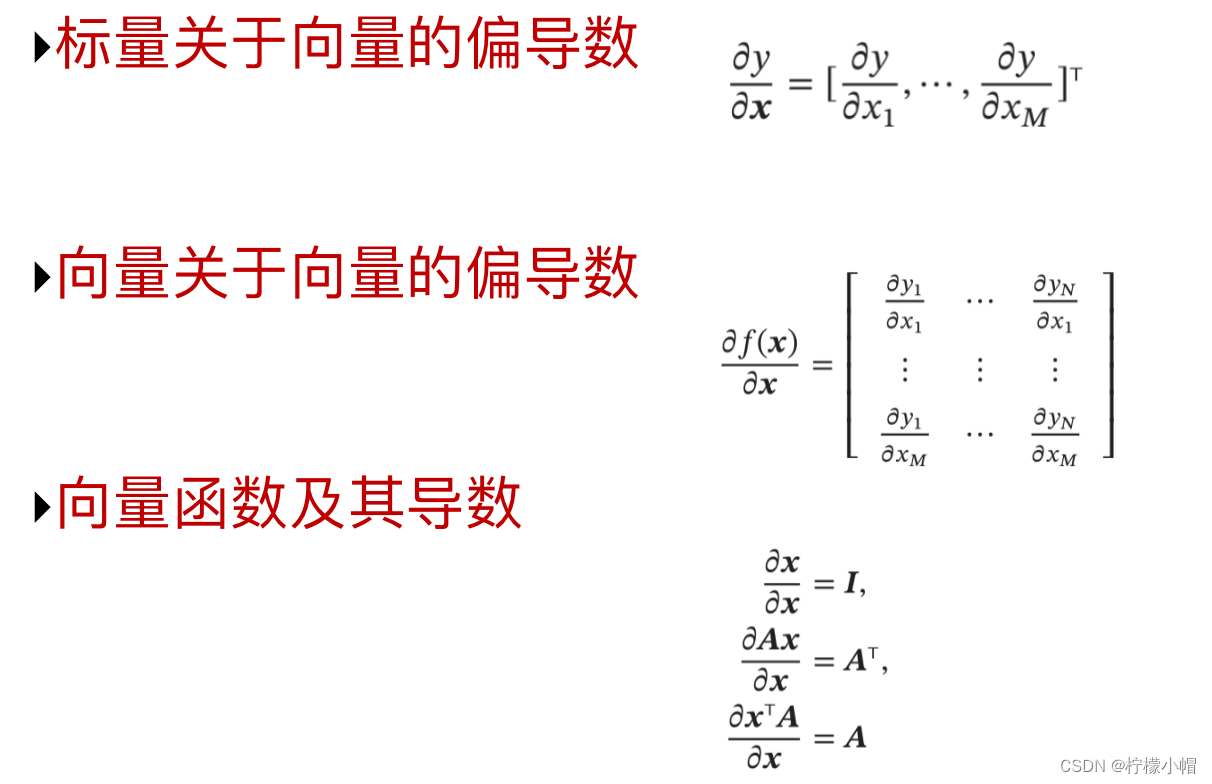

4. 矩阵微积分

5. 经验风险最小化

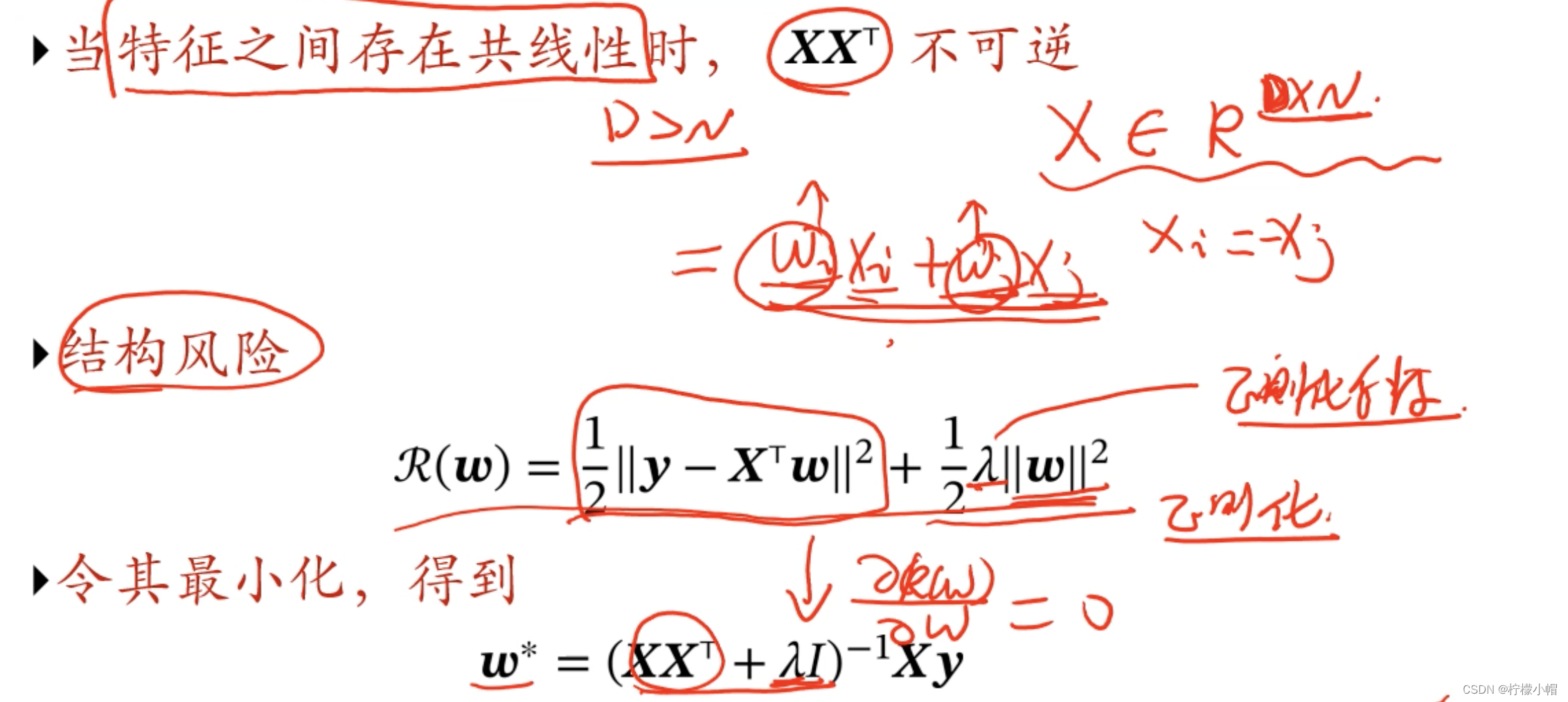

6. 结构风险最小化

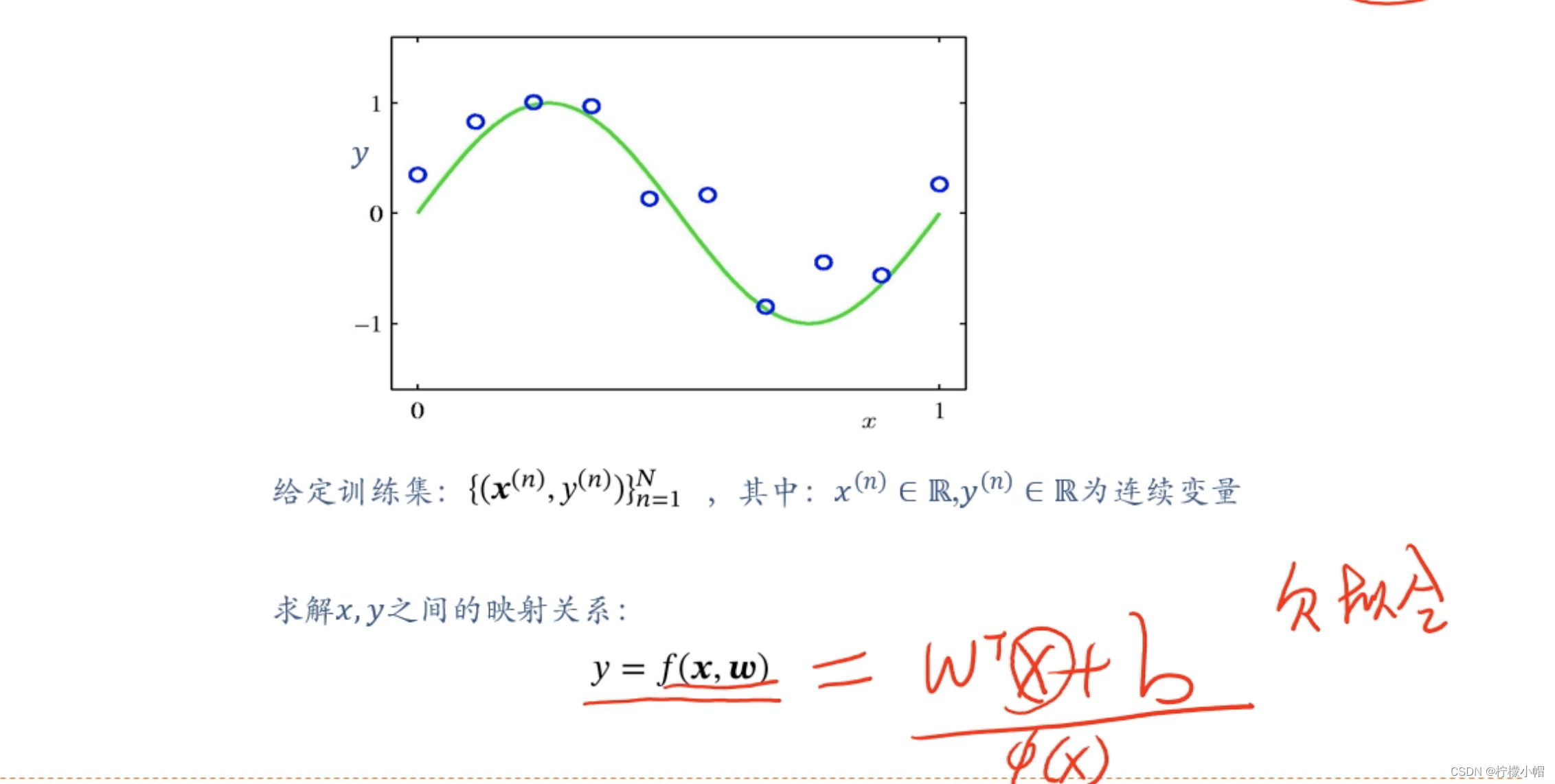

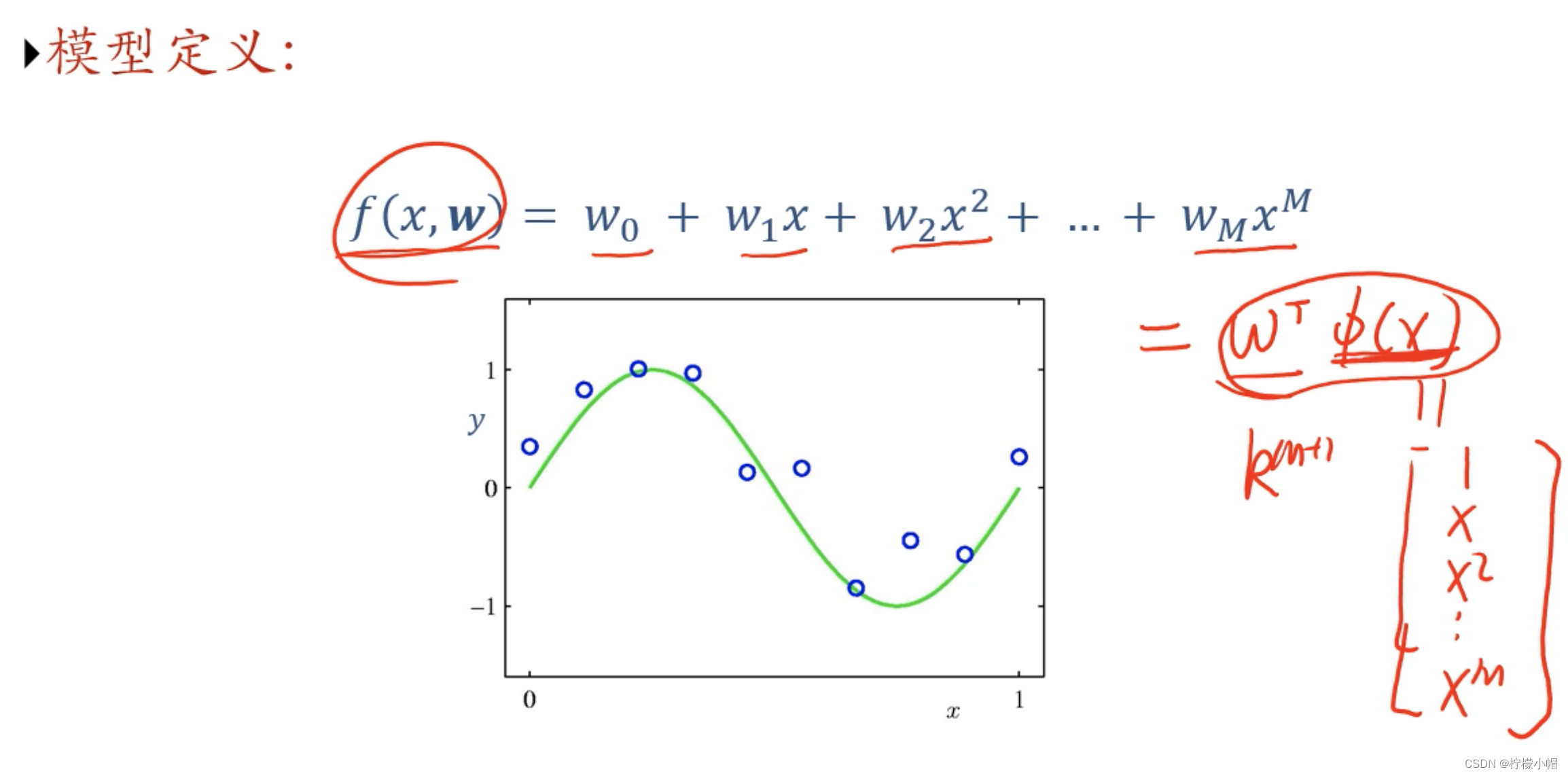

七、多项式回归

1. 曲线拟合(Curve Fitting)

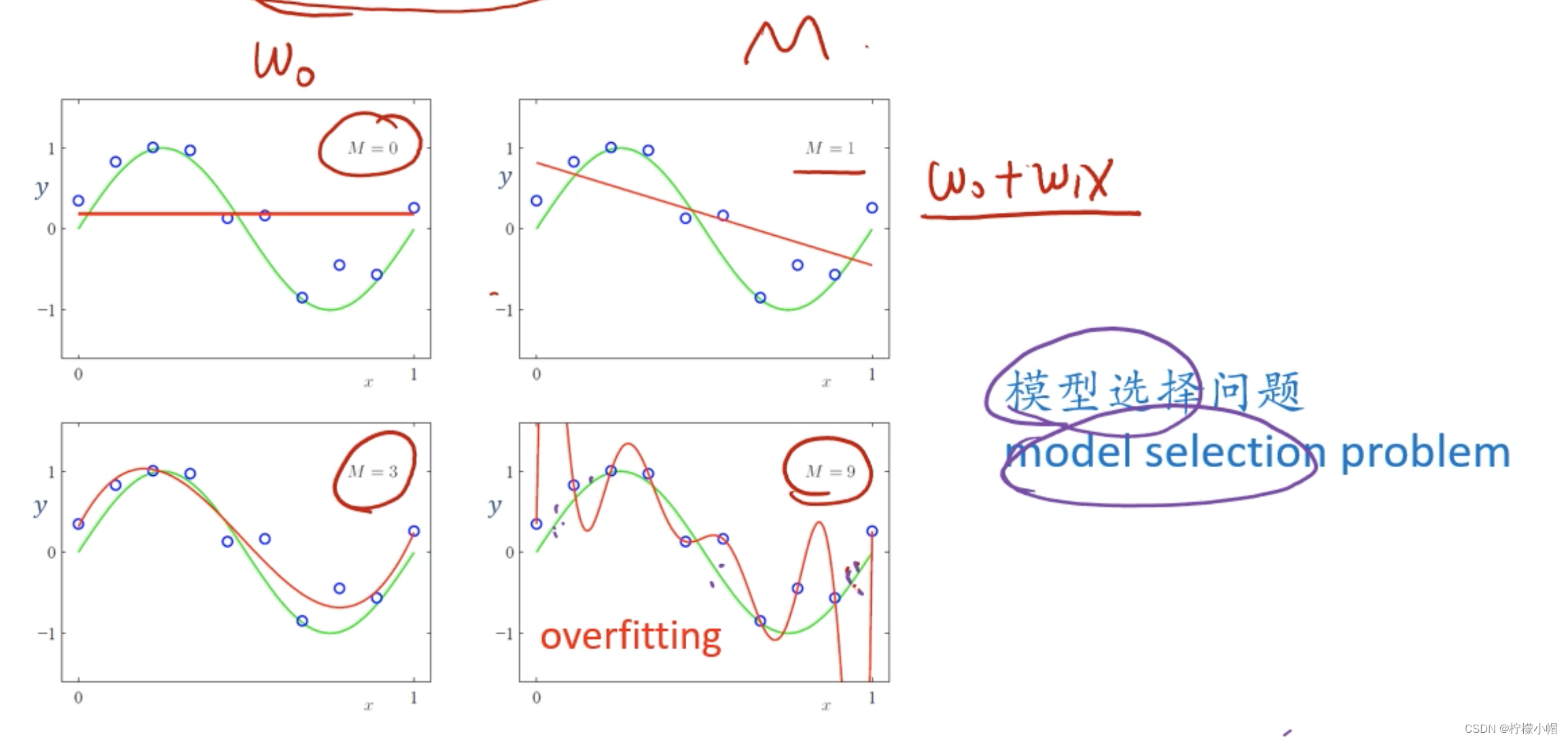

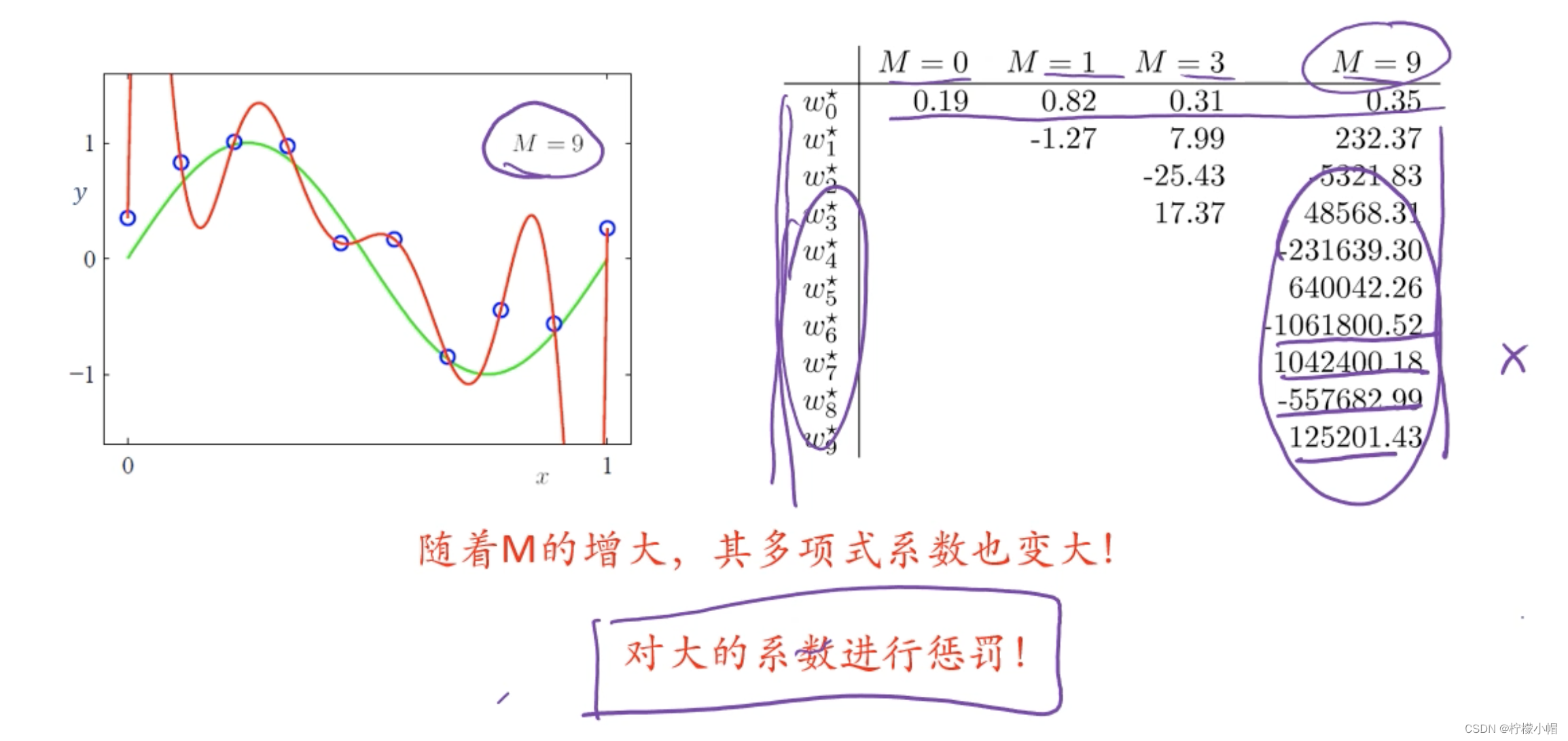

2. 多项式曲线拟合(Polynomial Curve Fitting)

3. 损失函数

4. 如何选择多项式的次数(Degree)?

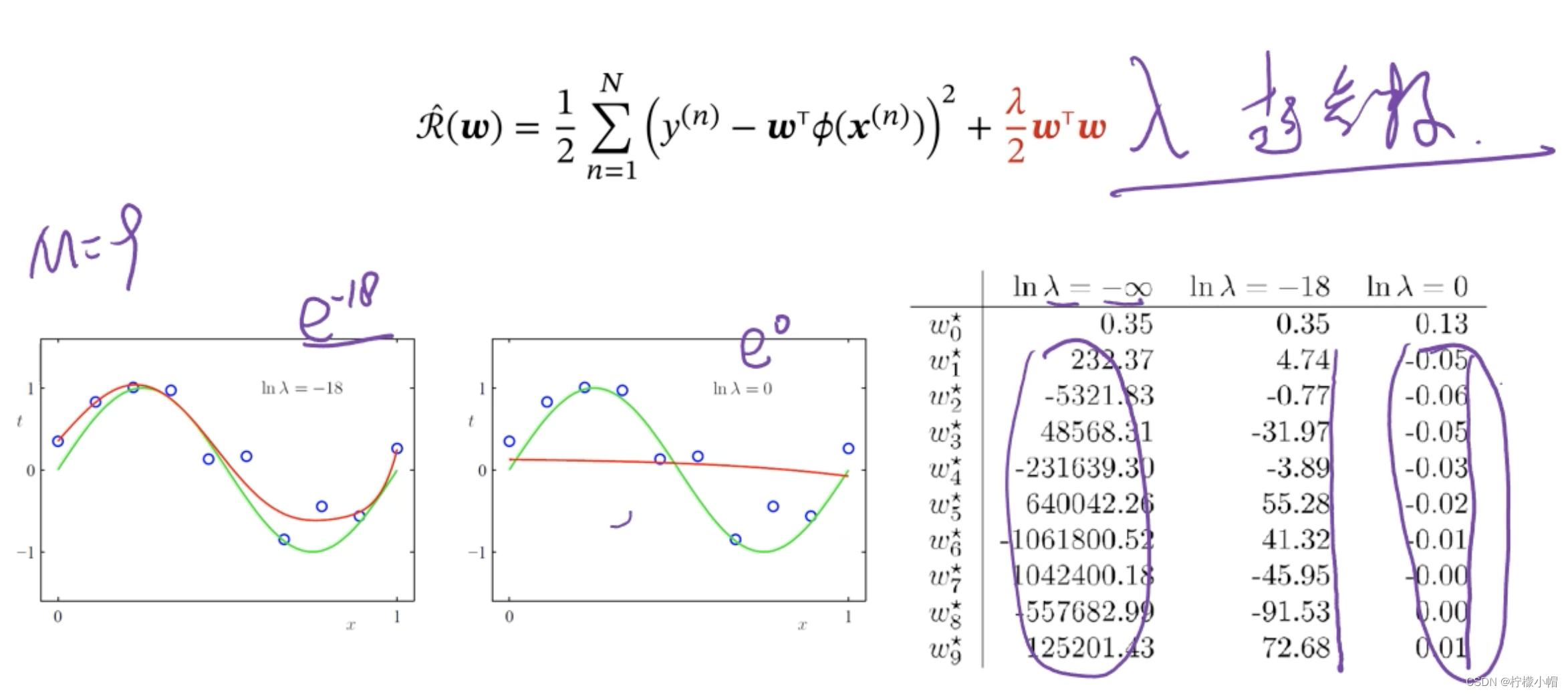

5. 控制过拟合:正则化(Regularization)

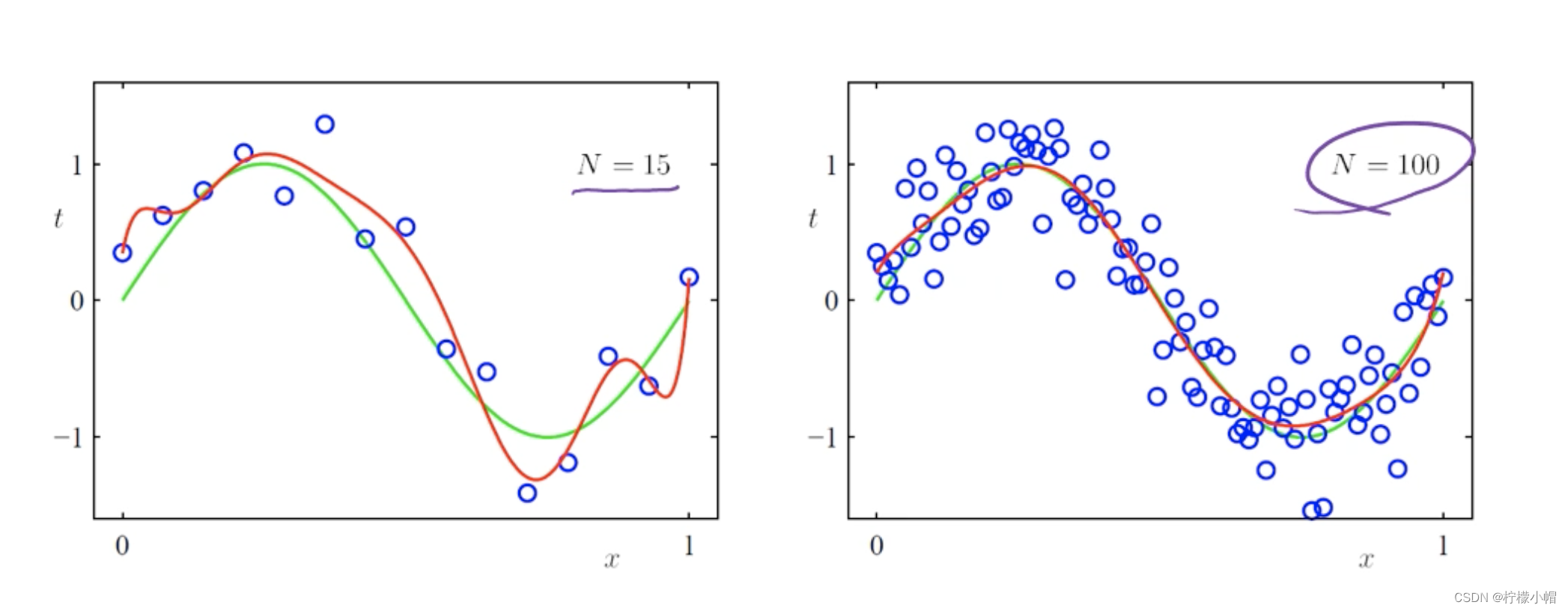

6. 控制过拟合:增加训练样本数量

4148

4148

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?