【02】监督学习-线性回归

- 监督学习

- 线性回归

- Gradient Descent(梯度下降)两种求解

1、LMS algorithm (Least Mean Squares)

2、the normal equaltion(正规方程法-矩阵的形式-主要是进行证明)

对于LMS方法:可以用batch GD 和 stochastic Gradient descent

监督学习

流程:(有标签样本训练,然后进行预测)

典型——线性回归

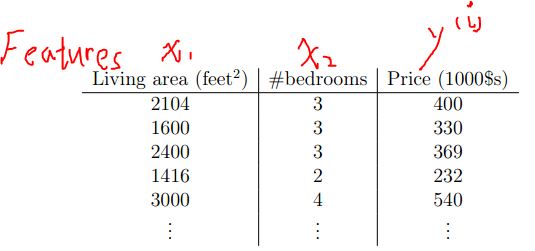

1、example 房价预测

- 训练样本

- 线性回归方程

- 代价函数(最小二乘代价函数)

注意得到代价函数是为了计算参数T的。

2、参数theta的用梯度下降法,两种得到Theta

- LMS algorithm

- the normal equations 正规化等式

Gradient descent

1 LMS Algo

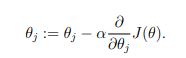

计算参数theta的用梯度下降法

- Batch GD

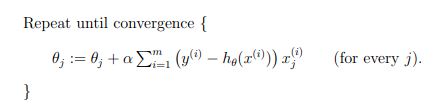

Batch: 每一次计算GD都遍历所有的样本,对于大数据的计算,因为样本非常多,导致计算缓慢。 - Stochastic GD

Stochastic:可以将样本分开计算GD,不用遍历所有的整个样本,对于大数据的计算非常有用,计算快速。

方程:

batch GD

计算的时候,每一次迭代后收敛,得到参数theta,但比较缓慢。最后得到线性回归方程。

Stochastic GD

SGD收敛快,但是最后收敛到最优值的附近区域,虽然快速,但是没有BGD的精确。

【注意】

在计算梯度的时候,迭代是同时进行的:

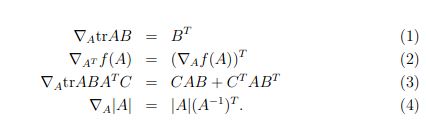

2 The normal equation 正规化方程

矩阵知识,

总结

1 监督学习的一种——线性回归

2 梯度下降

3 计算参数Theta的方法及其证明

4 涉及了一些矩阵的基本知识

感谢Andrew老师的Machine Learning课程

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?