欢迎捧场,上篇我们对什么是爬虫有一个大概的了解,那么我们可以用爬虫来做什么呢?爬虫又是怎么做到的呢?我们一起学习吧。

1.扒个网页压压惊

作为一个知乎的小白用户,平时的任务基本上就是刷刷问题点点赞什么的,今天我们爬一下知乎,应该不会出什么幺蛾子吧。

import urllib.request

resp=urllib.request.urlopen('http://www.zhihu.com')

print(resp.read())

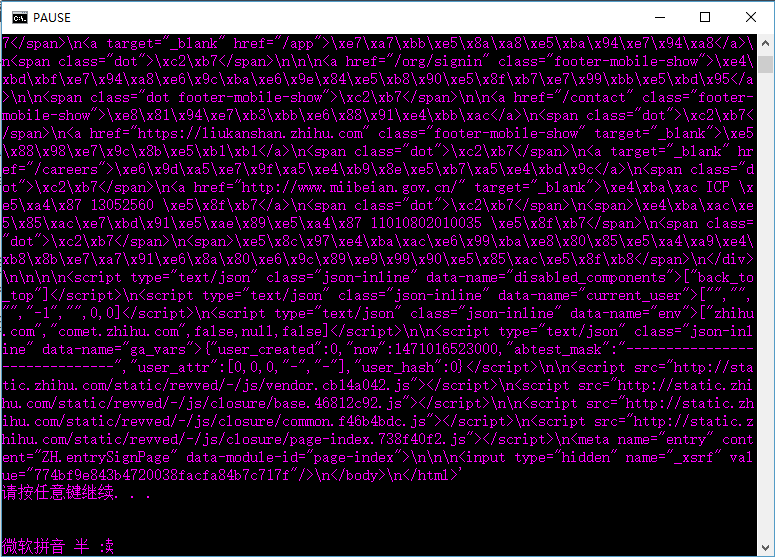

写完了之后运行一下,你就会看见这“三行情书”爬下来的一个知乎首页,三行爬虫。曾经在我找爬虫资料的是看见了不止一个人说自己学习爬虫就是为了“哄妹子”,结果发现,爬虫比妹子好玩。2333,我还是选择妹子。运行结果如下:

一不小心知乎首页的源码就显示在你的终端了,就是这么神奇。

2.三行爬虫代码分析

对于第一行,引用的官方库urllib.request,不解释。

第二行代码,我们调用的是urllib.request库里面的urlopen方法(Python3对urllib库做了整合,你有可能看见Python2.X中的写法

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6472

6472

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?