requests库加BeautifulSoup的技术路线。

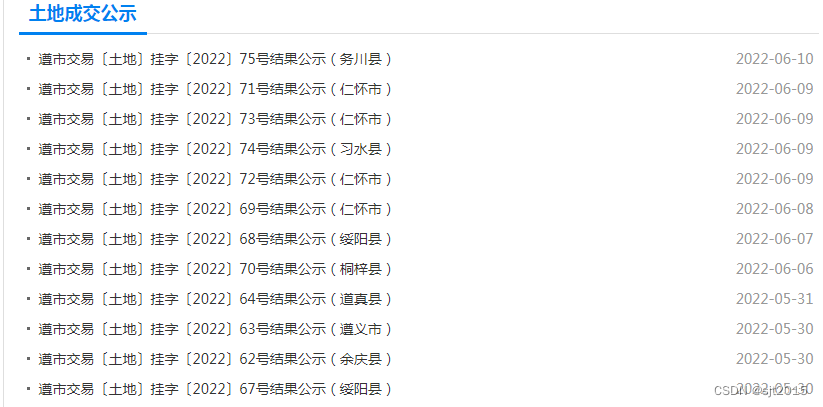

以采集遵义公共资源交易中心土地出让成交公共数据为例。采集的是公告内容的详情页。

import datetime

import numpy as np

import pandas as pd

import requests

from bs4 import BeautifulSoup

def gethttptext(url,head): #获取网页HTML源码,成功返回soup,失败返回空值。

try:

r=requests.get(url,headers=head,timeout=500) #通过get获取url信息,且设定timeout时间为50秒

r.raise_for_status() #如果状态不是200,引发HTTPError异常

r.encoding=r.apparent_encoding #修改编码,解决中文乱码

soup = BeautifulSoup(r.text, ‘lxml’)

return soup

except:

return “”

def getpagedata(soup,url_bt,url_lj): #处理网页HTML代码,获取数据

try:

print(‘----开始采集-----’ + url_files.loc[j][‘标题’])

table_data = soup.find(‘tbody’) #页面中所需数据在标签tbody下,且页面仅有一个tbody,获取第一个标签即为我们需要的标签

trs = table_data.find_all(‘tr’) #查找所有的标签为td的所有内容,返回的类型的列表类型。

data_list = []

df = pd.DataFrame(columns=[‘标题’, ‘标题链接’, ‘序号’, ‘地块编号’, ‘地块位置’, ‘出让面积’, ‘规划用途’, ‘容积率’,

‘建筑密度’, ‘绿地率’, ‘出让年限’, ‘出让方式’, ‘竞得人’, ‘成交价格’, ‘成交时间’])

df1 = df

for tr in trs:

tds = tr.find_all(‘td’)

if len(tds) == 15:

for td in tds:

if td.text != ‘’:

data_list.append(td.text.replace(‘\n’, ‘’))

i = 13

for i in range(13, len(data_list), 13): # range函数13为开始起点,len(data_list)为终点(不含),13为步长

df1 = pd.DataFrame(np.insert(df1.values, len(df1.index), values=[url_bt,url_lj,data_list[i],data_list[i+1],data_list[i+2],

data_list[i+3],data_list[i+4],data_list[i+5],data_list[i+6],

data_list[i+7],data_list[i+8],data_list[i+9],data_list[i+10],

data_list[i+11],data_list[i+12]], axis=0))

df1.columns = df.columns

return df1

except Exception as e:

print(url_files.loc[j][‘标题链接’]+‘采集失败’)

def read_url(filepath):

pdurl=pd.read_excel(filepath,‘Sheet1’,header=0)

return pdurl

if name == ‘main’:

url_files=read_url(r’E:\python_code\zhilianzhaopin-master\newurlz.xlsx’)

j=0

head = {

“User-Agent”: “Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/62.0.3202.94 Safari/537.36”,

‘Accept-Encoding’: ‘gzip, deflate’,

‘Accept-Language’: ‘zh-CN,zh;q=0.9’,

‘Accept’: ‘text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,/;q=0.8’,

‘Upgrade-Insecure-Requests’: ‘1’

}

df_data = pd.DataFrame(columns=['标题', '标题链接', '序号', '地块编号', '地块位置', '出让面积', '规划用途', '容积率', '建筑密度', '绿地率', '出让年限', '出让方式', '竞得人', '成交价格', '成交时间'])

df = df.append(pd.Series([],dtype=‘string’), ignore_index=True)

try:

for j in range(0,len(url_files.index)):

soup=gethttptext(url_files.loc[j]['标题链接'],head)

df_data=df_data.append(getpagedata(soup,url_files.loc[j]['标题'],url_files.loc[j]['标题链接']),ignore_index=True)

except:

print(url_files.loc[j]['标题']+'失败')

df_data.to_csv('pagedata.xlsx')

3161

3161

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?