线性回归中的梯度下降

线性回归函数的形式如下:

hθ=θ0+θ1x1+θ2x2

。

代价函数用方差来表示,被定义为:

J(θ)=12mΣmi=1(θTx(i)−y(i))2

。

式子中的

θ,x(i)

都是向量,

T

表示向量的转置。

不失一般性的情况下,代价函数

在梯度下降算法中,同时更新向量

θ

中的每个元素

θj

。

学习速度

在梯度下降中,更新向量参数

θ

的公式如下:

θj:=θj−α∂∂θjJ(θ)

。

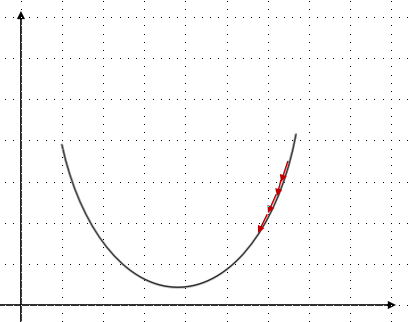

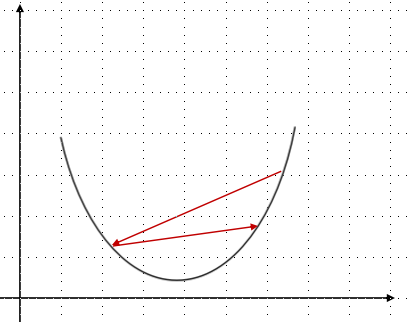

式子中的\alpha就是学习速度,学习速度的值的大小,影响着机器学习模型的收敛与否以及收敛速度。

较小的学习速度示意图。

过大的学习速度示意图。

从图中可以看出,适当的学习速度,有利于机器学习模型的快速收敛。而过大或者过小的学习速度,都不合适。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?