1、现象

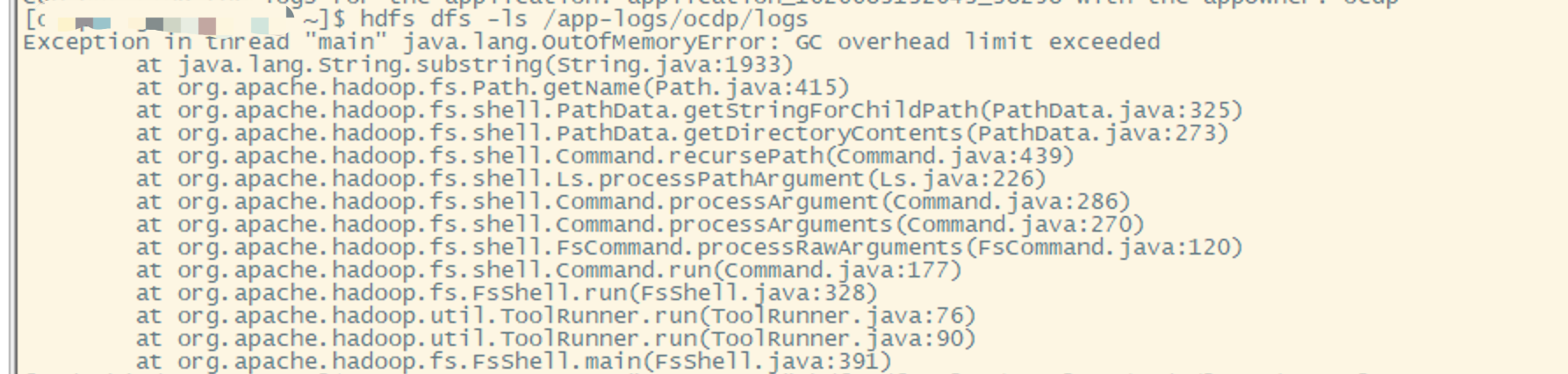

HDFS查询yarn日志目录,报错:Exception in thread “main” java.lang.OutOfMemoryError: GC overhead limit exceeded

2、解决问题

检测发现这个目录下有大量文件,hdfs dfs -ls命令以递归方式搜索目标文件夹中的所有文件,这导致GC OOM错误。

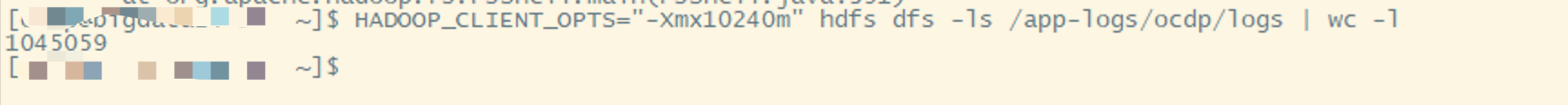

将hdfs客户端的heap大小调大,执行成功:

HADOOP_CLIENT_OPTS="-Xmx10240m" hdfs dfs -ls /app-logs/ocdp/logs | wc -l

HDFS 查询目录报错 OutOfMemoryError: GC overhead limit exceeded

最新推荐文章于 2024-05-14 01:11:44 发布

971

971

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?