思路

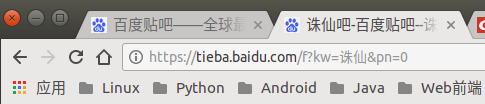

分析百度贴吧URL

发现,不同页面的URL唯一不同的是pn参数的值,每一页递增50。这样URL就搞定了。

编码思路

1. 构造URL

2. 根据URL,使用urllib.request发起网络请求,并获取HTML页面字符串

3. 将HTML页面字符串保存到本地磁盘中

源码

# !/usr/bin/env python

# -*- coding:utf-8 -*-

"""

使用urllib库下载百度贴吧页面

"""

import urllib.request

import urllib.parse

import random

def build_urls():

"""

获取

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?