一、环境配置

1.CDH 5.15.2

2.启动hiveserver2

确认端口号,默认是10000。自行修改的话,使用自己的。

3.Kettle 8.2

下载地址:https://community.hitachivantara.com/docs/DOC-1009855

二、配置Hive插件相关配置

1.下载需要的hadoop jar包(hadoop-common,hadoop-hdfs,hadoop-mapreduce-client-core,hadoop-client)放入…\data-integration\lib目录。

注意:一定需要和hadoop版本对应一致,如果是Apache版本,则下载Apache版本的jar包,否则容易报错异常!

2.下载对应hive jar包,放入:\data-integration\plugins\pentaho-big-data-plugin\hadoop-configurations\hdp26\lib\client

对于cdh,服务器上hive包目录如下,下载对应jar包即可。

/opt/cloudera/parcels/CDH/lib/hive/lib3.下载Hive相关配置文件

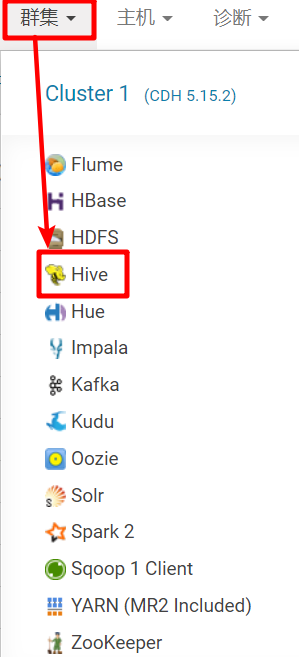

(1)CDH下载配置文件

-》选择hive

-》下载客户端配置文件

(2)将配置文件中下列表的core-site.xml、hdfs-site.xml、hive-site.xml、yarn-site.xml四个配置文件放到data-integration\plugins\pentaho-big-data-plugin\hadoop-configurations\hdp26目录下

4.修改配置文件"data-integration\plugins\pentaho-big-data-plugin\plugin.properties"

这两个文件分别与目录相对应

5.重新启动kettle

三、配置连接hive

1.创建连接

2.配置连接

注意:一般hiveserver2是默认没有用户名和密码的,所以可以默认为空。

3.点击测试(成功~)

四、总结

1.中间出现很多问题,大部分是jar包兼容性问题。解决方法是把对应版本jar包拷贝进去,即可正确连接Hive。

2.从CDH生产环境中拷贝的jar包,不要太多,上面的足够用,多的话容易引起jar包冲突,爆出不确定的错误!

6366

6366

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?