虽然网络上已经有许多搭建的方法。文章也与他们雷同,但是这是我学习的时候搭建的步骤。写下来以供复习。

一.系统环境准备

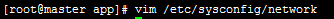

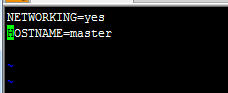

1、修改下主机名为master

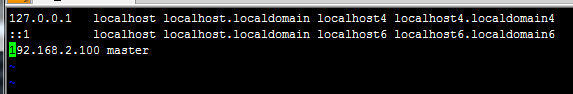

2.修改主机名网络映射

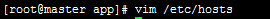

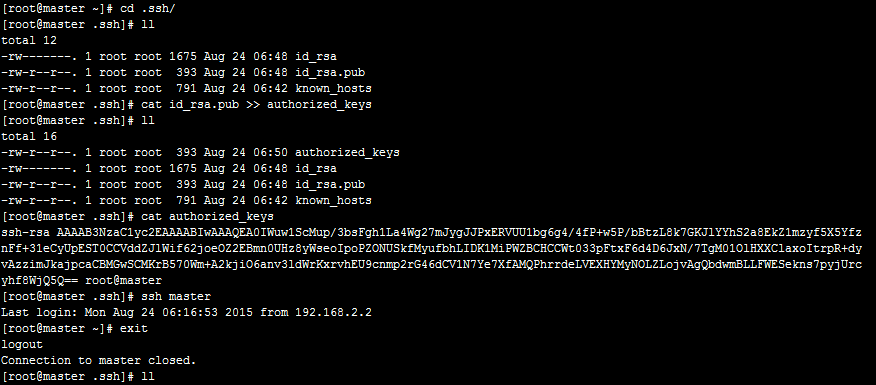

3.配置ssh无密码登录

a.创建密钥对

b.将公钥写入到authorizd_keys文件中

注:这里是为了启动hadoop的时候系统能够无密码登录,因为伪分布式是在模拟三个节点工作。它需要自己登录自己

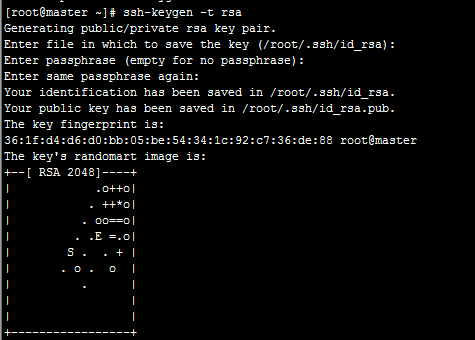

二.搭建集群

1.解压

2.修改配置文件

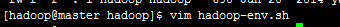

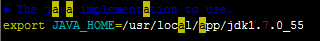

a.修改hadoop-env.sh文件

修改此文件上的Java环境变量

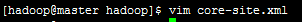

b.修改core-site.xml文件

在文件里添加这些配置

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/app/hadoop-2.4.1/tmp</value>

</property>

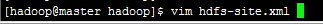

</configuration>c.修改hdfs-site.xml文件

在文件里添加如下配置

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

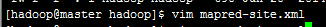

</configuration>d.修改mapred-site.xml文件

添加如下配置

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

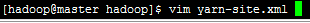

</configuration>e.修改yarn-site.xml文件

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>3.格式化hdfs

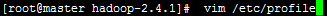

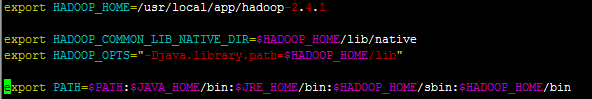

a.改环境变量

export HADOOP_HOME=/usr/local/java/hadoop-2.6.0

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

export PATH=$PATH:$JAVA_HOME/bin:$JRE_HOME/bin:$HADOOP_HOME/sbin:$HADOOP_HOME/binsource /etc/profile 使他生效

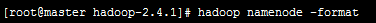

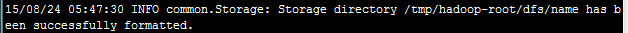

b.格式化namenode

有这句话表示成功

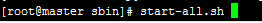

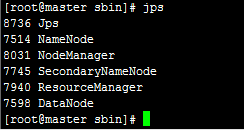

4.启动Hadoop

运行jps命令,如果出现了这几个进程,表示搭建成功

2614

2614

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?