在matlab中,既有各种分类器的训练函数,比如“fitcsvm”,也有图形界面的分类学习工具箱,里面包含SVM、决策树、Knn等各类分类器,使用非常方便。接下来讲讲如何使用。

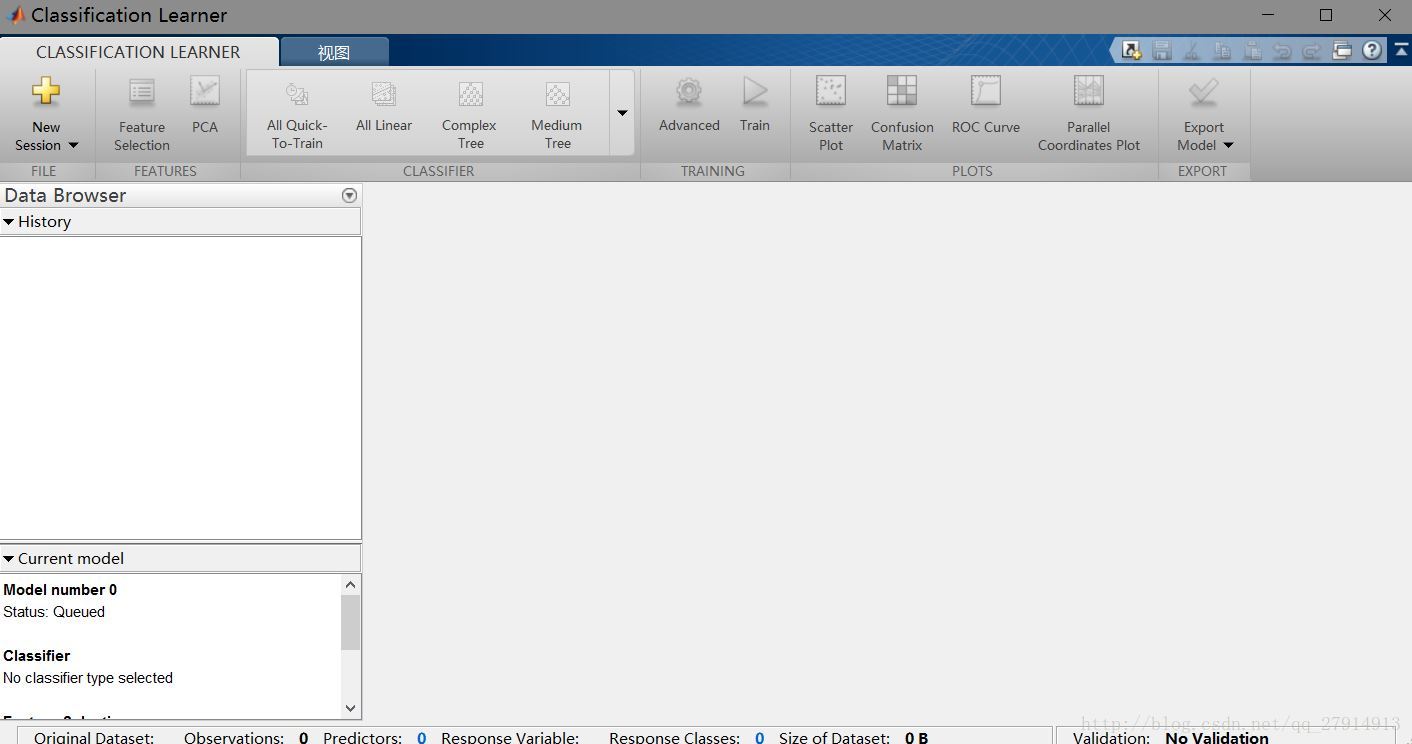

启动:

点击“应用程序”,在面板中找到“Classification Learner”图标点击即启动,也可以在命令行输入“classificationlearner”,回车,也可启动。如下图:

导入数据:

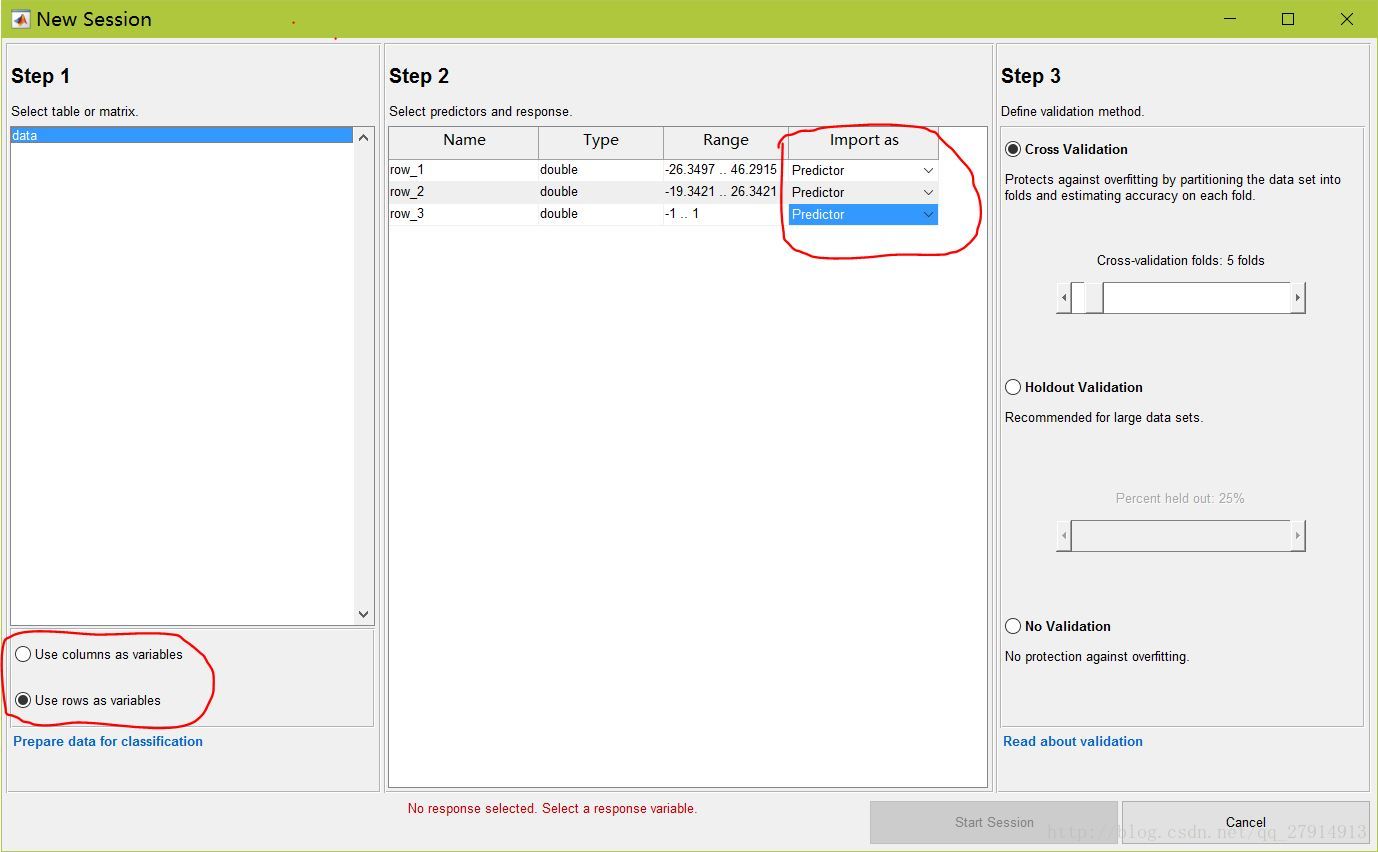

点击“New Session”,可以从工作空间或文件中导入数据。选择数据后,导入分为三步:

第一步,确定你的数据格式,这里导入的数据是一个矩阵,既有样本输入也有对应的输出。比如,我导入的数据data是3*3000的矩阵,3000个样本,每个样本两个特征值,第三行是每个样本对应的输出。这时我应该选择“Use row as variables”,如果数据格式为3000*3,则选择“Use column as variables”。

第二步,指定哪一行为“response”即输出响应,在本数据中,第三行为输出,其余为“predictor”。

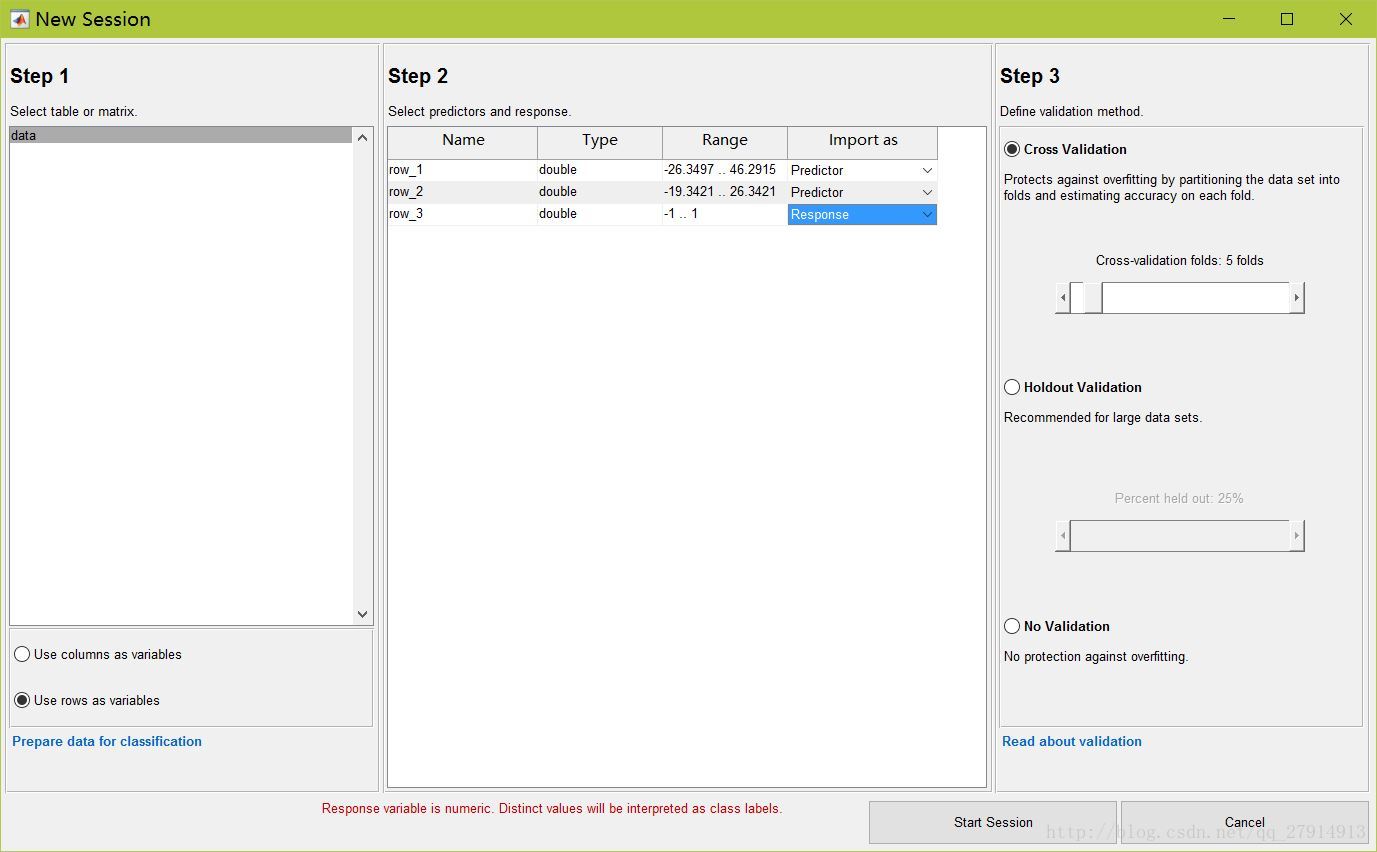

第三步,是否需要验证,一般都选择交叉验证“Cross Validation”,folds表示几次,自己选择即可。

确定后,点击“start session”。

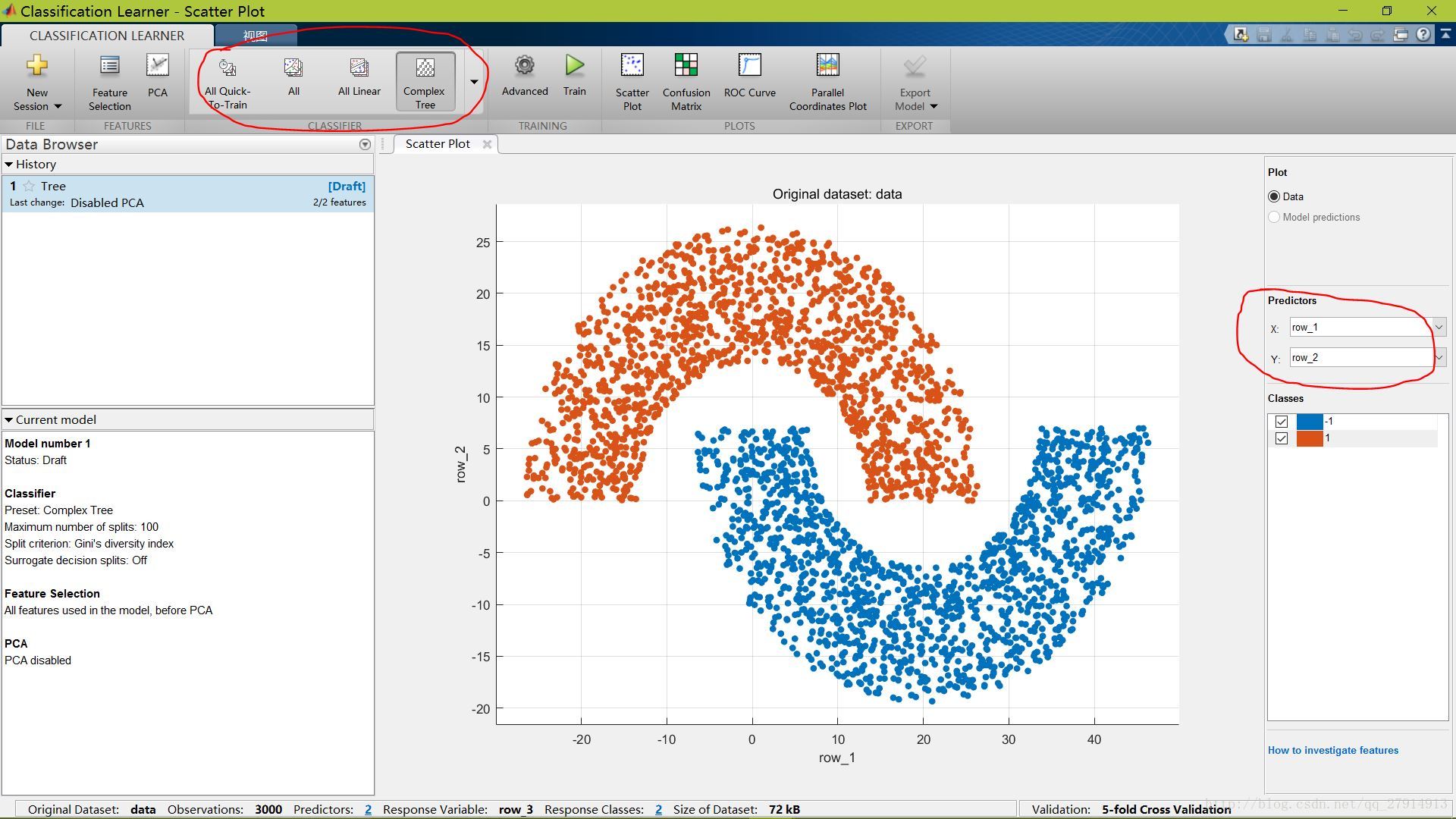

选择分类器:

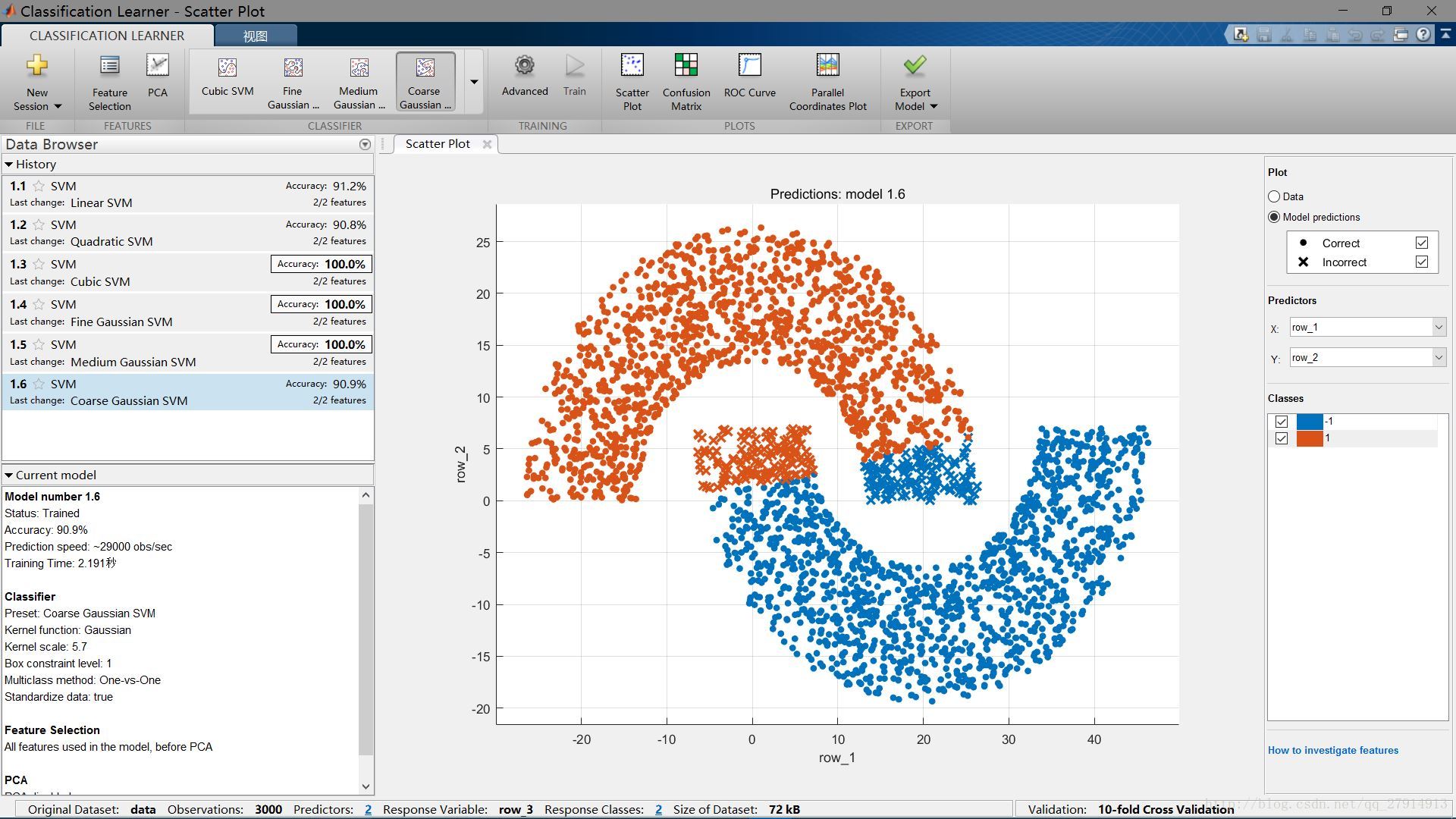

如下图,原始数据的散点图会显示出来,由于这数据只有两维,因此可以全部显示在二维坐标中。如果你的数据多于两维,二维坐标系不能完全显示每一维,你可以在右边红圈的X、Y下拉条中选择显示哪两维。

训练前可以选择训练的模型,点击红圈中的下拉箭头,可以看到各类训练模型,选择一个即可,也可以选择某一类的“ALL”,该类所有模型都会训练一遍。

选好模型后,点击“train”,开始训练。

训练结果:

训练结果显示在左边,每个模型训练后的准确率都会显示出来,最高准确率会被标注,下面即为模型的信息。

点击“Advance”可以设置模型的具体参数。点击“Confusion Matrix”可以查看混淆矩阵等。

点击“Export Model”可以将模型导出到工作空间,这样就可以利用模型来测试新的数据。也可以导出为代码,方便研究。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?