android集成科大讯飞语音听写和语音合成

集成科大讯飞语音听写和语音合成,语音听写只是语音识别下面的一部分,别弄混淆了,由于科大讯飞暂未开放gradle引包方式,所以目前集成还是手动引包。我的流程是点击语音合成按钮然后播放语音,点击语音合成按钮说话然后识别出文字。

1、语音合成:文字转语音

2、语音听写:语音转文字,可以使用原生UI,也可以不使用,区别就是在于两者的监听方法不一样而已。

集成步骤:

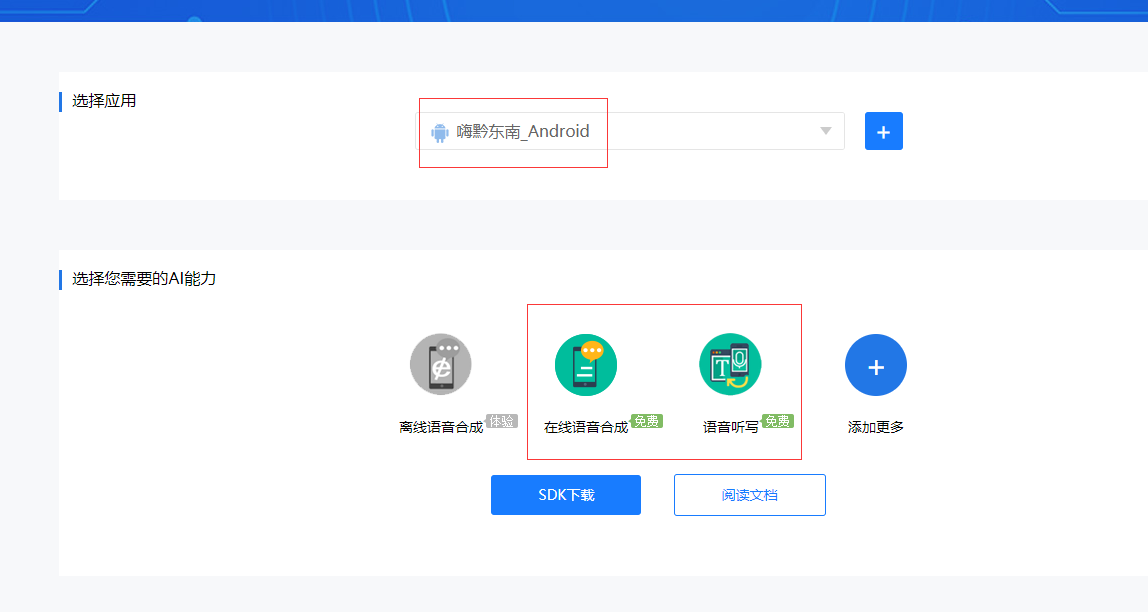

一、下载语音听写和语音合成sdk包(离线语音是要收费的,所以选择在线语言)

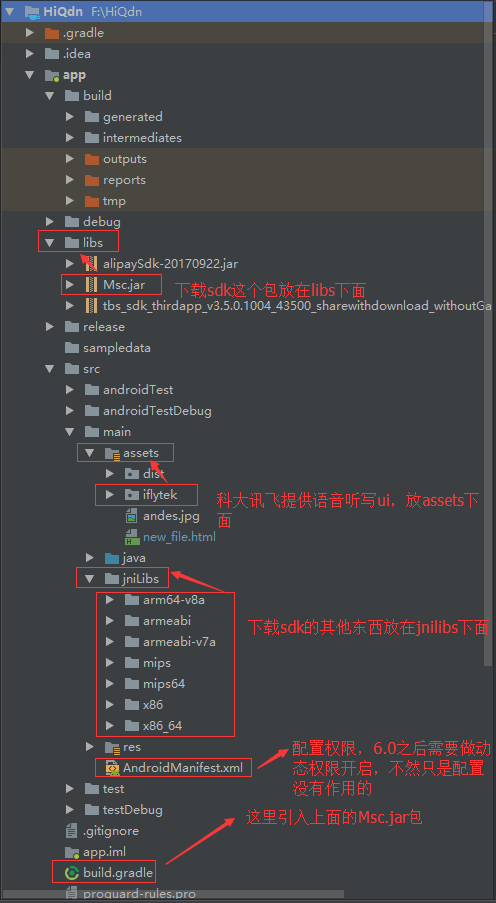

二、sdk引入项目,androidstudio项目目录结构如图所示,我的是webview加载的h5界面发起的语音请求,就算是原生,思路也一样,做好动态权限,不然是没有权限的,如果只是测试那你去手动开启麦克风权限也可以,但是不是科学的办法

1、原libs下面的Msc.jar引入android libs下面

2、iflytek引入assets下面

3、原libs下面的除Msc.jar其他包引入android 的jniLibs下面

4、build.gradle依赖里面加入

//科大讯飞语音包 implementation files('libs/Msc.jar')5、项目目录结构大致如下所示

三、加入权限,6.0之后需要做动态权限,不然只在清单文件里面申请是开启不了权限的。动态权限可以参考http://blog.csdn.net/u013144287/article/details/79298358这篇文章

<!--连接网络权限,用于执行云端语音能力 -->

<uses-permission android:name="android.permission.INTERNET"/>

<!--获取手机录音机使用权限,听写、识别、语义理解需要用到此权限 -->

<uses-permission android:name="android.permission.RECORD_AUDIO"/>

<!--读取网络信息状态 -->

<uses-permission android:name="android.permission.ACCESS_NETWORK_STATE"/>

<!--获取当前wifi状态 -->

<uses-permission android:name="android.permission.ACCESS_WIFI_STATE"/>

<!--允许程序改变网络连接状态 -->

<uses-permission android:name="android.permission.CHANGE_NETWORK_STA

本文介绍了如何在Android项目中集成科大讯飞的语音听写和语音合成功能。由于科大讯飞暂不支持gradle方式导入,因此需要手动引入SDK包。集成步骤包括下载SDK、添加jar和so文件、配置权限、初始化语音配置对象以及实现语音合成和听写的代码。注意,6.0及以上系统需处理动态权限。

本文介绍了如何在Android项目中集成科大讯飞的语音听写和语音合成功能。由于科大讯飞暂不支持gradle方式导入,因此需要手动引入SDK包。集成步骤包括下载SDK、添加jar和so文件、配置权限、初始化语音配置对象以及实现语音合成和听写的代码。注意,6.0及以上系统需处理动态权限。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

715

715

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?