利用HDFS java API增删改查操作

在做这个实验的时候需要特别注意下面三个问题:

1、hdfs安全模式需要关闭命令:./hadoop dfsadmin -safemode leave

2、工程中依赖的版本必须和集群的一致,否则也会报 version不一致错误

3、hadoop集群用户权限的问题,以及各个目录的作用

目前为什么会有这三个问题的原因待查!!!

未验证目前使用hadoop的版本(release-0.20.0)是否支持webhdfs,反正我是怎么都连接不上啊!!!

从这上面看,0.20.0 可能是不支持的

Serengeti Distro:

Apache Hadoop:1.0.1

GreenPlum HD:1.1(Apache Hadoop 1.0.0)

CloudEra: CDH3(Apache Hadoop 0.20.2, WebHDFS is not supported in this version)

Hortonworks: 1.0.7 (Apache Hadoop 1.0.2)

步骤如下:

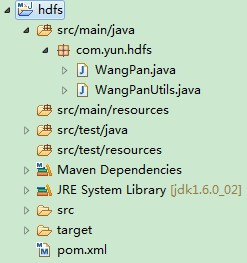

工程结构,如图:

上代码 O(∩_∩)O哈哈~

pom.xml配置如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

|

xsi:schemaLocation=

"http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd"

>

4.0.0

com.yun.hdfs

hdfs

0.0.1-SNAPSHOT

UTF-8

maven-assembly-plugin

false

jar-with-dependencies

com.yun.hdfs.WangPan

make-assembly

package

assembly

org.apache.hadoop

hadoop-core

0.20.2

jar

compile

|

WangPan.java 主方法用于调用:

|

1

2

|

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1625

1625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?