金灿

罗格斯大学

can.jin@rutgers.edu

唐玉瑾

萨卡纳人工智能

yujintang@sakana.ai

彭宏武

康涅狄格大学

hongwu.peng@uconn.edu

迪米特里斯·N·梅塔萨斯

罗格斯大学

dnm@cs.rutgers.edu

张启新

南洋理工大学

qixinzhang1106@gmail.com

车通

英伟达研究

tongc@nvidia.com

摘要

基于大型语言模型(LLM)的多智能体系统(MAS)为解决单智能体系统通常难以管理的复杂现实任务提供了一条有希望的路径。尽管最近在测试时间扩展(TTS)方面的进展显著提高了单智能体在复杂推理任务中的性能,但如何有效地扩展MAS中的协作和推理仍然是一个开放的问题。在这项工作中,我们引入了一个自适应多智能体框架,旨在通过模型级训练和系统级协调来增强协作推理。我们构建了高质量的数据集M500,其中包含500个多智能体协作推理轨迹,并在此数据集上微调Qwen2.5-32B-Instruct以生成M1-32B,这是一个专为多智能体协作优化的模型。为了进一步实现自适应推理,我们提出了一种新的CEO智能体,该智能体动态管理讨论过程,引导智能体协作并调整推理深度以实现更有效的解决问题。在开源MAS中跨多种任务进行评估——包括一般理解、数学推理和编码——我们的系统显著优于强大的基线模型。例如,M1-32B在GPQA-Diamond上实现了12%的改进,在AIME2024上实现了41%的改进,在MBPP-Sanitized上实现了10%的改进,与某些任务上的最先进的模型如DeepSeek-R1匹配性能。这些结果突显了学习协作和自适应协调在扩展多智能体推理中的重要性。代码可在https://github.com/jincan333/MAS-TTS获取。

1 引言

创建能够在真实世界环境中无缝操作并完成复杂任务的智能和自主代理一直是人工智能领域的基础目标(Wooldridge & Jennings, 1995; Minsky, 1988; Bubeck et al., 2023)。LLM的发展(Achiam et al., 2023; Hurst et al., 2024; Liu et al., 2024; Yang et al., 2024a)为此领域开辟了新途径。尽管它们表现出色,但单智能体LLM往往难以处理许多复杂任务中的固有复杂性,这需要使用MAS(Feng et al., 2025; Li et al., 2023)。通过利用多个LLM代理之间的协作互动,MAS可以有效应对各种任务,如数学推理(Chen et al., 2024)、软件开发(Qian et al., 2024)和科学发现(Schmidgall et al., 2025; Lu et al., 2024),推动我们向能够跨各种领域泛化的通用人工智能迈进(Goertzel & Pennachin, 2007; Clune, 2019)。

最近,TTS作为一种有效提升LLM性能的方法出现,特别是在复杂的数学推理任务中(Guo et al., 2025; Snell et al., 2025; Liu

et al., 2025; Muennighoff et al., 2025; Wu et al., 2025; Jin et al., 2024; Wang et al., 2025)。诸如蒙特卡洛树搜索(Gao et al., 2024; Zhang et al., 2024c;a)、大规模强化学习(Guo et al., 2025; OpenAI, 2024; Zeng et al., 2024)和详细推理链的监督微调(Muennighoff et al., 2025; Ye et al., 2025)等技术已被广泛用于促进TTS并改进链式思维(CoT)推理。然而,多智能体系统中协作推理的TTS,即多个具有不同专业知识的智能体协作解决复杂问题,仍然是一个重要且未解决的问题。因此,这项工作探讨了如何有效扩展多智能体协作和推理以提高在广泛复杂任务中的表现。

我们证明,通过在包含数百个多智能体协作推理轨迹的丰富数据集上进行监督微调,可以有效增强LLM的协作推理能力。利用MAS中的微调LLM允许智能体协作的自适应扩展,显著提高在包括一般理解、数学推理和编码在内的复杂任务中的表现。具体来说,

0

\boldsymbol{0}

0 我们首先通过使用开源MAS解决多样且具有挑战性的问题构建了一个高质量的多智能体协作推理数据集。为确保数据集质量并支持长链式思维,我们过滤掉低质量示例,并利用DeepSeek-R1(Guo et al., 2025)生成稳健的推理轨迹。随后,我们在策划的数据集M500上对LLM进行微调,该数据集包含500个详细的多智能体协作推理轨迹。所得模型称为M1-32B,旨在从多专家角度熟练地协作和扩展推理。(2)为进一步优化MAS中的自适应扩展,我们引入了一个由M1-32B驱动的“CEO”智能体,灵感来源于观察到人类社会中无领导群体往往缺乏效率和连贯方向(Cruz et al., 1999; Hackman, 2002)。这个智能体动态引导讨论,有效管理协作努力和推理深度,以提高整个系统的性能。

我们进行了广泛的实验,通过在我们的数据集M500上微调Qwen2.5-32BInstruct(Hui et al., 2024)获得模型M1-32B,并将其集成到AgentVerse(Chen et al., 2024)多智能体框架中来验证我们的方法。跨多种任务类别测试——包括一般理解、数学推理和编码——表明我们的M1-32B在MAS内显著优于基线Qwen2.5-32B-Instruct。例如,我们的方法在GPQA-Diamond(Rein et al., 2024)上实现了12%的改进,在AIME2024(MAA, 2024)上实现了41%的改进,在MBPP-Sanitized(Austin et al., 2021)上实现了10%的改进,在MATH-500和MBPP-Sanitized上达到了与DeepSeek-R1相当的性能。

总结而言,我们的贡献如下:(1)我们开发了一个全面的多智能体协作推理数据集,使用自动生成管道来改善LLM在MAS中的协作和推理;(2)我们训练了M1-32B模型,其表现出强大的协作推理能力;

Θ

\boldsymbol{\Theta}

Θ 我们提出了一种自适应扩展策略,结合由M1-32B驱动的CEO智能体动态引导多智能体协作和推理;以及

0

\boldsymbol{0}

0 我们通过广泛的实验证明,我们的方法显著优于基线模型,并在某些任务上实现了与DeepSeek-R1相当的性能。

2 相关工作

2.1 LLM智能体

近期的研究扩展了LLM的能力,使其不仅限于独立推理和理解,还能够作为多智能体系统的一部分,与环境、工具和其他智能体交互以执行复杂任务(Wu et al., 2023; Li et al., 2023; Chen et al., 2024; Qian et al., 2024; Xu et al., 2025b; a)。这些多智能体系统(MAS)整合了各种技术,包括链式思维提示(Wei et al., 2022)、迭代改进(Shinn et al., 2023)、自我改进(Huang et al., 2023)和外部工具使用(Hao et al., 2023; Qin et al., 2024; Schick et al., 2023),以支持多步骤决策和长期规划。它们已在数学推理(Chen et al., 2024)、软件工程(Qian et al., 2024; Jimenez et al., 2023; Yang et al., 2024b; Wang et al., 2024)和科学发现(Lu et al., 2024; Schmidgall et al., 2025)等领域取得成功应用。智能体框架通常使用诸如

少样本提示(Brown et al., 2020)和引导推理(Wei et al., 2022; Shinn et al., 2023)等技术来结构化与LLM的交互,依赖于模型的情境学习能力(Olsson et al., 2022)。

2.2 测试时间扩展

已经开发了多种方法,通过利用测试时间扩展(TTS)来改进LLM的推理能力。近期的工作探索了包括分层假设搜索的技术,这使得通过结构化探索实现归纳推理(Wang et al., 2023b),以及推理期间的工具增强,这通过允许模型与外部环境交互来提高下游性能(Gao et al., 2023; Qin et al., 2024)。其他方法关注内部机制,例如以无监督方式学习思考令牌(Zelikman et al., 2024; Goyal et al., 2023),使模型能够更好地利用扩展推理序列。在最广泛研究的扩展范式中包括并行和顺序TTS方法。并行方法独立生成多个解决方案候选者,并使用评分标准(如多数投票或基于结果的奖励模型)选择最佳方案(Brown et al., 2024; Irvine et al., 2023; Snell et al., 2025)。相比之下,顺序方法基于先前尝试进行条件设置,允许基于先前输出进行迭代改进(Muennighoff et al., 2025; Snell et al., 2025; Hou et al., 2025; Lee et al., 2025)。连接这些策略的是基于树的技术,如蒙特卡洛树搜索(MCTS)(Zhang et al., 2023; Zhou et al., 2023; Zhang et al., 2024b; Wu et al., 2024)和引导波束搜索(Xie et al., 2023),这些技术通过分支和评估实现结构化探索。许多方法的核心是奖励模型,它为生成提供反馈信号。这些可以分为结果奖励模型,它评估整个解决方案(Xin et al., 2024; Ankner et al., 2024),或过程奖励模型,它评估中间推理步骤(Lightman et al., 2023; Wang et al., 2023a; Wu et al., 2024),引导模型走向更有效的推理路径。

3 方法论

我们首先描述高质量多智能体协作推理数据的自动生成过程。接下来,我们通过对生成的数据进行监督微调来提高LLM在MAS中的协作推理能力。最后,我们将CEO智能体引入MAS框架,通过指导协作和调整资源配置进一步实现自适应扩展。

3.1 多智能体协作推理数据的自动生成

基于难度、多样性和跨学科性的题目采样。在为我们的多智能体协作推理数据集选择题目时,我们考虑三个方面:(1)难度,(2)多样性,(3)跨学科性。我们从Simple-Scaling(Muennighoff et al., 2025)的完整数据集开始,其中包括来自历史AIME问题、OlympicArena(Huang et al., 2024)和AGIEval(Zhong et al., 2024)等多个来源的多样化问题。这些问题涵盖物理、几何、数论、生物和天文学等各种领域。为确保难度和跨学科性,我们使用DeepSeek-R1(Guo et al., 2025)来确定解决每个问题是否需要跨学科知识,排除那些DeepSeek-R1用少于1024个标记回答的问题。通过此过程选出的问题通常具有挑战性,需要从多个学科整合知识。例如,解决一个复杂的数学问题可能受益于代数和几何专家的合作,而解决一个高级的天文学问题可能需要天文学家、物理学家和数学家的输入。

生成多智能体协作推理轨迹。为了生成协作推理轨迹,我们使用开源MAS框架和推理模型,特别是AgentVerse(Chen et al., 2024)和DeepSeek-R1(Guo et al., 2025),处理之前选定的问题。这个MAS框架涉及多个角色:专家招聘者(例如,人力资源)、问题解决者(例如,科学家和工程师)、执行者(例如,质量保证工程师)和评估者(例如,产品经理)。智能体以以下方式协作:

多智能体协作推理轨迹

专家招聘者

提示:您正在带领一组专家解决以下问题:… 找出不超过

x

2

100

\frac{x^{2}}{100}

100x2的最大整数。招募两名具有不同专长的专家来最好地解决问题…

响应:

<

<

< 思考

>

>

>… 我需要识别最适合这个几何任务的专家…

<

/

</

</ 思考

>

1

>1

>1. 几何分析专家。2. 代数建模专家。

问题解决者1(几何专家)

提示:… 准确解决以下问题:梯形的一个底边比另一个底边长100单位… 找出不超过

x

2

/

100

x^{2} / 100

x2/100的最大整数…

响应:

<

<

< 思考

>

>

>… 让我们理解结构:该段将面积按2:3比例分割。我们需要长度

x

x

x,使得两半都有相等面积… </思考>… 使用RMS找到

x

x

x,我们得到:

x 2 100 = 18125 100 = 181.25 ⇒ 181 \frac{x^{2}}{100}=\frac{18125}{100}=181.25 \Rightarrow 181 100x2=10018125=181.25⇒181

问题解决者2(代数专家)

提示:… 根据之前的解决方案,批评其正确性。不要重新求解。如果同意最终答案,请添加[同意]…

响应:<思考> … 审查解决方案:答案正确。但是,解释使用RMS的理由可以更清楚… </思考>… 推理合理且步骤准确。[同意]

评估者

提示:您是一位经验丰富的科学教师。评估两位解决者的最终解决方案的正确性…

响应:<思考> … 让我验证每一步。是的,使用RMS和计算都合适… </思考>… 正确性:1 …

图1:M500中的一个多智能体协作推理数据样本的插图。

按照这种方式:专家招聘者识别并分配适合任务的专家,总智能体数量固定且独立于问题复杂度或可用信息。这些被招聘的专家作为问题解决者,通过多轮讨论提出并迭代改进解决方案,预设的批评迭代次数。一旦达成共识——或如果达到最大批评迭代次数——则将结果解决方案传递给执行者,如果需要,执行者运行必要的代码或调用外部工具。然后,评估者审查解决方案和执行者产生的结果,提供潜在改进的反馈。这一迭代过程持续进行,直到解决方案被评估为正确或达到预定义的总迭代次数。每个MAS角色产生不同的输入和输出,从其专家视角生成推理轨迹。我们收集每个智能体的所有输入-输出对,并将整个协作推理历史编译成针对相应问题的综合轨迹。

数据过滤。为确保高质量的协作推理轨迹,我们根据三个标准过滤数据:(1)达成共识:未能在最大允许批评迭代次数内达成共识的轨迹被丢弃。此标准确保有效讨论收敛并最小化未解决的推理。(2)格式合规:不符合要求格式的样本被排除。具体而言,每个智能体的推理必须包含在<思考>和</思考>标签内,最终答案必须封装在方框中。这保持输出一致性并便于自动化解析和答案提取。(3)正确性:我们从每个协作轨迹中提取最终答案,并与基准解决方案进行比较,丢弃任何答案错误的轨迹。

通过这种方法,我们迭代采样500个问题及其相应的多智能体协作推理轨迹,形成M500数据集。该数据集包含500个需要跨学科协作的具有挑战性和多样性的问题,伴随详尽和高质量的推理轨迹,记录完整的多智能体问题解决过程。有关此采样程序的伪代码在附录中的算法1中提供。

图1展示了M500中的一个说明性示例,完整数据样本在附录中的图7中呈现。该协作推理轨迹包括

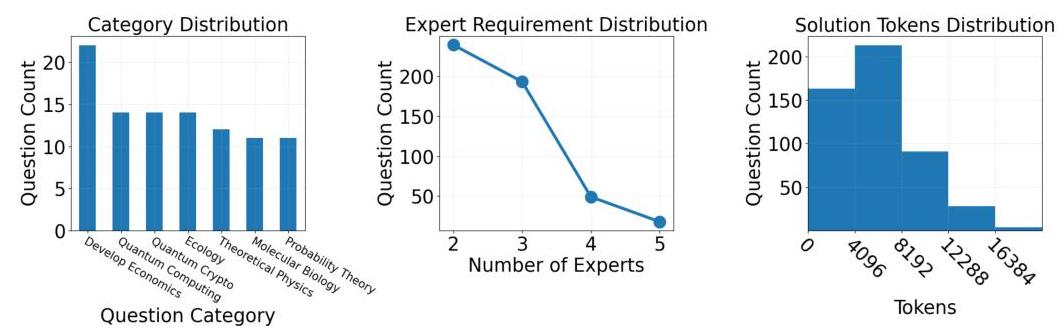

图2:M500中关键统计分布:问题类别(过滤计数>10),预测解决每个问题所需的专家人数,以及解决方案标记使用。

四个智能体之间的输入-输出交互:专家招聘者、几何专家、代数专家和评估者。示例问题是足够具有挑战性的(需要5695个标记),达成智能体间的共识,符合所需格式,并产生正确的解决方案。此外,M500数据集中问题类别的分布、预测专家人数和解决方案标记使用在图2中展示。我们观察到该数据集在经济学、物理学、生物学和数学等领域具有显著多样性。大多数问题被预测可以通过两名专家最优解决,并且需要少于8192个标记的解决方案。

3.2 通过监督微调增强LLM协作推理

受Simple-Scaling(Muennighoff et al., 2025)启发,该研究表明通过在详细推理轨迹上进行监督微调(SFT)可以发展LLM的长链式思维推理能力,我们使用M500数据集对LLM f f f 进行SFT。目标是使 f f f能够在MAS中产生有助于协作的长链式思维。具体而言,SFT目标是最小化:

L S F T = E ( x , y ) ∈ M 500 [ − 1 ∣ y ∣ ∑ t = 1 ∣ y ∣ log P f ( y t ∣ x , y < t ) ] \mathcal{L}_{\mathrm{SFT}}=\mathbb{E}_{(\mathbf{x}, \mathbf{y}) \in \mathrm{M} 500}\left[-\frac{1}{|\mathbf{y}|} \sum_{t=1}^{|\mathbf{y}|} \log P_{f}\left(\mathbf{y}_{t} \mid \mathbf{x}, \mathbf{y}<t\right)\right] LSFT=E(x,y)∈M500 −∣y∣1t=1∑∣y∣logPf(yt∣x,y<t)

其中

P

f

(

y

t

∣

x

,

y

<

t

)

P_{f}\left(\mathbf{y}_{t} \mid \mathbf{x}, \mathbf{y}<t\right)

Pf(yt∣x,y<t)表示模型

f

f

f在给定输入

x

\mathbf{x}

x和先前标记

y

<

t

\mathbf{y}<t

y<t的情况下分配给标记

y

t

\mathbf{y}_{t}

yt的概率。

对于M500数据集中的每个问题

q

q

q,我们有一系列输入-输出对

{

(

x

i

,

y

i

)

}

i

=

1

n

\left\{\left(\mathbf{x}_{i}, \mathbf{y}_{i}\right)\right\}_{i=1}^{n}

{(xi,yi)}i=1n,对应于所有参与智能体的推理轨迹。在训练过程中,我们确保

q

,

{

(

x

i

,

y

i

)

}

i

=

1

n

q,\left\{\left(\mathbf{x}_{i}, \mathbf{y}_{i}\right)\right\}_{i=1}^{n}

q,{(xi,yi)}i=1n的所有推理轨迹被分组在同一批次内,并根据MAS中原始生成顺序排列。这种方法帮助模型以连贯和逻辑的方式学习协作推理。

3.3 自适应测试时间扩展

最近,TTS作为一种有效提升LLM性能的方法出现。像OpenAI的o系列和DeepSeek-R1这样的模型通过在推理期间采用扩展推理显示了显著改进。然而,TTS在MAS中的应用仍相对较少探索。以往关于单智能体场景的研究表明,最优的TTS策略取决于问题难度(Liu et al., 2025; Wu et al., 2025)。在MAS中,选择适当的TTS策略更为关键,因为协作相较于单智能体涉及显著更高的计算和时间成本。

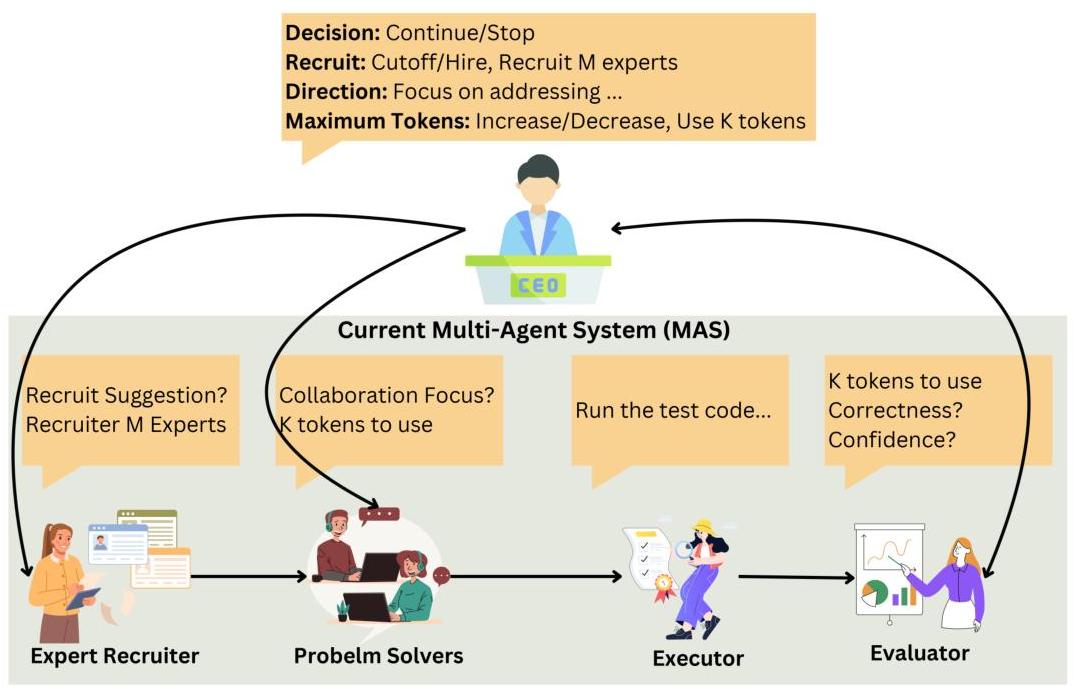

为解决此问题,我们通过引入专门的“CEO”智能体提出一种适用于MAS的自适应TTS策略,该智能体根据给定任务的进展情况动态管理协作和资源分配。如图3所示,CEO智能体评估问题、当前解决方案状态、评估反馈和可用资源,以确定是否接受提议的解决方案或需要进一步改进。此外,该智能体指导后续讨论,决定涉及多少智能体,并设定适当的推理深度,即每个智能体响应的标记预算。

图3:将CEO智能体集成到现有MAS中的概述,使用AgentVerse(Chen et al., 2024)作为示例。CEO智能体通过调整智能体数量、终止条件和推理深度来自适应扩展协作和推理。

与具有固定智能体数量、迭代限制和推理深度的静态MAS配置不同,我们的自适应方法允许MAS根据问题的演变复杂性和需求动态调整其设置。这种能力通过修改智能体参与、终止条件和推理深度来更有效地扩展协作推理。

4 实验

为了验证我们的系统——包括微调模型及其集成的CEO——能否有效增强MAS中的协作和推理,我们在AgentVerse上使用最先进的(SOTA)开源和闭源LLM跨一般理解、数学推理和编码任务进行实验。还进行了额外的研究以调查我们方法的新兴行为和扩展性能。

4.1 实验细节

LLM。我们评估了面向推理和非推理的LLM,以充分了解协作和推理在MAS中的影响。主要基线包括Qwen2.5-32B-Instruct(简写为Qwen2.5)(Hui et al., 2024)和s1.1-32B(Muennighoff et al., 2025)。M1-32B和s1.1-32B均从Qwen2.5微调而来;s1.1-32B还利用Simple-Scaling(Muennighoff et al., 2025)中的问题,使用DeepSeek-R1推理轨迹在单智能体设置下进行。我们还包括DeepSeek-V3(Liu et al., 2024)和DeepSeekR1(Guo et al., 2025)作为强大的开源基线。对于闭源模型,我们使用o3-mini(中型)(OpenAI, 2025)和GPT-4o(GPT-4o-2024-08-06)(Hurst et al., 2024)。

任务。为进行全面评估,我们专注于三个关键领域:一般理解:我们使用GPQA-Diamond(简写为GPQA)(Rein et al., 2024)评估一般知识,并使用Commongen-Challenge(简写为Commongen)(Madaan et al., 2023)评估句子写作和响应可读性。GPQA-Diamond包含198个来自生物学、化学和物理学的博士水平科学问题。我们报告零样本正确回答问题的百分比。在Commongen-Challenge中,

| 模型 | 一般理解 | 数学推理 | 编码 | |||

|---|---|---|---|---|---|---|

| GPQA | Commongen | AIME2024 | MATH-500 | HumanEval | MBPP-S | |

| 非推理模型 | ||||||

| Qwen2.5 | 50.2 | 96.7 | 21.1 | 84.4 | 89.0 | 80.2 |

| DeepSeek-V3 | 58.6 | 98.6 | 33.3 | 88.6 | 89.6 | 83.9 |

| GPT-40 | 49.2 | 97.8 | 7.8 | 81.3 | 90.9 | 85.4 |

| 推理模型 | ||||||

| s1.1-32B | 58.3 | 94.1 | 53.3 | 90.6 | 82.3 | 77.4 |

| DeepSeek-R1 | 75.5 | 97.2 | 78.9 | 96.2 | 98.2 | 91.7 |

| o3-mini | 71.3 | 99.1 | 84.4 | 95.3 | 97.0 | 93.6 |

| M1-32B(我们的) | 61.1 | 96.9 | 60.0 | 95.1 | 92.8 | 89.1 |

| M1-32B w. CEO(我们的) | 62.1 | 97.4 | 62.2 | 95.8 | 93.9 | 90.5 |

表1:在AgentVerse框架内使用强大推理和非推理模型进行一般理解、数学推理和编码任务的性能比较。我们的方法在所有任务上相对于Qwen2.5和s1.1-32B实现了显著改进,并在MATH-500和MBPP-S上达到了与o3-mini和DeepSeek-R1相当的性能,证明了其在增强MAS协作推理方面的有效性。

智能体需要使用尽可能多的20个给定概念生成连贯且语法正确的段落。基准测试包括200个概念列表,我们报告覆盖概念的平均百分比。(2)数学推理:我们在两个广泛使用的具有挑战性的数学基准测试中进行评估:AIME2024(MAA, 2024)和MATH500(Hendrycks et al., 2021)。AIME2024包括2024年美国邀请数学考试(AIME)中的30个问题,而MATH-500是一个精心策划的竞争级别数学问题基准,难度各异。报告零样本准确性,即正确解决问题的百分比。(3)编码:我们使用HumanEval(Chen et al., 2021)和MBPP-Sanitized(简写为MBPP-S)(Austin et al., 2021)评估代码生成能力。HumanEval包括164个Python编程问题,旨在测试从自然语言规范生成功能正确代码的能力。MBPP-Sanitized包含257个入门级Python编程问题,涵盖了广泛的算法和功能挑战。对于这两个基准测试,我们报告零样本Pass@1准确性。

训练和评估。我们使用M500数据集对Qwen2.5进行5个epoch的SFT,学习率为1e-5,得到了我们的模型M1-32B。训练在8个NVIDIA A100 GPU上进行,使用FlashAttention(Dao, 2024)和DeepSpeed(Rasley et al., 2020)在LLaMA-Factory框架(Zheng et al., 2024)内进行。评估使用开源MAS AgentVerse进行,MAS的默认智能体总数为5,批评迭代次数为3,总迭代次数为2。MAS生成的最终响应用于评估。所有主要结果取三次运行的平均值。数学推理任务中所有智能体使用的提示在附录B中详细列出,以便重现,其他任务的提示可在随附代码中找到。

4.2 主要结果

表1展示了我们方法和基线模型在一般理解、数学推理和编码任务上的实验结果。从这些结果中可以得出几个关键发现:

- 我们提出的方法在所有评估任务上相对于Qwen2.5实现了显著性能改进,证明了集成M1-32B和CEO智能体能有效增强MAS中的一般问题回答、写作、数学推理和编码能力。具体而言,与Qwen2.5相比,M1-32B w. CEO在GPQA、AIME2024、MATH500和MBPP-S上分别提高了 12 % 12 \% 12%、 41 % 41 \% 41%、 11 % 11 \% 11%和 10 % 10 \% 10%。此外,我们的方法在MATH-500和MBPP-S上达到了与最先进的开源和闭源模型相当的性能,强调了其在增强MAS协作推理方面的有效性。

-

Aha Moment in MAS

问题

设

A

B

C

A B C

ABC为圆

ω

\omega

ω内接三角形。

ω

\omega

ω在

B

B

B和

C

C

C处的切线交于点

D

D

D,

A

D

‾

\overline{A D}

AD再次交

ω

\omega

ω于

P

P

P。若

A

B

=

5

,

B

C

=

9

A B=5, B C=9

AB=5,BC=9, 和

A

C

=

10

,

A

P

A C=10, A P

AC=10,AP可以写成

m

n

\frac{m}{n}

nm的最低形式。求

m

+

n

m+n

m+n。

问题解决者

… 将 B = ( 0 , 0 ) , C = ( 9 , 0 ) B=(0,0), C=(9,0) B=(0,0),C=(9,0)放置,计算 D D D的幂: D B 2 = ( 225 22 ) 2 D B^{2}=\left(\frac{225}{22}\right)^{2} DB2=(22225)2。使用点的幂法则: D A ⋅ D P = D B 2 D A \cdot D P=D B^{2} DA⋅DP=DB2,解得 D P D P DP,然后计算 A P = D P − D A A P=D P-D A AP=DP−DA。最终结果: A P = 22 1 ⇒ m + n = 23 A P=\frac{22}{1} \Rightarrow m+n=\boxed{23} AP=122⇒m+n=23。

CEO

< < < 思考 > > >…等等,让我们看看解决方案做了什么。他们说 D A = 225 22 , D B 2 = ( 225 22 ) 2 D A=\frac{225}{22}, D B^{2}=\left(\frac{225}{22}\right)^{2} DA=22225,DB2=(22225)2。那么:

D P = ( 225 / 22 ) 2 325 / 22 , A P = D P − D A = 2025 286 325 22 = − 1100 143 D P=\frac{(225 / 22)^{2}}{325 / 22}, \quad A P=D P-D A=\frac{2025}{286} \quad \frac{325}{22}=\frac{-1100}{143} DP=325/22(225/22)2,AP=DP−DA=286202522325=143−1100

但长度不能为负,这表明符号假设错误。这表明

P

P

P的位置假设不正确。也许

P

P

P位于

D

D

D和

A

A

A之间。所以

A

P

=

1100

143

=

325

22

≈

7.6923

A P=\frac{1100}{143}=\frac{325}{22} \approx 7.6923

AP=1431100=22325≈7.6923

解决方案说

A

P

=

22

A P=22

AP=22。那是不可能的。正确值是

A

P

=

100

143

A P=\frac{100}{143}

AP=143100,因此

m

+

n

=

113

…

<

/

m+n=\boxed{113} \ldots</

m+n=113…</ 思考

>

>

>

### 决策:继续

### 招募人数:2

### 方向:1) 验证点的应用 2) 重新检查几何配置 …

### 最大标记:8192

问题解决者

… 点

D

D

D的功率计算:

D

A

⋅

D

P

=

D

B

2

D A \cdot D P=D B^{2}

DA⋅DP=DB2

其中:

D

A

=

225

22

D A=\frac{225}{22}

DA=22225(从

D

D

D到

A

A

A的距离),

D

B

=

225

22

D B=\frac{225}{22}

DB=22225(从

D

D

D到圆的切线长度)。解得

D

P

D P

DP :

D P = D B 2 D A = ( 225 22 ) 2 225 22 = 2025 286 D P=\frac{D B^{2}}{D A}=\frac{\left(\frac{225}{22}\right)^{2}}{\frac{225}{22}}=\frac{2025}{286} DP=DADB2=22225(22225)2=2862025

关键几何关系:点

P

P

P位于

D

D

D和

A

A

A之间,所以:

A

P

=

D

A

−

D

P

=

225

22

−

2025

286

=

100

143

A P=D A-D P=\frac{225}{22}-\frac{2025}{286}=\frac{100}{143}

AP=DA−DP=22225−2862025=143100

最终结果:

A

P

=

100

143

⇒

m

+

n

=

113

A P=\frac{100}{143} \Rightarrow m+n=\boxed{113}

AP=143100⇒m+n=113

图4:MAS中的“aha”时刻,CEO智能体主动验证并纠正问题解决者提供的解决方案。发现问题后,CEO建议一种修正方法,问题解决者随后将其纳入修订后的解决方案。

模型,如DeepSeek-R1和o3-mini,在MATH-500、Commongen和MBPP-S上,突出了我们方法的有效性。

- 我们的方法显著增强了MAS中的协作推理,与Simple-Scaling(Muennighoff et al., 2025)相比。例如,带有CEO的M1-32B在GPQA和AIME2024上分别比s1.1-32B高出 4 % 4 \% 4%和 9 % 9 \% 9%。此外,与Qwen2.5相比,s1.1-32B在编码任务上经历了性能退化,这可能是由于Simple-Scaling数据集中编码示例有限。相比之下,我们的方法显著提升了编码性能,突显了其相对于Simple-Scaling的优势。M1-32B和s1.1-32B均在从Simple-Scaling数据集中衍生的样本上训练;因此,观察到的改进表明,多智能体协作推理轨迹比单智能体推理轨迹更能有效提升LLM在MAS中的能力。

-

- 引入CEO智能体始终提升了M132B在所有任务中的性能,强调了在CEO智能体指导下有效扩展MAS中协作推理的重要性。

4.3 MAS中的“aha”时刻

在MAS中,我们观察到当使用M1-32B时,智能体有时会展现出积极贡献于验证和改进协作过程的新兴行为,即使这不是明确要求的。例如,如图4所示,问题解决者最初未能识别其解决方案中的错误。在审查该解决方案后,CEO智能体主动检查其有效性并识别问题解决者的错误,指出这导致了线段的负长度。然后CEO智能体提出了一种替代且正确的

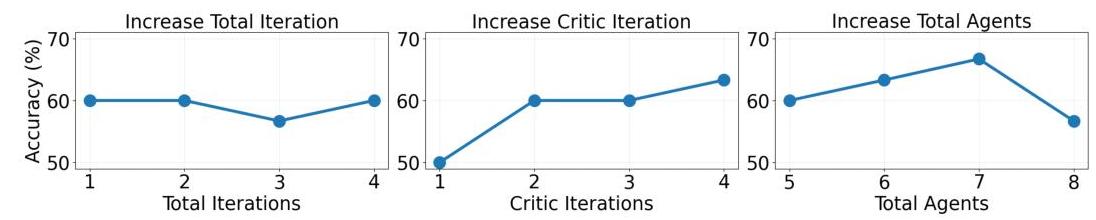

图5:使用M1-32B通过增加总迭代、批评迭代和MAS中涉及的总智能体数量来扩展AgentVerse中的协作。

解决方案,促使问题解决者相应地修订其原始响应。这种协作互动,其中一个智能体通过验证解决方案、探索替代方法和提出更正来帮助其他智能体,即使其他智能体不知道自己的错误时也会发生。这种新兴行为的合理原因是CEO智能体经过多智能体协作推理轨迹训练,并观察其他智能体的讨论后,基于从其他智能体推理中学到的协作模式和见解主动验证和更正解决方案。

4.4 额外调查

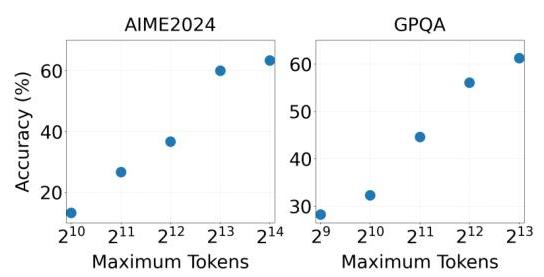

扩展MAS中的协作和推理。我们通过系统调整总迭代次数、批评迭代次数、总智能体数量和最大标记限制来调查扩展协作和推理对M1-32B在MAS中的性能影响。结果如图5和图6所示。我们的观察如下:1 增加问题解决者之间的互动以增强协作显著提高了性能。这可以通过提高批评迭代限制以允许更广泛的讨论达成共识或增加问题解决者的总数量来实现。然而,涉及过多的问题解决者可能会因智能体间讨论分散而降低性能。此外,仅仅增加总迭代次数并不能提高MAS性能。2 通过增加每个智能体允许的最大标记数来增强推理能力,可以有效提高MAS性能。此外,最佳标记限制因任务而异;例如,16384标记在AIME2024上产生最佳结果,而8192标记对于GPQA已足够。这一发现支持了我们使用CEO智能体根据特定任务要求动态管理标记分配的动机。

图6:使用M1-32B通过控制最大标记使用量来扩展AgentVerse中的推理。

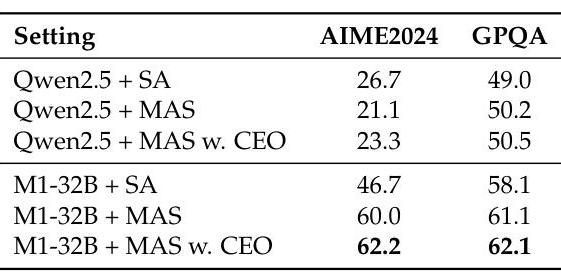

表2:Qwen2.5和M1-32B作为单智能体(SA)、在AgentVerse(MAS)内以及在带CEO的MAS内的性能比较。

M1-32B作为单智能体的性能。我们进一步调查了在MAS中使用M1-32B相对于其作为单智能体使用的性能改进。结果总结在表2中。我们观察到在MAS中使用M1-32B显著提高了性能。相比之下,在MAS中使用Qwen2.5仅在单智能体设置上带来了较小的改进,进一步证明了我们提出方法在增强MAS性能方面的有效性。

5 结论

在本文中,我们介绍了一种自适应TTS方法,以增强多智能体协作推理能力。我们通过自动生成过程构建了M500数据集,特别

是在多智能体协作推理任务中使用的,并在该数据集上微调了Qwen2.5-32BInstruct模型,从而得到了专为MAS协作推理优化的M1-32B模型。此外,我们提出了一种CEO智能体,旨在自适应地管理协作和推理资源,进一步提升M1-32B在MAS中的性能。广泛的实验结果表明,我们的方法显著超越了Qwen2.5-32B-Instruct和s1.1-32B模型在MAS中的表现。

6 可重复性声明

作者们做出了广泛的努力以确保本文结果的可重复性。首先,在第4.1节中清楚描述并详细说明了实验设置,包括训练配置、评估协议和模型设置。其次,数学推理任务的提示在附录B中详细列出,以便清晰和可重复。第三,M500数据集、所有任务的所有智能体提示、其他配置以及完整的代码库包含在补充材料中,以促进完全可重复性和未来研究。

参考文献

Josh Achiam, Steven Adler, Sandhini Agarwal, Lama Ahmad, Ilge Akkaya, Florencia Leoni Aleman, Diogo Almeida, Janko Altenschmidt, Sam Altman, Shyamal Anadkat, et al. Gpt-4技术报告。arXiv预印本arXiv:2303.08774, 2023.

Zachary Ankner, Mansheej Paul, Brandon Cui, Jonathan D Chang, 和Prithviraj Ammanabrolu. 大声批评奖励模型。arXiv预印本arXiv:2408.11791, 2024.

Jacob Austin, Augustus Odena, Maxwell Nye, Maarten Bosma, Henryk Michalewski, David Dohan, Ellen Jiang, Carrie Cai, Michael Terry, Quoc Le, et al. 使用大型语言模型进行程序合成。arXiv预印本arXiv:2108.07732, 2021.

Bradley Brown, Jordan Juravsky, Ryan Ehrlich, Ronald Clark, Quoc V Le, Christopher Ré, 和Azalia Mirhoseini. 大型语言猴子:通过重复采样扩展推理计算。arXiv预印本arXiv:2407.21787, 2024.

Tom Brown, Benjamin Mann, Nick Ryder, Melanie Subbiah, Jared D Kaplan, Prafulla Dhariwal, Arvind Neelakantan, Pranav Shyam, Girish Sastry, Amanda Askell, et al. 语言模型是少量样本学习者。神经信息处理系统进展, 33:1877-1901, 2020.

Sébastien Bubeck, Varun Chandrasekaran, Ronen Eldan, Johannes Gehrke, Eric Horvitz, Ece Kamar, Peter Lee, Yin Tat Lee, Yuanzhi Li, Scott M. Lundberg, Harsha Nori, Hamid Palangi, Marco Túlio Ribeiro, 和Yi Zhang. 人工通用智能的火花:GPT-4早期实验。CoRR, abs/2303.12712, 2023. doi: 10.48550/arXiv.2303.12712. URL https://doi.org/10.48550/arXiv.2303.12712.

Mark Chen, Jerry Tworek, Heewoo Jun, Qiming Yuan, Henrique Ponde De Oliveira Pinto, Jared Kaplan, Harri Edwards, Yuri Burda, Nicholas Joseph, Greg Brockman, et al. 评估训练于代码的大规模语言模型。arXiv预印本arXiv:2107.03374, 2021.

Weize Chen, Yusheng Su, Jingwei Zuo, Cheng Yang, Chenfei Yuan, Chi-Min Chan, Heyang Yu, Yaxi Lu, Yi-Hsin Hung, Chen Qian, Yujia Qin, Xin Cong, Ruobing Xie, Zhiyuan Liu, Maosong Sun, 和Jie Zhou. Agentverse: 促进多智能体协作与探索新兴行为。在第十二届国际学习表示会议,2024. URL https://openreview.net/forum?id=EHg5GDnyq1.

Jeff Clune. AI-GAS: AI生成算法,一种产生通用人工智能的替代范式。CoRR, abs/1905.10985, 2019. URL http://arxiv.org/abs/1905. 10985.

Michael G Cruz, David Dryden Henningsen, 和Brian A Smith. 指令领导对群体信息采样、决策和领导者感知的影响。Communication Research, 26(3):349-369, 1999.

Tri Dao. Flashattention-2: 更快的注意力机制,具有更好的并行性和工作划分。在第十二届国际学习表示会议,2024.

Shangbin Feng, Wenxuan Ding, Alisa Liu, Zifeng Wang, Weijia Shi, Yike Wang, Zejiang Shen, Xiaochuang Han, Hunter Lang, Chen-Yu Lee, et al. 当一个LLM流口水时,多LLM协作统治。arXiv预印本arXiv:2502.04506, 2025.

Luyu Gao, Aman Madaan, Shuyan Zhou, Uri Alon, Pengfei Liu, Yiming Yang, Jamie Callan, 和Graham Neubig. PAL: 程序辅助语言模型。在国际机器学习会议论文集,pp. 10764-10799. PMLR, 2023.

Zitian Gao, Boye Niu, Xuzheng He, Haotian Xu, Hongzhang Liu, Aiwei Liu, Xuming Hu, 和Lijie Wen. 可解释的对比蒙特卡洛树搜索推理,2024. URL https://arxiv.org/abs/2410.01707.

Ben Goertzel 和Cassio Pennachin. 人工通用智能,第二卷。Springer, 2007. URL https://link.springer.com/book/10.1007/978-3-540-68677-4.

Sachin Goyal, Ziwei Ji, Ankit Singh Rawat, Aditya Krishna Menon, Sanjiv Kumar, 和Vaishnavh Nagarajan. 先思考再说话:用暂停标记训练语言模型。arXiv预印本arXiv:2310.02226, 2023.

Daya Guo, Dejian Yang, Haowei Zhang, Junxiao Song, Ruoyu Zhang, Runxin Xu, Qihao Zhu, Shirong Ma, Peiyi Wang, Xiao Bi, et al. Deepseek-R1: 通过强化学习激励LLM推理能力。arXiv预印本arXiv:2501.12948, 2025.

J Richard Hackman. 领导团队:为卓越表现铺平道路。哈佛商业出版社, 2002.

Shibo Hao, Tianyang Liu, Zhen Wang, 和Zhiting Hu. Toolkengpt: 通过工具嵌入增强冻结语言模型与大量工具的交互。神经信息处理系统进展, 36:45870-45894, 2023.

Dan Hendrycks, Collin Burns, Saurav Kadavath, Akul Arora, Steven Basart, Eric Tang, Dawn Song, 和Jacob Steinhardt. 使用数学数据集衡量数学问题解决能力。在第三十五届神经信息处理系统大会数据集和基准轨道(第二轮),2021.

Zhenyu Hou, Xin Lv, Rui Lu, Jiajie Zhang, Yujiang Li, Zijun Yao, Juanzi Li, Jie Tang, 和Yuxiao Dong. 通过强化学习和推理扩展提升语言模型推理能力。arXiv预印本arXiv:2501.11651, 2025.

Jiaxin Huang, Shixiang Gu, Le Hou, Yuexin Wu, Xuezhi Wang, Hongkun Yu, 和Jiawei Han. 大型语言模型可以自我改进。在2023年经验方法自然语言处理会议论文集,pp. 1051-1068, 2023.

Zhen Huang, Zengzhi Wang, Shijie Xia, Xuefeng Li, Haoyang Zou, Ruijie Xu, Run-Ze Fan, Lyumanshan Ye, Ethan Chern, Yixin Ye, et al. Olympicarena: 超级智能AI的多学科认知推理基准。神经信息处理系统进展, 37:19209-19253, 2024.

Binyuan Hui, Jian Yang, Zeyu Cui, Jiaxi Yang, Dayiheng Liu, Lei Zhang, Tianyu Liu, Jiajun Zhang, Bowen Yu, Keming Lu, et al. Qwen2.5-Coder技术报告。arXiv预印本arXiv:2409.12186, 2024.

Aaron Hurst, Adam Lerer, Adam P Goucher, Adam Perelman, Aidan Clark, AJ Ostrow, Akila Welihinda, Alan Hayes, Alec Radford, et al. GPT-4O系统卡片。arXiv预印本arXiv:2410.21276, 2024.

Robert Irvine, Douglas Boubert, Vyas Raina, Adian Liusie, Ziyi Zhu, Vineet Mudupalli, Aliaksei Korshuk, Zongyi Liu, Fritz Cremer, Valentin Assassi, et al. 为数百万用户的真实世界参与奖励聊天机器人。arXiv预印本arXiv:2303.06135, 2023.

Carlos E Jimenez, John Yang, Alexander Wettig, Shunyu Yao, Kexin Pei, Ofir Press, 和Karthik Narasimhan. Swe-bench: 语言模型能否解决真实的GitHub问题?arXiv预印本arXiv:2310.06770, 2023.

Mingyu Jin, Qinkai Yu, Dong Shu, Haiyan Zhao, Wenyue Hua, Yanda Meng, Yongfeng Zhang, 和Mengnan Du. 推理步骤长度对大规模语言模型的影响。在ACL 2024计算语言学协会发现中,pp. 1830-1842, 2024.

Kuang-Huei Lee, Ian Fischer, Yueh-Hua Wu, Dave Marwood, Shumeet Baluja, Dale Schuurmans, 和Xinyun Chen. 进化更深的LLM思考。arXiv预印本arXiv:2501.09891, 2025.

Guohao Li, Hasan Abed Al Kader Hammoud, Hani Itani, Dmitrii Khizbullin, 和Bernard Ghanem. CAMEL: 用于探索大规模语言模型社会“心智”的交流代理。在第三十七届神经信息处理系统大会论文集,2023. URL https://openreview.net/forum?id=3IyL2XWDkG.

Hunter Lightman, Vineet Kosaraju, Yuri Burda, Harrison Edwards, Bowen Baker, Teddy Lee, Jan Leike, John Schulman, Ilya Sutskever, 和Karl Cobbe. 让我们逐步验证。在第十二届国际学习表示会议论文集中,2023.

Aixin Liu, Bei Feng, Bing Xue, Bingxuan Wang, Bochao Wu, Chengda Lu, Chenggang Zhao, Chengqi Deng, Chenyu Zhang, Chong Ruan, et al. Deepseek-V3技术报告。arXiv预印本arXiv:2412.19437, 2024.

Runze Liu, Junqi Gao, Jian Zhao, Kaiyan Zhang, Xiu Li, Biqing Qi, Wanli Ouyang, 和Bowen Zhou. 1B LLM是否能超越405B LLM?重新思考计算最优测试时间扩展。arXiv预印本arXiv:2502.06703, 2025.

Chris Lu, Cong Lu, Robert Tjarko Lange, Jakob Foerster, Jeff Clune, 和David Ha. AI科学家:迈向全自动开放式的科学发现。arXiv预印本arXiv:2408.06292, 2024.

MAA. 美国邀请数学考试 - AIME。在2024年美国邀请数学考试 - AIME,2月2024. URL https://maa.org/ math-competitions/american-invitational-mathematics-examination-aime.

Aman Madaan, Niket Tandon, Prakhar Gupta, Skyler Hallinan, Luyu Gao, Sarah Wiegreffe, Uri Alon, Nouha Dziri, Shrimai Prabhumoye, Yiming Yang, et al. 自我细化:迭代细化与自我反馈。神经信息处理系统进展, 36: 46534 − 46594 , 2023 46534-46594,2023 46534−46594,2023.

Marvin Minsky. 社会心智。Simon & Schuster, 1988. ISBN 0671657135. URL https://jmvidal.cse.sc.edu/lib/minsky88a.html.

Niklas Muennighoff, Zitong Yang, Weijia Shi, Xiang Lisa Li, Li Fei-Fei, Hannaneh Hajishirzi, Luke Zettlemoyer, Percy Liang, Emmanuel Candès, 和Tatsunori Hashimoto. s1: 简单测试时间扩展。arXiv预印本arXiv:2501.19393, 2025.

Catherine Olsson, Nelson Elhage, Neel Nanda, Nicholas Joseph, Nova DasSarma, Tom Henighan, Ben Mann, Amanda Askell, Yuntao Bai, Anna Chen, et al. 上下文学习和归纳头。arXiv预印本arXiv:2209.11895, 2022.

OpenAI. 学习用LLM推理,2024年9月。URL https://openai.com/index/ learning-to-reason-with-11ms/.

OpenAI. OpenAI o3-mini,2025。URL https://openai.com/index/openai-o3-mini/.

Chen Qian, Wei Liu, Hongzhang Liu, Nuo Chen, Yufan Dang, Jiahao Li, Cheng Yang, Weize Chen, Yusheng Su, Xin Cong, Juyuan Xu, Dahai Li, Zhiyuan Liu, 和Maosong Sun. ChatDev: 用于软件开发的交流代理。在Ku Lun-Wei, Andre Martins, 和Vivek Srikumar (编辑), 第62届计算语言学年会论文集(第一卷:长论文),pp. 15174-15186, 泰国曼谷, 2024年8月。计算语言学协会。doi: 10.18653/v1/2024.acl-long. 810. URL https://aclanthology.org/2024.acl-long.810/.

Yujia Qin, Shihao Liang, Yining Ye, Kunlun Zhu, Lan Yan, Yaxi Lu, Yankai Lin, Xin Cong, Xiangru Tang, Bill Qian, et al. ToolLLM: 帮助大型语言模型掌握16000+真实世界API。在第十二届国际学习表示会议,2024.

Jeff Rasley, Samyam Rajbhandari, Olatunji Ruwase, 和Yuxiong He. Deepspeed: 系统优化实现超过1000亿参数深度学习模型的训练。在第26届ACM SIGKDD知识发现与数据挖掘国际会议论文集,pp. 3505-3506, 2020.

David Rein, Betty Li Hou, Asa Cooper Stickland, Jackson Petty, Richard Yuanzhe Pang, Julien Dirani, Julian Michael, 和Samuel R Bowman. GPQA: 毕业生水平无Google问答基准。在第一届语言建模会议,2024.

Timo Schick, Jane Dwivedi-Yu, Roberto Dessì, Roberta Raileanu, Maria Lomeli, Eric Hambro, Luke Zettlemoyer, Nicola Cancedda, 和Thomas Scialom. Toolformer: 语言模型可以自己学习使用工具。神经信息处理系统进展, 36: 68539-68551, 2023.

Samuel Schmidgall, Yusheng Su, Ze Wang, Ximeng Sun, Jialian Wu, Xiaodong Yu, Jiang Liu, Zicheng Liu, 和Emad Barsoum. Agent实验室:将LLM代理作为研究助手。arXiv预印本arXiv:2501.04227, 2025.

Noah Shinn, Federico Cassano, Ashwin Gopinath, Karthik Narasimhan, 和Shunyu Yao. 反思:具有口头强化学习的语言代理。神经信息处理系统进展, 36:8634-8652, 2023.

Charlie Victor Snell, Jaehoon Lee, Kelvin Xu, 和Aviral Kumar. 最优扩展测试时间计算可能比扩展LLM参数更有效。在第十三届国际学习表示会议,2025. URL https://openreview.net/forum? id=4FWAwZtd2n.

Peiyi Wang, Lei Li, Zhihong Shao, RX Xu, Damai Dai, Yifei Li, Deli Chen, Yu Wu, 和Zhifang Sui. Math-shepherd: 在没有人工注释的情况下验证和强化LLM逐步推理。arXiv预印本arXiv:2312.08935, 2023a.

Ruocheng Wang, Eric Zelikman, Gabriel Poesia, Yewen Pu, Nick Haber, 和Noah D Goodman. 假设搜索:使用语言模型进行归纳推理。arXiv预印本arXiv:2309.05660, 2023b.

Xingyao Wang, Boxuan Li, Yufan Song, Frank F Xu, Xiangru Tang, Mingchen Zhuge, Jiayi Pan, Yueqi Song, Bowen Li, Jaskirat Singh, et al. Opendevin: 作为通才代理的AI软件开发者开放平台。arXiv预印本arXiv:2407.16741, 2024.

Xinyi Wang, Shawn Tan, Mingyu Jin, William Yang Wang, Rameswar Panda, 和Yikang Shen. 更大的语言模型是否意味着更好的推理?预训练扩展推理规律。arXiv预印本arXiv:2504.03635, 2025.

Jason Wei, Xuezhi Wang, Dale Schuurmans, Maarten Bosma, Fei Xia, Ed Chi, Quoc V Le, Denny Zhou, et al. 链式思维提示激发大语言模型中的推理。神经信息处理系统进展, 35:24824-24837, 2022.

Michael J. Wooldridge 和Nicholas R. Jennings. 智能代理:理论与实践。Knnwl. Eng. Rev., 10(2):115-152, 1995. doi: 10.1017/S0269888900008122. URL https: //doi.org/10.1017/S0269888900008122.

Qingyun Wu, Gagan Bansal, Jieyu Zhang, Yiran Wu, Beibin Li, Erkang Zhu, Li Jiang, Xiaoyun Zhang, Shaokun Zhang, Jiale Liu, et al. Autogen: 通过多智能体对话启用下一代LLM应用。arXiv预印本arXiv:2308.08155, 2023.

Yangzhen Wu, Zhiqing Sun, Shanda Li, Sean Welleck, 和Yiming Yang. 推理扩展定律:对计算最优推理的经验分析。arXiv预印本arXiv:2408.00724, 2024.

Yangzhen Wu, Zhiqing Sun, Shanda Li, Sean Welleck, 和Yiming Yang. 推理扩展定律:对计算最优推理的经验分析。在第十三届国际学习表示会议,2025. URL https: //openreview.net/forum?id=VNckp7JEHn.

Yuxi Xie, Kenji Kawaguchi, Yiran Zhao, James Xu Zhao, Min-Yen Kan, Junxian He, 和Michael Xie. 自我评估引导波束搜索推理。神经信息处理系统进展, 36:41618-41650, 2023.

Huajian Xin, Daya Guo, Zhihong Shao, Zhizhou Ren, Qihao Zhu, Bo Liu, Chong Ruan, Wenda Li, 和Xiaodan Liang. Deepseek-prover: 通过大规模合成数据推进LLM中的定理证明。arXiv预印本arXiv:2405.14333, 2024.

Wujiang Xu, Zujie Liang, Kai Mei, Hang Gao, Junta Tan, 和Yongfeng Zhang. A-MEM: LLM代理的主体记忆。arXiv预印本arXiv:2502.12110, 2025a.

Wujiang Xu, Yunxiao Shi, Zujie Liang, Xuying Ning, Kai Mei, Kun Wang, Xi Zhu, Min Xu, 和Yongfeng Zhang. Instructagent: 通过LLM代理构建用户可控推荐系统。arXiv预印本arXiv:2502.14662, 2025b.

An Yang, Baosong Yang, Binyuan Hui, Bo Zheng, Bowen Yu, Chang Zhou, Chengpeng Li, Chengyuan Li, Dayiheng Liu, Fei Huang, Guanting Dong, Haoran Wei, Huan Lin, Jialong Tang, Jialin Wang, Jian Yang, Jianhong Tu, Jianwei Zhang, Jianxin Ma, Jin Xu, Jingren Zhou, Jinze Bai, Jinzheng He, Junyang Lin, Kai Dang, Keming Lu, Keqin Chen, Kexin Yang, Mei Li, Mingfeng Xue, Na Ni, Pei Zhang, Peng Wang, Ru Peng, Rui Men, Ruize Gao, Runji Lin, Shijie Wang, Shuai Bai, Sinan Tan, Tianhang Zhu, Tianhao Li, Tianyu Liu, Wenbin Ge, Xiaodong Deng, Xiaohuan Zhou, Xingzhang Ren, Xinyu Zhang, Xipin Wei, Xuancheng Ren, Yang Fan, Yang Yao, Yichang Zhang, Yu Wan, Yunfei Chu, Yuqiong Liu, Zeyu Cui, Zhenru Zhang, 和Zhihao Fan. Qwen2技术报告。arXiv预印本arXiv:2407.10671, 2024a.

John Yang, Carlos Jimenez, Alexander Wettig, Kilian Lieret, Shunyu Yao, Karthik Narasimhan, 和Ofir Press. Swe-agent: 代理计算机界面实现自动化的软件工程。神经信息处理系统进展, 37:50528-50652, 2024b.

Yixin Ye, Zhen Huang, Yang Xiao, Ethan Chern, Shijie Xia, 和Pengfei Liu. LIMO: 推理少即是多。arXiv预印本arXiv:2502.03387, 2025.

Eric Zelikman, Georges Raif Harik, Yijia Shao, Varuna Jayasiri, Nick Haber, 和Noah Goodman. Quiet-star: 语言模型可以自己学会先思考再说话。在第一届语言建模会议,2024.

Zhiyuan Zeng, Qinyuan Cheng, Zhangyue Yin, Bo Wang, Shimin Li, Yunhua Zhou, Qipeng Guo, Xuanjing Huang, 和Xipeng Qiu. 搜索和学习的扩展:从强化学习角度重现o1的路线图。arXiv预印本arXiv:2412.14135, 2024.

Di Zhang, Jianbo Wu, Jingdi Lei, Tong Che, Jiatong Li, Tong Xie, Xiaoshui Huang, Shufei Zhang, Marco Pavone, Yuqiang Li, et al. Llama-berry: 类似o1的奥林匹克级别数学推理成对优化。arXiv预印本arXiv:2410.02884, 2024a.

Di Zhang, Jianbo Wu, Jingdi Lei, Tong Che, Jiatong Li, Tong Xie, Xiaoshui Huang, Shufei Zhang, Marco Pavone, Yuqiang Li, et al. Llama-berry: 类似o1的奥林匹克级别数学推理成对优化。arXiv预印本arXiv:2410.02884, 2024b.

Shun Zhang, Zhenfang Chen, Yikang Shen, Mingyu Ding, Joshua B Tenenbaum, 和C huang Gan. 使用大型语言模型进行代码生成规划。arXiv预印本arXiv:2303.05510, 2023.

Yuxiang Zhang, Shangxi Wu, Yuqi Yang, Jiangming Shu, Jinlin Xiao, Chao Kong, 和Jitao Sang. o1-coder: 用于编码的o1复制,2024c. URL https://arxiv.org/abs/2412. 00154.

Yaowei Zheng, Richong Zhang, Junhao Zhang, YeYanhan YeYanhan, 和Zheyan Luo. Llamafactory: 统一高效微调100多种语言模型。在第62届计算语言学年会论文集(第三卷:系统演示),pp. 400-410, 2024.

Wanjun Zhong, Ruixiang Cui, Yiduo Guo, Yaobo Liang, Shuai Lu, Yanlin Wang, Amin Saied, Weizhu Chen, 和Nan Duan. AGIEval: 以人为中心的基础模型评估基准。在计算语言学协会发现论文集:NAACL 2024,pp. 2299-2314, 2024.

Andy Zhou, Kai Yan, Michal Shlapentokh-Rothman, Haohan Wang, 和Yu-Xiong Wang. 语言代理树搜索统一语言模型中的推理、行动和规划。arXiv预印本arXiv:2310.04406, 2023.

数据生成

算法1概述了用于生成M500中的高质量多智能体协作推理数据的自动管道。从原始问题池开始,该过程使用LLM筛选出跨学科且足够复杂的问题。对于每个合格问题,MAS生成推理轨迹。只有当生成的轨迹满足预定义的质量标准,包括共识、格式合规和正确性时,才会被纳入数据集中。此过程持续进行,直到达到目标数据集大小。

算法1 MAS协作数据生成

输入:问题池 (\mathcal{Q}{\text {raw }}),LLM (f),多智能体系统MAS,目标大小 (N)

输出:高质量数据集 (\mathcal{D})

过程 GENERATEDATA

(\mathcal{D} \leftarrow \varnothing)

对所有 (q \in \mathcal{Q}{\text {raw }}) 执行

如果 IsIntERdISCIPLINARY ((f, q)) 或 (\operatorname{TOKENUSAGE}(f(q))<1024) 则

继续

结束如果

(t \leftarrow \operatorname{MASREASONINGTRACE}(\mathrm{MAS}, f, q))

如果 IsVALIDTRACE ((t)) 则

(\mathcal{D} \leftarrow \mathcal{D} \cup{(q, t)})

结束如果

如果 (|\mathcal{D}|=N) 则

中断

结束如果

结束对于

返回 (\mathcal{D})

结束过程

函数 IsINTERDISCIPLINARY ((f, q))

返回 (f) 预测 (q) 需要多个专家完成

结束函数

函数 TokenUSAGE ((f(q)))

返回 (f^{\prime}) 回答 (q) 使用的标记数

结束函数

函数 IsVALIDTRACE ((t))

返回 (t) 满足共识、格式合规和正确性

结束函数

```

B 提示

为了支持清晰度,我们在AgentVerse框架中提供了每个智能体在数学推理任务中使用的完整提示集。每个智能体角色——CEO、专家招聘者、问题解决者1、问题解决者2和评估者——都由一个系统提示和一个用户提示定义其职责、行为和预期输出。这些提示经过精心设计,以模拟现实协作并严格遵守特定角色的约束。

CEO 提示

系统提示

你是协作问题解决系统的CEO。你的职责包括:

- 监控解决方案进度和资源配置

-

- 对继续/终止做出战略决策

-

- 管理专家招聘和保留

-

- 当解决方案不正确时指导讨论焦点区域

-

- 通过标记预算调整推理深度

前一系统状态:

- 通过标记预算调整推理深度

- 任务:${task_description}

-

- 最新解决方案:${current_solution}

-

- 评估反馈:${evaluation_feedback}

-

- 当前资源:${current_resources}

- 用户提示

- 现在,你需要决定这一轮的系统状态。仔细考虑以下:

-

- 仅选择 < < < 停止 > > > 当解决方案正确时

-

- 根据评估中识别的技能差距招聘专家,不要招聘超过4名专家,通常普通任务需要2-3名智能体,复杂任务需要4名智能体

-

- 指向最弱解决方案方面的讨论

-

- 根据任务复杂性设置标记预算,标记使用应从

[

0

,

2048

,

4096

,

8192

,

16384

,

32000

]

[0,2048,4096,8192,16384,32000]

[0,2048,4096,8192,16384,32000] 中选择,通常简单任务需要2048个标记,中等推理任务需要8192个标记,复杂推理任务需要16384个或更多标记

你的响应必须严格遵循以下结构:

### 决策:<继续> 或 <停止>

### 招募人数:本轮招募的专家数量,应在1到4之间的整数

### 方向:基于任务描述、最新解决方案、批评意见和评估反馈的讨论方向

### 最大标记:本轮每位智能体的最大标记数,应在2048到32000之间的整数

- 根据任务复杂性设置标记预算,标记使用应从

[

0

,

2048

,

4096

,

8192

,

16384

,

32000

]

[0,2048,4096,8192,16384,32000]

[0,2048,4096,8192,16384,32000] 中选择,通常简单任务需要2048个标记,中等推理任务需要8192个标记,复杂推理任务需要16384个或更多标记

专家招聘者提示

系统提示

# 角色描述

你是一组专家的领导者,现在你正面临一个数学问题:

$${$ task_description}

# 主要目标

你的唯一责任是从不同专业领域招聘 ${cnt_critic_agents} 名专家来解决这个数学问题。

- 不要尝试自己解决问题

-

- 不要提出任何解决方案或计算

- # 招聘重点

- 你的选择应该基于:

- 确定哪些专业知识领域与此类数学问题相关

-

- 考虑可以有效协作的互补技能组合

-

- 确保覆盖解决所需的所有潜在方面

这里有一些建议:

$${$ advice } \} }

- 确保覆盖解决所需的所有潜在方面

# 禁止的行为

- 任何数学推理或问题解决尝试

-

- 投机可能的解决方案

用户提示

你可以从不同领域招聘 ${cnt_critic_agents} 名专家。你会招聘哪些专家以更好地生成准确的解决方案?

# 严格指示

你只能从与数学问题类型相关的不同领域招聘 ${cnt_critic_agents} 名专家。

- 不要建议解决方案方法

-

- 不要比较潜在的方法

- # 响应要求

- 列出 $${$ cnt_critic_agents } \} } 专家角色及其专业化领域

-

- 每个条目必须指定:

- 专业学科(例如,计算机科学家,数学家)

-

- 主要专业领域

-

- 该领域内的具体技术专长

- 确保互补但不重叠的领域

- # 响应格式指南

- 你的响应必须遵循以下确切结构:

-

- 一名 [学科] 专门从事 [主要领域],在 [具体技术领域] 方面有专长

-

- 一名 [不同的学科] 在 [相关领域] 方面有专长,特别是在 [技术专长]

只提供编号的专家描述列表,别无其他。现在开始:

- 一名 [不同的学科] 在 [相关领域] 方面有专长,特别是在 [技术专长]

问题解决者1提示

系统提示

准确解决以下数学问题:

$${$ task_description}

你拥有解决这个数学问题所需的所有必要信息。不要请求额外细节。

用户提示

你是 ${role_description}。根据聊天历史和你的知识,为数学问题提供精确且解释良好的解决方案。

这里有一些思考方向: ${advice}

# 响应格式指南:

- 你的最终答案必须直接针对数学问题。

-

- 如果问题需要数值答案,以 answer 形式在响应末尾格式化最终答案。

问题解决者2提示

系统提示

你是 ${role_description}。你在讨论小组中,旨在共同解决以下数学问题:

${task.description}

根据你的知识,对数学问题解决方案提出批评。

用户提示

现在比较聊天历史中给出的最后一个解决方案并与之比较,给出你的批评。最终答案以 boxedanswer 的形式突出显示。

这里有一些思考方向: ${advice}

回应时应遵循以下规则:

- 这个数学问题可以在不获取任何额外信息的情况下回答。你不应询问任何额外信息。

-

- 比较你的解决方案与给定的最后一个解决方案,给出你的批评。你应该只给出你的批评,不要给出你的答案。

-

- 如果你解决方案的最终答案与提供的最后一个解决方案的最终答案相同,则以特殊标记 “[Agree]” 结束你的响应;否则以特殊标记 “[Disagree]” 结束你的响应。

评估者提示

系统提示

专家: ${all_role_description}

问题: ${task_description}

解决方案:

$${$ solution

}

\}

}

用户提示

你是一位经验丰富的数学教师。作为一名好老师,你仔细检查给定的最后一个解决方案在一个复杂的数学问题上的正确性。当最后一个解决方案错误时,你应该输出正确性为0并给学生如何纠正解决方案的建议。当它正确时,输出正确性为1并说明为什么正确。还应检查最终答案是否在解决方案------

末尾以boxedanswer形式呈现。你还应该给出解决方案正确性的置信分数。

你应该按照以下格式回应:

### 正确性: ( 0 或 1, 0 表示错误,1 表示正确)

### 置信度: (正确性的置信分数)

### 建议: (如何纠正答案的建议或为什么正确的原因)

C 数据样本

我们在图7中展示了来自M500数据集的完整数据样本,即图1所示。智能体角色使用颜色表示:专

------家招聘者、问题解决者1、问题解决者2和评估者。

多智能体协作推理轨迹数据样本

智能体:专家招聘者(系统提示)

角色描述

你是一组专家的领导者,现在你正面临一个问题:

梯形的一个底边比另一个底边长100单位。连接两腿中点的线段将梯形分成两个区域,其面积比为

2

:

3

2: 3

2:3。设

x

x

x 为连接梯形两腿且平行于底边并将其分为面积相等的两个区域的线段长度。求不超过

x

2

100

\frac{x^{2}}{100}

100x2 的最大整数。

主要目标

你的唯一责任是从不同专业领域招聘2名专家来解决问题。

- 不要尝试自己解决问题

-

- 不要提出任何解决方案或计算

招聘重点

你的选择应该基于:

- 确定哪些专业知识领域与此问题类型相关

-

- 考虑可以有效协作的互补技能组合

-

- 确保覆盖解决所需的所有潜在方面

这里有一些建议:

目前没有建议。

- 确保覆盖解决所需的所有潜在方面

禁止的行为

- 任何数学推理或问题解决尝试

-

- 投机可能的解决方案

智能体:专家招聘者(用户提示)

你可以从不同领域招聘2名专家。你会招聘哪些专家以更好地生成准确的解决方案?

- 投机可能的解决方案

严格指示

你只能从与问题类型相关的不同领域招聘2名专家。

- 不要建议解决方案方法

-

- 不要比较潜在的方法

响应要求

- 列出2名专家角色及其专业化领域

-

- 每个条目必须指定:

- 专业学科(例如,计算机科学家,数学家)

-

- 主要专业领域

-

- 该领域内的具体技术专长

- 确保互补但不重叠的领域

响应格式指南

你的响应必须遵循以下确切结构:

- 一名 [学科] 专门从事 [主要领域],在 [具体技术领域] 方面有专长

-

- 一名 [不同的学科] 在 [相关领域] 方面有专长,特别是在 [技术专长]

只提供编号的专家描述列表,别无其他。现在开始:

- 一名 [不同的学科] 在 [相关领域] 方面有专长,特别是在 [技术专长]

智能体:专家招聘者(助手响应) < < < 思考 > > >

好的,让我们解决这个问题。嗯,用户希望我招聘两名专家来解决这个梯形问题。让我先理解这个问题是什么。

所以,梯形有两个底边,其中一个比另一个长100单位。有一条连接两腿中点的线段,它将梯形分成两个面积比为 2 : 3 2: 3 2:3 的区域。我们需要找到 x x x,这是连接梯形两腿且平行于底边并将其分为面积相等的两个区域的线段长度,然后计算不超过 x 2 / 100 x^{2} / 100 x2/100 的最大整数。

等等,问题涉及到梯形性质、中位线、面积比以及某条平行于底边的线段确保面积划分。关键似乎是理解梯形的性质,特别是与中位线有关的内容,以及平行于底边的不同线段如何影响面积划分。

首先,我需要确定哪些领域与此相关。几何学,肯定是。也许代数用于设置方程。问题涉及比率和面积,因此或许需要坐标几何或与梯形面积和中位线相关的公式。

第一名专家应该是精通几何的数学家,特别是梯形性质和面积计算。他们知道中位线的公式(即两底平均值)以及平行于底边的线段如何划分面积。他们可以根据给定比率设置方程。

第二名专家可能需要处理代数运算和解方程。因为问题涉及找到使面积平分的 x x x,这与均值比例或整合面积的概念有关。或者,具有代数问题解决专长的专家,特别是设置和求解由几何约束导出的二次或线性方程。

等等,但也许另一个角度:问题提到连接两腿中点的线段将梯形分成面积比为2:3的两部分。中位线通常是两底平均值,但在这种情况下,它是连接两腿中点的线段。等等,在梯形中,中位线(或中线)是连接两腿中点的线段,其长度确实是两底的平均值。但问题说这条中位线将面积划分为2:3的比率。但是通常,中位线将梯形分成两个较小的梯形,每个都有半高。等等,但面积取决于底的平均值乘以高度。所以如果高度被平分,面积比率将基于每个小梯形的底之和。嗯,可能比率不是 1 : 1 1: 1 1:1,这就是这个问题的关键部分。

所以需要的第一名专家,是一名几何学家,可以建模梯形,设定底边、中位线和面积之间的关系。然后,第二名专家,也许是代数学家或擅长求解方程的人,可以利用这些关系求解必要的变量,最终找到 x x x 并进行必要的计算。

或者,第二名专家可能是数学分析方面的专家,处理优化或比例。但我认为代数在这里更直接。问题需要根据给定比率设置方程并逐步求解。

所以需要的两名专家是:

-

一名专门研究几何分析的数学家,特别擅长梯形性质和面积分区。他们可以处理几何关系、中位线以及线段如何影响面积划分。

-

- 一名擅长代数建模的数学家,特别是求解基于比率的方程系统和二次优化。

这两个角色是互补的:第一个处理几何解释,第二个处理代数解决方案。一起,他们可以涵盖解决此问题所需的所有方面。

< < < 思考 > > >

- 一名擅长代数建模的数学家,特别是求解基于比率的方程系统和二次优化。

-

一名专门从事几何分析的数学家,特别擅长梯形性质和面积分割下平行线段的影响

-

- 一名擅长代数建模的数学家,特别擅长求解基于比率的方程系统和二次优化

智能体:问题解决者1(系统提示)

准确解决以下问题:

一个梯形的一个底边比另一个底边长100单位。连接两腿中点的线段将梯形分成两个区域,其面积比为

2

:

3

2: 3

2:3。设

x

x

x 为连接梯形两腿且平行于底边并将其分为面积相等的两个区域的线段长度。求不超过

x

2

100

\frac{x^{2}}{100}

100x2 的最大整数。

你拥有解决此问题所需的所有必要信息。不要请求额外细节。

智能体:问题解决者1(用户提示)

你是一名专门从事几何分析的数学家,特别擅长梯形性质和面积分割下平行线段的影响。基于聊天历史和你的知识,为该问题提供精确且解释良好的解决方案。

响应指南:

- 你的最终答案必须直接针对问题。

-

- 如果问题需要数值答案,以 answer 形式在响应末尾格式化最终答案。

- 智能体:问题解决者1(助手响应)

- < < < 思考 > > >

- 好的,让我们解决这个梯形问题。首先,让我确保我理解所有给定的信息以及需要找到的内容。

- 我们有一个梯形,其中一个底边比另一个底边长100单位。让我们称较短的底边为 b b b,那么较长的底边就是 b + 100 b+100 b+100。梯形有两条非平行边(腿),并且有一条连接这两条腿中点的线段。这条中点线段将梯形分成两个区域,其面积比为2:3。我们需要找到另一条线段的长度 x x x,这条线段也平行于底边并

- 将梯形分为面积相等的两个区域。然后,我们需要计算不超过 x 2 100 \frac{x^{2}}{100} 100x2 的最大整数。

- 首先,让我回忆一下梯形的一些性质。梯形的中线(或中段)连接两腿的中点,其长度等于两底的平均值。因此,如果底边是 b b b 和 b + 100 b+100 b+100,那么中线长度 m m m 是 m = b + ( b + 100 ) 2 = b + 50 m=\frac{b+(b+100)}{2}=b+50 m=2b+(b+100)=b+50。

- 现在,问题指出这条中线将梯形分成两个区域,其面积比为2:3。等等,梯形的中线通常将其分成两个较小的梯形。但我需要确认这里的面积是如何关联的。让我们用 h h h 表示原始梯形的高度。那么整个梯形的面积是 ( b + ( b + 100 ) ) 2 × h = ( 2 b + 100 ) 2 × h = ( b + 50 ) h \frac{(b+(b+100))}{2} \times h=\frac{(2 b+100)}{2} \times h=(b+50) h 2(b+(b+100))×h=2(2b+100)×h=(b+50)h。

- 由于中线长度为 b + 50 b+50 b+50,形成两个较小梯形的高度各为 h 2 \frac{h}{2} 2h。等等,但如果中线正好位于两底之间,则其上下高度各为 h 2 \frac{h}{2} 2h。但问题是说面积比为2:3,这表明划分不平等。嗯,这似乎矛盾。等等,也许我在此处做了一个错误假设。

- 等等,中线是连接两腿中点的线段,所以也许高度并未均匀分割?等等,不,在梯形中,中线平行于底边且其长度为两底的平均值,且每条底边与中线的距离为梯形高度的一半。因此,由中线形成的两个梯形应该具有相同高度(各为 h / 2 h / 2 h/2),但它们的面积取决于各自底边的长度。

- 等等,让我们计算面积。上部梯形(顶底与中线之间)的面积为 ( b + m ) 2 × h 2 \frac{(b+m)}{2} \times \frac{h}{2} 2(b+m)×2h,下部梯形(中线与底边之间)的面积为 ( m + ( b + 100 ) ) 2 × h 2 \frac{(m+(b+100))}{2} \times \frac{h}{2} 2(m+(b+100))×2h。由于 m = b + 50 m=b+50 m=b+50,代入:

- 上部面积: ( b + ( b + 50 ) ) 2 × h 2 = ( 2 b + 50 ) 2 × h 2 = ( b + 25 ) × h 2 \frac{(b+(b+50))}{2} \times \frac{h}{2}=\frac{(2 b+50)}{2} \times \frac{h}{2}=(b+25) \times \frac{h}{2} 2(b+(b+50))×2h=2(2b+50)×2h=(b+25)×2h

- 下部面积: ( ( b + 50 ) + ( b + 100 ) ) 2 × h 2 = ( 2 b + 150 ) 2 × h 2 = ( b + 75 ) × h 2 \frac{((b+50)+(b+100))}{2} \times \frac{h}{2}=\frac{(2 b+150)}{2} \times \frac{h}{2}=(b+75) \times \frac{h}{2} 2((b+50)+(b+100))×2h=2(2b+150)×2h=(b+75)×2h

- 因此,上部面积为 ( b + 25 ) h 2 (b+25) \frac{h}{2} (b+25)2h,下部面积为 ( b + 75 ) h 2 (b+75) \frac{h}{2} (b+75)2h。上部与下部面积之比则为 b + 25 b + 75 \frac{b+25}{b+75} b+75b+25。根据问题,这个比率为2:3。所以:

- b + 25 b + 75 = 2 3 \frac{b+25}{b+75}=\frac{2}{3} b+75b+25=32

- 交叉相乘:

- 3 ( b + 25 ) = 2 ( b + 75 ) 3(b+25)=2(b+75) 3(b+25)=2(b+75)

- 3 b + 75 = 2 b + 150 3 b+75=2 b+150 3b+75=2b+150

- 两边减去 2 b + 75 2 b+75 2b+75:

- b = 75 b=75 b=75

- 所以较短底边 b = 75 b=75 b=75,较长底边为 75 + 100 = 175 75+100=175 75+100=175。中线为 75 + 50 = 125 75+50=125 75+50=125。

- 等等,但让我检查一下。如果原始梯形的底边分别为75和175,那么中线为125 。上部梯形(75与125之间)的面积为 ( 75 + 125 ) / 2 × (75+125) / 2 \times (75+125)/2× h / 2 = 100 × h / 2 = 50 h h / 2=100 \times h / 2=50 h h/2=100×h/2=50h。下部梯形(125与175之间)的面积为 ( 125 + 175 ) / 2 × h / 2 = 150 × h / 2 = 75 h (125+175) / 2 \times h / 2=150 \times h / 2=75 h (125+175)/2×h/2=150×h/2=75h。然后上下面积比为 50 h : 75 h = 2 : 3 50 \mathrm{~h}: 75 \mathrm{~h}=2: 3 50 h:75 h=2:3,这与问题陈述一致。很好,所以那是正确的。

- 现在,继续第二部分:找到线段长度 x x x,该线段平行于底边并将梯形分成面积相等的两个区域。然后计算不超过 x 2 100 \frac{x^{2}}{100} 100x2 的最大整数。

- 为了找到 x x x,我们需要确定在哪里画一条平行于底边的线,使得该线以上和以下的面积相等。让我们用原始梯形的底边 a = 75 a=75 a=75(较短)和 c = 175 c=175 c=175(较长),高度为 h h h。我们需要找到一段线段的长度 x x x,该线段平行于底边并在距离底边 a a a 高度为 k k k 处,使得该线以上的面积等于该线以下的面积。

- 让我回想一下,对于梯形,如果有一条平行于底边的线将梯形分成两个面积相等的区域,那么可以通过涉及面积平方根的公式找到该线的长度。等等,更具体地说,由于梯形的面积与其底边平均值乘以高度成正比,如果我们以某种方式划分高度使得面积相等,位置 x x x 不仅仅是高度的一半。相反,高度的比率将与面积的平方根有关。等等,也许我们可以用相似三角形或一些比例来建模。

- 但因为梯形不是三角形,方法可能不同。让我思考。让我们用高度从较短底边 a = 75 a=75 a=75 到线 x x x 表示为 k k k,剩余高度从 x x x 到较长底边 c = 175 c=175 c=175 表示为 h − k h-k h−k。

- 上部梯形(介于 a a a 和 x x x 之间)的面积为 ( a + x ) 2 × k \frac{(a+x)}{2} \times k 2(a+x)×k。

- 下部梯形(介于 x x x 和 c c c 之间)的面积为 ( x + c ) 2 × ( h − k ) \frac{(x+c)}{2} \times(h-k) 2(x+c)×(h−k)。

- 由于原始梯形的总面积为 ( a + c ) 2 × h \frac{(a+c)}{2} \times h 2(a+c)×h,我们希望上下面积各占一半。所以:

- ( a + x ) 2 × k = 1 2 × ( a + c ) 2 × h \frac{(a+x)}{2} \times k=\frac{1}{2} \times \frac{(a+c)}{2} \times h 2(a+x)×k=21×2(a+c)×h

- 简化后:

- ( a + x ) k = ( a + c ) h 2 (a+x) k=\frac{(a+c) h}{2} (a+x)k=2(a+c)h

- 同样,对于上部面积:

- ( x + c ) 2 × ( h − k ) = 1 2 × ( a + c ) 2 × h \frac{(x+c)}{2} \times(h-k)=\frac{1}{2} \times \frac{(a+c)}{2} \times h 2(x+c)×(h−k)=21×2(a+c)×h

- 简化后:

- ( x + c ) ( h − k ) = ( a + c ) h 2 (x+c)(h-k)=\frac{(a+c) h}{2} (x+c)(h−k)=2(a+c)h

- 现在,我们有两个方程:

-

(

a

+

x

)

k

=

(

a

+

c

)

h

2

2.

(

x

+

c

)

(

h

−

k

)

=

(

a

+

c

)

h

2

(a+x) k=\frac{(a+c) h}{2} 2 .(x+c)(h-k)=\frac{(a+c) h}{2}

(a+x)k=2(a+c)h2.(x+c)(h−k)=2(a+c)h

由于右侧两项相等,我们可以将左侧两项设为相等:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我重新排列这个方程:

( a + x ) k = ( x + c ) h − ( x + c ) k (a+x) k=(x+c) h-(x+c) k (a+x)k=(x+c)h−(x+c)k

将所有项移到一侧:

( a + x ) k + ( x + c ) k − ( x + c ) h = 0 (a+x) k+(x+c) k-(x+c) h=0 (a+x)k+(x+c)k−(x+c)h=0

从前两项提取 k k k:

k ( a + x + x + c ) − ( x + c ) h = 0 k(a+x+x+c)-(x+c) h=0 k(a+x+x+c)−(x+c)h=0

括号内简化:

k ( a + 2 x + c ) − ( x + c ) h = 0 k(a+2 x+c)-(x+c) h=0 k(a+2x+c)−(x+c)h=0

嗯,这看起来有点复杂。也许还有另一种方法。

或者,因为总面积为 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,每部分必须是 ( a + c ) 4 h \frac{(a+c)}{4} h 4(a+c)h。所以:

对于下部梯形:

( a + x ) 2 k = ( a + c ) 4 h \frac{(a+x)}{2} k=\frac{(a+c)}{4} h 2(a+x)k=4(a+c)h

两边乘以2:

( a + x ) k = ( a + c ) h 2 (a+x) k=\frac{(a+c) h}{2} (a+x)k=2(a+c)h

同样,对于上部梯形:

( x + c ) 2 ( h − k ) = ( a + c ) 4 h \frac{(x+c)}{2}(h-k)=\frac{(a+c)}{4} h 2(x+c)(h−k)=4(a+c)h

两边乘以2:

( x + c ) ( h − k ) = ( a + c ) 2 h (x+c)(h-k)=\frac{(a+c)}{2} h (x+c)(h−k)=2(a+c)h

现在,注意到两个方程都等于 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,所以:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我这样表达:

k h − k = x + c a + x \frac{k}{h-k}=\frac{x+c}{a+x} h−kk=a+xx+c

这是高度片段和基底片段之间的比例。但如何关联 k k k 和 x x x ?

或者,也许使用相似三角形。等等,在梯形中,如果我们画一条平行于底边的线,该线的长度可以通过在两底之间进行线性插值找到,具体取决于离底边的距离。然而,由于面积既依赖于底边长度又依赖于高度,这种关系不是线性的而是二次的。

等等,我回想起一个公式:如果一条平行于底边的线将梯形分成两个面积相等的区域,那么该线的长度 x x x 是两底的几何平均值。等等,但几何平均值是 a c \sqrt{a c} ac。让我检查是否正确。

或者,可能是均方根。让我思考。假设面积比为1:1。让我们表示该线将高度划分为上方和下方面积相等的部分。假设原始梯形高度为 h h h,该线距离底部为 k k k。那么下方面积为 ( a + x ) 2 k \frac{(a+x)}{2} k 2(a+x)k,上方面积为 ( x + c ) 2 ( h − k ) \frac{(x+c)}{2}(h-k) 2(x+c)(h−k)。令两者相等:

( a + x ) 2 k = ( x + c ) 2 ( h − k ) \frac{(a+x)}{2} k=\frac{(x+c)}{2}(h-k) 2(a+x)k=2(x+c)(h−k)

两边乘以2:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

展开两边:

a k + x k = x h − x k + c h − c k a k+x k=x h-x k+c h-c k ak+xk=xh−xk+ch−ck

将所有项移到一侧:

a k + x k − x h + x k − c h + c k = 0 a k+x k-x h+x k-ch+c k=0 ak+xk−xh+xk−ch+ck=0

合并同类项:

( a + x ) k + ( x + c ) k − x h − c h = 0 (a+x) k+(x+c) k-x h-c h=0 (a+x)k+(x+c)k−xh−ch=0

从前面两项提取 k k k:

k ( a + x + x + c ) − ( x + c ) h = 0 k(a+x+x+c)-(x+c) h=0 k(a+x+x+c)−(x+c)h=0

括号内简化:

k ( a + 2 x + c ) − ( x + c ) h = 0 k(a+2 x+c)-(x+c) h=0 k(a+2x+c)−(x+c)h=0

嗯,这看起来有点复杂。也许还有另一种方法。

或者,因为总面积为 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,每部分必须是 ( a + c ) 4 h \frac{(a+c)}{4} h 4(a+c)h。所以:

对于下部梯形:

( a + x ) 2 k = ( a + c ) 4 h \frac{(a+x)}{2} k=\frac{(a+c)}{4} h 2(a+x)k=4(a+c)h

两边乘以2:

( a + x ) k = ( a + c ) 2 h (a+x) k=\frac{(a+c)}{2} h (a+x)k=2(a+c)h

同样,对于上部梯形:

( x + c ) 2 ( h − k ) = ( a + c ) 4 h \frac{(x+c)}{2}(h-k)=\frac{(a+c)}{4} h 2(x+c)(h−k)=4(a+c)h

两边乘以2:

( x + c ) ( h − k ) = ( a + c ) 2 h (x+c)(h-k)=\frac{(a+c)}{2} h (x+c)(h−k)=2(a+c)h

现在,注意到两个方程都等于 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,所以:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我这样表达:

k h − k = x + c a + x \frac{k}{h-k}=\frac{x+c}{a+x} h−kk=a+xx+c

这是高度片段和基底片段之间的比例。但如何关联 k k k 和 x x x ?

或者,也许使用相似三角形。等等,在梯形中,如果我们画一条平行于底边的线,该线的长度可以通过在两底之间进行线性插值找到,具体取决于离底边的距离。然而,由于面积既依赖于底边长度又依赖于高度,这种关系不是线性的而是二次的。

等等,我回想起一个公式:如果一条平行于底边的线将梯形分成两个面积相等的区域,那么该线的长度 x x x 是两底的几何平均值。等等,但几何平均值是 a c \sqrt{a c} ac。让我检查是否正确。

或者,可能是均方根。让我思考。假设面积比为1:1。让我们表示该线将高度划分为上方和下方面积相等的部分。假设原始梯形高度为 h h h,该线距离底部为 k k k。那么下方面积为 ( a + x ) 2 k \frac{(a+x)}{2} k 2(a+x)k,上方面积为 ( x + c ) 2 ( h − k ) \frac{(x+c)}{2}(h-k) 2(x+c)(h−k)。令两者相等:

( a + x ) 2 k = ( x + c ) 2 ( h − k ) \frac{(a+x)}{2} k=\frac{(x+c)}{2}(h-k) 2(a+x)k=2(x+c)(h−k)

两边乘以2:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

展开两边:

a k + x k = x h − x k + c h − c k a k+x k=x h-x k+c h-c k ak+xk=xh−xk+ch−ck

将所有项移到一侧:

a k + x k − x h + x k − c h + c k = 0 a k+x k-x h+x k-ch+c k=0 ak+xk−xh+xk−ch+ck=0

合并同类项:

( a k + c k ) + ( x k + x k ) − x h − c h = 0 (a k+c k)+(x k+x k)-x h-c h=0 (ak+ck)+(xk+xk)−xh−ch=0

提取公因式:

k ( a + c ) + 2 x k − x h − c h = 0 k(a+c)+2 x k-x h-c h=0 k(a+c)+2xk−xh−ch=0

从最后两项提取 h h h:

k ( a + c ) + x ( 2 k − h ) − c h = 0 k(a+c)+x(2 k-h)-c h=0 k(a+c)+x(2k−h)−ch=0

嗯,这并没有很好地简化。也许还有另一种方法。

或者,因为总面积为 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,每部分必须是 ( a + c ) 4 h \frac{(a+c)}{4} h 4(a+c)h。

所以,对于下部梯形:

( a + x ) 2 k = ( a + c ) 4 h \frac{(a+x)}{2} k=\frac{(a+c)}{4} h 2(a+x)k=4(a+c)h

两边乘以2 :

( a + x ) k = ( a + c ) 2 h (a+x) k=\frac{(a+c)}{2} h (a+x)k=2(a+c)h

同样,对于上部梯形:

( x + c ) 2 ( h − k ) = ( a + c ) 4 h \frac{(x+c)}{2}(h-k)=\frac{(a+c)}{4} h 2(x+c)(h−k)=4(a+c)h

两边乘以2 :

( x + c ) ( h − k ) = ( a + c ) 2 h (x+c)(h-k)=\frac{(a+c)}{2} h (x+c)(h−k)=2(a+c)h

现在,注意到两个方程都等于 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,所以:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我这样表达:

k h − k = x + c a + x \frac{k}{h-k}=\frac{x+c}{a+x} h−kk=a+xx+c

这是高度片段和基底片段之间的比例。但如何关联 k k k 和 x x x ?

或者,也许使用相似三角形。等等,在梯形中,如果我们画一条平行于底边的线,该线的长度可以通过在两底之间进行线性插值找到,具体取决于离底边的距离。然而,由于面积既依赖于底边长度又依赖于高度,这种关系不是线性的而是二次的。

等等,我回想起一个公式:如果一条平行于底边的线将梯形分成两个面积相等的区域,那么该线的长度 x x x 是两底的几何平均值。等等,但几何平均值是 a c \sqrt{a c} ac。让我检查是否正确。

或者,可能是均方根。让我思考。假设面积比为1:1。让我们表示该线将高度划分为上方和下方面积相等的部分。假设原始梯形高度为 h h h,该线距离底部为 k k k。那么下方面积为 ( a + x ) 2 k \frac{(a+x)}{2} k 2(a+x)k,上方面积为 ( x + c ) 2 ( h − k ) \frac{(x+c)}{2}(h-k) 2(x+c)(h−k)。令两者相等:

( a + x ) 2 k = ( x + c ) 2 ( h − k ) \frac{(a+x)}{2} k=\frac{(x+c)}{2}(h-k) 2(a+x)k=2(x+c)(h−k)

两边乘以2 :

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我们展开两边:

a k + x k = x h − x k + c h − c k a k+x k=x h-x k+c h-c k ak+xk=xh−xk+ch−ck

将所有项移到左侧:

a k + x k − x h + x k − c h + c k = 0 a k+x k-x h+x k-ch+c k=0 ak+xk−xh+xk−ch+ck=0

合并同类项:

( a k + c k ) + ( x k + x k ) − x h − c h = 0 (a k+c k)+(x k+x k)-x h-c h=0 (ak+ck)+(xk+xk)−xh−ch=0

提取公因式:

k ( a + c ) + 2 x k − x h − c h = 0 k(a+c)+2 x k-x h-c h=0 k(a+c)+2xk−xh−ch=0

让我们从最后两项提取 h h h:

k ( a + c ) + x ( 2 k − h ) − c h = 0 k(a+c)+x(2 k-h)-c h=0 k(a+c)+x(2k−h)−ch=0

嗯,这并没有很好地简化。也许还有另一种方法。

或者,因为整个面积为 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,每部分必须是 ( a + c ) 4 h \frac{(a+c)}{4} h 4(a+c)h。

所以,对于下部梯形:

( a + x ) 2 k = ( a + c ) 4 h \frac{(a+x)}{2} k=\frac{(a+c)}{4} h 2(a+x)k=4(a+c)h

两边乘以2 :

( a + x ) k = ( a + c ) 2 h (a+x) k=\frac{(a+c)}{2} h (a+x)k=2(a+c)h

对于上部:

( x + c ) 2 ( h − k ) = ( a + c ) 4 h \frac{(x+c)}{2}(h-k)=\frac{(a+c)}{4} h 2(x+c)(h−k)=4(a+c)h

两边乘以2 :

( x + c ) ( h − k ) = ( a + c ) 2 h (x+c)(h-k)=\frac{(a+c)}{2} h (x+c)(h−k)=2(a+c)h

现在,注意这两个方程等于 ( a + c ) 2 h \frac{(a+c)}{2} h 2(a+c)h,所以:

( a + x ) k = ( x + c ) ( h − k ) (a+x) k=(x+c)(h-k) (a+x)k=(x+c)(h−k)

让我们解出 k k k :

k = ( a + c ) h 2 ( a + x ) k=\frac{(a+c) h}{2(a+x)} k=2(a+x)(a+c)h

同样,从第二个方程:

h − k = ( a + c ) h 2 ( x + c ) h-k=\frac{(a+c) h}{2(x+c)} h−k=2(x+c)(a+c)h

因此, k = h − ( a + c ) h 2 ( x + c ) k=h-\frac{(a+c) h}{2(x+c)} k=h−2(x+c)(a+c)h

将这两个关于 k k k 的表达式设为相等:

( a + c ) h 2 ( a + x ) = h − ( a + c ) h 2 ( x + c ) \frac{(a+c) h}{2(a+x)}=h-\frac{(a+c) h}{2(x+c)} 2(a+x)(a+c)h=h−2(x+c)(a+c)h

两边除以 h h h :

( a + c ) 2 ( a + x ) = 1 − ( a + c ) 2 ( x + c ) \frac{(a+c)}{2(a+x)}=1-\frac{(a+c)}{2(x+c)} 2(a+x)(a+c)=1−2(x+c)(a+c)

两边乘以2以消除分母:

( a + c ) ( a + x ) = 2 − ( a + c ) ( x + c ) \frac{(a+c)}{(a+x)}=2-\frac{(a+c)}{(x+c)} (a+x)(a+c)=2−(x+c)(a+c)

让我们表示 S = a + c S=a+c S=a+c 以简化符号。然后:

S a + x = 2 − S x + c \frac{S}{a+x}=2-\frac{S}{x+c} a+xS=2−x+cS

将所有项移到一侧:

S a + x + S x + c = 2 \frac{S}{a+x}+\frac{S}{x+c}=2 a+xS+x+cS=2

提取公因式5 :

S ( 1 a + x + 1 x + c ) = 2 S\left(\frac{1}{a+x}+\frac{1}{x+c}\right)=2 S(a+x1+x+c1)=2

合并分数:

S ⋅ ( x + c ) + ( a + x ) ( a + x ) ( x + c ) = 2 S \cdot \frac{(x+c)+(a+x)}{(a+x)(x+c)}=2 S⋅(a+x)(x+c)(x+c)+(a+x)=2

简化分子:

( x + c + a + x ) = ( 2 x + a + c ) (x+c+a+x)=(2 x+a+c) (x+c+a+x)=(2x+a+c)

所以:

S ⋅ 2 x + a + c ( a + x ) ( x + c ) = 2 S \cdot \frac{2 x+a+c}{(a+x)(x+c)}=2 S⋅(a+x)(x+c)2x+a+c=2

因为 S = a + c S=a+c S=a+c,代入回去:

( a + c ) ⋅ 2 x + a + c ( a + x ) ( x + c ) = 2 (a+c) \cdot \frac{2 x+a+c}{(a+x)(x+c)}=2 (a+c)⋅(a+x)(x+c)2x+a+c=2

两边乘以 ( a + x ) ( x + c ) (a+x)(x+c) (a+x)(x+c) :

( a + c ) ( 2 x + a + c ) = 2 ( a + x ) ( x + c ) (a+c)(2 x+a+c)=2(a+x)(x+c) (a+c)(2x+a+c)=2(a+x)(x+c)

展开两边:

左边: ( a + c ) ( 2 x ) + ( a + c ) 2 = 2 x ( a + c ) + ( a + c ) 2 (a+c)(2 x)+(a+c)^{2}=2 x(a+c)+(a+c)^{2} (a+c)(2x)+(a+c)2=2x(a+c)+(a+c)2

右边: 2 ( a x + a c + x 2 + x c ) = 2 a x + 2 a c + 2 x 2 + 2 x c 2\left(a x+a c+x^{2}+x c\right)=2 a x+2 a c+2 x^{2}+2 x c 2(ax+ac+x2+xc)=2ax+2ac+2x2+2xc

从右边减去左边:

2 a x + 2 a c + 2 x 2 + 2 x c − [ 2 x ( a + c ) + ( a + c ) 2 ] = 0 2 a x+2 a c+2 x^{2}+2 x c-\left[2 x(a+c)+(a+c)^{2}\right]=0 2ax+2ac+2x2+2xc−[2x(a+c)+(a+c)2]=0

展开 2 x ( a + c ) : 2 a x + 2 c x 2 x(a+c): 2 a x+2 c x 2x(a+c):2ax+2cx

展开 ( a + c ) 2 : a 2 + 2 a c + c 2 (a+c)^{2}: a^{2}+2 a c+c^{2} (a+c)2:a2+2ac+c2

所以:

2 a x + 2 a c + 2 x 2 + 2 c x − 2 a x − 2 c x − a 2 − 2 a c − c 2 = 0 2 a x+2 a c+2 x^{2}+2 c x-2 a x-2 c x-a^{2}-2 a c-c^{2}=0 2ax+2ac+2x2+2cx−2ax−2cx−a2−2ac−c2=0

逐项简化:

-

2

a

x

−

2

a

x

=

0

−

2

c

x

−

2

c

x

=

0

−

2

a

c

−

2

a

c

=

0

2 a x-2 a x=0-2 c x-2 c x=0-2 a c-2 a c=0

2ax−2ax=0−2cx−2cx=0−2ac−2ac=0 - 剩余项:

2

x

2

−

a

2

−

c

2

2 x^{2}-a^{2}-c^{2}

2x2−a2−c2

因此:

2 x 2 − a 2 − c 2 = 0 2 x^{2}-a^{2}-c^{2}=0 2x2−a2−c2=0

所以:

2 x 2 = a 2 + c 2 2 x^{2}=a^{2}+c^{2} 2x2=a2+c2

因此:

x = a 2 + c 2 2 x=\sqrt{\frac{a^{2}+c^{2}}{2}} x=2a2+c2

啊! 所以长度 x x x 是两底的均方根(RMS)。这很有趣。所以无论高度如何,将面积平分的线的长度等于两底的RMS。

等等,但让我验证这个结论。因为在推导时,我得出 2 x 2 = a 2 + c 2 2 x^{2}=a^{2}+c^{2} 2x2=a2+c2,所以 x = a 2 + c 2 2 x=\sqrt{\frac{a^{2}+c^{2}}{2}} x=2a2+c2。这基于代数似乎是正确的。

但让我们用之前找到的值检查一下。我们有 a = 75 , c = 175 a=75, c=175 a=75,c=175。

所以 x = 7 5 2 + 17 5 2 2 x=\sqrt{\frac{75^{2}+175^{2}}{2}} x=2752+1752。

计算那个:

75的平方是5625,175的平方是30625 。总和是 5625 + 30625 = 36250 5625+30625=36250 5625+30625=36250。除以2 :

18125。所以 x = 18125 x=\sqrt{18125} x=18125。

计算

18125

\sqrt{18125}

18125 :

嗯,18125除以25是725 。所以

25

⋅

725

=

5

725

\sqrt{25 \cdot 725}=5 \sqrt{725}

25⋅725=5725。

现在,

725

\sqrt{725}

725。让我们看看,

25

⋅

29

=

725

25 \cdot 29=725

25⋅29=725。所以

725

=

5

29

\sqrt{725}=5 \sqrt{29}

725=529。因此,

18125 = 5 ⋅ 5 ⋅ 29 = 25 29 \sqrt{18125}=5 \cdot 5 \cdot \sqrt{29}=25 \sqrt{29} 18125=5⋅5⋅29=2529

等等,

725

=

25

⋅

29

=

5

29

\sqrt{725}=\sqrt{25 \cdot 29}=5 \sqrt{29}

725=25⋅29=529。所以确实,

18125

=

5

⋅

725

=

5

⋅

(

5

29

)

=

\sqrt{18125}=5 \cdot \sqrt{725}=5 \cdot(5 \sqrt{29})=

18125=5⋅725=5⋅(529)=

25

29

25 \sqrt{29}

2529。

但让我计算数值:

29

≈

5.385164807

\sqrt{29} \approx 5.385164807

29≈5.385164807

所以

25

⋅

5.385164807

≈

25

⋅

5.385

≈

134.629

25 \cdot 5.385164807 \approx 25 \cdot 5.385 \approx 134.629

25⋅5.385164807≈25⋅5.385≈134.629

因此,

x

≈

134.629

x \approx 134.629

x≈134.629

然后,

x 2 100 = 18125 100 = 181.25 \frac{x^{2}}{100}=\frac{18125}{100}=181.25 100x2=10018125=181.25

不超过181.25的最大整数是181 。所以答案应该是181 ,以框形式表示为181 。

等等,但让我确认公式

x

=

a

2

+

c

2

2

x=\sqrt{\frac{a^{2}+c^{2}}{2}}

x=2a2+c2 是否确实正确。因为我推导时得出了

2

x

2

=

a

2

+

c

2

2 x^{2}=a^{2}+c^{2}

2x2=a2+c2,所以

x

=

a

2

+

c

2

2

x=\sqrt{\frac{a^{2}+c^{2}}{2}}

x=2a2+c2。基于代数,这似乎是正确的。

但让我们用简单的例子验证一下。假设

a

=

c

a=c

a=c,那么

x

x

x 应该等于

a

a

a (因为梯形变成矩形,将面积平分的线将是中线,与底边相同)。代入公式:

x = a 2 + a 2 2 = 2 a 2 2 = a 2 = a x=\sqrt{\frac{a^{2}+a^{2}}{2}}=\sqrt{\frac{2 a^{2}}{2}}=\sqrt{a^{2}}=a x=2a2+a2=22a2=a2=a

正确。

另一个例子:假设

a

=

0

,

c

=

2

h

a=0, c=2 h

a=0,c=2h(等等,不对,

a

a

a 和

c

c

c 是底边,与高度无关)。如果一个底边为0 ,梯形就变成了三角形。等等,但一个底边为0的梯形是一个三角形。让我看看。如果

a

=

0

,

c

=

c

a=0, c=c

a=0,c=c,那么

x

x

x 将是将三角形分成两个相等面积区域的线。对于三角形,将面积平分的线在距底边高度为

h

2

\frac{h}{\sqrt{2}}

2h 处,该线的长度为

c

⋅

1

2

c \cdot \sqrt{\frac{1}{2}}

c⋅21。但根据公式,

x = 0 + c 2 2 = c 2 x=\sqrt{\frac{0+c^{2}}{2}}=\frac{c}{\sqrt{2}} x=20+c2=2c

这与预期一致。所以这验证了。

因此,公式在边缘情况也成立。因此,我们的解决方案是正确的。

<

/

</

</ 思考

>

>

>

给定一个梯形,底边为

b

b

b和

b

+

100

b+100

b+100,其中连接两腿中点的线段将梯形分成面积比为

2

:

3

2: 3

2:3的两个区域,我们需要找到将梯形分成两个相等面积的线段长度

x

x

x,并计算不超过

x

2

100

\frac{x^{2}}{100}

100x2的最大整数。

1. 确定底边:

-

中线(连接两腿中点的线段)长度为 b + 50 b+50 b+50。

-

- 由中线形成的两个区域的面积比为2:3。建立比例如下:

b + 25 b + 75 = 2 3 \frac{b+25}{b+75}=\frac{2}{3} b+75b+25=32

- 由中线形成的两个区域的面积比为2:3。建立比例如下:

-

解得 b = 75 b=75 b=75。因此,底边为75和175 。

-

找到等面积线段的长度 x x x:

x = 7 5 2 + 17 5 2 2 = 5625 + 30625 2 = 18125 x 2 = 18125 \begin{gathered} x=\sqrt{\frac{75^{2}+175^{2}}{2}}=\sqrt{\frac{5625+30625}{2}}=\sqrt{18125} \\ x^{2}=18125 \end{gathered} x=2752+1752=25625+30625=18125x2=18125 -

计算不超过 x 2 100 \frac{x^{2}}{100} 100x2的最大整数;

x 2 100 = 18125 100 = 181.25 \frac{x^{2}}{100}=\frac{18125}{100}=181.25 100x2=10018125=181.25

不超过此值的最大整数为181 。

因此,最终答案为181 。

但为了彻底验证,让我们用一个简单例子验证公式。假设

a

=

c

a=c

a=c,那么

x

x

x应该等于

a

a

a(因为梯形是矩形,将面积平分的线将是中线,与底边相同)。代入公式:

x = a 2 + a 2 2 = 2 a 2 2 = a 2 = a x=\sqrt{\frac{a^{2}+a^{2}}{2}}=\sqrt{\frac{2 a^{2}}{2}}=\sqrt{a^{2}}=a x=2a2+a2=22a2=a2=a

正确。

另一个例子:假设

a

=

0

,

c

=

2

h

a=0, c=2 h

a=0,c=2h(等等,不对,

a

a

a 和

c

c

c 是底边,与高度无关)。如果一个底边为0 ,梯形就变成了三角形。等等,但一个底边为0的梯形是一个三角形。让我看看。如果

a

=

0

,

c

=

c

a=0, c=c

a=0,c=c,那么

x

x

x将是将三角形分成两个相等面积区域的线。对于三角形,将面积平分的线在距底边高度为

h

2

\frac{h}{\sqrt{2}}

2h处,该线的长度为

c

⋅

1

2

c \cdot \sqrt{\frac{1}{2}}

c⋅21。但根据公式,

x = 0 + c 2 2 = c 2 x=\sqrt{\frac{0+c^{2}}{2}}=\frac{c}{\sqrt{2}} x=20+c2=2c

这与预期一致。所以这验证了。

因此,公式在边缘情况也成立。因此,我们的解决方案是正确的。

<

/

</

</ 思考

>

>

>

给定一个梯形,底边为

b

b

b和

b

+

100

b+100

b+100,其中连接两腿中点的线段将梯形分成面积比为

2

:

3

2: 3

2:3的两个区域,我们需要找到将梯形分成两个相等面积的线段长度

x

x

x,并计算不超过

x

2

100

\frac{x^{2}}{100}

100x2的最大整数。

1. 确定底边:

-

中线(连接两腿中点的线段)长度为 b + 50 b+50 b+50。

-

- 由中线形成的两个区域的面积比为2:3。建立比例如下:

b + 25 b + 75 = 2 3 \frac{b+25}{b+75}=\frac{2}{3} b+75b+25=32

- 由中线形成的两个区域的面积比为2:3。建立比例如下:

-

解得 b = 75 b=75 b=75。因此,底边为75和175 。

-

找到等面积线段的长度 x x x:

x = 7 5 2 + 17 5 2 2 = 5625 + 30625 2 = 18125 x 2 = 18125 \begin{gathered} x=\sqrt{\frac{75^{2}+175^{2}}{2}}=\sqrt{\frac{5625+30625}{2}}=\sqrt{18125} \\ x^{2}=18125 \end{gathered} x=2752+1752=25625+30625=18125x2=18125 -

计算不超过 x 2 100 \frac{x^{2}}{100} 100x2的最大整数;

x 2 100 = 18125 100 = 181.25 \frac{x^{2}}{100}=\frac{18125}{100}=181.25 100x2=10018125=181.25

不超过此值的最大整数为181 。

因此,最终答案为181 。

参考论文:https://arxiv.org/pdf/2504.09772

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?