沙玉阳

1

{ }^{1}

1, 潘宏欣

1

{ }^{1}

1, 徐伟

1

{ }^{1}

1, 孟威宇

1

{ }^{1}

1, 罗刚

1

{ }^{1}

1, 杜新宇

2

{ }^{2}

2, 翟晓兵

1

{ }^{1}

1, 董汉辉 Y.

1

{ }^{1}

1, 石彩娟

3

{ }^{3}

3, 李克锋

1

∗

{ }^{1 *}

1∗

1

{ }^{1}

1 澳门城市大学应用科学学院人工智能驱动药物发现中心,澳门,999708,中国

2

{ }^{2}

2 中国河北沧州市泊头医院牙科部,河北,062150,中国

3

{ }^{3}

3 华北科技大学人工智能学院,河北唐山,063210,中国

- 通讯作者李克锋,博士。

-

- 邮箱: kefengl@mpu.edu.mo

摘要

重度抑郁症(MDD)影响全球超过3亿人,凸显了重要的公共卫生问题。然而,医疗资源分布不均和诊断方法的复杂性导致许多国家和地区对该疾病的关注不足。本文介绍了一种高性能的MDD诊断工具——MDD-LLM,这是一种基于AI的框架,利用微调的大规模语言模型(LLMs)和大量真实世界样本解决MDD诊断中的挑战。因此,我们从UK Biobank队列中选取了274,348条个人数据以训练和评估所提出的方法。具体来说,我们从UK Biobank队列中选择了274,348条个人记录,并设计了一种表格数据转换方法来创建一个大型语料库,用于训练和评估该方法。为了说明MDD-LLM的优势,我们进行了全面实验,并在多个评估指标上与现有模型解决方案进行了比较分析。实验结果显示,MDD-LLM (70B) 达到了0.8378的准确率和0.8919的AUC值(95%置信区间:0.8799-0.9040),显著优于现有的机器学习和深度学习框架。鉴于LLMs在MDD诊断中的研究有限,我们探讨了可能影响所提方法性能的多种因素,如表格数据转换技术和不同的微调策略。此外,我们还分析了模型的可解释性,要求MDD-LLM解释其预测并提供相应的原因。本文研究了LLMs和大规模训练数据在MDD诊断中的应用。结果表明,基于LLMs的方案在准确性、鲁棒性和可解释性方面具有显著潜力,相较于传统的模型解决方案。

关键词:重度抑郁症,大规模语言模型,人工智能,模型微调,医疗数据处理。

1. 引言

重度抑郁症(MDD)是一种严重的精神健康状况,通常对个人的日常生活、职业表现和身体健康产生不利影响 [1]。世界卫生组织(WHO)估计全球有超过3亿人受到MDD的影响 [2]。研究表明,超过70%的自杀或自残行为与MDD相关 [3]。目前,MDD被认为是第二大健康问题。研究 [4] 预测到2030年左右,MDD将成为全球首要的健康状况。尽管投入了大量资源研究MDD的病因、诊断和治疗,但这些领域的进展仍低于预期。在某些地区,MDD患者可能面临文化和经济障碍,限制了他们获得适当治疗的机会 [5]。开发MDD的诊断技术是一个关键的研究课题,强调了其重要的学术和实践价值。目前,大多数MDD的诊断方法依赖于标准化量表,

例如患者健康问卷-9(PHQ-9)和汉密尔顿抑郁量表(HDRS)[6]。然而,这些诊断方法需要患者的主动合作,且结果容易受到各种外部因素的影响。因此,一些研究试图构建独立于量表的MDD诊断方案。例如,Watts等人 [7] 开发了一种基于脑电图的机器学习方法来预测MDD风险因素。同样,Pan等人 [8] 利用代谢网络结合先进的深度学习技术来识别分类MDD的特征。此外,一些研究人员 [9-12] 正在探索通过整合MRI、分子技术和各种信号等多模态信息来更有效地识别MDD的诊断解决方案。虽然这些方法旨在从多个角度创建高效的MDD诊断框架,但仍面临各种挑战。例如,大多数基于模型的MDD诊断框架是数据驱动的,这意味着其有效性高度依赖于提供的训练数据的数量和质量。然而,在医学领域获取足够的数据往往很困难,特别是对于某些罕见疾病 [13]。

尽管MDD的确切发病机制尚不清楚,但广泛的研究已经考察了与MDD相关的生物和社会因素之间的相互作用。例如,Blundell等人 [14] 建立了体重指数(BMI)与MDD之间的关联。通过对回顾性队列数据进行分析,研究人员证明肥胖者经常表现出更高的MDD风险。Darling等人 [15] 考察了工作压力与MDD之间的联系,显示长期和高强度的工作条件会增加抑郁的可能性。此外,多项因素 [16, 17] 如收入、职业、教育水平和婚姻状况已被发现与MDD的患病率相关。然而,当前基于模型的MDD诊断方案难以有效利用这些先验知识。随着人工智能技术的不断进步,基础大型语言模型(LLMs)得到了快速发展,在许多自然语言处理任务中表现出相当大的潜力 [18, 19]。因此,研究人员正在探索将LLMs应用于医学领域,并在医疗报告生成 [20]、健康诊断聊天机器人 [21] 和临床AI代理 [22] 等任务中取得了有希望的结果。现有的LLMs经过大量样本的训练,能够理解和生成自然语言。例如,LLMs可以理解糖尿病对人体的危害并识别血压的正常范围 [23]。相比之下,传统的基于模型的解决方案 [24-26] 如卷积神经网络(CNN)、长短期记忆网络(LSTM)和XGBoost通常缺乏这种能力。此外,LLMs在处理医学任务时具有几个优势。数据清理在医学领域至关重要,通常需要对外出值和缺失值进行复杂的处理。幸运的是,LLMs在这方面表现出色,使其特别适合医学应用 [27]。此外,基于LLMs的解决方案主要依赖于对话交互,有助于理解输入信息并有效阐明生成的结果。因此,由LLMs驱动的医学模型提供了更强的可解释性和更大的发展潜力。

在本文中,我们提出了一种高性能的MDD诊断工具——MDDLLM。该方案结合经典的LLMs和参数高效微调技术,以提高诊断的准确性和效率。一般来说,微调LLMs需要大量的高质量训练样本。为了解决这一挑战,我们从UK Biobank队列 [28] 中选择了274,348条个人记录,并设计了一种表格数据转换方法,以创建一个大型语料库用于训练和评估所提出的方案。在微调阶段,LLMs需要从输入信息中学习,判断个人是否患有MDD,并提供该判断的概率。为了证明我们所提出方法的有效性,我们还在同一数据集上实现了几种基于分类模型的MDD诊断方法,包括ResNet1D [29]、多层感知机(MLP)、XGBoost和随机森林(RF)。实验结果显示,所提出的MDD-LLM (70B) 达到了0.8378的准确率和0.8919的AUC值(95%置信区间:0.8799-0.9040),显著优于现有的机器学习和深度学习框架。此外,我们还探讨了可能影响MDD-LLM性能的各种因素,如表格数据转换技术、不同的微调策略和处理缺失特征的有效性。此外,我们设计了实验来评估模型的可解释性,并开发了一个图形用户界面以增强我们所提出的MDD-LLM的可用性。

2. 材料与方法

2.1 数据集。

大型语言模型(LLMs)的训练过程通常涉及两个阶段:预训练和监督微调(SFT)。本文重点在于SFT阶段,强调训练数据数量和质量的重要性。在医学领域,数据收集和组织一直是一个重大挑战。医学相关任务的数据收集和组织通常需要解决许多挑战。幸运的是,UK Biobank队列 [28] 提供了大量的医学数据,特别是在MDD诊断方面,这成为本文实验和分析的主要资源。

UK Biobank是一项大规模的前瞻性队列研究,于2006年至2010年间招募了超过500,000名年龄在40至69岁之间的个体。该项目在英格兰、威尔士和苏格兰的22个评估中心进行。参与者的健康信息、医院记录、尿液和血液生物标志物以及遗传数据通过触摸屏问卷和口头访谈收集。所有参与者在招募时都提供了电子知情同意书。在本研究中,MDD的表型定义使用《国际疾病统计分类及有关健康问题第10次修订本》(ICD-10)代码F32,对应抑郁发作 [30]。此定义还包括评估期间自我报告的情况,如数据字段20433和20434中所述。我们的研究包括274,348名参与者,其中12,715名被诊断为MDD,261,633名为对照组。UK Biobank的基础特征见表1。

表1. 参与人群的基础特征。

| 特征 | HC ( n = 261 , 633 ) \boldsymbol{n = 2 6 1 , 6 3 3 )} n=261,633) | MDD ( n = 12 , 715 ) \boldsymbol{n = 1 2 , 7 1 5 )} n=12,715) | P \boldsymbol{P} P 值 |

|---|---|---|---|

| 年龄 | 61 ( 53 − 66 ) 61(53-66) 61(53−66) | 57 ( 50 − 63 ) 57(50-63) 57(50−63) | < 0.001 <0.001 <0.001 |

| BMI | 26.96 ( 24.35 − 30.12 ) 26.96(24.35-30.12) 26.96(24.35−30.12) | 26.84 ( 24.03 − 30.23 ) 26.84(24.03-30.23) 26.84(24.03−30.23) | 0.051 |

| HDL胆固醇 | 0.13 ( 0.61 − 0.33 ) 0.13(0.61-0.33) 0.13(0.61−0.33) | 0.13 ( 0.62 − 0.33 ) 0.13(0.62-0.33) 0.13(0.62−0.33) | 0.124 |

| 临床LDL胆固醇 | − 0.05 ( 0.64 − 0.70 ) -0.05(0.64-0.70) −0.05(0.64−0.70) | − 0.05 ( 0.63 − 0.70 ) -0.05(0.63-0.70) −0.05(0.63−0.70) | 0.843 |

| 总胆固醇 | − 0.03 ( 0.64 − 0.68 ) -0.03(0.64-0.68) −0.03(0.64−0.68) | − 0.04 ( 0.62 − 0.67 ) -0.04(0.62-0.67) −0.04(0.62−0.67) | 0.664 |

| 甘油三酯 | − 0.20 ( 0.42 − 0.62 ) -0.20(0.42-0.62) −0.20(0.42−0.62) | − 0.20 ( 0.41 − 0.61 ) -0.20(0.41-0.61) −0.20(0.41−0.61) | 0.684 |

| 睡眠时间,中位数 | 7 ( 6 − 8 ) 7(6-8) 7(6−8) | 7 ( 6 − 8 ) 7(6-8) 7(6−8) | < 0.001 <0.001 <0.001 |

| 性别 (%) | < 0.001 <0.001 <0.001 | ||

| 女性 | 140 , 980 ( 53.88 ) 140,980(53.88) 140,980(53.88) | 8 , 081 ( 63.55 ) 8,081(63.55) 8,081(63.55) | |

| 男性 | 120 , 653 ( 46.12 ) 120,653(46.12) 120,653(46.12) | 4 , 634 ( 36.45 ) 4,634(36.45) 4,634(36.45) | |

| 失眠 (%) | < 0.001 <0.001 <0.001 | ||

| 经常 | 72 , 840 ( 27.84 ) 72,840(27.84) 72,840(27.84) | 4439 ( 34.91 ) 4439(34.91) 4439(34.91) | |

| 有时 | 124 , 256 ( 47.49 ) 124,256(47.49) 124,256(47.49) | 5940 ( 46.71 ) 5940(46.71) 5940(46.71) | |

| 从未 | 63 , 741 ( 24.36 ) 63,741(24.36) 63,741(24.36) | 2309 ( 18.16 ) 2309(18.16) 2309(18.16) | |

| 缺失值 | 796 ( 0.31 ) 796(0.31) 796(0.31) | 27 ( 0.22 ) 27(0.22) 27(0.22) | |

| 饮酒频率 (%) | < 0.001 <0.001 <0.001 | ||

| 经常 | 52 , 847 ( 20.20 ) 52,847(20.20) 52,847(20.20) | 2 , 417 ( 19.01 ) 2,417(19.01) 2,417(19.01) | |

| 有时 | 187 , 034 ( 71.48 ) 187,034(71.48) 187,034(71.48) | 9 , 189 ( 72.30 ) 9,189(72.30) 9,189(72.30) | |

| 从未 | 20 , 961 ( 8.02 ) 20,961(8.02) 20,961(8.02) | 1 , 067 ( 8.39 ) 1,067(8.39) 1,067(8.39) | |

| 缺失值 | 791 ( 0.30 ) 791(0.30) 791(0.30) | 42 ( 0.30 ) 42(0.30) 42(0.30) | |

| 自我伤害行为 (%) | < 0.001 <0.001 <0.001 | ||

| 是 | 3 , 189 ( 1.21 ) 3,189(1.21) 3,189(1.21) | 597 ( 4.69 ) 597(4.69) 597(4.69) | |

| 否 | 74 , 140 ( 28.33 ) 74,140(28.33) 74,140(28.33) | 7 , 831 ( 61.58 ) 7,831(61.58) 7,831(61.58) | |

| 未回答 | 211 ( 0.08 ) 211(0.08) 211(0.08) | 31 ( 0.24 ) 31(0.24) 31(0.24) | |

| 缺失值 | 184 , 083 ( 70.38 ) 184,083(70.38) 184,083(70.38) | 4 , 256 ( 33.49 ) 4,256(33.49) 4,256(33.49) | |

| 教育水平 (%) | 0.292 | ||

| 低 | 44 , 503 ( 17.01 ) 44,503(17.01) 44,503(17.01) | 2 , 189 ( 17.22 ) 2,189(17.22) 2,189(17.22) | |

| 中 | 128 , 017 ( 48.93 ) 128,017(48.93) 128,017(48.93) | 6 , 236 ( 49.05 ) 6,236(49.05) 6,236(49.05) | |

| 高 | 83 , 827 ( 32.04 ) 83,827(32.04) 83,827(32.04) | 4 , 039 ( 31.69 ) 4,039(31.69) 4,039(31.69) | |

| 缺失值 | 5316 ( 2.03 ) 5316(2.03) 5316(2.03) | 260 ( 2.04 ) 260(2.04) 260(2.04) | |

| 收入 (%) | 0.608 | ||

| 低 | 52 , 023 ( 19.88 ) 52,023(19.88) 52,023(19.88) | 2 , 558 ( 20.11 ) 2,558(20.11) 2,558(20.11) | |

| 中 | 159 , 755 ( 61.07 ) 159,755(61.07) 159,755(61.07) | 7773 ( 61.46 ) 7773(61.46) 7773(61.46) | |

| 高 | 11 , 273 ( 4.30 ) 11,273(4.30) 11,273(4.30) | 567 ( 4.14 ) 567(4.14) 567(4.14) | |

| 缺失值 | 38 , 582 ( 14.75 ) 38,582(14.75) 38,582(14.75) | 1 , 817 ( 14.29 ) 1,817(14.29) 1,817(14.29) | |

| 就业状态 (%) | 0.652 | ||

| 就业 | 149 , 026 ( 56.96 ) 149,026(56.96) 149,026(56.96) | 7 , 275 ( 57.08 ) 7,275(57.08) 7,275(57.08) | |

| 未就业 | 108 , 525 ( 41.48 ) 108,525(41.48) 108,525(41.48) | 5 , 238 ( 41.20 ) 5,238(41.20) 5,238(41.20) | |

| :– | :–: | :–: | |

| 其他状态 | 2 , 616 ( 1.00 ) 2,616(1.00) 2,616(1.00) | 139 ( 1.11 ) 139(1.11) 139(1.11) | |

| 缺失值 | 1 , 466 ( 0.56 ) 1,466(0.56) 1,466(0.56) | 81 ( 0.61 ) 81(0.61) 81(0.61) |

- 缩写:BMI,身体质量指数,计算方式为体重(公斤)除以身高(米)的平方。

教育:低(无相关资格);中(A级、AS级或同等学历;O级、GCSE或同等学历;CSE或同等学历;NVQ或HND或HNC或同等学历;以及其他专业资格);高(学院或大学学位)。

收入定义为税前家庭总收入平均值:低(少于£18,000);中(£18,000至£30,999;£31,000至£51,999和£52,000至£100,000);高(大于£100,000)。

当前就业状态:就业(有薪就业或自营职业及全职或兼职学生);未就业(退休;因病或残疾无法工作;失业并在照顾家庭或孩子);其他状态(从事无偿或志愿工作及其他上述情况以外的状态)。

2.2 表格数据处理

与其它医学数据集类似,UK Biobank中的大多数数据以表格形式组织。然而,当前的LLMs难以直接处理表格数据。因此,有必要将表格信息转换为LLMs可以理解的指令提示。我们提出了三种表格数据对话方法,包括文本模板、列表模板和GPT生成模板。具体而言,列表模板采用简单的格式进行数据转换,例如“{ 特征名称 特征名称 特征名称} is { 值 值 值}。” 文本模板比列表模板更为复杂,需要根据不同的特征名称创建多个简短句子。GPT生成模板利用ChatGPT API,允许在线ChatGPT模型将输入的表格数据转换为描述性文本。这些对话方法的详细信息见附录S1。例如,我们利用表2中的数据作为案例研究进行文本模板的数据转换。

表2. 表格数据对话的一个示例。

| 年龄 | BMI | 失眠 | 睡眠时间 | 饮酒 | 自我伤害 | 就业状态 |

|---|---|---|---|---|---|---|

| 60 | 24.5018 | 有时 | 6小时 | 每周3次 | 从未 | 有偿就业 |

| 工作时间 | 教育 | 收入 | HDLC | CLDLC | TG | TC |

| 38小时/周 | O级 | 45000 | 2.075 | 2.6077 | 1.334 | 4.7848 |

通过文本模板方法生成的提示样例如下所示:

“instruction”: “预测患者是否患有重度抑郁症?是或否?请仅以是或否回答,不要给出任何额外信息。”

“input”: “年龄是60岁,性别是女性,体质指数(BMI)是

24.5018

k

g

/

m

∧

2

24.5018 \mathrm{~kg} / \mathrm{m}^{\wedge} 2

24.5018 kg/m∧2,有时失眠,睡眠时间是6小时,每周饮酒三次,从未自残,就业状态是有偿就业,收入是45000英镑,每周工作38小时,教育程度是O级,没有长期疾病,高密度脂蛋白胆固醇是

2.075

m

m

o

l

/

l

2.075 \mathrm{mmol} / \mathrm{l}

2.075mmol/l,临床低密度脂蛋白胆固醇是

2.6077

m

m

o

l

/

l

2.6077 \mathrm{mmol} / \mathrm{l}

2.6077mmol/l,甘油三酯是

1.334

m

m

o

l

/

l

1.334 \mathrm{mmol} / \mathrm{l}

1.334mmol/l,总胆固醇是

4.7848

m

m

o

l

/

l

4.7848 \mathrm{mmol} / \mathrm{l}

4.7848mmol/l。”,

“output”: “是”

在此背景下,“instruction”指的是提供的系统提示,“input”表示从表格数据转换而来的信息,“output”表示我们期望模型输出的结果。特别是,模型不仅应提供相应的答案,还应提供该答案的相关概率。该概率作为一个风险评分,可以通过指标来评估模型的区分能力。此外,表格数据的多种转换可能会显著影响我们所提出的MDD-LLM的结果。在实验部分,我们将对这些不同转换方法的有效性进行全面讨论。

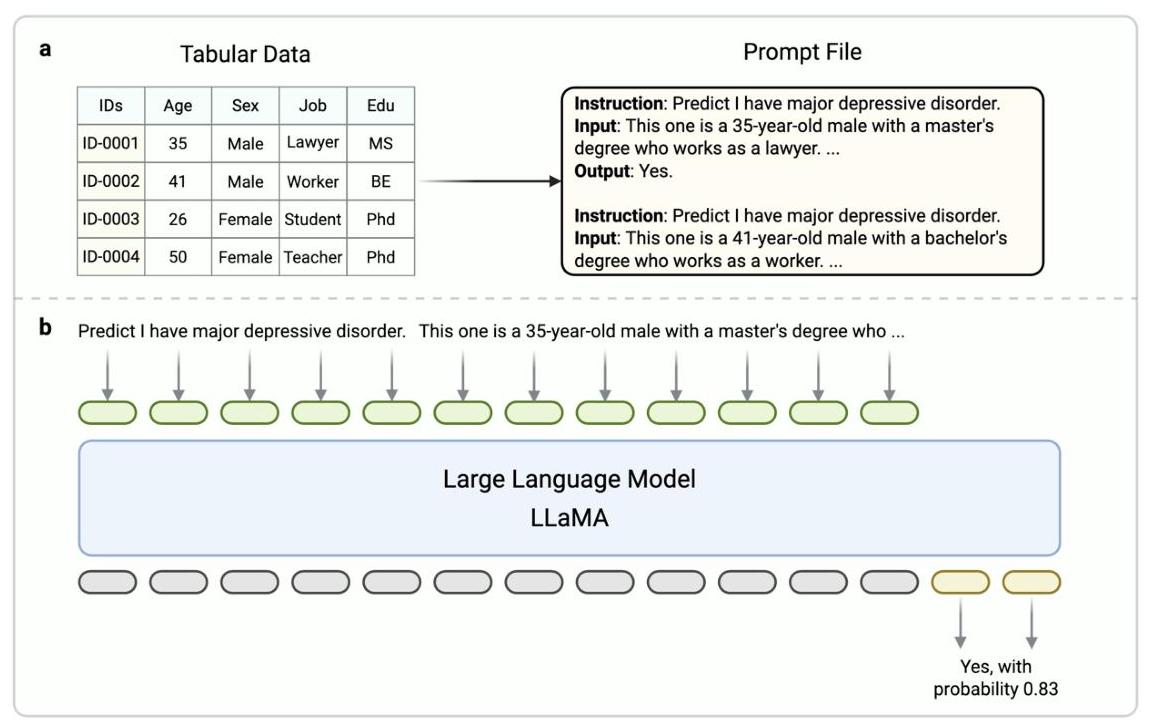

图1. 我们提出的方法结构。图1a展示了表格数据转换过程。图1b定义了MDD-LLM的概述。生成的提示信息被标记化并嵌入到令牌嵌入空间中。然后,所提出的MDDLLM应根据输入给出预测结果和概率。

2.3 提出的方法

为了实现MDD诊断的最佳解决方案,有必要使用高质量数据对适当的LLMs进行微调,以增强模型在心理学方面的能力。本文的任务可以简化为一个特殊的分类问题。作为关键组成部分,LLM应理解转换后的提示指令,并提供精确的预测结果及其相应的概率。所提出的MDD-LLM架构如图1所示。我们发现,LLM分词器首先将输入的文本信息转换为模型可理解的令牌。随后,这些令牌通过LLM的核心架构进行特征提取。经过自注意力和交叉注意力机制处理后,我们获得了更具区分性的表示。最终,模型应使用这些特征来预测结果,并以请求的格式呈现结果。具体而言,所有输入提示的文本组件必须通过MDD-LLM的分词器和词嵌入层进行标记化和嵌入,然后输入解码器。解码过程可以概括如下:

r t p = f ( P , r 1 : t − 1 p ) r_{t}^{p}=f\left(P, r_{1: t-1}^{p}\right) rtp=f(P,r1:t−1p)

其中 r t p ∈ V r_{t}^{p} \in \mathbb{V} rtp∈V是步骤 t t t的预测令牌, V \mathbb{V} V定义词汇集。预测结果可以表示为 R p = { r 1 p , r 2 p , … , r T p } R^{p}=\left\{r_{1}^{p}, r_{2}^{p}, \ldots, r_{T}^{p}\right\} Rp={r1p,r2p,…,rTp}, T T T是生成诊断结果的长度。语言建模损失定义如下:

L L L M = − ∑ t = 1 T log p ( r t p ∣ P , r 1 : t − 1 p ) \mathcal{L}_{L L M}=-\sum_{t=1}^{T} \log p\left(r_{t}^{p} \mid P, r_{1: t-1}^{p}\right) LLLM=−t=1∑Tlogp(rtp∣P,r1:t−1p)

本文旨在基于LLMs开发一种专业的MDD诊断解决方案。为此,必须纳入大量与抑郁症相关的高质量现实世界数据,以有效微调我们提出的方法。采用不同的技术也可以显著影响LLMs参数高效微调任务中的模型性能。已经提出了许多不同的大模型微调方案,如LoRA [31]、Q-LoRA [32]、Prefix Tuning [33] 和Adapter Tuning [34]。经过仔细考虑任务需求和可用计算资源后,我们选择LoRA和Q-LoRA来微调所提出的MDD-LLM。

2.4 实现细节

在本研究中,我们使用Llama3.1系列模型 [35] 进行广泛的实验,特别关注评估Llama3.1-8B和Llama3.1-70B模型在微调后的性能。微调过程采用LoRA方法,等级为8,alpha值为16 。模型在约300 k个数据上进行微调,使用线性预热和衰减计划,峰值学习率为0.0003 ,恒定权重衰减为0.1 ,全局批次大小为192 ,总训练周期为5 。在模型微调过程中,所提出的方法应根据输入信息提供是或否的答案,以表示相应的分类标签,以及相关的预测概率。值得注意的是,每个类别的预测概率反映了LLM生成其令牌序列的可能性,并在所有类别中归一化。所有实验方法均使用PyTorch和Python实现。所提出的MDD-LLM和对比方法在四个Nvidia H100 GPU上进行训练。我们在从UK Biobank队列收集的数据集上进行所有实验。数据集按患者ID以80%/20%的比例分为训练/测试集。我们采用了5折交叉验证来验证所提出模型的预测性能,这可以减少分区随机性对结果的影响。

2.5 评估指标

我们使用几种常用的指标来评估模型性能,如准确率(Acc)、F1分数(F1)、特异性(SPE)、敏感性(SNE)、阳性预测值(PPV)、阴性预测值(NPV)和曲线下面积(AUC)。这些指标的详细解释见附录S2。

3. 结果

3.1 实验设置

本文致力于使用大量的现实世界样本对现有的LLMs进行微调,以创建更有效的MDD诊断解决方案。因此,我们基于UK Biobank队列进行了各种深入分析。首先,我们使用测试集评估所提出的MDD-LLM与传统机器学习和深度学习方法的性能。接下来,我们探讨可能影响MDD-LLM性能的因素。例如,我们检查了不同方法对我们提出的框架进行微调的效果,包括LoRA和Q-LoRA。此外,我们还考虑了表格数据转换方法如何显著影响基于LLMs的解决方案的性能。因此,我们尝试了一系列转换方法,包括列表模板、文本模板和GPT生成模板。由于LLMs在MDD诊断中的研究较少,很难找到基于LLMs的解决方案与我们提出的方法进行比较。目前,大多数基于模型的解决方案使用机器学习或深度学习算法。为了展示我们提出解决方案的有效性,我们使用相同的数据集开发了几种经典方法,如XGBoost、随机森林(RF)、支持向量机(SVM)和多层感知机(MLP)。

3.2 UK Biobank上的模型性能

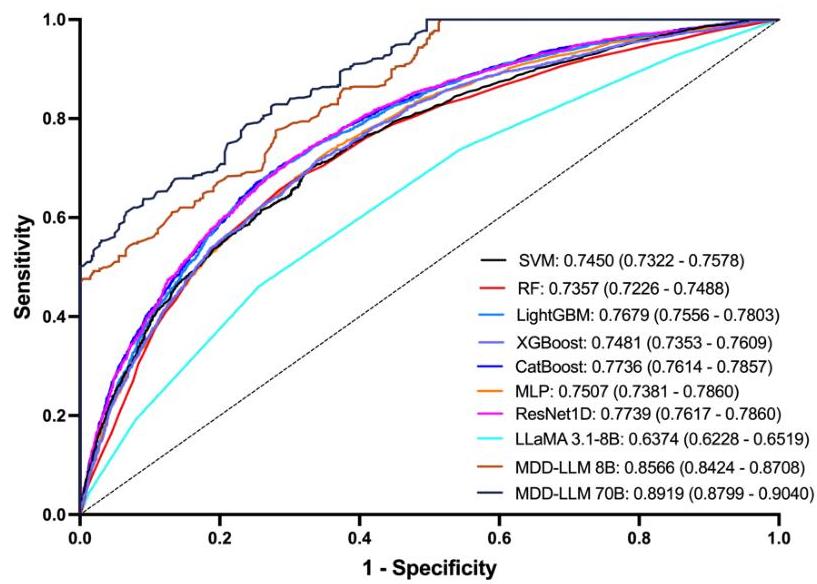

为了展示MDD-LLM的有效性,我们在UK Biobank数据集上进行了综合实验,并通过各种评估指标与现有的机器学习和深度学习解决方案进行了比较,如准确率(ACC)、F1得分(F1)和接收者操作特性曲线(ROC)。详细结果见表3,ROC结果见图2。所提出的MDDLLM 8B和70B模型在大多数评估指标上表现优于现有的基于模型的方法。例如,MDD-LLM 70B模型在准确率、F1得分和AUC方面的结果分别为0.8378、0.8184和0.8919(95%置信区间:0.8799 - 0.9040)。与SVM相比,MDD-LLM 70B在准确率和F1得分上分别提高了23.57%和25.87%。尽管MDD-LLM 8B解决方案的性能可能不如MDD-LLM 70B,但在准确性和稳健性方面仍显著优于现有方法。

表3. 不同方法在UK Biobank数据集上的比较结果。

| 方法 | ACC | F1 | AUC | SPE | SENS | PPV | NPV |

|---|---|---|---|---|---|---|---|

| SVM | 0.6780 | 0.6502 | 0.7450 | 0.6945 | 0.6582 | 0.6423 | 0.7091 |

| RF | 0.6868 | 0.6327 | 0.7357 | 0.7647 | 0.5933 | 0.6776 | 0.6929 |

| LightGBM | 0.7077 | 0.6691 | 0.7678 | 0.7558 | 0.6500 | 0.6893 | 0.7216 |

| XGBoost | 0.7055 | 0.6688 | 0.7481 | 0.7486 | 0.6539 | 0.6843 | 0.7218 |

| CatBoost | 0.7102 | 0.6701 | 0.7736 | 0.7627 | 0.6472 | 0.6945 | 0.7217 |

| MLP | 0.6852 | 0.6287 | 0.7507 | 0.7676 | 0.5863 | 0.6777 | 0.6901 |

| ResNet1D | 0.7062 | 0.6629 | 0.7739 | 0.7653 | 0.6354 | 0.6929 | 0.7158 |

| LLaMA3.1 8B | 0.6153 | 0.5215 | 0.6374 | 0.7436 | 0.4612 | 0.5999 | 0.6235 |

| MDD-LLM 8B | 0.7904 | 0.7627 | 0.8566 | 0.8023 | 0.7748 | 0.7509 | 0.8225 |

| MDD-LLM 70B | 0.8378 | 0.8184 | 0.8919 | 0.8358 | 0.8405 | 0.7974 | 0.8721 |

- ACC=准确率,F1=f1得分,AUC=接收者操作特性曲线下的面积,SPE=特异性,SEN=灵敏度,PPV=阳性预测值,NPV=阴性预测值。

UK Biobank上的ROC结果

图2. 不同方法在UK Biobank队列上的ROC结果比较。

3.3 微调方法的有效性

寻找有效的微调LLMs的方法是一个值得探索的领域。几种广泛认可的模型微调技术包括LoRA、QLoRA、Adapter Tuning、Prompt Tuning和Prefix Tuning。这些方法可以提高模型性能和适应性。鉴于丰富的微调方法,本节集中讨论两种最普遍的技术:LoRA和QLoRA。值得注意的是,所有实验都基于MDD-LLM 8B。比较结果见表4。实验结果表明,使用LoRA微调的模型性能略优于使用QLoRA微调的模型。值得注意的是,LoRA解决方案允许更高效的微调过程,仅需40分钟即可完成训练,而QLoRA则需要大约55分钟。然而,LoRA需要比QLoRA更多的GPU内存。在相同的实验设置下,LoRA需要245 GB的GPU内存进行模型训练,而QLoRA只需要172 GB。鉴于LLM基础解决方案对硬件资源的巨大需求,我们应该根据实际情况选择合适的微调技术。

表4. 使用LoRA和QLoRA微调的MDD-LLM 8B模型性能。

| 方法 | 准确率 | F1得分 | 训练时间 | 使用内存 |

|---|---|---|---|---|

| LoRA | 0.7904 | 0.7627 | 40分钟 | 245 GB |

| QLoRA | 0.7883 | 0.7624 | 55分钟 | 172 GB |

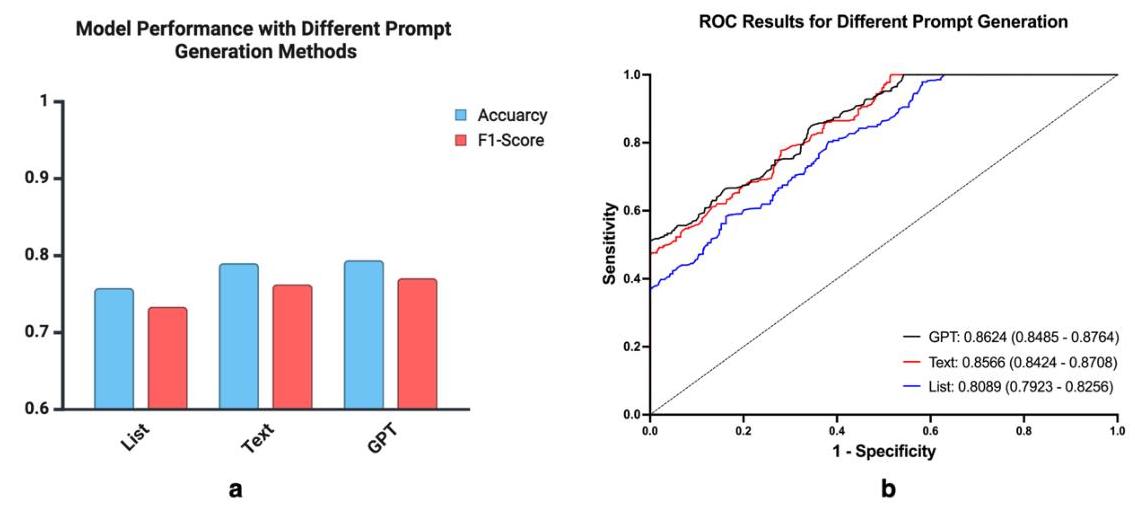

3.4 提示生成类型的有效性

创建有效的提示对于微调LLMs至关重要,从而促成了提示工程任务的出现。在本部分中,我们研究了不同类型的提示如何影响模型性能。我们为相同的表格数据设计了不同的提示表达方式,包括列表模板、文本模板和GPT生成模板。具体而言,列表模板指的是一组结构化的列名和特征值,列的顺序固定。文本模板以句子的形式表达每个特征,例如“患者的年龄是25岁”。GPT生成模板建议使用ChatGPT API为表格数据创建自然语言描述。图3展示了比较各种转换方法的一个例子。表格转换的详细信息见附录S1。生成的提示用于优化我们提出的MDD-LLM 8B,这些实验的结果详见图4和附录表S2。我们的研究发现,使用列表模板生成的提示在微调MDDLLM时的表现不如使用文本模板和GPT生成模板生成的提示。值得注意的是,使用文本模板和GPT生成模板生成的提示在微调所提出的模型时产生了相似的结果。考虑到数据获取成本、收集时间和模型性能,我们推荐使用文本模板生成提示。

| 特征 | 值 | 特征 | 值 |

|---|---|---|---|

| 年龄 | 47 | 工作时间 | 17小时/周 |

| 性别 | 男性 | 教育 | A级 |

| 失眠 | 有时 | 收入 | 18,000 |

| 睡眠时间 | 9小时 | HDLC | 1.507 |

| 饮酒 | 每周4次 | CLDLC | 2.3299 |

| 自我伤害 | 从未 | TG | 1.038 |

| 就业状态 | 有偿就业 | TC | 4.7086 |

表格数据

年龄是47岁,性别是男性,体质指数(BMI)是 29.7973 k g / m 2 2 29.7973 \mathrm{~kg} / \mathrm{m}^{2} 2 29.7973 kg/m22,有时失眠,睡眠时间是9小时,每周饮酒三到四次,从未自我伤害,就业状态是有偿就业或自营职业,收入少于18,000美元,每周工作17小时,教育程度是A级/AS级或同等学历,没有长期疾病,高密度脂蛋白胆固醇是 1.507 m m o l / l 1.507 \mathrm{mmol} / \mathrm{l} 1.507mmol/l,临床低密度脂蛋白胆固醇是2.3299 mmol/l,甘油三酯是1.038 mmol/l,总胆固醇是4.7086 mmol/l。

文本模板

年龄:47,性别:男性,失眠:有时,睡眠时间:9小时,饮酒:每周4次,自我伤害:从未,就业状态:有偿就业,工作时间:17小时/周,教育:A级,收入:18,000,HDLC:1.507,CLDLC:2.3299,TG:1.038,TC:4.7086。

列表模板

这位47岁的男性,体质指数(BMI)约为 29.8 k g / m 2 29.8 \mathrm{~kg} / \mathrm{m}^{2} 29.8 kg/m2,属于超重范畴。他偶尔会出现睡眠困难,但通常每晚平均睡9小时。他的饮酒频率约为每周三到四次,且没有自残史。关于他的就业状态,他要么从事有偿工作,要么是自营职业者,年收入少于$18,000,每周工作约17小时。他的教育背景包括A级或AS级,或同等学历,并未报告任何慢性疾病。从健康角度来看,他的胆固醇水平如下:高密度脂蛋白(HDL)为 1.507 m m o l / L 1.507 \mathrm{mmol} / \mathrm{L} 1.507mmol/L,低密度脂蛋白(LDL)为 2.3299 m m o l / L 2.3299 \mathrm{mmol} / \mathrm{L} 2.3299mmol/L,甘油三酯为 1.038 m m o l / L 1.038 \mathrm{mmol} / \mathrm{L} 1.038mmol/L,总胆固醇为 4.7086 m m o l / L 4.7086 \mathrm{mmol} / \mathrm{L} 4.7086mmol/L。

GPT生成模板

图3. 列表模板、文本模板和GPT生成模板的表格数据转换结果示例。

图4a. 不同提示生成方法在准确率和F1得分方面的模型性能。图4b. 三种不同表格数据转换方法的ROC结果。List、Text和GPT分别定义了列表模板、文本模板和GPT生成模板的转换方法。

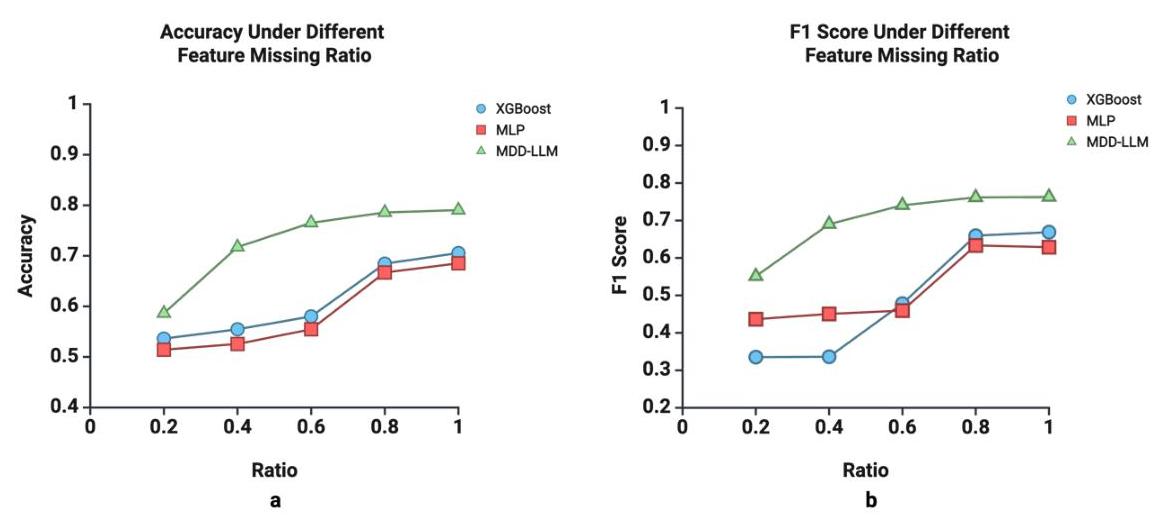

3.5 缺失特征的鲁棒性

经典的深度学习或机器学习模型通常需要训练样本的完整性和多样性。因此,许多工作在缺失数据方面进行了广泛研究,并提出了几种解决方案,如MICE [36] 和

MissForest [37]。然而,缺失数据在医学相关任务中是一个普遍的挑战。过度依赖数据补全解决方案可能会在模型中引入大量噪声,从而影响其性能。相比之下,LLMs具备大量的先验知识。例如,它们本质上理解异常血糖水平与糖尿病之间的相关性,以及长时间工作与抑郁症风险的潜在联系。研究表明,利用LLMs的医学诊断解决方案在处理不完整数据时表现出令人印象深刻的韧性。为了进一步研究这一问题,我们随机保留训练数据中

20

%

20\%

20%、

40

%

40\%

40%、

60

%

60\%

60% 和

80

%

80\%

80% 的特征。如图5和附录表S2所示,所提出的MDD-LLM在面对缺失数据时表现出强大的鲁棒性。当

60

%

60\%

60% 的特征缺失时,MDD-LLM的准确率和F1得分仅略有下降,与使用完整数据集的结果相比变化不大。相比之下,XGBoost和MLP在这些情况下难以维持有效的性能表现。

图5a. 在不同特征保留比例下的模型性能(以准确率为指标)。图5b. 在不同特征保留比例下的模型性能(以F1得分为指标)。

4. 讨论

重度抑郁症(MDD)的诊断通常被认为是心理健康领域中的一个复杂且具有挑战性的话题。目前,MDD的主要诊断方法依赖于诸如DSM-5和PHQ-9等量表。然而,这些方法需要患者的高度配合以及临床医生的丰富经验。一旦患者有意隐瞒信息,将显著增加得出错误结论和误判的风险。随着技术的不断发展,更先进的MDD初步诊断方案正在被提出。例如,Wang等人[38]引入了M-MDD方案,结合多任务深度学习模型和脑电图(EEG)数据高效诊断MDD。该方法在验证数据集中展示了有希望的结果。由于MDD与人类运动和面部表情相关,许多研究人员利用多模态信息进行了调查。例如,Sadeghi等人[39]提出了一种基于深度学习的方法,通过整合面部表情和文本信息完成MDD诊断任务。尽管这些模型表现出有效性能,但它们需要大量高质量的数据进行训练。然而,数据收集和标注过程带来了重大挑战,特别是在医学相关任务的背景下。大多数基于模型的解决方案作为黑箱操作,这使得阐明模型所获得的知识变得复杂。模型可解释性的缺乏成为在现实世界医疗场景中应用这些方法的重大障碍。大型语言模型(LLMs)的快速发展促使一些研究人员探索其在疾病诊断中的潜在应用[40]。例如,Kim等人[41]使用GPT4识别心血管疾病并取得了良好的结果。目前,针对MDD诊断专门微调的大型现实世界数据集的LLMs尚显不足。LLMs在模型准确性、推理能力和先验知识方面具有显著优势,使其成为诊断MDD的有效解决方案。

鉴于当前MDD诊断面临的挑战及LLMs带来的益处,本文提出了MDD-LLM。这一创新方法利用大规模现实世界样本对LLMs进行微调,从而构建出更精确的MDD诊断框架。在本文中,我们探讨了将LLMs应用于MDD诊断的各种方面,并将其性能与传统深度学习和机器学习方法进行了比较。实验结果表明,基于微调LLMs的解决方案在预测准确性方面表现优异,并在MDD诊断领域展现出卓越潜力。然而,微调LLMs是一项复杂的项目,仍需进一步研究,因为许多因素可能显著影响模型性能。因此,我们进行了一系列探索以分析这些问题。首先,我们讨论了两种主流微调技术——LoRA和QLoRA,并考察了它们的优点、局限性和适用的应用场景。随后,我们回顾了三种不同的提示生成方法,并根据使用成本和模型性能确定了最合适的转换方案。

基于LLMs的MDD诊断解决方案相较于现有的基于模型的框架具有显著优势,包括对缺失数据的鲁棒性和更强的模型可解释性。为了展示我们提出的解决方案在存在缺失数据情况下的鲁棒性,我们进行了全面实验以验证其有效性,并与几种现有方法进行了比较。实验结果显示,即使在大量数据缺失的情况下,MDD-LLM仍能保持更好的性能。例如,当训练数据中 60 % 60\% 60% 的特征缺失时,MDD-LLM在准确率和F1得分上的性能分别仅下降 9.24 % 9.24\% 9.24% 和 9.50 % 9.50\% 9.50%。相比之下,现有的基于模型的解决方案在这种情况下难以有效运作。此外,基于LLMs的解决方案可以通过对话输出预测结果并提供相应的解释。例如,我们将表格数据转换为提示并输入到MDD-LLM中。模型根据指令解释此信息并预测患者是否患有MDD。然后,我们可以要求模型解释其预测背后的推理。LLMs的对话能力和广泛的背景知识使它们能够为预测提供详细的解释。说明模型可解释性的示例见图6。

5. 局限性与未来工作

在本研究中,我们开发了一种基于LLMs和大规模现实世界样本的MDD诊断解决方案。实验结果表明,所提出的MDD-LLM在准确性、鲁棒性和可解释性方面具有显著优势。然而,几个问题仍需进一步研究。在本文中,我们利用UK Biobank队列对Llama 3.1 8B和70B模型进行了微调。然而,Llama 3.1系列仅包含通用模型,缺乏专为医学领域定制的版本。有必要进一步探索使用医学LLM替代Llama 3.1对MDD-LLM性能的影响。此外,基于LLMs的解决方案的可解释性显著优于传统的深度学习和机器学习模型。然而,LLMs中的幻觉现象仍然是需要关注的挑战。虽然存在标准的LLMs微调方案,但尚不清楚这些方法是否适用于医学相关任务,尤其是在MDD诊断方面。由于硬件限制,我们使用了两种微调方法:LoRA和QLoRA。其他微调方法的有效性仍需进一步实验验证。

接下来,我们将从以下几个方面继续研究基于LLMs的抑郁诊断模型。首先,我们将评估各种基础LLMs以确定最适合我们解决方案的选项。其次,我们将专注于开发专门针对医学相关任务的LLM微调技术。第三,我们将研究与MDD-LLM相关的幻觉问题,并探索有效的策略来缓解这些问题。最后,我们将收集更多现实世界和多中心样本用于MDD诊断。

请帮助我预测患者是否患有重度抑郁症?请回答是或否,并给出相应概率。

好的,我明白了。

年龄为48岁,性别为女性,BMI为 36.56 k g / m ∗ 2 36.56 \mathrm{~kg} / \mathrm{m} * 2 36.56 kg/m∗2,经常失眠,睡眠时间为5小时,仅在特殊场合饮酒,经常感到极度不快乐,工作满意度为极度不快乐,就业状态为退休,收入少于18,000美元,教育程度为O级/GCSE或同等学历(其他专业资格,如护理、教学),有长期疾病,健康满意度为极度不快乐,家庭关系满意度为极度不快乐,财务状况满意度为中度不快乐,高密度脂蛋白胆固醇为 1.709 m m o l / l 1.709 \mathrm{mmol} / \mathrm{l} 1.709mmol/l,临床低密度脂蛋白胆固醇为 2.6395 m m o l / l 2.6395 \mathrm{mmol} / \mathrm{l} 2.6395mmol/l,甘油三酯为1.581 m m o l / l \mathrm{mmol} / \mathrm{l} mmol/l,总胆固醇为 4.3438 m m o l / l 4.3438 \mathrm{mmol} / \mathrm{l} 4.3438mmol/l。

请解释你的判断。

重要的是要考虑影响其精神健康的多种生物心理社会因素。以下是此人案例中的关键因素:

- BMI ( 36.56 k g / m 2 36.56 \mathrm{~kg} / \mathrm{m}^{2} 36.56 kg/m2):该个体被归类为肥胖,这与抑郁风险增加有关,原因包括系统性炎症、自我评价低下和身体健康的减少。

-

- 睡眠问题:慢性失眠和每晚仅睡5小时会对心理健康产生负面影响,损害情绪调节能力并增加抑郁的脆弱性。

-

- 长期疾病:慢性健康状况往往降低生活质量,造成身体不适,并导致绝望感,这些都是MDD的风险因素。

-

- 极度不快乐的感觉:该个体经常感到极度不快乐,这是MDD的一个标志性症状。这种情绪基线可能会加剧病情。

-

- 工作满意度:尽管已退休,该个体对工作的满意度为“极度不快乐”。这可能暗示对过去工作经历的不满或退出劳动力市场的心理影响。

-

- 退休:进入退休阶段可能导致社交联系减少、日常结构丧失和目标感减弱,这些都是预防抑郁的保护因素。

-

- 教育水平低:拥有“O级/GCSE或其他专业资格”可能限制获得更高薪工作的机会,从而持续造成经济不安全和自卑感。

图6. 示例显示MDD-LLM在模型可解释性、推理和对话能力方面的表现。

- 教育水平低:拥有“O级/GCSE或其他专业资格”可能限制获得更高薪工作的机会,从而持续造成经济不安全和自卑感。

6. 结论

在本研究中,我们基于LLMs和大规模现实世界样本开发了一种MDD诊断解决方案,命名为MDD-LLM。据我们所知,所提出的MDD-LLM是第一个基于大规模现实世界数据集微调的LLM MDD诊断解决方案。为了展示模型的性能,我们对现有的机器学习和深度学习方法进行了综合比较。结果显示,MDD-LLM在多个评估指标上优于大多数基于模型的方案,包括准确率、F1分数和AUC。由于很少有研究探索使用LLMs诊断MDD,我们讨论了可能影响微调LLM解决方案性能的各种因素。这些因素包括表格数据转换方法、不同微调策略的有效性以及模型在处理缺失数据方面的鲁棒性。实验表明,通过大规模数据微调的MDD-LLM可以有效地用于MDD诊断。

作者贡献

概念和设计:沙玉阳,李克锋。数据采集、分析或解释:沙玉阳,潘宏欣,孟威宇,罗刚,徐伟,杜新宇,石彩娟。代码和模型构建:沙玉阳,石彩娟。撰写初稿:沙玉阳,潘宏欣。稿件重要智力内容的关键修订:李克锋。所有作者都参与了结果讨论并对稿件进行了评论。所有作者同意对所有方面的工作负责以确保其完整性和准确性。

数据和材料的可用性

本研究使用的源代码可通过GitHub (https://github.com/syysha0k/MDD-LLM) 获得,仅供研究目的使用。本研究使用了UK Biobank资源,申请编号为99946。

利益冲突声明

作者声明他们没有利益冲突。

资金支持

本研究得到了澳门城市大学基金(RP/FCA14/2023)、澳门城市大学内部研究资助(RP/FCSD-02/2022)、澳门科学技术发展基金(FDCT)(0033/2023/RIB2)的支持。

参考文献

- Sm G, O K-F, R M-M, A M, Jj M, M B, et al. 共病抑郁症的医学疾病。Nature reviews Disease primers. 2020;6.

-

- Depression WHO. 抑郁症和其他常见精神障碍。2017.

-

- Cui L, Li S, Wang S, Wu X, Liu Y, Yu W, et al. 重度抑郁症:假设、机制、预防和治疗。Signal Transduct Target Ther. 2024;9:30.

-

- GBD 2021 Forecasting Collaborators. 2022年至2050年204个国家和地区的疾病负担情景:全球疾病负担研究2021年的预测分析。Lancet. 2024;403:2204-56.

-

- Teesson M, Newton NC, Slade T, Chapman C, Birrell L, Mewton L, et al. 针对青少年物质使用、抑郁和焦虑的综合预防:数字在线干预的群组随机对照试验。Lancet Digit Health. 2020;2:e74-84.

-

- Kennis M, Gerritsen L, van Dalen M, Williams A, Cuijpers P, Bockting C. 重度抑郁症的前瞻性生物标志物:系统评价和荟萃分析。Mol Psychiatry. 2020;25:321-38.

-

- Watts D, Pulice RF, Reilly J, Brunoni AR, Kapczinski F, Passos IC. 使用EEG预测重度抑郁症治疗反应:机器学习荟萃分析。Transl Psychiatry. 2022;12:332.

-

- Pan H, Sha Y, Zhai X, Luo G, Xu W, Meng W, et al. 引导推断和机器学习揭示重度抑郁症的核心差异血浆代谢连接体特征。J Affect Disord. 2025;378:281-92.

-

- Cohen SE, Zantvoord JB, Wezenberg BN, Bockting CLH, van Wingen GA. 使用磁共振成像进行重度抑郁症个体治疗反应预测:系统评价和荟萃分析。Transl Psychiatry. 2021;11:168.

10.10. Tasci G, Loh HW, Barua PD, Baygin M, Tasci B, Dogan S, et al. 使用双帕斯卡三角格子模式自动准确检测抑郁症。Knowledge-Based Systems. 2023;260:110190.

- Cohen SE, Zantvoord JB, Wezenberg BN, Bockting CLH, van Wingen GA. 使用磁共振成像进行重度抑郁症个体治疗反应预测:系统评价和荟萃分析。Transl Psychiatry. 2021;11:168.

- Yoon J, Kang C, Kim S, Han J. D-vlog:用于抑郁检测的多模态Vlog数据集。In: Proceedings of the AAAI Conference on Artificial Intelligence. 2022. p. 12226-34.

-

- Chiong R, Budhi GS, Dhakal S, Chiong F. 基于文本的特征提取方法用于使用机器学习分类器和社会媒体文本的抑郁检测。Computers in Biology and Medicine. 2021;135:104499.

-

- Meng W, Pan H, Sha Y, Zhai X, Xing A, Lingampelly SS, et al. 代谢连接组及其在复杂疾病预测、诊断和治疗中的作用。Metabolites.

- 2024;14:93.

-

- Blundell E, De Stavola BL, Kellock MD, Kelly Y, Lewis G, McMunn A, et al. 儿童BMI、身体不满和青少年抑郁之间的纵向路径:使用英国千年队列研究的观察性研究。Lancet Psychiatry. 2024;11:47-55.

-

- Darling AM, Young BE, Skow RJ, Dominguez CM, Saunders EFH, Fadel PJ, et al. 患有重度抑郁症的年轻人的交感神经和血压反应性。J Affect Disord. 2024;361:322-32.

-

- Buckman JEJ, Saunders R, Stott J, Arundell L-L, O’Driscoll C, Davies MR, et al. 成人抑郁症预后中年龄、性别和婚姻状况的作用:一项个体患者数据荟萃分析。Epidemiol Psychiatr Sci. 2021;30:e42.

-

- Patel V, Burns JK, Dhingra M, Tarver L, Kohrt BA, Lund C. 收入不平等与抑郁症:关联的系统评价和荟萃分析以及机制的范围审查。World Psychiatry. 2018;17:76-89.

-

- Touvron H, Martin L, Stone K, Albert P, Almahairi A, Babaei Y, et al. Llama 2:开放的基础模型和微调聊天模型。2023.

-

- Bedi S, Liu Y, Orr-Ewing L, Dash D, Koyejo S, Callahan A, et al. 大型语言模型在医疗保健应用中的测试与评估:系统综述。JAMA. 2025;333:319-28.

-

- Liu Q, Wu X, Zhao X, Zhu Y, Xu D, Tian F, et al. 当MOE遇到LLMs:参数高效微调用于多任务医学应用。In: Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York, NY, USA: Association for Computing Machinery; 2024. p. 1104-14.

-

- Ma R, Cheng Q, Yao J, Peng Z, Yan M, Lu J, et al. 多模态机器学习使AI聊天机器人能够诊断眼科疾病并提供高质量的医疗响应。NPJ Digit Med. 2025;8:64.

-

- Moor M, Banerjee O, Abad ZSH, Krumholz HM, Leskovec J, Topol EJ, et al. 基础模型用于通用医学人工智能。Nature. 2023;616:259-65.

-

- Belyaeva A, Cosentino J, Hormozdiari F, Eswaran K, Shetty S, Corrado G, et al. 基于个体特定数据的多模态LLMs。In: Maier AK, Schnabel JA, Tiwari P, Stegle O, editors. Machine Learning for Multimodal Healthcare Data. Cham: Springer Nature Switzerland; 2024. p. 86-102.

-

- Sha Y, Meng W, Luo G, Zhai X, Tong HHY, Wang Y, et al. MetDIT:使用卷积神经网络转换和分析临床代谢组学数据。Anal Chem. 2024;96:2949-57.

-

- Sha Y, Zhai X, Li J, Meng W, Tong HH, Li K. 一种基于全局局部注意力和通道特征增强的轻量级深度学习跌倒检测系统。Interdisciplinary Nursing Research. 2023;2:68-75.

-

- Sha Y. 基于知识蒸馏的高效面部标志检测器。In: IEEE International Conference on Automatic Face and Gesture Recognition. 2021. p. 1-8.

-

- Tan Y, Zhang Z, Li M, Pan F, Duan H, Huang Z, et al. MedChatZH:用于中医咨询的调整LLM。Comput Biol Med. 2024;172:108290.

-

- Bycroft C, Freeman C, Petkova D, Band G, Elliott LT, Sharp K, et al. 包含深入表型和基因组数据的UK Biobank资源。Nature. 2018;562:203-9.

-

- Sha Y, Jiang M, Luo G, Meng W, Zhai X, Pan H, et al. HerbMet:使用深度学习增强代谢组学数据分析以准确识别中药的HerbMet。Phytochem Anal. 2025;36:261-72.

-

- Depression WHO. ICD-10精神和行为障碍分类:临床描述和诊断指南。世界卫生组织;1992.

-

- Hu EJ, Shen Y, Wallis P, Allen-Zhu Z, Li Y, Wang S, et al. LoRA:大语言模型的低秩适应。2021.

-

- Dettmers T, Pagnoni A, Holtzman A, Zettlemoyer L. QLoRA:量化LLMs的有效微调。Advances in Neural Information Processing Systems. 2023;36:10088-115.

-

- Li XL, Liang P. Prefix-Tuning:优化连续提示以生成。2021.

-

- Zhang R, Han J, Liu C, Gao P, Zhou A, Hu X, et al. LLaMA-Adapter:零初始化注意力的高效微调语言模型。2024.

-

- Grattafiori A, Dubey A, Jauhri A, Pandey A, Kadian A, Al-Dahle A, et al. Llama 3模型群。2024.

-

- Zhang Z. 多变量插补链式方程(MICE)包的多重插补。Ann Transl Med. 2016;4:30.

-

- Stekhoven DJ, Bühlmann P. MissForest——非参数混合型数据缺失值插补。Bioinformatics. 2012;28:112-8.

-

- Wang Y, Zhao S, Jiang H, Li S, Li T, Pan G. M-MDD:使用EEG的重度抑郁症诊断多任务深度学习框架。Neurocomputing. 2025;636:130008.

-

- Sadeghi M, Richer R, Egger B, Schindler-Gmelch L, Rupp LH, Rahimi F, et al. 利用大型语言模型和面部表情进行抑郁检测的多模态方法。Npj Ment Health Res. 2024;3:66.

-

- Wu S-H, Tong W-J, Li M-D, Hu H-T, Lu X-Z, Huang Z-R, et al. 协同提升甲状腺结节超声诊断的一致性和准确性。Radiology. 2024;310:e232255.

-

- Han C, Kim DW, Kim S, Chan You S, Park JY, Bae S, et al. 评估GPT-4用于10年心血管风险预测:来自UK Biobank和KoGES数据的见解。iScience. 2024;27:109022.

参考论文:https://arxiv.org/pdf/2505.00032

- Han C, Kim DW, Kim S, Chan You S, Park JY, Bae S, et al. 评估GPT-4用于10年心血管风险预测:来自UK Biobank和KoGES数据的见解。iScience. 2024;27:109022.

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?