Transformer中Query-Key-Value(QKV)机制的详细中文解析:

一、核心概念

Transformer的自注意力机制通过Q(Query)、K(Key)、V(Value)三元组实现动态的上下文建模,取代了RNN/CNN的固定模式交互。其核心思想是:每个词通过Q去“查询”其他词的K,找到相关词后,聚合它们的V。

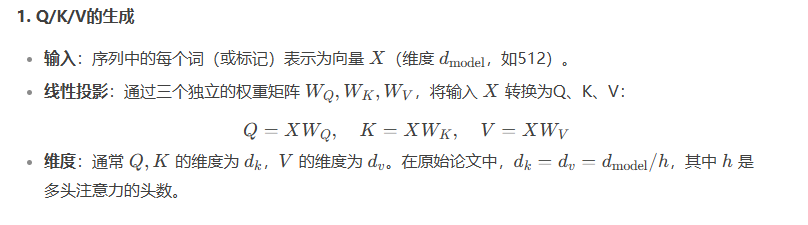

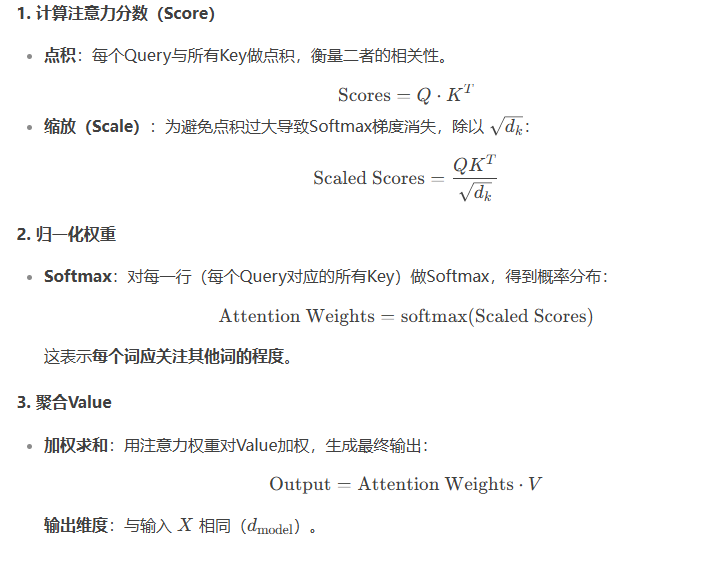

二、注意力计算步骤

三、Q/K/V的直观理解

Query(Q)

- 代表当前词“想了解什么”,比如句子中的代词“它”可能通过Q寻找前文提到的实体(如“猫”)。

Key(K)

- 表示每个词“能提供什么信息”,如“猫”的K可能包含“动物”“宠物”等语义。

Value(V)

- 实际用于传递的信息,例如当“它”关注到“猫”时,V可能是“猫”的具体特征(如“尾巴”“喵喵叫”)。

🌰 例子:

句子:“动物因为跑得太快,它撞到了树。”

-

“它”的Q:寻找“跑得快”的主体。

-

“动物”的K:包含“主体”信息。

-

结果:Q-K匹配后,“它”的注意力权重集中在“动物”上,最终输出会聚合“动物”的V。

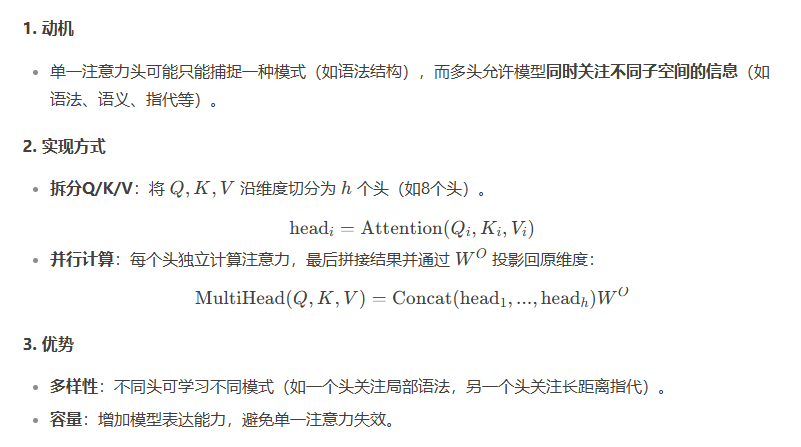

四、多头注意力(Multi-Head Attention)

五、Q/K/V的变体与应用

自注意力(Self-Attention)

-

Q、K、V均来自同一输入序列(如编码器处理原文时)。

-

作用:建模序列内部关系(如词与词、段落与段落)。

交叉注意力(Cross-Attention)

-

Q来自解码器,K、V来自编码器(如机器翻译中,解码器用Q查询编码器的上下文)。

-

作用:实现跨序列对齐(如源语言到目标语言)。

掩码注意力(Masked Attention)

- 解码器中使用,防止当前词看到未来信息(通过掩码矩阵将未来位置权重设为 −∞)。

六、为什么Q/K/V需要分开?

-

角色分离:

-

如果Q=K=V,模型退化为简单自相关,无法区分“查询内容”和“被查询内容”。

-

独立参数允许Q/K学习不同的匹配模式(如Q侧重“问题”,K侧重“答案”)。

-

七、代码示例(简化版)

import torch

import torch.nn.functional as F

def scaled_dot_product_attention(Q, K, V):

d_k = Q.size(-1)

scores = torch.matmul(Q, K.transpose(-2, -1)) / (d_k ** 0.5)

weights = F.softmax(scores, dim=-1)

output = torch.matmul(weights, V)

return output

八、关键优势

-

长距离依赖:任意两个词直接交互,无需逐步传递(克服RNN瓶颈)。

-

并行计算:所有注意力权重可同时计算(适合GPU加速)。

-

可解释性:通过可视化注意力权重,可分析模型关注点(如指代消解、关键词提取)。

151

151

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?