这几天刚刚接触自然语言处理,使用了Stanford CoreNLP工具。但毕竟是第一次用,所以遇到很多问题,现将解决方案记下(容易百度到的错误就不记了)。

其中用Stanford CoreNLP集合工具来处理中文的方法网上很少有说明,官方Demo也没有说明,特在此记下。

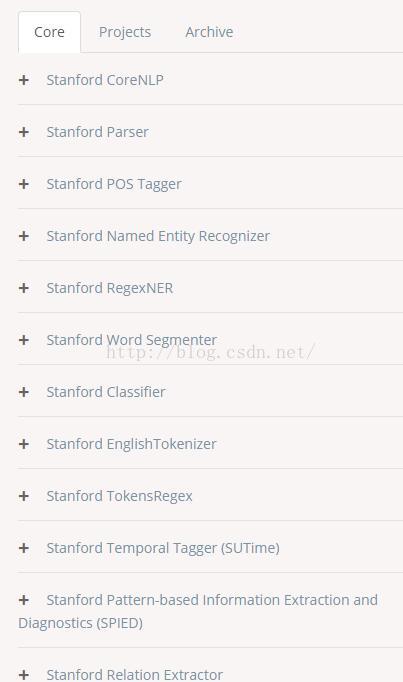

Stanford 提供了很多NLP工具,默认均直接支持英文,部分需要model支持中文。这是这些工具官方列表地址:http://nlp.stanford.edu/software/

部分工具列表如图:

其中第一个Stanford CoreNLP工具可以说是其它工具的集合,功能相对强大。假如你只需要进行分词,则使用Stanford Word Segmenter工具即可。该工具支持中文。而且下载的文件中也有适用于中文的Demo,比较容易理解。但是如果你想使用集合工具Stanford CoreNLP处理中文,则网上相关资料很少,下载的Demo文件中只有处理英文的。

下面介绍怎么用集合工具Stanford CoreNLP处理中文:

注意:需要java8,怎么配合eclipse使用,自己百度,目前需

本文介绍了如何使用Stanford CoreNLP工具包处理中文。首先,需要下载Stanford CoreNLP 3.6.0及其中文支持包,然后将中文模型jar包放入解压后的文件夹,并将其所有jar添加到工程中。接着,通过修改配置文件`StanfordCoreNLP-chinese.properties`,创建处理中文的pipeline,实现分词、分句、词性标注等任务。文章提供了测试代码示例,帮助读者理解和应用。

本文介绍了如何使用Stanford CoreNLP工具包处理中文。首先,需要下载Stanford CoreNLP 3.6.0及其中文支持包,然后将中文模型jar包放入解压后的文件夹,并将其所有jar添加到工程中。接着,通过修改配置文件`StanfordCoreNLP-chinese.properties`,创建处理中文的pipeline,实现分词、分句、词性标注等任务。文章提供了测试代码示例,帮助读者理解和应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

96

96

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?