机器学习性能评估指标汇总

- Accuracy:准确率

- Precision:精确率 / 查准率

- Recall:召回率 / 查全率

- F1 score:F1 值

- PR:查准率、查全率曲线

- ROC:真正率、假正率曲线

- AUC:ROC曲线下方的面积(Area Under Curve)

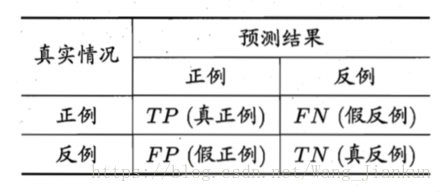

混淆矩阵(Confusion Matrix):

P:positive N:negative

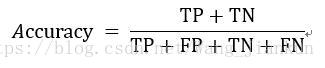

1、Accuracy:准确率

预测正确的样本占总样本的比例:

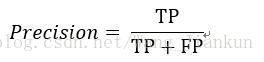

2、Precision:精确率 / 查准率

预测的真正例占预测为正例的比例:

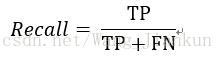

3、 Recall:召回率 / 查全率

预测的真正例占实际为正例的比例:

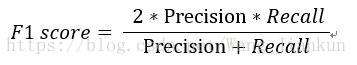

4、 F1 score:F1 值

Precision 和 Recall 的权衡(trade-off)

5、PR 曲线:查准率、查全率曲线

PR曲线:

根据不同的阈值得到的混淆矩阵计算 Precision、Recall。横坐标为Recall,纵坐标为 Precision。PR曲线越右左上角凸越好。

如果A模型的曲线完全向下包住B模型曲线,则A模型好于B模型。

6、ROC 曲线:真正率、假正率曲线

TPR:就是Recall

FPR:预测为假正例占实际为假正例的比例

ROC曲线:

根据不同的阈值得到的混淆矩阵计算 TPR、FPR。横坐标为 FPR,纵坐标为 TPR。

正常情况下 TPR 和 FPR 是正相关的。如果随着 TPR 的增加而 FPR 增加较少,则该阈值是好的。ROC曲线越向左上角凸越好。

如果A模型的曲线完全向下包住B模型曲线,则A模型好于B模型。

7、AUC:ROC曲线下方的面积(Area Under Curve)

AUC:

AUC越大越好,表示ROC曲线越向左上角凸。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?