软件存放目录

/home/hadoop/app 软件安装目录

/sofWare 软件安装包

Hadoop环境搭建

1)下载Hadoop

http://archive.cloudera.com/cdh5/cdh/5/

hadoop-2.6.0-cdh5.7.0.tar.gz

wget http://archive.cloudera.com/cdh5/cdh/5/hadoop-2.6.0-cdh5.7.0.tar.gz

2)安装JDK

下载

解压到APP目录:

tar -zxvf jdk-7u51-linux-x64.tar.gz

mv jdk1.7.0_51 java7

验证安装是否成功:

~/app/java7/bin ./java -version

JDK 配置到环境变量中:

vi .bash_profile

在文件中添加:

export: JAVA_HOME=/home/hadoop/app/java7

export: PATH=$JAVA_HOME/bin:$PATH

3)机器参数设置

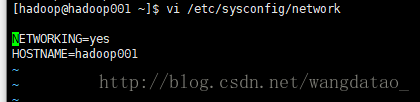

1、主机名:

hostname:hadoop01

修改机器名:

vi /etc/sysconfig/network

2、设置ip和hostname的映射关系

vi /etc/hosts

192.168.199.200 hadoop001

127.0.0.1 localhost

3、Hadoop配置文件修改:

cd /home/hadoop/app/hadoop-2.6.0-cdh5.7.0/etc/hadoop

hadoop-env.sh

export JAVA_HOME=/home/hadoop/app/java7

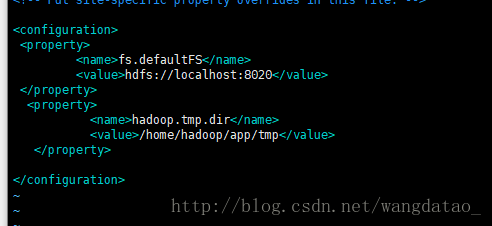

core-site.xml

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/app/tmp</value>

</property>

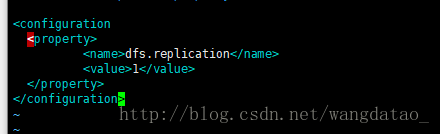

hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

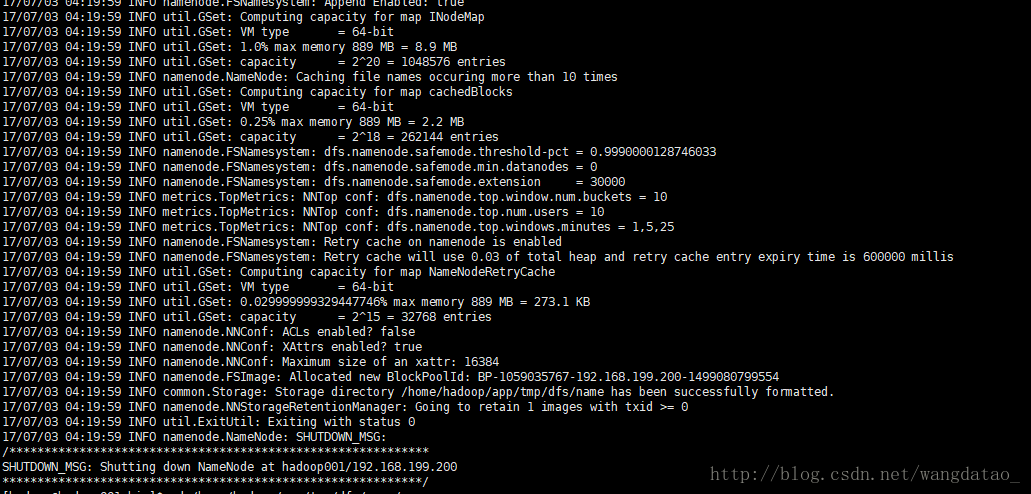

4、格式化HDFS

注意:这一步操作只在安装配置好后第一次执行,每次如果都格式化的话,那么HDFS上的数据就会被清空。

cd bin

./hdfs namenode -format

5、 启动HDFS

sbin/start-dfs.sh

验证是否安装成功:

① jps

DataNode

SecondaryNameNode

NameNode

②浏览器

浏览器中输入:

6 停止HDFS

cd sbin

./stop-dfs-sh

文件夹介绍

- bin:Hadoop最基本的管理脚本和使用脚本的目录,这些脚本是sbin目录下管理脚本的基础实现,用户可以直接使用这些脚本管理和使用Hadoop。

- etc:Hadoop配置文件所在的目录,包括core-site,xml、hdfs-site.xml、mapred-site.xml等从Hadoop1.0继承而来的配置文件和yarn-site.xml等Hadoop2.0新增的配置文件。

- include:对外提供的编程库头文件(具体动态库和静态库在lib目录中),这些头文件均是用C++定义的,通常用于C++程序访问HDFS或者编写MapReduce程序。

- lib:该目录包含了Hadoop对外提供的编程动态库和静态库,与include目录中的头文件结合使用。

- libexec:各个服务对用的shell配置文件所在的目录,可用于配置日志输出、启动参数(比如JVM参数)等基本信息。

- sbin:Hadoop管理脚本所在的目录,主要包含HDFS和YARN中各类服务的启动/关闭脚本。

- share:Hadoop各个模块编译后的jar包所在的目录。

HDFS 优点

- 高容错

- 审核批量处理

- 适合大数据处理

- 可构建在廉价的机器上

HDFS缺点

- 低延迟的数据访问

- 小文件储存

2847

2847

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?