前言:昨天看到微博上分享的深度学习视频,为上海复旦大学吴立德教授深度学习课程,一共六课时,视频地址点击打开链接。在此我结合其他资料,写点个人的学习笔记进行记录。

第二课:前馈神经网BP算法

本课吴老师对深度学习前馈神经网BP算法做介绍。内容分为两块:1.前馈网基本概念 2.BP算法

1前馈网基本概念

1.1.基本概念:

神经元

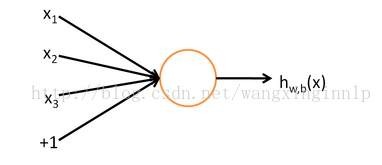

图1,神经元 (图片来自http://deeplearning.stanford.edu/wiki/index.php/%E7%A5%9E%E7%BB%8F%E7%BD%91%E7%BB%9C)

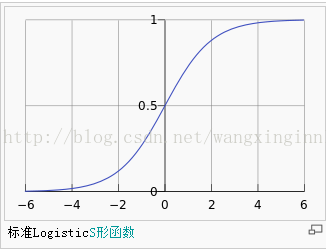

**神经元就是神经网络的基本运算单元。中的函数叫做激活函数 (activation function)。激活函数一般有两种选择:sigmoid函数

或者tanh函数

。两者的不同之处是前者的输出范围是(0,1)(见图2)后者的输出范围是(-1, 1)(见图3)。

神经元就是一个和

套在一起的复合函数组成,其中外层是一个非线性函数和内层是一个线性函数,组成的是一个多元函数。展开写就是

。

图2.sigmoid函数(图片来自维基百科)

图3.tanh函数(图片来自http://deeplearning.stanford.edu/wiki/index.php/%E7%A5%9E%E7%BB%8F%E7%BD%91%E7%BB%9C)

神经层

本文是深度学习学习笔记的第二部分,主要讲解前馈神经网络的BP算法。介绍了神经元的基本概念,包括激活函数、神经层和神经网,以及前馈计算过程。此外,文章还探讨了神经网络优化目标、梯度下降法以及BP算法在求偏导数时的特殊性,并讨论了深度学习中常见的问题——对称失效和梯度弥散。

本文是深度学习学习笔记的第二部分,主要讲解前馈神经网络的BP算法。介绍了神经元的基本概念,包括激活函数、神经层和神经网,以及前馈计算过程。此外,文章还探讨了神经网络优化目标、梯度下降法以及BP算法在求偏导数时的特殊性,并讨论了深度学习中常见的问题——对称失效和梯度弥散。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?