内置Hive

- 需要将core-site.xml和hdfs-site.xml 拷贝到spark的conf目录下。如果Spark路径下发现metastore_db,需要删除【仅第一次启动的时候】。

- 在你第一次启动创建metastore的时候,你需要指定spark.sql.warehouse.dir这个参数,

spark-shell --master spark://hadoop01:7077 --conf spark.sql.warehouse.dir=hdfs://hadoop01:9000/spark_warehouse

随便创建一张表

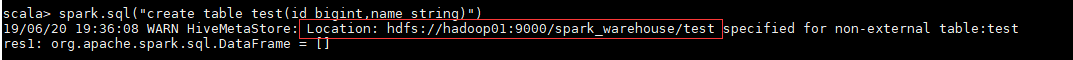

scala> spark.sql("create table test(id bigint,name string)")

效果如下,可以看到这表的位置时在hadoop集群上

外部Hive

- 需要将hive-site.xml 拷贝到spark的conf目录下。

- 如果hive的metestore使用的是mysql数据库,那么需要将mysql的jdbc驱动包放到spark的jars目录下。

- 可以通过spark-sql或者spark-shell来进行sql的查询。完成和hive的连接。

310

310

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?