最近,yolo之父Joseph Redmon退出CV界以表达抗议,拒绝AI算法用于军事和隐私窥探。计算机视觉这把双刃剑已经日益深入到我们的生活,虽说大神已经退圈,但我们的研究还是要继续。

为了实现一套CPU独立可运行的高效人体跟踪方案,尽量降低程序的时间复杂度和空间复杂度,可应用在资源有限的嵌入式设备中,我测试了多种主流的开源算法,今天与大家一起分享。

整个方案主要分为两大部分,目标检测+目标跟踪:

说到目标检测,大家脑海里可能浮现很多检测的方法。在以前,大家可能是通过传统的图像处理,手工提取特征描述子,利用滑动窗+SVM的方案来实现检测。比如在2006年,就有人通过HOG+SVM的方法实现了行人检测。

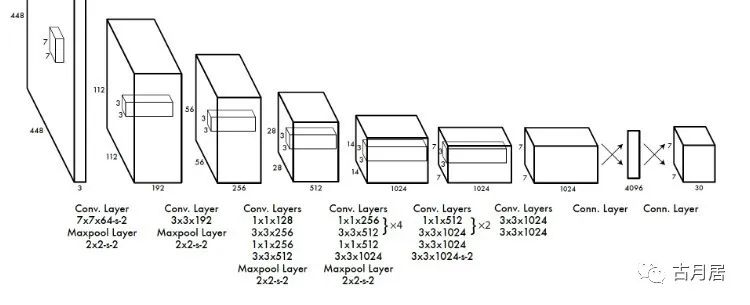

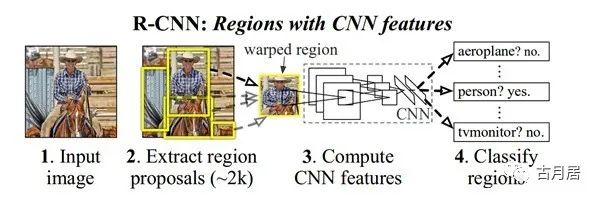

随着计算机算力的逐步提高,2012年CNN在ImageNet大赛中一鸣惊人,以高出第二名近10%的成绩将深度学习推向热潮。卷积神经网络在分类器上取得显著成效,人们很快将其应用在了目标检测当中,于是乎就有了RCNN、Fast-RCNN、Faster-RCNN三兄弟。

(图1 ALexNet网络结构)

(图2 RCNN算法流程)

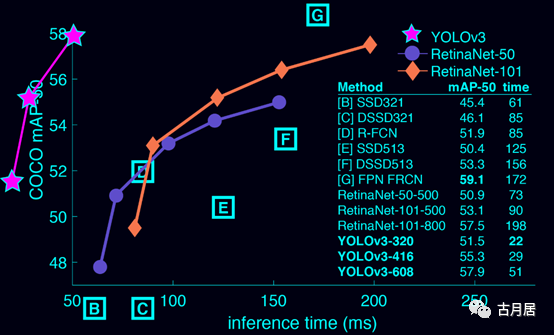

2016年,yolo算法提出了一种新的单阶段检测方案,后面逐步优化,出现了v2,v3的版本。单阶段的方法省去了生成候选区域的(RPN)的步骤,所以其速度相较于二阶段的算法来说有很大的优势,但是其对于小物体的检测效果较差。从图3我们可以看出,yolo v3的速度是优于其他网络结构的。

(图3 Yolo算法性能对比)</

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?