目录

zookeeper常见用法

部署kafka集群

zookeeper常见用法

首先进入到ZooKeeper命令行模式下,可以进行如下操作:

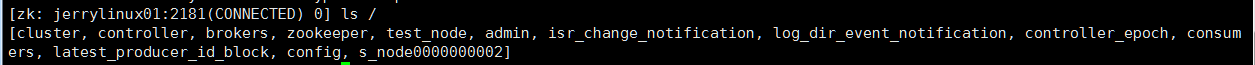

1)查询节点

ls /

.png)

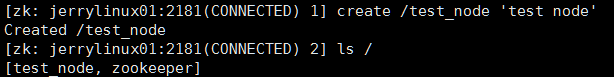

2)创建节点

create /test_node 'test node'

说明:节点名称必须以/开头,test_node为节点名称,'test node'为具体数据

.png)

创建临时节点 退出登录临时节点消失

create -e /test_node2 'ephemeral node'

创建序列节点,它会自动加上一堆数字

create -s /s_node 'sequential node'

.png)

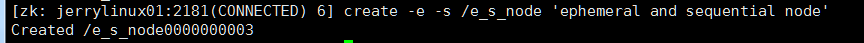

创建临时序列节点

create -e -s /e_s_node 'ephemeral and sequential node'

.png)

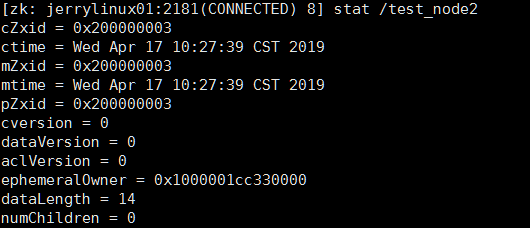

3)查看节点状态

stat /test_node

.png)

.png)

4)查看节点数据内容

get /test_node

.png)

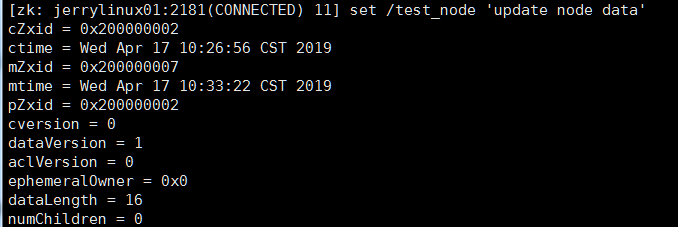

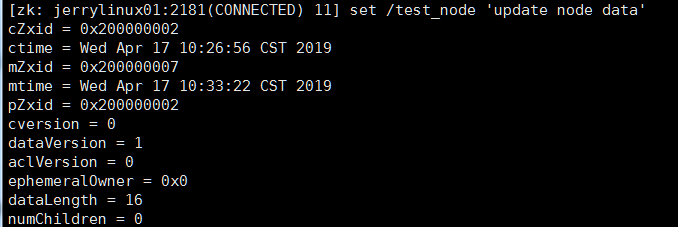

5)设置节点数据

set /test_node 'update node data'

说明:最后面的数字为版本号

.png)

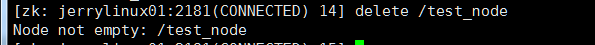

6)删除节点

[zk: jerrylinux01:2181(CONNECTED) 13] create /test_node/abc 'adffdfdfdfdfdff'

delete /test_node

注意:如果/test_node下有子节点,则删除会报错,此时可以使用递归删除命令rmr

.png)

rmr /test_node

7)设置节点Acl

setAcl /test_node ip:192.168.78.129:rcdwa

.png)

c

c

create (c) 创建子节点权限

delete (d)删除节点权限

read (r)读取节点数据权限

write (w)修改节点数据权限

admin (a) 设置子节点权限的权限

8)获取节点Acl

getAcl /test_node

部署kafka集群

说明:我们使用三台机器搭建Kafka集群

解压并挪到/usr/local(jerrylinux01操作)

tar zxf kafka_2.11-2.1.1.tgz

mv kafka_2.11-2.1.1 /usr/local/kafka

配置(aming01操作)

cd /usr/local/kafka

mkdir logs

vim config/server.properties #按如下方法配置

broker.id=1 #当前机器在集群中的唯一标识,和zookeeper的myid性质一样

port=9092 #当前kafka对外提供服务的端口默认是9092

host.name=192.168.78.128 #本机IP

num.io.threads=8 #这个是borker进行I/O处理的线程数

log.dirs=/usr/local/kafka/logs #消息存放的目录,这个目录可以配置为“,”逗号分割的表达式,上面的num.io.threads要大于这个目录的个数这个目录,如果配置多个目录,新创建的topic他把消息持久化的地方是,当前以逗号分割的目录中,那个分区数最少就放那一个

socket.send.buffer.bytes=102400 #发送缓冲区buffer大小,数据不是一下子就发送的,先回存储到缓冲区了到达一定的大小后在发送,能提高性能

socket.receive.buffer.bytes=102400 #kafka接收缓冲区大小,当数据到达一定大小后在序列化到磁盘

socket.request.max.bytes=104857600 #这个参数是向kafka请求消息或者向kafka发送消息的请请求的最大数,这个值不能超过java的堆栈大小

num.partitions=1 #默认的分区数,一个topic默认1个分区数

log.retention.hours=168 #默认消息的最大持久化时间,168小时,7天

message.max.byte=5242880 #消息保存的最大值5M

default.replication.factor=2 #kafka保存消息的副本数,如果一个副本失效了,另一个还可以继续提供服务

replica.fetch.max.bytes=5242880 #取消息的最大直接数

log.segment.bytes=1073741824 #这个参数是:因为kafka的消息是以追加的形式落地到文件,当超过这个值的时候,kafka会新起一个文件

log.retention.check.interval.ms=300000 #每隔300000毫秒去检查上面配置的log失效时间(log.retention.hours=168 ),到目录查看是否有过期的消息如果有,删除

log.cleaner.enable=false #是否启用log压缩,一般不用启用,启用的话可以提高性能

zookeeper.connect=jerrylinux01:2181,jerrylinux02:2181,jerrylinux03:2181 #设置zookeeper的连接端口

分发到另外两台机器(jerrylinux01操作)

scp -r /usr/local/kafka jerrylinux02:/usr/local/

scp -r /usr/local/kafka jerrylinux03:/usr/local/

修改配置文件(jerrylinux02/jerrylinux03操作)

vim config/server.properties #jerrylinux02, 将brokerid设置为2,host.name设置为192.168.78.129

vim config/server.properties #jerrylinux03, 将brokerid设置为3,host.name设置为192.168.78.130

启动服务(三台都操作)

/usr/local/kafka/bin/kafka-server-start.sh -daemon /usr/local/kafka/config/server.properties

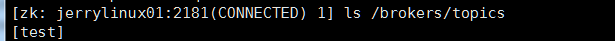

测试

jerrylinux01作为生产者,jerrylinux03作为消费者

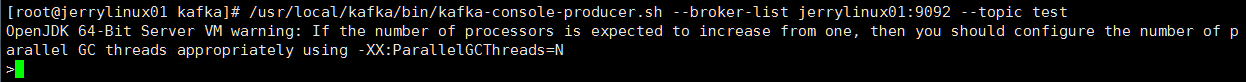

在jerrylinux01上执行:

创建一个主题test:一个分区,两个副本

/usr/local/kafka/bin/kafka-topics.sh --create --zookeeper jerrylinux01:2181 --replication-factor 2 --partitions 1 --topic test

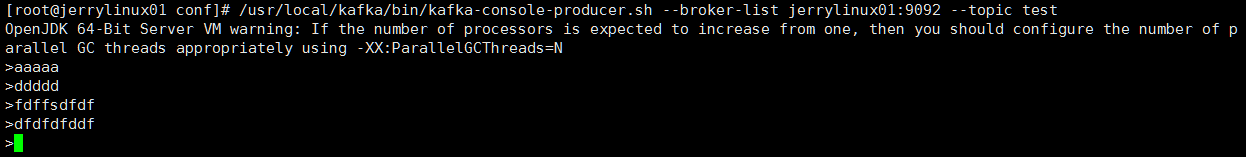

创建一个生产者(消息发布者)

/usr/local/kafka/bin/kafka-console-producer.sh --broker-list jerrylinux01:9092 --topic test

#此时会进入到新的console(以>开头)

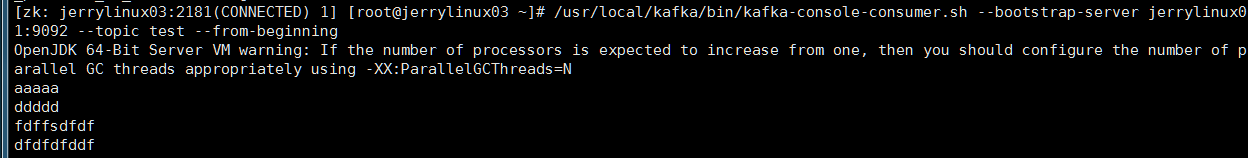

在jerrylinux03上执行

创建一个消费者(消息订阅者)

/usr/local/kafka/bin/kafka-console-consumer.sh --bootstrap-server jerrylinux01:9092 --topic test --from-beginning

#此时也会进入到另外一个console下

再到aming01上的> 下输入一些字符,然后aming03上就可以看到了。

常用命令

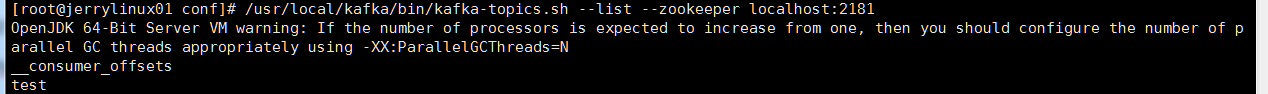

查看主题

/usr/local/kafka/bin/kafka-topics.sh --list --zookeeper localhost:2181

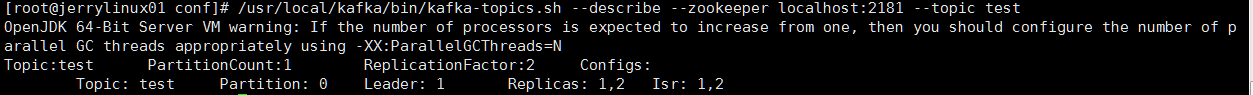

查看主题详情

/usr/local/kafka/bin/kafka-topics.sh --describe --zookeeper localhost:2181 --topic test

删除主题(需设置参数delete.topic.enable=true)

/usr/local/kafka/bin/kafka-topics.sh --zookeeper localhost:2181 --delete --topic test

生产者参数查看

/usr/local/kafka/bin/kafka-console-producer.sh

消费者参数查看

/usr/local/kafka/bin/kafka-console-consumer.sh

1541

1541

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?