这篇文章主要介绍两个序列生成的GAN模型,分别是发表在AAAI 2017上的SeqGan和 NIPS 2017上的 RankGAN

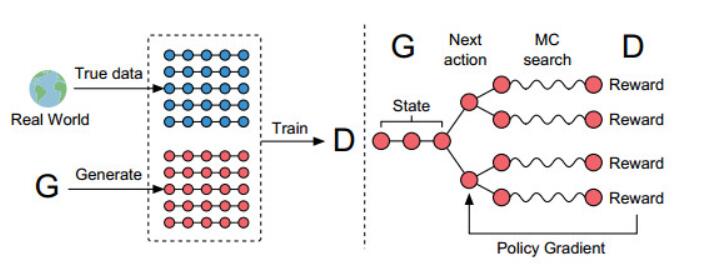

SeqGAN: Sequence Generative Adversarial Nets with Policy Gradientarxiv.org Adversarial Ranking for Language Generation59.80.44.49除了在图像领域有显著的成果,在序列生成任务中,GAN并不能直接应用。与连续型数值的图像不同,在序列生成中数据由于经过了采样,离散的数据是没办法直接计算梯度的。除此之外,GAN仅仅可以对整个序列给出一个score或者loss,没办法对部分生成的序列进行判断,如何权衡当前和未来的score是很重要的。对于第一个问题,可以用强化学习中的policy gradient来解决,而对于第二个问题,则可以使用Monte Carlo方法来近似状态-动作值。下面分别来介绍两篇论文。

Sequence Generative Adversarial Nets

用

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

795

795

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?