1.kafka下载

下载地址:http://kafka.apache.org/downloads 选择二进制版本

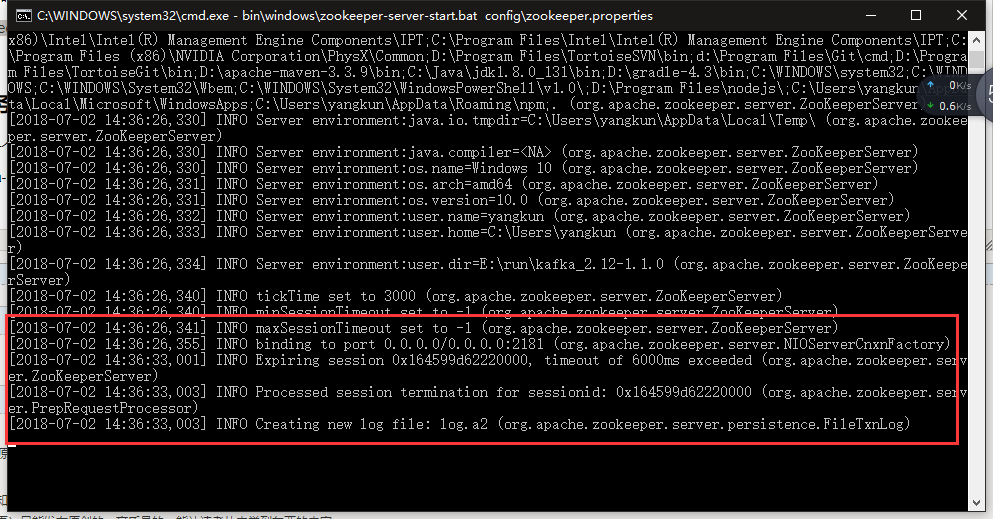

2.启动zookeeper

下载后解压到本地,不用修改配置

在kafka目录下打开第一个cmd命令(按住shift 在文件夹空白处右键 直接打开命令行)

(先输入 title zookeeper 可以把cmd窗口名称改为zookeeper)

输入 bin\windows\zookeeper-server-start.bat config\zookeeper.properties

zk启动成功

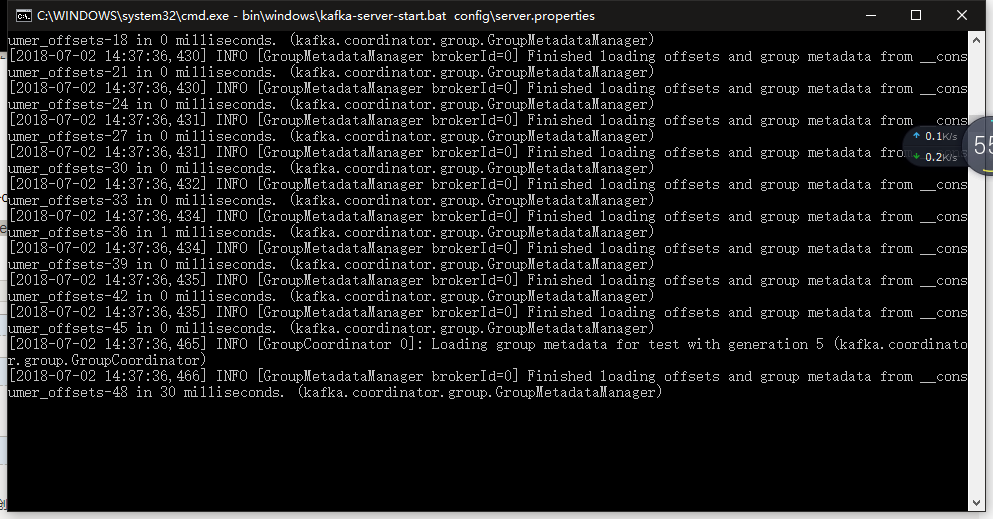

3.启动kafka服务

在kafka目录下新打开第二个cmd窗口

输入 bin\windows\kafka-server-start.bat config\server.properties

kafka 服务器启动成功

4.创建topic

打开第三个cmd窗口(执行完毕可以关闭)

输入 bin\windows\kafka-topics.bat --create --zookeeper 127.0.0.1:2181 --replication-factor 1 --partitions 1 --topi

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

147

147

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?