最近需要用到FCN来分割一些物体,所以一直在苦苦学习中,光是跑FCN就用了挺久的时间,最重要的是在数据集的格式上。现在做一下总结,针对小白。如果有错误希望能及时指出。谢谢!

准备工作

我用的是caffe和fcn,caffe可以从这里获得

git clone https://github.com/BVLC/caffe.git

caffe的安装可以根据我的另一片博客深度学习ssd配置并在VGG模型上训练自己的数据来安装。

fcn使用这个fcn.berkeleyvision.org

git clone https://github.com/shelhamer/fcn.berkeleyvision.org.git

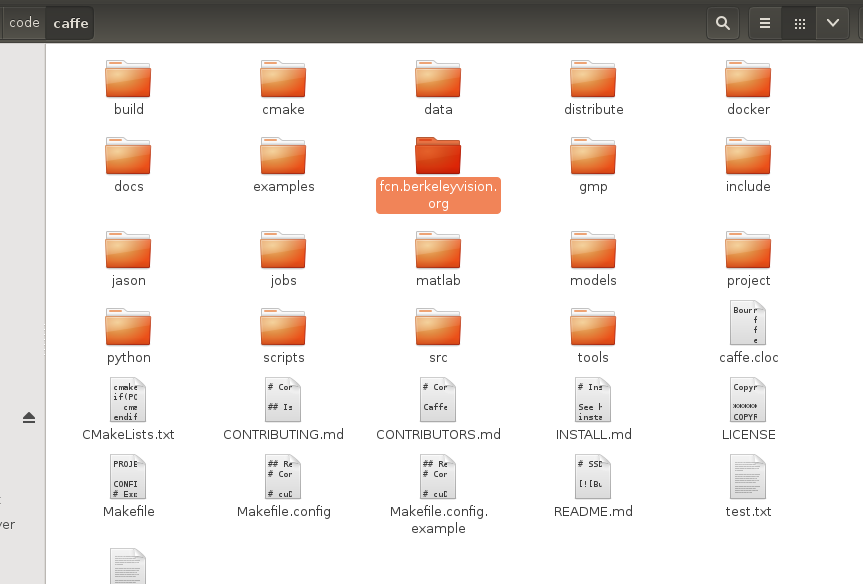

把fcn这个文件放在caffe目录中就可以了,如图:

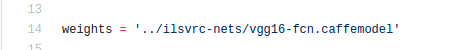

现在准备用voc-fcn32s这个来训练。先把预先需要的模型下载了。在voc-fcn32s/solve.py中可以看到:

所以我下载了一个vgg16的模型,地址:VGG_ILSVRC_16_layers。

准备数据集

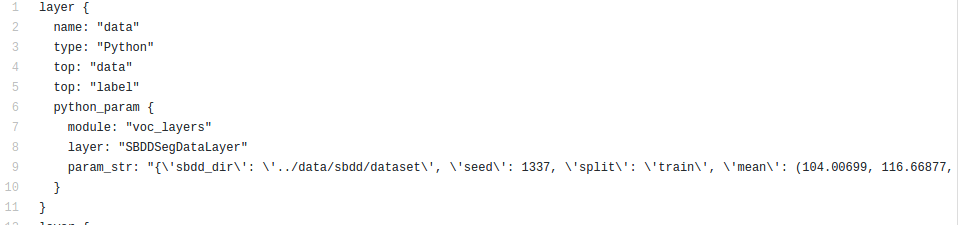

这个是最重要的,大部分不成功的原因都来自这里。 在voc-fcn32/train.prototxt中: 在val.prototxt中

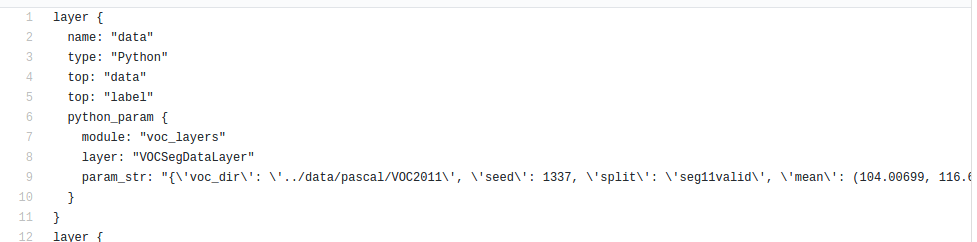

在val.prototxt中

可以看到是使用sbd这个数据集进行训练,使用voc的数据集进行测试。在这里我们只需要更换'../data/sbdd/dataset'和'../data/pascal/VOC2011'就可以了。

**注意: **如果不想使用sdb那种存放数据格式的话,我们可以使用自己的数据格式。

打开voc_layers.py文件,可以看到有两个类,一个是处理voc数据集格式的,一个是处理sbd数据集格式的。 对于voc格式来说,目录的大概结构是这样的

VOC2011

|____JPEGImages

|____SegmentationClass

|____ImageSets

|______Segmentation

- JPEGImages中存放.jpg格式的彩色图片

- SegmentationClass中存放label图片。重点注意: label图片一定是要单通道的!而且每个像素的值只能是从0开始到N。N为你定义的类别数+1,这个1是背景类,黑的。

- Segmentation中存放写有图片的名字的train.txt,这个txt的名字要和上面图片中split参数决定,比如train.prototxt的split参数是train,而val.prototxt中的split参数则是seg11valid,所以就要叫做seg11valid.txt。txt文件中的图片名字不带路径和后缀。比如你的图片名字叫a.jpg,bb.jpg,ccc.jpg,那么里面在txt中就写

a

bb

ccc

这些目录结构可以对应代码中的:

# load indices for images and labels

split_f = '{}/ImageSets/Segmentation/{}.txt'.format(self.voc_dir,self.split)

self.indices = open(split_f, 'r').read().splitlines()

self.idx = 0

...

...

...

def load_image(self, idx):

im = Image.open('{}/JPEGImages/{}.jpg'.format(self.voc_dir, idx))

in_ = np.array(im, dtype=np.float32)

in_ = in_[:,:,::-1]

in_ -= self.mean

in_ = in_.transpose((2,0,1))

return in_

def load_label(self, idx):

im = Image.open('{}/SegmentationClass/{}.png'.format(self.voc_dir, idx))

label = np.array(im, dtype=np.uint8)

label = label[np.newaxis, ...]

return label

如果想要把sbd的数据集像voc的一样简单的话可以按照这个代码把SBDDSegDataLayer类中的load_label函数改成

def load_label(self, idx):

im = Image.open('{}/SegmentationClass/{}.png'.format(self.sbdd_dir, idx))

label = np.array(im, dtype=np.uint8)

label = label[np.newaxis, ...]

return label

在load_image函数中的图片路径也需要改一改,还有加载txt的地方也要改一下。

训练

全部改完后就可以开始训练了。如果爆出一下文件找不到问题,那就自己修改下路径。 如果说surger,score找不到 那么修改solve.py文件,把import sys提前,并加入路径,如下:

import sys

sys.path.append('/your-path-to-caffe/caffe/fcn.berkeleyvision.org')

import caffe

import surgery, score

import numpy as np

import os

然后开心的运行这个文件开始训练:

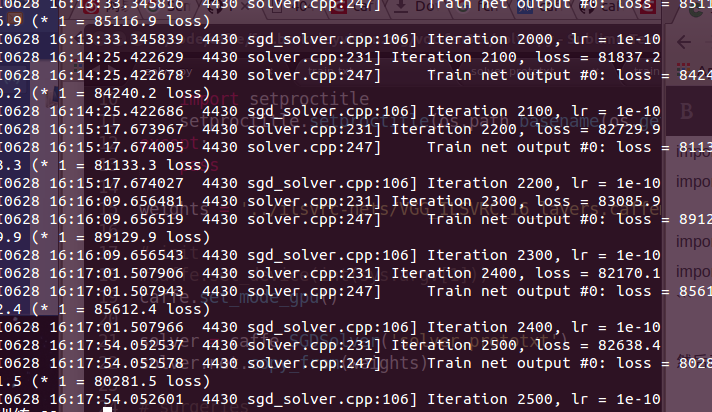

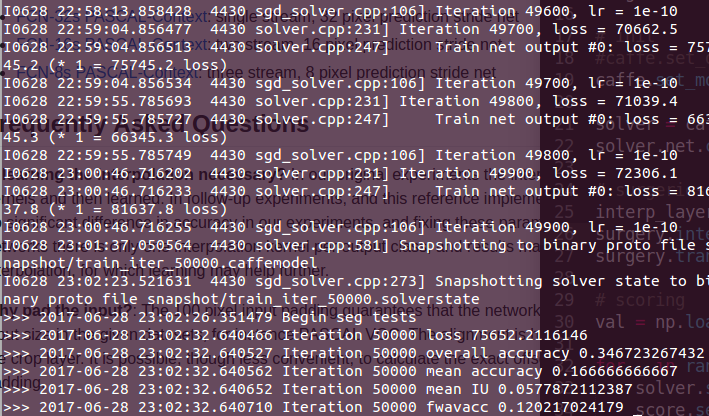

loss有点大,先观望一下,如果有错误我会及时更新。

后继 发现loss一直很到,直到结束依旧这样。

网上查了下原因,是说deconvolution layer没有初始化什么的,要加入weight filler 和bias filler,http://www.cnblogs.com/lvlvlvlvlv/p/6353637.html。 fcn中有提示说如果输出或者参数是0的话,可以加个surgery.transplant()。

Why are all the outputs/gradients/parameters zero?: This is almost universally due to not initializing the weights as needed.

To reproduce our FCN training, or train your own FCNs, it is crucial to transplant the weights from the corresponding ILSVRC net such as VGG16. The included surgery.transplant() method can help with this.

然后这个帖子 中发现使用规则

base_net = caffe.Net('vgg16.prototxt', 'vgg16.caffemodel', caffe.TEST)

surgery.transplant(solver.net, base_net)

del base_net

具体实现可以参考这个帖子,对于处理voc-fcn写的很详细。参照这个改完后200次迭代loss就下降了一半。

参考

图像分割实验:FCN数据集制作,网络模型定义,网络训练(提供数据集和模型文件,以供参考)

FCN-for-semantic-image-segmentation 训练过程的一些坑记录

caffe的FCN的loss居高不下和执行训练命令的脚本有关是怎么回事?

3169

3169

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?