1.可视化(散点图顶部回归)

2.查看线性回归产生的误差(误差即某个人的实际净值,与回归预测的净值之差)

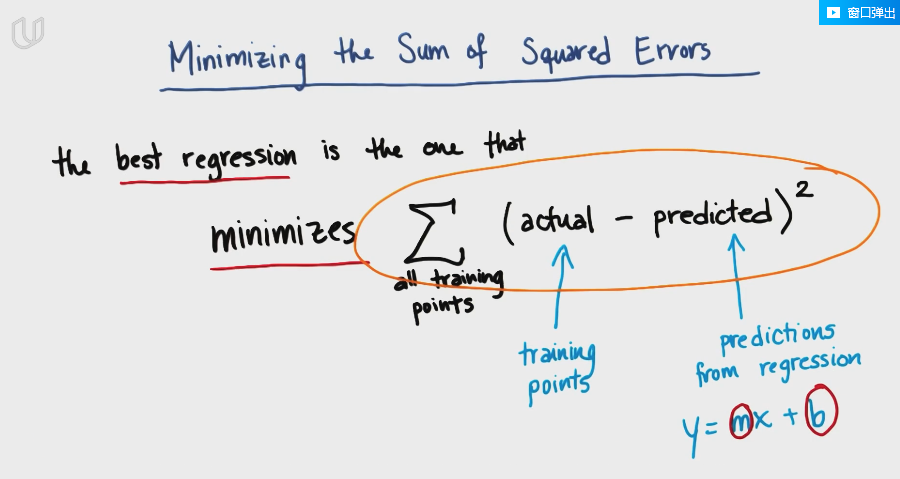

算法:

1.普通最小二乘法,或者OLS( sklearn LinearRegression )

2.梯度下降法,

这两种算法是最大程度上降低回归中的误差平方和

1.可视化(散点图顶部回归)

2.查看线性回归产生的误差(误差即某个人的实际净值,与回归预测的净值之差)

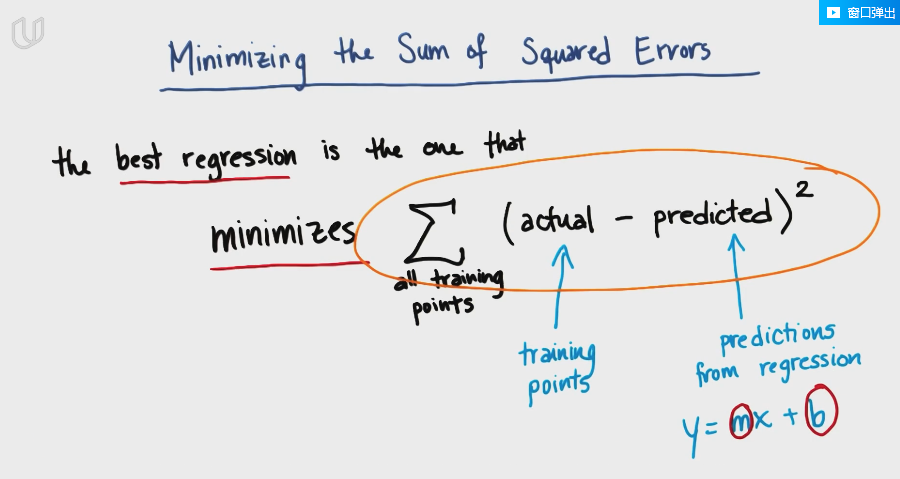

算法:

1.普通最小二乘法,或者OLS( sklearn LinearRegression )

2.梯度下降法,

这两种算法是最大程度上降低回归中的误差平方和

转载于:https://my.oschina.net/Bettyty/blog/754177

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?