目的:

通过网络爬虫爬取中国最小粒度的区域维度信息,包括省(Province) 、市(City)、县(County)、镇(town)、村委会(village)

主网站链接:

主要jar包:

之前一节我们说过java爬虫从网络上利用jsoup获取网页文本,也就是说我们可以有三种方法获取html,一是根据url链接,而是从本地路径获取,三是通过字符串解析成html文档

在这里,我们利用前两种搭配使用:

先看本地是否存在需要的网页,如果不存在就通过url获取并保存在本地(下次就可以不需要重新从网络加载)

我们先建一个类叫做Html类,具体内容如下:

packageProduct;importjava.io.BufferedInputStream;importjava.io.BufferedOutputStream;importjava.io.File;importjava.io.FileOutputStream;importjava.io.IOException;importjava.io.InputStream;importjava.net.URL;importjava.util.ArrayList;importjava.util.Arrays;import org.jsoup.*;import org.jsoup.nodes.*;import org.jsoup.select.*;public classHtml {//根据url从网络获取网页文本

publicDocument getHtmlTextByUrl(String url)

{

Document doc= null;try{//doc = Jsoup.connect(url).timeout(5000000).get();

int i = (int) (Math.random()*1000); //做一个随机延时,防止网站屏蔽

while(i!=0)

{ i--; }

doc= Jsoup.connect(url).data("query", "Java")

.userAgent("Mozilla") .cookie("auth", "token")

.timeout(300000) .post();

}catch(IOException e)

{ e.printStackTrace();try{

doc= Jsoup.connect(url).timeout(5000000).get();

}catch(IOException e1)

{//TODO Auto-generated catch block e1.printStackTrace(); } }returndoc;

}//根据本地路径获取网页文本,如果不存在就通过url从网络获取并保存

publicDocument getHtmlTextByPath(String name,String url)

{

String path= "D:/Html/" +name+".html";

Document doc= null;

File input= newFile(path);

String urlcat=url;try{

doc= Jsoup.parse(input, "GBK");if(!doc.children().isEmpty())

{

doc=null; System.out.println("已经存在"); }

}catch(IOException e)

{

System.out.println("文件未找到,正在从网络获取.......");

doc= this.getHtmlTextByUrl(url);//并且保存到本地

this.Save_Html(url, name); }returndoc; } //此处为保存网页的函数

//将网页保存在本地(通过url,和保存的名字)

public voidSave_Html(String url,String name) {try{

name= name+".html";//System.out.print(name);

File dest = new File("D:/Html/" +name);//D:\Html//接收字节输入流

InputStream is;//字节输出流

FileOutputStream fos = newFileOutputStream(dest);

URL temp= newURL(url);

is=temp.openStream();//为字节输入流加缓冲

BufferedInputStream bis = newBufferedInputStream(is);//为字节输出流加缓冲

BufferedOutputStream bos = newBufferedOutputStream(fos);intlength;byte[] bytes = new byte[1024*20];while((length = bis.read(bytes, 0, bytes.length)) != -1){

fos.write(bytes,0, length);

}

bos.close();

fos.close();

bis.close();

is.close();

}catch(IOException e) {

e.printStackTrace();

}

}

这样通过Html这个类,调用getHtmlTextByPath函数,传入我们的链接和想要保存的名称,接下就可以对这个网页文本提取信息

并将整个网页下载到我们的本地。

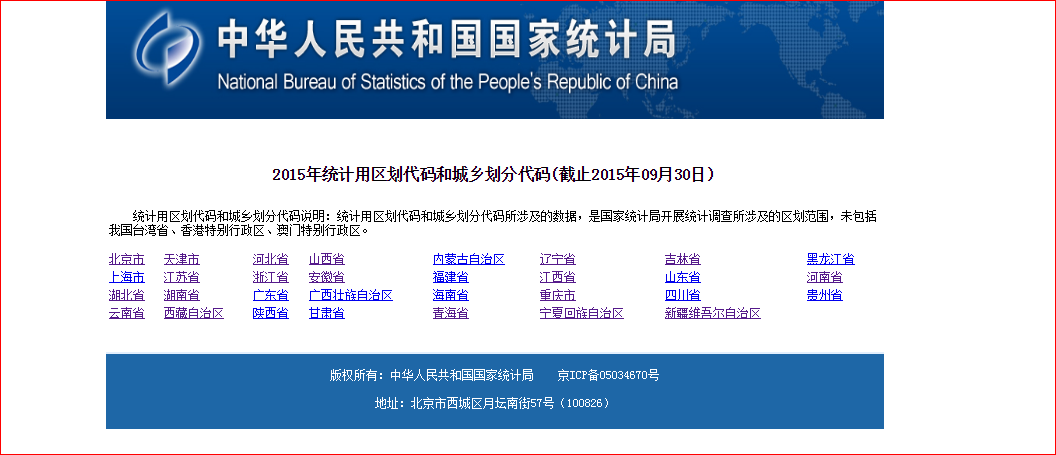

看到我们的网站是这样的:

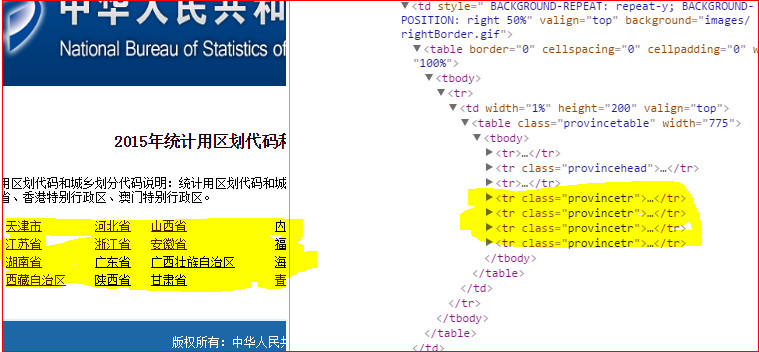

利用谷歌浏览右键检查元素,我们注意观察黄色标记的部分:

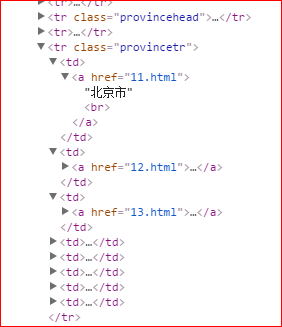

我们发现这些文本信息和超链接信息在tr 下的td下的a标签内,利用我们的jsoup可以直接获取到这些信息,详情请看:

//根据元素属性获取某个元素内的elements列表

publicElements getEleByClass(Document doc,String className)

{

Elements elements= null;elements=doc.select(className);//这里把我们获取到的html文本doc,和工具class名,注意

returnelements; //此处返回的就是所有的tr集合}

我们在调用的时候,就直接把我们获取的html文本,以及"tr.provincertr"作为参数传入,在来解析tr集合内部的信息,

也就是td中两个a标签href和文本内容:比如href="12.html" 北京

代码如下:

//获取省 、市 、县等的信息

publicArrayList getProvince(String name,String url ,String type)

{ ArrayList result= newArrayList();//"tr.provincetr"

String classtype = "tr."+type+"tr";//从网络上获取网页//Document doc = this.getHtmlTextByUrl(url);//从本地获取网页,如果没有则从网络获取

Document doc2 = this.getHtmlTextByPath(name,url);

System.out.println(name);if(doc2!=null){

Elements es=this.getEleByClass(doc2,classtype); //tr的集合for(Element e : es) //依次循环每个元素,也就是一个tr

{if(e!=null){for(Element ec : e.children()) //一个tr的子元素td,td内包含a标签

{

String[] prv= new String[4]; //身份的信息: 原来的url(当前url) 名称(北京) 现在url(也就是北京的url) 类型(prv)省if(ec.children().first()!=null)

{//原来的url

prv[0]=url; //就是参数url//身份名称

System.out.println(ec.children().first().ownText());

prv[1]=ec.children().first().ownText(); //a标签文本 如:北京//身份url地址//System.out.println(ec.children().first().attr("href"));//http://www.stats.gov.cn/tjsj/tjbz/tjyqhdmhcxhfdm/2015/index.html

String ownurl=ec.children().first().attr("abs:href"); //北京的url//因为如果从本地取得话,会成为本地url,所以保留第一次从网络上的url,保证url不为空

if(ownurl.length()<10)

{ connectOrcl c= newconnectOrcl();

ownurl= c.selectOne(prv[1]); //从数据库中取,这是另一个调用数据库函数,根据名称取url

}

prv[2]=ownurl; //如:北京自己的url

System.out.println(prv[2]);//级别

prv[3]=type; //就是刚刚传的类型,后面会有city 、county等//将所有身份加入list中

result.add(prv);}

}}

}

}returnresult; //反回所有的省份信息集合,存数据库,字段类型为: baseurl name ownurl levelname(type) updatetime

}

java获取本机的名称和ip

//获取本机名称和IP

public static voidmain(String[] args) {

InetAddress ia=null;try{

ia=ia.getLocalHost();

String localname=ia.getHostName();

String localip=ia.getHostAddress();

System.out.println("本机名称是:"+localname);

System.out.println("本机的ip是 :"+localip);

}catch(UnknownHostException e) {//TODO Auto-generated catch block

e.printStackTrace();

}

}

java获取本机的屏幕分辨率,DPI,以及屏幕尺寸

屏幕分辨率:比如1366*768

DPI:意思是说一英寸多少个象素

屏幕的物理尺寸:屏幕的物理大小还需要知道屏幕的dpi ,然后用象素除以dpi 就可以得到多少英寸了

//获取电脑屏幕信息

public static voidgetScreen()

{

Dimension screensize=Toolkit.getDefaultToolkit().getScreenSize();int width = (int)screensize.getWidth();int height = (int)screensize.getHeight();

System.out.println("宽的像素:"+width+"高的像素:"+height);//获取屏幕的dpi

int dpi =Toolkit.getDefaultToolkit().getScreenResolution();

System.out.println(dpi);//根据dpi和像素,可以计算物理尺寸

System.out.println("宽:"+width/dpi+"高:"+height/dpi);

}

341

341

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?