本文旨在介绍一些常用的神经网络的张量计算公式。

主要参考资料:

- 《矩阵分析与应用》

- 矩阵求导术(上)

- 矩阵求导术(下)

- 《word2vec中的数学原理详解》

- 其他一些网页截图

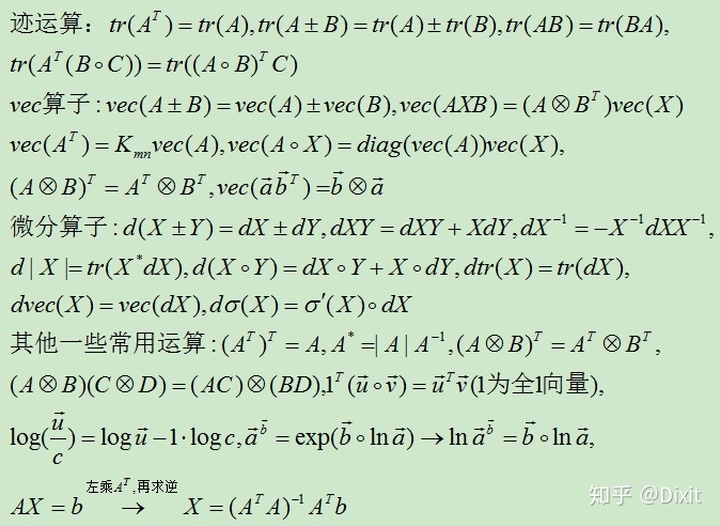

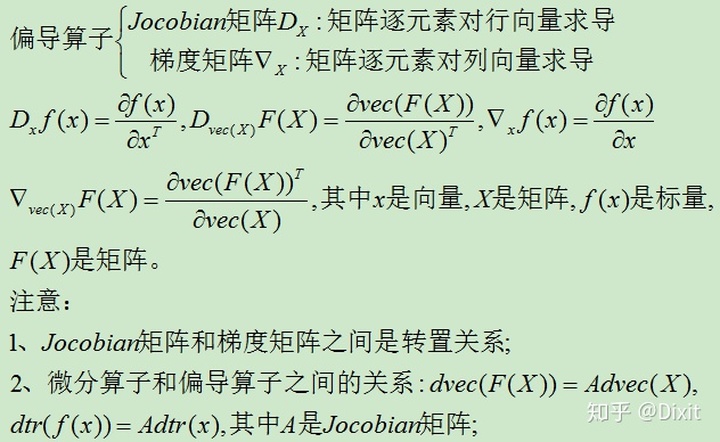

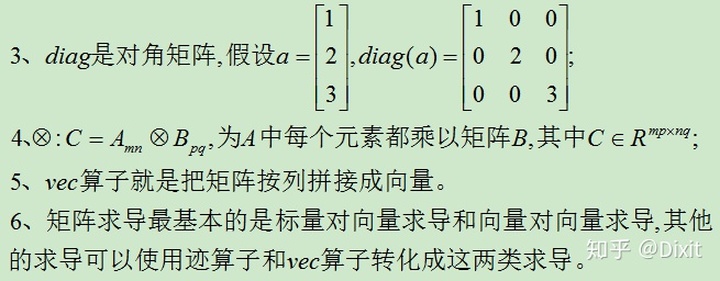

矩阵基本运算

import numpy as np

##验证:

A=np.arange(1,10).reshape(3,3)

X=np.arange(10,19).reshape(3,3)

print((A*X).reshape(9,1)==np.dot(np.diag(A.flatten()),X.reshape(9,1)))

##验证:

A=np.arange(1,10).reshape(3,3)

X=np.arange(2,14).reshape(3,4)

B=np.arange(3,23).reshape(4,5)

print(A.dot(X).dot(B).reshape(15,1)==np.kron(A,B.T).dot(X.reshape(12,1)))

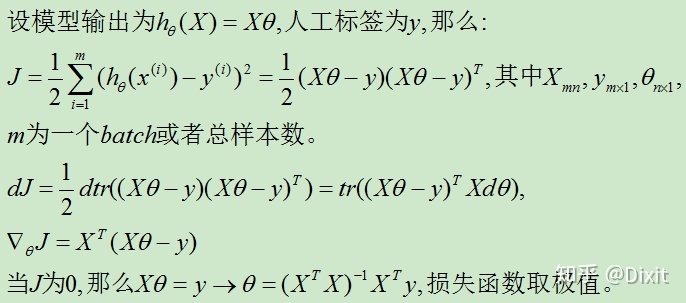

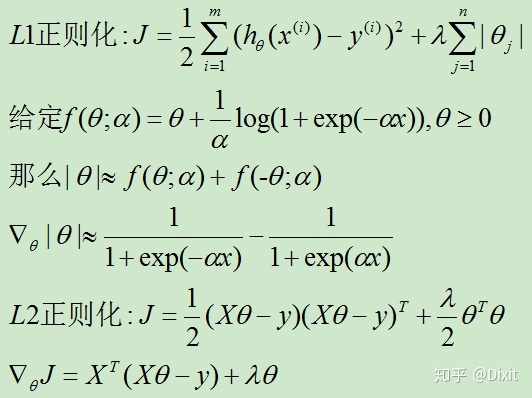

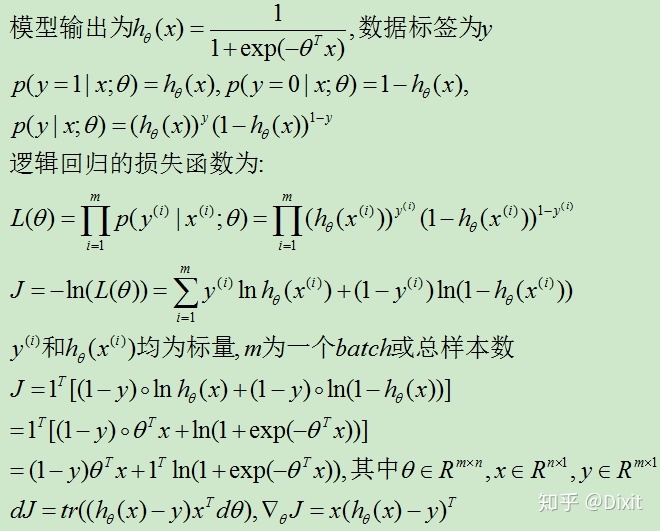

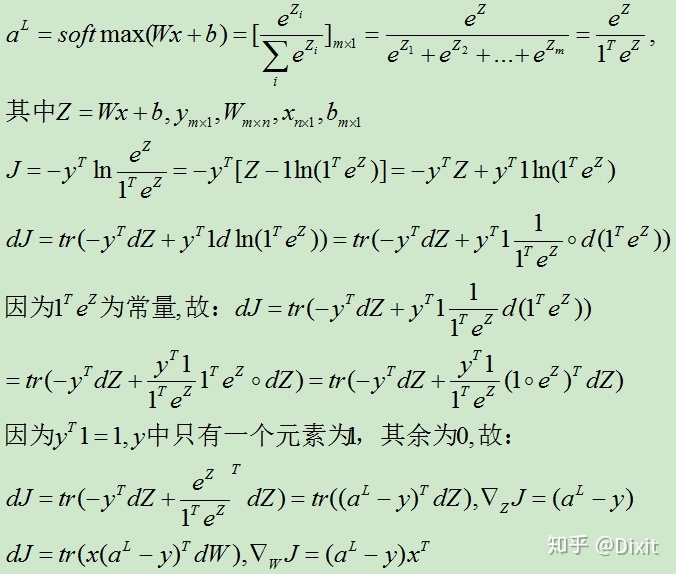

损失函数和正则化

损失函数包含模型输出和人工标签。通常损失函数是标量函数,因此可以使用迹运算来辅助求导。

- 线性回归的损失函数

- 加上正则化

- 逻辑回归的损失函数

- 多分类的损失函数

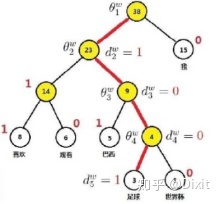

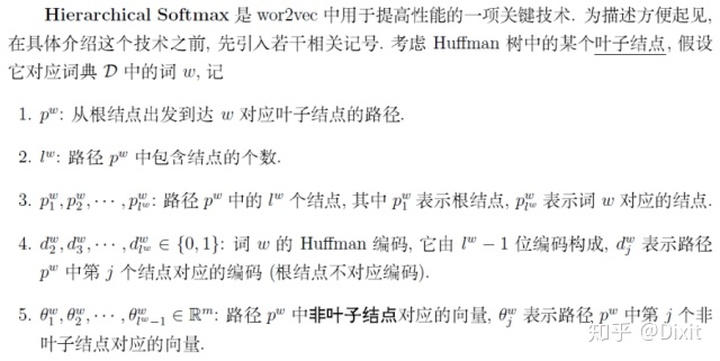

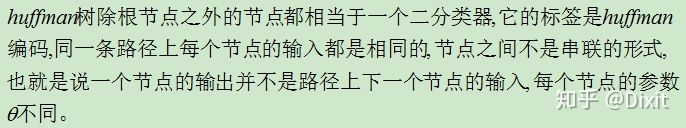

word2vec

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1111

1111

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?