Q: 这篇论文试图解决什么问题?

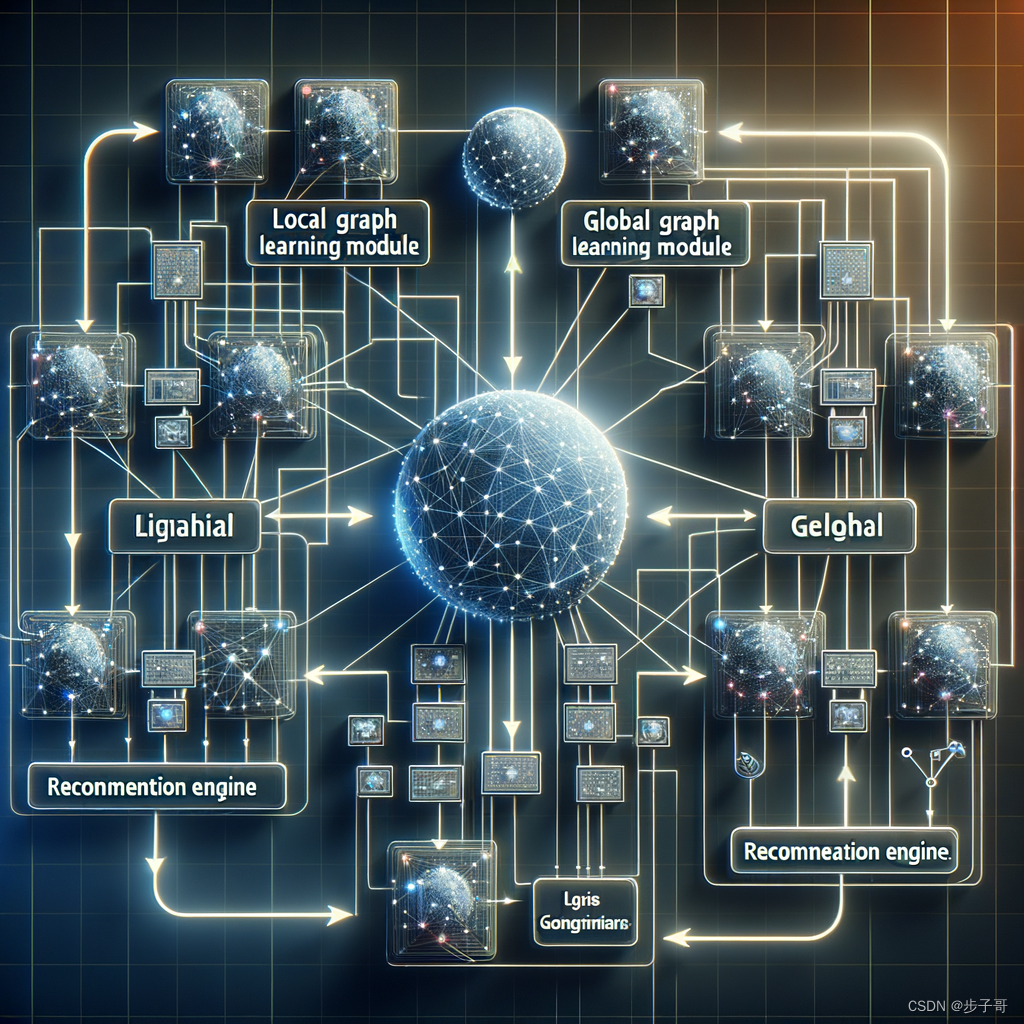

A: 这篇论文试图解决多模态推荐系统中的两个主要问题:1. 共享用户ID嵌入导致的协作信号和多模态信号之间的耦合问题。2. 缺乏对鲁棒全局用户兴趣的探索,以缓解局部兴趣建模面临的稀疏交互问题。为了解决这些问题,论文提出了一种新的局部和全局图学习引导的多模态推荐器(LGMRec),它联合建模局部和全局用户兴趣。具体来说,论文提出了一个局部图嵌入模块,通过在用户-项目交互图上分别进行消息传递,独立地学习与协作相关和模态相关的用户和项目的局部兴趣。此外,设计了一个全局超图嵌入模块,通过建模有见地的全局依赖关系来捕获全局用户和项目嵌入。在超图嵌入空间中获得的全局嵌入可以与两个解耦的局部嵌入相结合,以提高推荐的准确性和鲁棒性。

Q: 有哪些相关研究?

A: 根据论文的介绍,相关研究主要可以分为以下几个方向:1. 多模态推荐(Multi-modal Recommendation): 早期研究通常将多模态内容作为辅助信息融入传统的协同过滤框架,或者利用深度自编码器来建模模态特征。后来受到图神经网络成功的启发,许多研究开始利用图结构来捕捉用户和项目的高阶兴趣。2. 图基推荐(Graph-based Recommendation): 利用图神经网络建模

论文提出LGMRec模型解决多模态推荐中的耦合问题和全局兴趣探索,通过局部图和全局超图学习,提升推荐准确性和鲁棒性。实验证明其在多个数据集上的有效性。

论文提出LGMRec模型解决多模态推荐中的耦合问题和全局兴趣探索,通过局部图和全局超图学习,提升推荐准确性和鲁棒性。实验证明其在多个数据集上的有效性。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?